Innhold Vis

Gemini 3.1 Flash Live er Googles nye lavlatens-modell for sanntids tale og video, lansert 26. mars 2026. Modellen er tilgjengelig via Gemini API og Google AI Studio, og driver nå både Gemini Live-appen og Search Live globalt – i over 200 land. Google kaller det sin «høyeste kvalitets audio- og stemmemodell til nå».

Det som skiller denne fra eldre løsninger er at den kollapser den tradisjonelle stemmeprosesseringsstabelen til én enkelt nativ audio-til-audio-modell. Ingen mellomliggende transkripsjonsslag, ingen pipeline med mange trinn – bare direkte lyd inn og lyd ut, med støtte for video-inndata underveis. Og det er raskere enn det meste vi har sett til nå.

Hva betyr dette i praksis? For deg som bygger agenter, er dette ganske stor nyhet. Modellen støtter funksjonsanrop, barge-in (brukeren avbryter uten at agenten krasjer), og WebSocket-kommunikasjon for full-duplex – altså toveis samtale uten ventetid. Og den forstår 90+ språk.

Hva er Gemini 3.1 Flash Live?

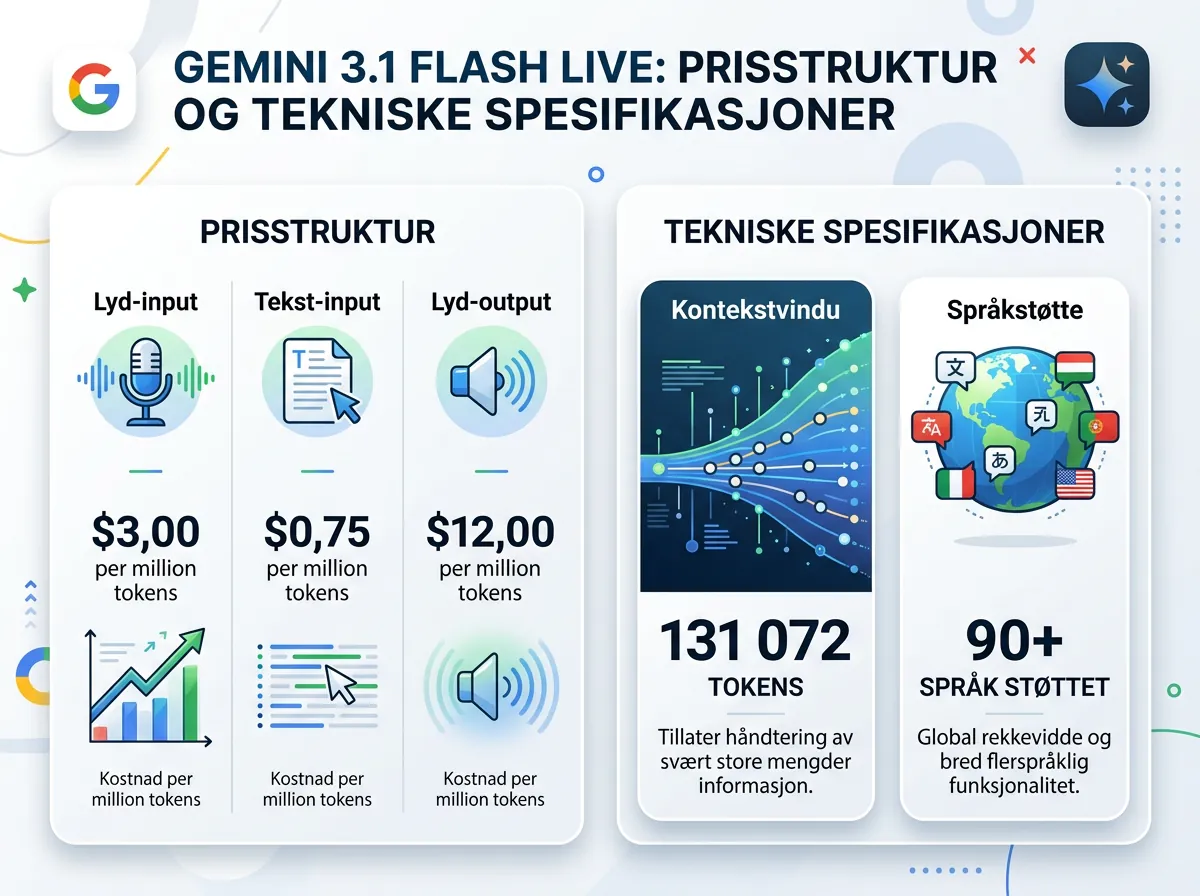

Teknisk sett er Gemini 3.1 Flash Live en audio-til-audio-modell med 131 072 tokens kontekstvindu inn og 65 536 tokens ut. Den godtar tekst, bilder, lyd og video som input, og returnerer tekst og audio som output.

Modellen bruker WebSockets (WSS) for kommunikasjon, noe som gir full-duplex – altså at du kan sende og motta data samtidig, hele tiden. Det betyr at brukeren kan avbryte agenten midt i en setning («barge-in»), og systemet håndterer det rent uten at samtalen kollapser.

Sammenlignet med Gemini 2.5 Flash Live er forbedringene konkrete: lavere latens, bedre støyfiltrering (modellen filtrerer ut bakgrunnsstøy mer effektivt), og sterkere instruksjonsopfølging. Den siste biten er undervurdert viktig – at en agent faktisk holder seg innenfor det systemprompten sier, selv når samtalen tar uventede svinger.

På ComplexFuncBench Audio – en benchmark for flerstegs funksjonsanrop med ulike begrensninger – scorer modellen 90,8%. Det er bransjens høyeste publiserte tall på dette målet per nå.

Hva koster Gemini 3.1 Flash Live?

Priser via Gemini API (betalt tier):

- Tekst-input: $0,75 per million tokens

- Audio-input: $3,00 per million tokens (eller $0,005 per minutt)

- Video/bilde-input: $1,00 per million tokens (eller $0,002 per minutt)

- Tekst-output: $4,50 per million tokens

- Audio-output: $12,00 per million tokens (eller $0,018 per minutt)

Det gratis nivået finnes også, men Google forbeholder seg retten til å bruke data derfra til å forbedre modellene. Vil du bygge noe produksjonsklart, bør du bruke betalt tier.

For å sette dette i perspektiv: en ti-minutters sanntidssamtale med audio inn og audio ut vil koste i størrelsesorden 20-30 øre på betalt tier. Det er billig nok til at det åpner opp for brukstilfeller som tidligere var for dyre til å skalere.

Hva er nytt sammenlignet med Gemini 2.5 Flash Live?

Hvis du har brukt Gemini 2.5 Flash Live i API-et, er det noen ting du bør vite om migreringen. Modellstrengen endres til gemini-3.1-flash-live-preview. Thinking-parameteret er nå thinkingLevel i stedet for thinkingBudget. Server-events kan nå inneholde flere innholdsdeler samtidig.

Standard turn-dekning er endret til TURN_INCLUDES_AUDIO_ACTIVITY_AND_ALL_VIDEO – modellen er altså mer aggressiv på å plukke opp alt som skjer i sanntid, inkludert video.

For brukerne av Gemini Live-appen på Android og iOS er endringene merkbare: raskere svar, færre pauser, og dobbelt så lang samtalehukommelse. Modellen tilpasser også svarlengde og tone dynamisk – kortere svar på raske spørsmål, lengre når det trengs.

Hva kan du bygge med dette?

Tenk sanntids kundeservice-agenter som faktisk forstår hva du sier – inkludert at du snakker rolig, eller at du snakker fort og irritert. Tenk undervisningsverktøy der AI-en hører at en elev nøler og tilpasser forklaringen. Tenk tilgjengelighetsteknologi der blinde brukere kan navigere digitale grensesnitt via tale og video.

Agentbygging er det som gjør dette ekstra interessant. Modellen kan kalle funksjoner under en samtale – ikke etter – noe som betyr at en agent kan slå opp informasjon, utføre handlinger og rapportere tilbake mens du fortsatt prater. Det er en ganske vesentlig forskjell fra «chat, vent, svar»-modellen vi er vant til.

Jeg har tidligere skrevet om Gemini 3 Flash som et prisgunstig alternativ for koding, og den samme kostnadsfilosofien gjelder her – Google komprimerer prisene nedover og åpner opp for eksperimenter som for et år siden ville krevd budsjetter bare store selskaper hadde tilgang til.

Hvem bør teste dette nå?

Modellen er tilgjengelig i dag via Google AI Studio med modell-ID gemini-3.1-flash-live-preview. Den er i preview, noe som betyr at API-et og funksjonene kan endre seg – men det er tidlig nok til at du kan begynne å eksperimentere uten å binde deg til et ferdig produkt.

Hvis du driver med n8n-automatisering, er dette interessant å koble inn i agent-workflows der talebasert input gir mening. Hvis du bygger applikasjoner for nettleseren, er WebSocket-støtten veldig enkel å sette opp med JavaScript. Og hvis du bare er nysgjerrig på hvor god sanntidstale med AI faktisk er blitt – prøv Gemini Live på telefonen din, den kjører nå på denne modellen.

90+ språk, inkludert norsk. Det er verdt å merke seg.

Hva er du nysgjerrig på å bygge med sanntids multimodalitet? Er det kundestøtte, tilgjengelighet, eller noe helt annet? Fortell meg i kommentarfeltet.

Les komplett oversikt: Google Gemini – komplett norsk guide (2026).