Alt jeg har skrevet om

AI-Modeller

91 innlegg

Her tester og vurderer jeg AI-modellene som faktisk betyr noe. Fra Claude og GPT til Gemini, Llama og lokale modeller du kan kjøre på din egen maskin. Ingen PR-prat – bare ærlige erfaringer fra en som bruker disse verktøyene hver eneste dag. Hva funker, hva funker ikke, og hva er bare hype?

Qwen Image og alternativ historie – slik lager du fotorealistiske bilder fra tidslinjer som aldri skjedde

Qwen Image er Alibabas open source AI-modell for bildegenerering og -redigering. Her er hvordan den brukes til å lage fotorealistiske bilder fra alternative historiske tidslinjer – med ComfyUI-oppsett og GGUF-varianter ned til 8 GB VRAM.

Qwen 3 VL vs Gemma 4 – hvem vinner egentlig på vision-oppgaver?

Offisielle benchmarks peker mot Qwen 3 VL 32B som vinner over Gemma 4 31B på vision-oppgaver. Men side-om-side-testing med vLLM og FP8 lokalt avslører et annet bilde: Gemma 4 vinner i praksis. Her er hva benchmaxing faktisk betyr for deg som vil kjøre vision-AI lokalt.

SenseNova-U1 – nativ multimodal AI uten VAE og diffusion

SenseNova-U1 er en ny åpen kildekode-modell fra SenseTime som genererer bilder uten VAE, visuell encoder eller diffusion-prosess. NEO-Unify-arkitekturen behandler tekst og piksler nativt i én modell – og åpner for tekstrendering og infografikk der diffusion-modeller tradisjonelt mislykkes.

Mistral Medium 3.5 128B lansert – open weights, 256k kontekst og sterk kodeytelse

Mistral AI lanserte Medium 3.5 29. april 2026 – en 128 milliarder parameter tett modell med 256k kontekstvindu, open weights under modifisert MIT-lisens og sterk ytelse på koding og agentic oppgaver. API-pris $1,50/$7,50 per million tokens.

Poolside AI lanserer Laguna XS.2 og M.1 – spesialiserte agentic coding-modeller

Poolside AI lanserte 28. april 2026 sine to første offentlige modeller: Laguna M.1 (225B/23B aktive parametere) og Laguna XS.2 (33B/3B aktive, Apache 2.0). Begge er bygget for agentic coding og lange autonome kodingssessjoner – og begge er gratis via API og OpenRouter nå.

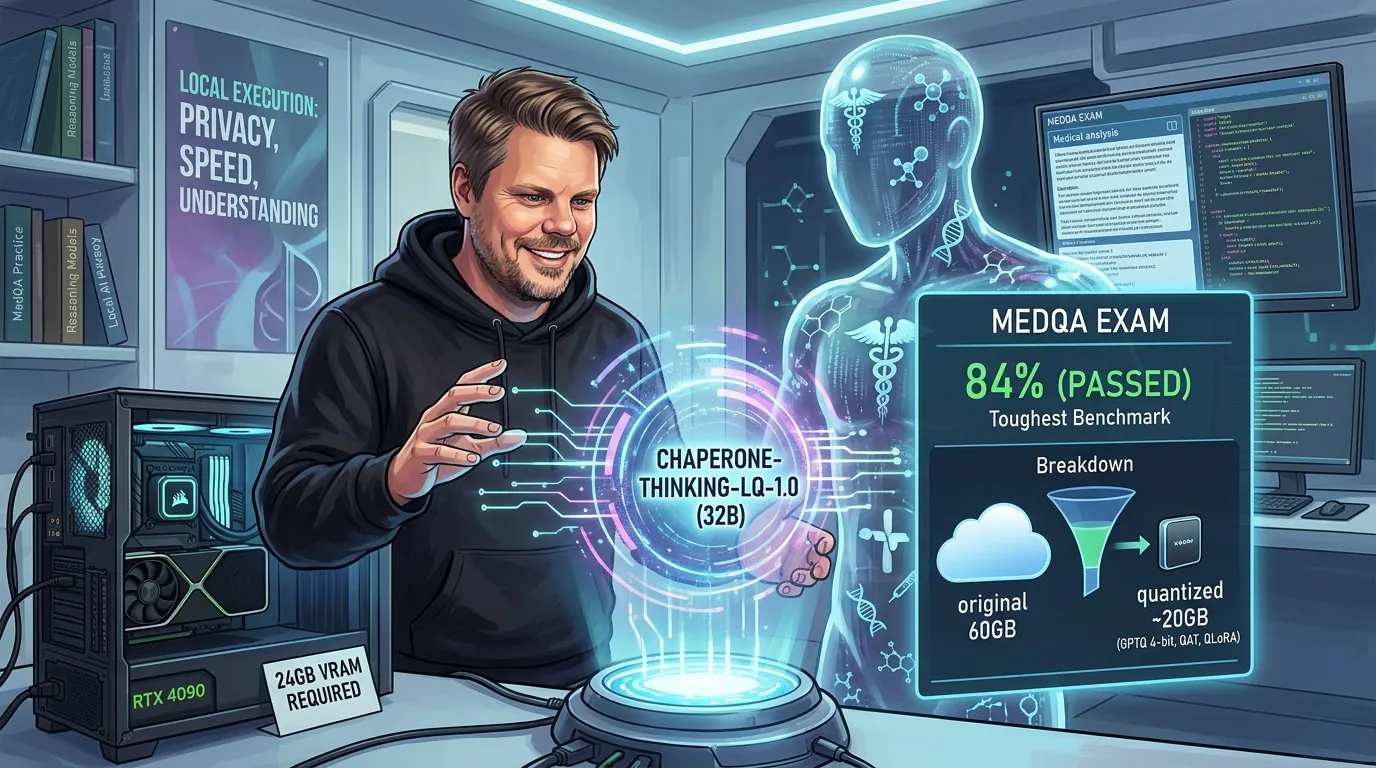

Chaperone-Thinking-LQ-1.0 – medisinsk AI som scorer 84% på legeeksamen og kjører på 20GB

Chaperone-Thinking-LQ-1.0 er en open source medisinsk AI-modell basert på DeepSeek-R1-Distill-Qwen-32B, kvantisert til ~20GB via GPTQ og finjustert med QLoRA på medisinske korpus. Modellen scorer 84% på MedQA-benchmarket og kan kjøres lokalt på en RTX 3090 eller 4090.