Innhold Vis

ZAYA1-8B er en ny Mixture of Experts-modell fra Zyphra som bare aktiverer 760 millioner parametere per inferens – men presterer som om den var mye, mye større. Lansert 6. mai 2026 under Apache 2.0-lisens, er dette en av de mer fascinerende tekniske lanseringene på en stund. Ikke fordi den er størst, men fordi den er uforskammet god relativt til størrelsen.

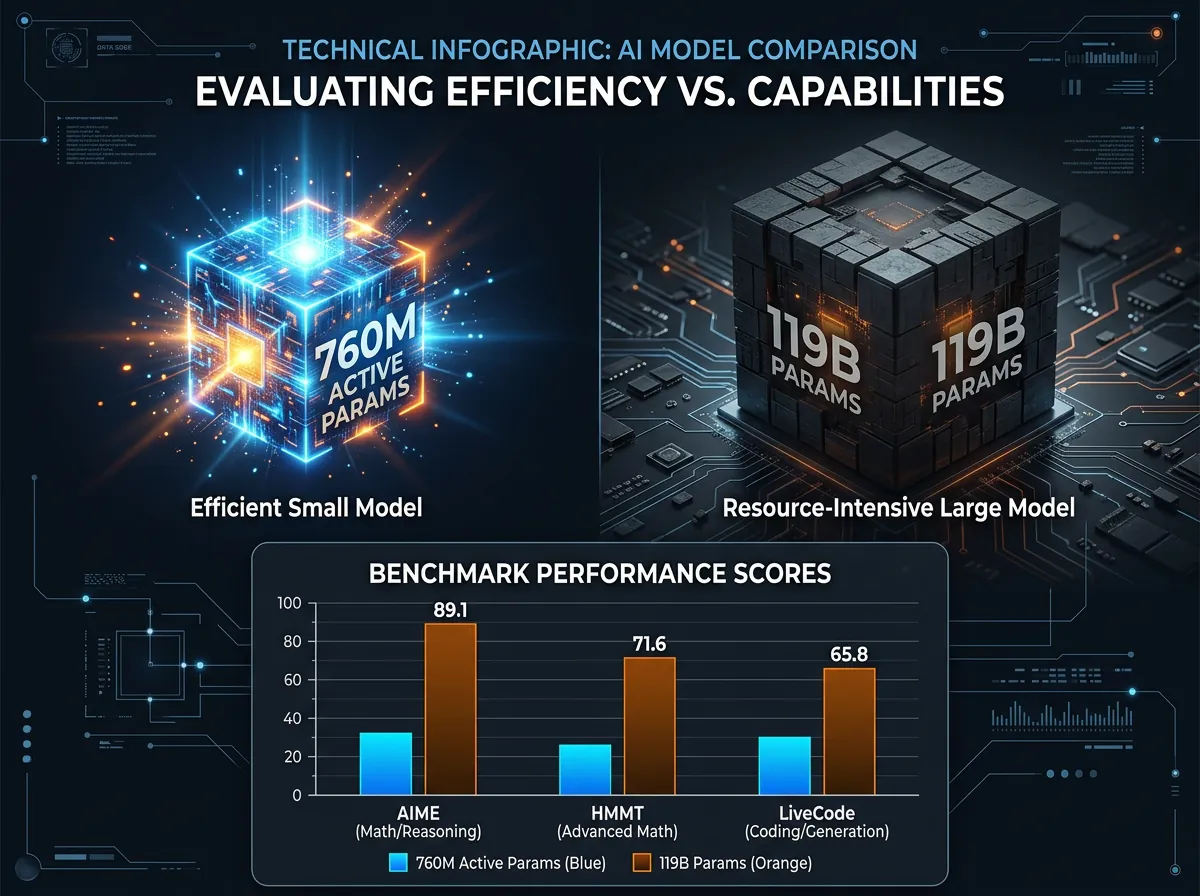

Tenk på det: 8,4 milliarder totale parametere, men bare 760 millioner aktive om gangen. Likevel banker den Mistral Small 4 med 119 milliarder parametere på matematikk-benchmarks. Det er ikke en feilskriving. Det er hele poenget.

Og så er det AMD-historien. Hele modellen – fortrening, midttrening og supervised fine-tuning – er kjørt på AMD Instinct MI300x-hardware. For et felt som lenge har vært dominert av NVIDIA, er det verdt å merke seg.

Hva er ZAYA1-8B egentlig?

ZAYA1-8B er bygget på Zyphras MoE++ arkitektur – en videreutvikling av standard Mixture of Experts-design. Der vanlige MoE-modeller aktiverer en fast andel eksperter per token, har Zyphra presset på tre konkrete forbedringer som gjør modellen mer effektiv å kjøre og mer stabil å trene.

Den første heter Compressed Convolutional Attention (CCA). Kort fortalt: 8× kompresjon av KV-cache sammenlignet med standard attention-mekanismer. Det betyr dramatisk lavere minnekrav ved inferens, noe som er grunnen til at du kan kjøre den på hardware som normalt ville kvelt seg på en modell med disse ytelsestallene.

Den andre forbedringen er en MLP-basert router med PID-controller bias-balansering. Litt teknisk, men poenget er at den forhindrer at noen eksperter overbelastes mens andre knapt brukes – et kjent problem i eldre MoE-arkitekturer som gjerne omtales som «døde eksperter». Darwin-35B-A3B-Opus, som jeg tidligere har skrevet om, ble faktisk bygget for å fikse nettopp dette problemet i en annen modell.

Den tredje er learned residual scaling, som kontrollerer hvordan residualnormene vokser gjennom nettverkets dybde. Det høres abstrakt ut, men det gjør treningen mer stabil og forhindrer at modellen degenererer på lange kontekster.

Hva sier benchmarkene?

ZAYA1-8B scorer høyt på de benchmarkene som faktisk er vanskelige å jukse på:

- AIME’26: 89,1 – avansert matematikk-konkurranse

- HMMT Feb.’26: 71,6 – høyere enn Claude Sonnet 4.5 på denne testen

- LiveCodeBench-v6: 65,8 – realistisk kodeytelse

- GPQA-Diamond: 71,0 – ekspert-nivå vitenskapelige spørsmål

Den slår altså Mistral Small 4 på matte – en modell med 119 milliarder totale parametere – og overgår Claude Sonnet 4.5 på HMMT’25. Det er tallene jeg la merke til. Mistral Small 4 er ikke en svak konkurrent – den er en solid, velrundet modell. Å bli utkonkurrert av noe som aktiverer 760 millioner parametere er ikke trivielt.

Benchmarks lyver ikke alltid, men de forteller heller ikke hele historien. Det som er interessant her er at AIME og HMMT er konkurranser designet for å avsløre ekte matematisk resonnering – ikke memorering. Det er vanskeligere å overfitte på slike tester.

Hva er Markovian RSA?

Her er der det virkelig blir interessant. ZAYA1-8B er ikke bare en god grunnmodell – den har en ny test-time compute-metode kalt Markovian RSA (Recursive Self-Aggregation med Markovian chunking).

Kort fortalt: Når du gir modellen et vanskelig problem, genererer den flere resonneringstilbakespor parallelt i stedet for å følge én lineær tankerekke. Markovian-aspektet handler om at den håndterer kontekstlengde smart – den «glemmer» på en kontrollert måte og beholder det essensielle, i stedet for å drukne i sin egen kontekst.

Ved bruk av 5,5 millioner tokens per problem overskrider denne teknikken DeepSeek-V3.2 på APEX-shortlist. Det er en aggressiv påstand, og den er verdt å følge med på når uavhengige tester kommer. Men arkitekturen er solid nok til at jeg ikke avfeier den.

I den brede open source AI-guiden jeg har skrevet er en av observasjonene at de virkelig interessante fremskrittene ikke alltid handler om å trene større modeller – men om å bli smartere på inferenstidspunktet. ZAYA1-8B er et godt eksempel på den trenden.

Er AMD Instinct MI300x et signal?

Dette er en av de mer bemerkelsesverdige detaljene: Hele treningsstakken kjørte på AMD Instinct MI300x. Et kluster med 1 024 noder koblet via AMD Pensando Pollara-samband.

NVIDIA dominerer AI-treningsmarkedet så totalt at det nesten er tatt for gitt. H100, A100, H200 – det er det alle snakker om. At Zyphra velger AMD og produserer disse ytelsestallene er et signal. Ikke et bevis på at AMD er likeverdig enda, men et tydelig signal om at alternativene modnes raskt.

For de som er interessert i å holde kostnader nede – AMD-hardware er generelt rimeligere enn tilsvarende NVIDIA – er dette verdt å følge med på fremover.

Kan du bruke ZAYA1-8B selv?

Ja. Modellen er tilgjengelig på Hugging Face under Apache 2.0-lisens – det vil si full kommersiell bruk uten restriksjoner. Du kan laste ned, modifisere og bygge produkter på toppen av den uten å betale lisensavgifter.

Zyphra tilbyr også modellen via Zyphra Cloud som et serverløst endepunkt, hvis du ikke vil håndtere infrastrukturen selv.

Med 760 millioner aktive parametere er inferenskravene overraskende lave. Det betyr at du kan kjøre den på hardware som normalt ikke ville klart en fullt aktivert 8B-modell. Nøyaktig hvilken forbrukerhardware som fungerer optimalt vil tester de neste ukene si mer om.

Hva betyr dette for utviklingen av små modeller?

Denne lanseringen er et godt eksempel på noe jeg har fulgt en stund: intelligenstetthet per aktivert parameter øker raskt. Mistral Medium 3.5 128B er en annen modell som viser det samme mønsteret fra en annen vinkel – store totale parametertall, men effektiv arkitektur som konkurrerer langt opp i klassen.

Tendensen er tydelig: det er ikke lenger slik at du trenger en monsterstor modell for å løse vanskelige matematikk- og kodeoppgaver. Spesialisering, arkitekturoptimalisering og smart test-time compute begynner å kompensere for rå størrelse.

For de som er nysgjerrige på MoE-arkitekturer generelt: Darwin-35B artikkelen gir et godt bilde av utfordringene og løsningene i dette feltet. ZAYA1-8B er på mange måter neste steg i den utviklingen.

Hva tenker du – er intelligenstetthet den riktige måten å tenke på fremgangen i AI, eller er det fortsatt absolutte ytelsestall som teller mest?