Innhold Vis

Qwen 3 VL 32B og Gemma 4 31B er to av de sterkeste vision-modellene du kan kjøre lokalt i dag. Offisielle benchmarks peker klart mot Qwen – bedre på dokumentanalyse, OCR og agentoppgaver. Men hva skjer når noen faktisk setter dem opp side om side på virkelige oppgaver, med vLLM og FP8-kvantisering? Resultatet er overraskende. En lokal AI-tester delte funnene sine etter å ha samlet inn de hardeste vision-utfordringene fra community-et og kjørt begge modellene gjennom dem systematisk.

Resultatet snur benchmarks på hodet. Gemma 4 vinner i praksis, til tross for at Qwen ser sterkere ut på papiret. Det finnes et ord for dette: benchmaxing – når modeller er optimalisert for å score høyt på standardiserte tester, men ikke nødvendigvis er bedre til det du faktisk trenger dem til.

Jeg er skeptisk til benchmarks generelt, og dette er et godt eksempel på hvorfor. La meg gå gjennom hva som faktisk ble funnet – og hva det betyr for deg som vil kjøre en solid vision-modell lokalt.

Hva er benchmaxing?

Benchmaxing er fenomenet der AI-modeller trenes eller finjusteres spesifikt for å gjøre det bra på kjente benchmarks, uten at denne forbedringen nødvendigvis overføres til virkelige brukssituasjoner. Det er litt som å trene en elev til å løse eksakt de oppgavene som kommer på prøven – men eleven sliter når de møter et problem de ikke har sett før.

Problemet er reelt og veldokumentert. Når laboratorier konkurrerer om å toppe offentlige benchmarks, er det fristende å inkludere benchmarkdata (direkte eller indirekte) i treningsdataene. Det hever scoren. Det hever ikke nødvendigvis kvaliteten på faktisk bruk.

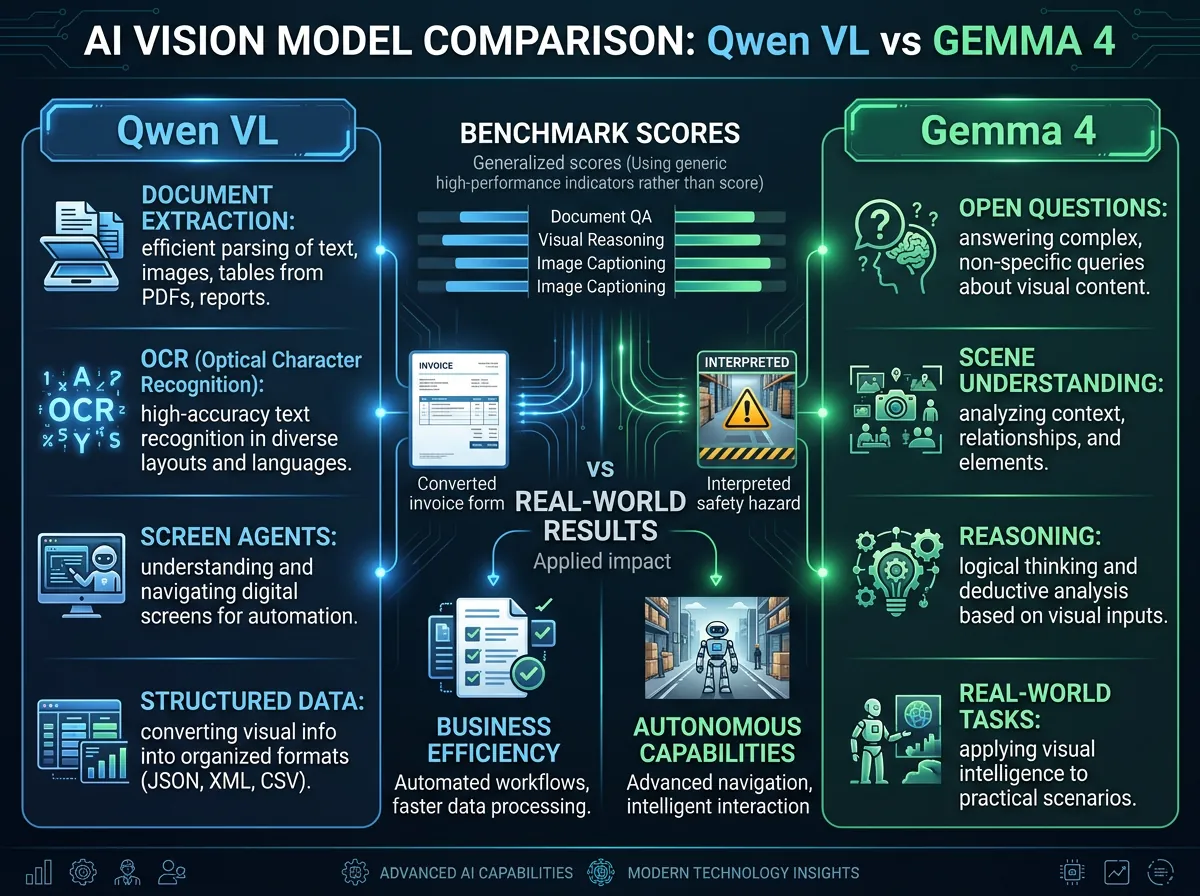

Qwen 2.5 VL 32B scorer imponerende på standardiserte AI-benchmarks: 94,8 på DocVQA, 74,7 på MathVista, 88,5 på ScreenSpot. Disse er tall fra offisielle målinger. Gemma 4 31B scorer godt – men ikke alltid like høyt. Likevel vinner Gemma i praksis.

Hva ble testet, og hvordan?

Testoppsettet er det som gjør disse funnene interessante. I stedet for å bruke standardiserte benchmarks ble det samlet inn reelle vision-oppgaver fra folk som bruker lokale modeller i praksis – de vanskeligste casene de støtte på i sin egen hverdag.

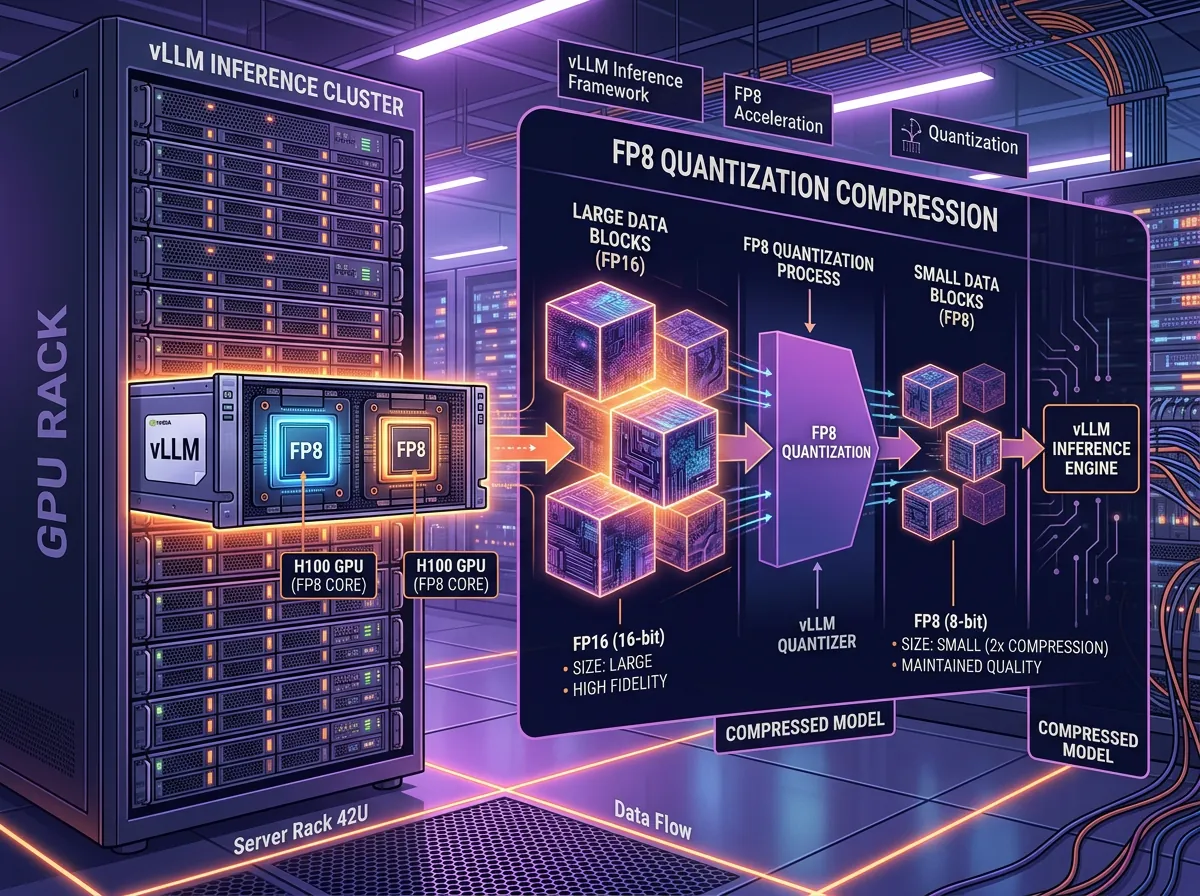

Begge modellene kjørte på vLLM med FP8-kvantisering. Dette er viktig kontekst: FP8 er en komprimeringsmetode som reduserer minnebehovet betraktelig, men kan påvirke presisjon. At begge modellene kjørte under identiske forhold gir sammenligningen troverdighet. Det er ikke en benchmark-lab med ideelle forhold – det er så nær vanlig lokal bruk som du kommer.

27B og 31B er størrelsesklassen der du trenger et solid GPU-oppsett – tenk 24 GB VRAM minimum for å kjøre FP8-versjoner komfortabelt med vLLM. Det er denne klassen som er relevant for seriøse hobbybygde setups og mindre produksjonsservere.

Hva vinner Qwen 3 VL på?

Qwen sin styrke er strukturert dataekstraksjon. Modellen er ekstremt god på oppgaver som har klare svar – trekk ut disse feltene fra dette dokumentet, finn dette tallet i dette regneark-skjermbildet, les denne teksten i dette bildet. Qwen 2.5 VL ble bygget for dokumentforståelse, og det vises i benchmarks av en grunn: disse oppgavene er ofte strukturerte nok til at treningen overføres godt.

Agentoppgaver der modellen skal interagere med skjermer og grensesnitt er også et Qwen-sterkeområde. Lokal browser-automasjon med Qwen fungerer overraskende godt nettopp av denne grunn – modellen er trent spesifikt på UI-forståelse og koordinatgenerering.

Videoforståelse er en annen nisje. Qwen VL kan analysere videoer over en time, med temporal lokalisering av spesifikke hendelser. Gemma 4 er ikke like sterk her.

Hva vinner Gemma 4 på i virkeligheten?

Det interessante er hva Gemma 4 31B gjør bedre når du setter de to opp mot hverandre på oppgaver folk faktisk sliter med. Funnene peker mot at Gemma er sterkere på åpne spørsmål om bilder, kontekstuell forståelse av komplekse scener, og oppgaver der det ikke finnes ett korrekt svar men der kvaliteten på resonnementet er det som teller.

Gemma er bygget på Gemini 3-forskning og scorer imponerende på MMLU (85,2%) og AIME 2026 matematikk (89,2%). Det er en modell som er bygget for dyp forståelse, ikke optimalisert for benchmark-poeng på enkle dokumentoppgaver.

Resonneringen er mer pålitelig på uventede inputs. Dette er den typen ting benchmarks ikke fanger opp: hva skjer når du gir modellen noe den ikke har sett varianter av tusenvis av ganger? Gemma håndterer dette bedre.

MMMU Pro (76,9%) indikerer sterk multimodal forståelse i kombineringsoppgaver. Det er denne generelle robustheten som gjør at Gemma 4 vinner i praksis selv når tallene favoriserer Qwen.

Bør du kjøre Gemma 4 eller Qwen VL lokalt?

Det avhenger av hva du trenger. Dette er ikke en svart/hvitt-situasjon – begge modellene er ekstremt gode, og valget handler om brukstilfelle.

Kjør Qwen VL hvis du trenger strukturert dataekstraksjon fra dokumenter, OCR-arbeid, UI-automasjon og agentoppgaver der modellen skal navigere skjermer. Qwen er spesialisert på computer-use-lignende oppgaver og levererer der.

Kjør Gemma 4 hvis du vil ha en modell som håndterer et bredere spekter av vision-oppgaver godt, spesielt åpne spørsmål, kompleks sceneforståelse og oppgaver som krever resonering fremfor ekstraksjon. Gemma 4 kom med Apache 2.0-lisens, som betyr full kommersiell bruk uten restriksjoner.

Verdt å nevne: Google har gjort noen kontroversielle valg med Gemma 4. Multi-Token Prediction ble fjernet fra den offentlige modellen, en ytelsesboost som konkurrenter beholder. Det betyr at Gemma 4 du får tilgang til er god, men ikke nødvendigvis alt Google kan levere.

Hva betyr dette for lokale modell-tester fremover?

Benchmaxing er ikke et nytt problem, men det er et voksende problem. Etter hvert som AI-laboratorier konkurrerer hardere om topp-plasseringer på offentlige benchmarks, øker insentivene til å optimalisere for benchmarks fremfor virkelig bruk.

Den eneste motgiften er dette: test modellene på dine egne oppgaver. Ikke på VQA-datasett, ikke på DocVQA. På de bildene og spørsmålene du faktisk jobber med. Et par timers testing på egne data forteller deg mer enn noen tabells samling av benchmarks.

Jeg har skrevet om dette temaet i forbindelse med Qwen 3.5 9B-testen på M1 Pro – modellen som scoret lavere på benchmarks vant i faktisk agentbruk. Mønsteret ser ut til å gjenta seg. Det er ikke tilfeldig.

Qwen 3 VL 32B og Gemma 4 31B er begge modeller det er verdt å ha på radaren hvis du driver med lokal vision-AI. Men hvis du bare har ressurser til å sette opp én av dem og trenger en allround vision-modell til varierte oppgaver – peker de faktiske testresultatene mot Gemma 4. Tallene forteller en annen historie. Det er den du bør ignorere.

Hva er FP8, og hvorfor kjøre vLLM?

FP8 (8-bits flytallspresisjon) er en kvantiseringsmetode som halverer minnekravet sammenlignet med BF16, uten like store nøyaktighetstap som INT4. Det er gullstandarden for å kjøre 27-32B modeller lokalt med akseptabel ytelse: du ofrer litt presisjon, men beholder mesteparten av modellkvaliteten og kan kjøre på hardware som ellers ikke hadde hatt plass.

vLLM er et inferens-rammeverk optimalisert for gjennomstrømning og lave latenstider på GPU. Det støtter FP8, batchprosessering og PagedAttention – teknologi som lar deg servere modellen til flere brukere eller prosessere mange bilder raskere enn naive PyTorch-løsninger. Vil du teste lokalt med seriøst oppsett, er vLLM standardvalget.

Konklusjonen er enkel: benchmarks lyver ikke, men de forteller ikke hele sannheten heller. Gemma 4 31B vinner der det teller – i virkelige brukssituasjoner med reelle utfordringer. Qwen VL er fortsatt bedre til sine spesifikke spesialistoppgaver. Bruk begge hvis du kan. Og mist aldri troen på at egne tester er mer verdifulle enn noen tabell noensinne kan være.