Innhold Vis

GuppyLM er en liten språkmodell på 8,7 millioner parametere, bygget fra bunnen av i PyTorch på rundt 130 linjer kode. Den ble publisert av utvikleren Arman på GitHub og trender akkurat nå på Hacker News med over 150 poeng. Modellen er trent på 60 000 syntetiske samtaler, kjører på en gratis Google Colab T4-GPU på fem minutter, og snakker som en filosofisk gullfisk som mener meningen med livet er mat.

Det høres latterlig ut. Det er også genialiteten bak det. Å trene en LLM som faktisk fungerer – som produserer sammenhengende tekst, svarer på spørsmål, har en personlighet – er ikke lenger noe som krever milliarder av parametere og datasentre. Det krever en ettermiddag og en gratis GPU.

Jeg synes dette er en av de mer underholdende tilnærmingene til AI-pedagogikk jeg har sett på en stund. Ikke fordi gullfisken er nyttig – det er den definitivt ikke – men fordi den avmystifiserer noe folk fortsatt tror er magi.

Hva er egentlig GuppyLM?

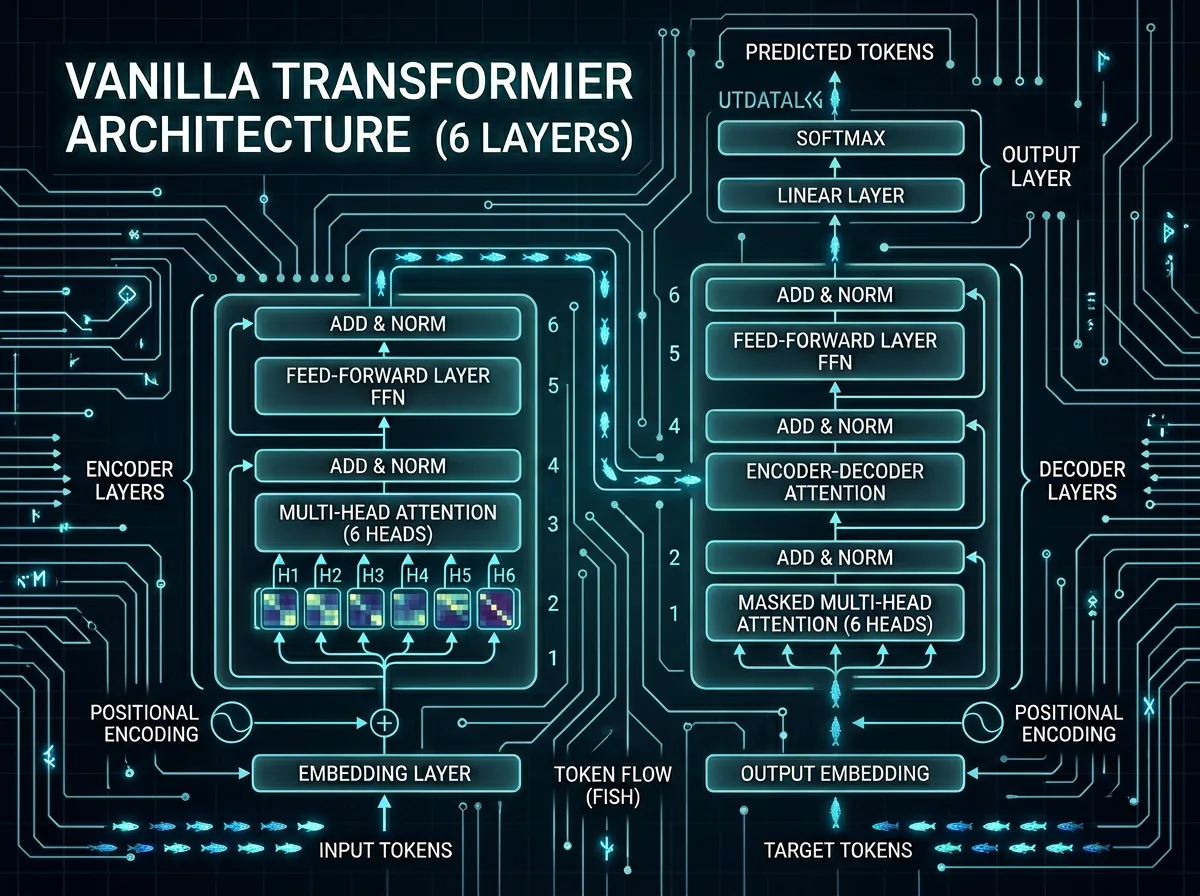

GuppyLM er en vanilla transformer-modell. Ingen fancy optimaliseringer som GQA (grouped-query attention) eller RoPE (rotational positional encodings) – bare standard transformer-arkitektur fra Attention Is All You Need-papiret fra 2017. Det er poenget.

Tallene ser slik ut:

- 8,7 millioner parametere totalt

- 6 transformer-lag

- 384 skjult dimensjon

- 6 attention heads

- 4 096 tokens vokabular (BPE-tokenisering)

- Maks 128 tokens sekvens

Til sammenligning har GPT-3 175 milliarder parametere. GuppyLM er altså omtrent 20 000 ganger mindre. Og den fungerer likevel – innenfor sitt smale domene.

Treningsdataen er 60 000 syntetiske samtaler spredt over 60 emner, fra enkle hilsener til filosofiske spørsmål. Alt generert via template composition med tilfeldiggjorte komponenter. Ikke noe scraping av internett, ikke noe komplisert datarensing. Bare strukturert syntetisk data som lærte en liten modell å opptre som en fisk med sterke meninger om pellets.

Hvorfor er dette nyttig å forstå?

Jeg har skrevet om hvordan språkmodeller fungerer tidligere, men det er én ting å lese en forklaring – og noe helt annet å se koden som faktisk gjør det. GuppyLM er 130 linjer PyTorch. Du kan lese hele modellen på én skjerm.

Det er ikke abstrakt lenger. Du ser attention-mekanismen. Du ser embedding-laget. Du ser hvordan tokens flyter gjennom lag etter lag. Og så ser du outputen – en fisk som sier «vann er livet og mat er meningen» – og du skjønner at ChatGPT gjør akkurat det samme, bare med 175 milliarder parametere i stedet for 8,7 millioner.

Dette er faktisk ett av de bedre pedagogiske verktøyene jeg har sett for folk som vil forstå hva begreper som transformer, token, og attention egentlig betyr i praksis.

Kan du kjøre det selv?

Ja, og det er overraskende enkelt. Tre alternativer:

Direkte i nettleseren: Det finnes en forhåndstrent modell på Hugging Face. Ingen installasjon nødvendig, bare chat med fisken umiddelbart.

Lokalt: pip install torch tokenizers og deretter python -m guppylm chat. Det er det. Fungerer på en vanlig laptop uten GPU.

Tren din egen: Her er den morsomme delen. GitHub-repositoriet inkluderer en Google Colab-notatbok som kjører hele treningspipelinen på en gratis T4-GPU på omtrent fem minutter. Du kan bytte ut personligheten – fisken kan bli en robot, en viking, en pessimistisk katt. Datasettet genereres automatisk basert på malen du definerer.

Hva lærer du av å bygge dette?

Arman skriver at målet hans var å demystifisere hvordan språkmodeller faktisk fungerer. Det er et godt mål. De fleste snakker om LLM-er som en slags svart boks – noe som skjer inne i datasentrene til OpenAI og Anthropic og som ingen kan forstå uten et PhD-studium.

Det stemmer ikke. Grunnprinsippene er tilgjengelige. Transformer-arkitekturen ble publisert åpent i 2017. PyTorch er gratis. Google Colab gir deg en GPU uten å betale en krone. Det som mangler er et lite, håndterbart eksempel som viser hele flyten – fra rådata til fungerende inferens – uten at du drukner i kompleksitet.

GuppyLM er det eksemplet. Du forstår ikke alt om GPT-4o ved å trene en 9 millioner parametere stor gullfiskmodell. Men du forstår nok til at det ikke lenger er magi. Det er matrisemultiplikasjon, attention-vekter og litt statistikk. Og det er faktisk ganske tilfredsstillende å se det fungere.

For de som vil grave dypere: VL-JEPA-artikkelen tar opp et interessant alternativ til transformer-paradigmet – Metas tilnærming som tenker i konsepter i stedet for tokens. Men for å forstå hva man avviker fra, er det lurt å kjenne til originalen. GuppyLM er en god start.

Fisken lever på Hugging Face og er klar for filosofiske diskusjoner om mat. Fork den og gi den en ny personlighet.