Innhold Vis

MemPalace er et gratis, lokalt AI-minnesystem lansert av skuespiller Milla Jovovich og ingeniør Ben Sigman i april 2026. Systemet fikk over 7 000 GitHub-stjerner på under 24 timer – og hevder å ha scoret 100% på LongMemEval-benchmarken, noe som umiddelbart utløste storm i AI-miljøet. Sannheten er mer nyansert enn overskriftene antyder.

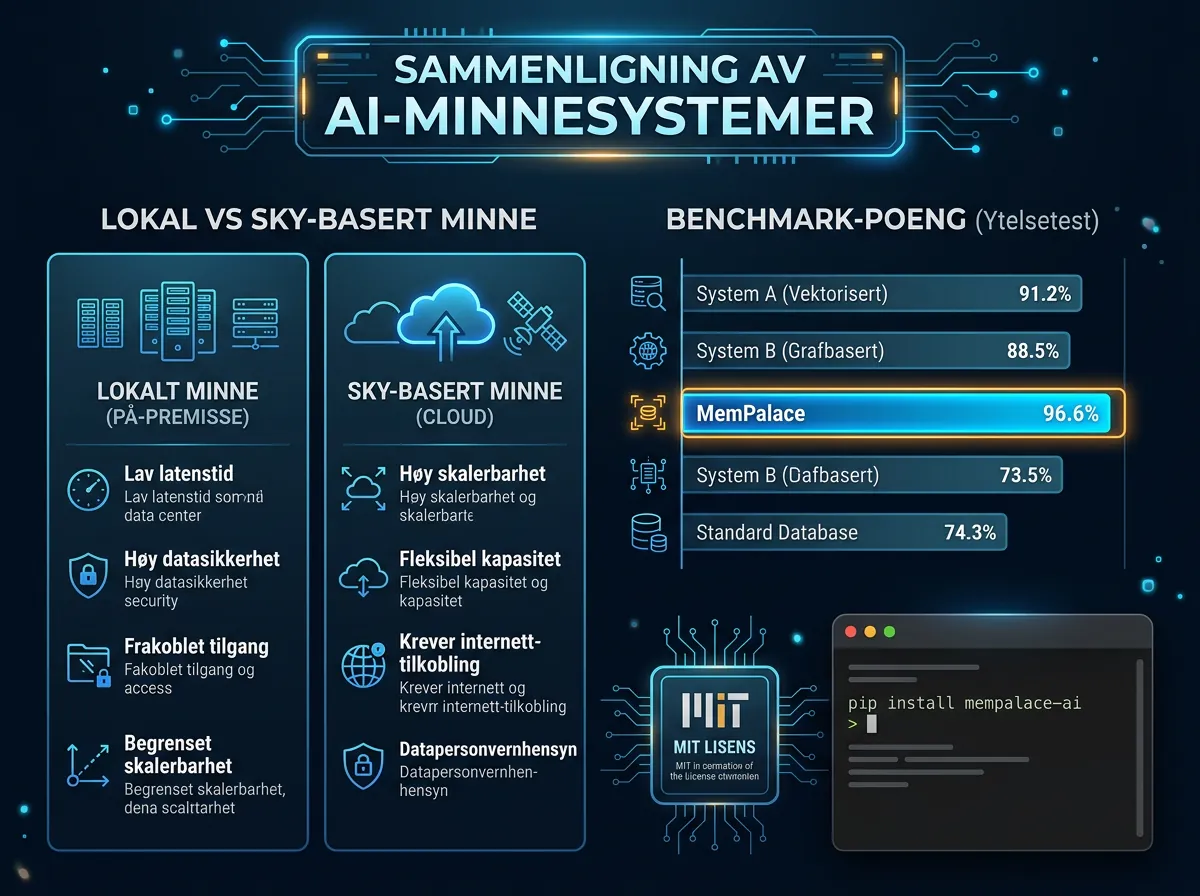

MemPalace gir AI-modeller vedvarende, krysssesjon-hukommelse som kjører helt lokalt. Ingen abonnement, ingen API-nøkkel, ingen cloud. Du installerer via pip install mem-palace og all data forblir på din maskin. MIT-lisens.

At Milla Jovovich – kjent fra Resident Evil og The Fifth Element – plutselig dukker opp som medutvikler av et AI-minneverktøy er ganske sprøtt. Men saken er interessant uavhengig av hvem som laget det. Her er hva MemPalace faktisk er, og hva benchmark-tallene faktisk betyr.

Hva er MemPalace?

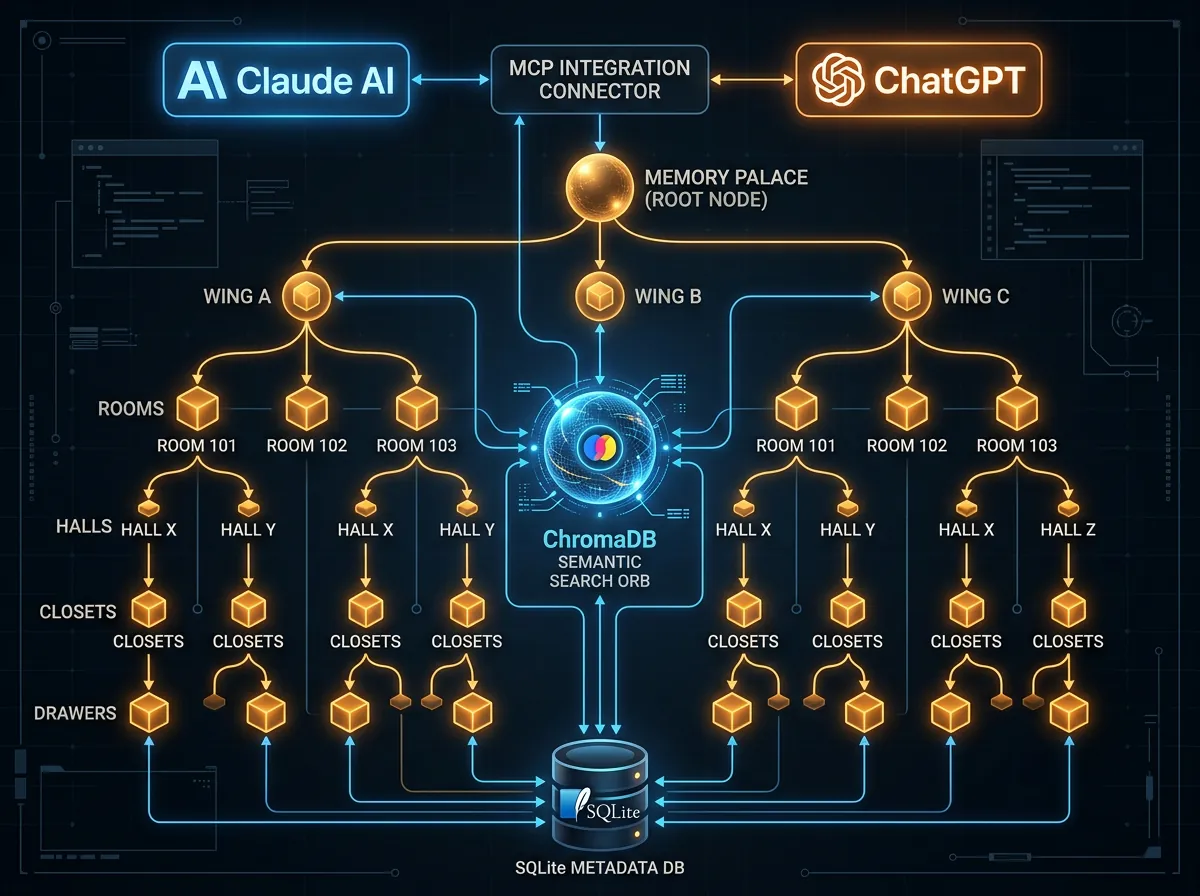

Systemet er bygget rundt en gammel mnemoteknisk metafor – et huskerpalasset. Informasjon organiseres hierarkisk i «wings» (personer/prosjekter), «rooms» (spesifikke emner), «halls» (minnetyper), «closets» (oppsummeringer) og «drawers» (originalfiler). Ikke bare pynt – denne strukturen gir ifølge egne tester 34% bedre gjenfinning enn ufiltrert semantisk søk alene.

Under panseret: SQLite for lokal lagring og ChromaDB for semantisk søk. Systemet støtter tre innlastings-modi: prosjekter (kode/dokumentasjon), samtaler (eksporter fra Claude og ChatGPT) og generelt innhold som auto-klassifiseres i kategorier som beslutninger, preferanser og milepæler.

Integrasjon skjer via MCP-verktøy – du kan koble MemPalace til Claude, ChatGPT eller Cursor. En utvikler kan spørre «hvorfor byttet vi til GraphQL?» og få opp den opprinnelige begrunnelsen fra en samtale for måneder siden. Det er den praktiske verdien – ikke at du husker ting, men at AI-verktøyene du bruker husker dem for deg.

Er 100%-kravet ekte?

Her blir det interessant. Da nyheten sprang ut, var den store overskriften «100% på LongMemEval.» Det er et ledende benchmark for AI-langtidshukommelse – så 100% ville vært sjokkerende bra. Problemet er at det ikke er det benchmarken faktisk måler.

En gjennomgang av implementasjonen viser at MemPalace kun gjennomfører gjenfinnings-steget i LongMemEval. For hvert av de 500 testspørsmålene bygger systemet ett dokument per sesjon, konkatenerer brukermeldingene og returnerer topp 5 sesjoner. Deretter sjekker det om korrekt sesjon-ID finnes i topp-5. Det leser aldri innholdet i de gjenfunne sesjonene, produserer aldri et svar.

De rapporterte tallene er «recall_any@5»-målinger, ikke LongMemEval-scores i tradisjonell forstand. X Community Notes koblet til Ben Sigmans opprinnelige post sier det slik: «The claimed 100% LongMemEval score uses targeted fixes for the 3 failing questions and LLM reranking (held-out score: 98.4%).»

Prosjektets egen dokumentasjon innrømmer at 100%-tallet stammer fra håndkodet optimalisering mot tre spesifikke dev-spørsmål – inkludert en «person-name boost for a question about someone named Rachel.» Det ærlige grunnlinje-tallet er 96,6% R@5 uten reranking. Det er fortsatt imponerende for et gratis, lokalt system – men det er noe annet enn «perfekt».

Til teamets ære: de publiserte en korreksjon i april 2026 der de innrømmet at de hadde overkommunisert tokenkompresjons-funksjoner og «30x besparelser.» Det vitner om en gjeng som faktisk er ærlige nok til å rette opp feil.

Hva fungerer egentlig, og hva er hype?

AAAK-kompresjon (Adaptive Abbreviation for Agentic Knowledge) er listet som en nøkkelfunksjon. Tanken er å komprimere tett entitetskoding for å spare tokens. Men egne resultater viser at det regresserer mot råmodus – 84,2% mot 96,6%. Og det er ikke token-effektivt i liten skala. Med andre ord: slå det av.

Kunnskapsgrafen er mer interessant. Den lagrer temporale entitetsrelasjoner med gyldighetsvindu – fakta kan utløpe eller bli historisk gyldige. Det er en smart arkitektur for agenter som skal jobbe med informasjon over tid. Nøkkelord: «jeg byttet jobb i mars 2025» blir en tripling med start- og sluttdatoer, ikke bare en statisk tekststreng.

Lokalt kjørende minnelag for AI-agenter er et tema jeg har skrevet om tidligere – se særlig artikkelen om Octopoda, et vedvarende minnelag for lokale AI-agenter uten sky, og om COG-arkitekturen som gir Claude Code vedvarende hukommelse. MemPalace er i samme kategori – men med en høyere grad av ekstern oppmerksomhet enn de fleste slike prosjekter får.

Hvorfor eksploderte det viralt?

7 000 GitHub-stjerner på under 24 timer for et minneverktøy er uvanlig. Svaret er åpenbart: Milla Jovovich. Resident Evil-serien er global, og et kjent ansikt i en usannsynlig kontekst driver klikk. Overskriften «skuespiller slår alle betalte AI-løsninger» er umulig å ikke klikke på.

Men det er verdt å spørre: betyr det at prosjektet er dårlig? Nei. Viral spredning og teknisk soliditet er to separate ting. Tallene er noe overdrevet, men kjernesystemet – SQLite + ChromaDB + hierarkisk organisering + MCP-integrasjon – er reelt og gratis. 96,6% R@5 lokalt og gratis er bedre enn mange betalte løsninger som koster hundrevis av kroner i måneden.

Jovovich beskriver selv at hun brukte måneder på å bli frustrert over dårlig filgjenfinning i AI-arbeidsflytene sine, og at det var drivkraften bak prosjektet. Ekte frustrasjon pluss kompetent ingeniørpartner er ofte et bedre startpunkt enn ren kommersiell motivasjon.

Bør du prøve MemPalace?

Hvis du allerede eksperimenterer med lokale AI-agenter og vil gi dem bedre langtidshukommelse, er MemPalace verdt å teste. Det er gratis, MIT-lisensiert, fungerer offline og integrerer med Claude via MCP. Installer, last inn noen samtaler, se om gjenfinningen er brukbar.

Ikke forvent at det er perfekt. 100%-påstanden var markedsføring. Men 96,6% lokalt og gratis – det er ganske bra. Og korreksjonen de publiserte selv viser at dette ikke er et typisk hype-prosjekt der tallene aldri ettergås.

github.com/milla-jovovich/mempalace – installer med pip install mem-palace og gi AI-verktøyene dine en skikkelig hukommelse.