Innhold Vis

YouTube har nå gjort det enkelt å deepfake seg selv. En ny funksjon i YouTube Shorts lar deg lage en AI-avatar som ser og høres ut som deg – og sende den direkte ut i verden uten at du trenger å løfte et kamera. Funksjonen rulles ut globalt fra 8. april 2026, men er foreløpig ikke tilgjengelig i Europa.

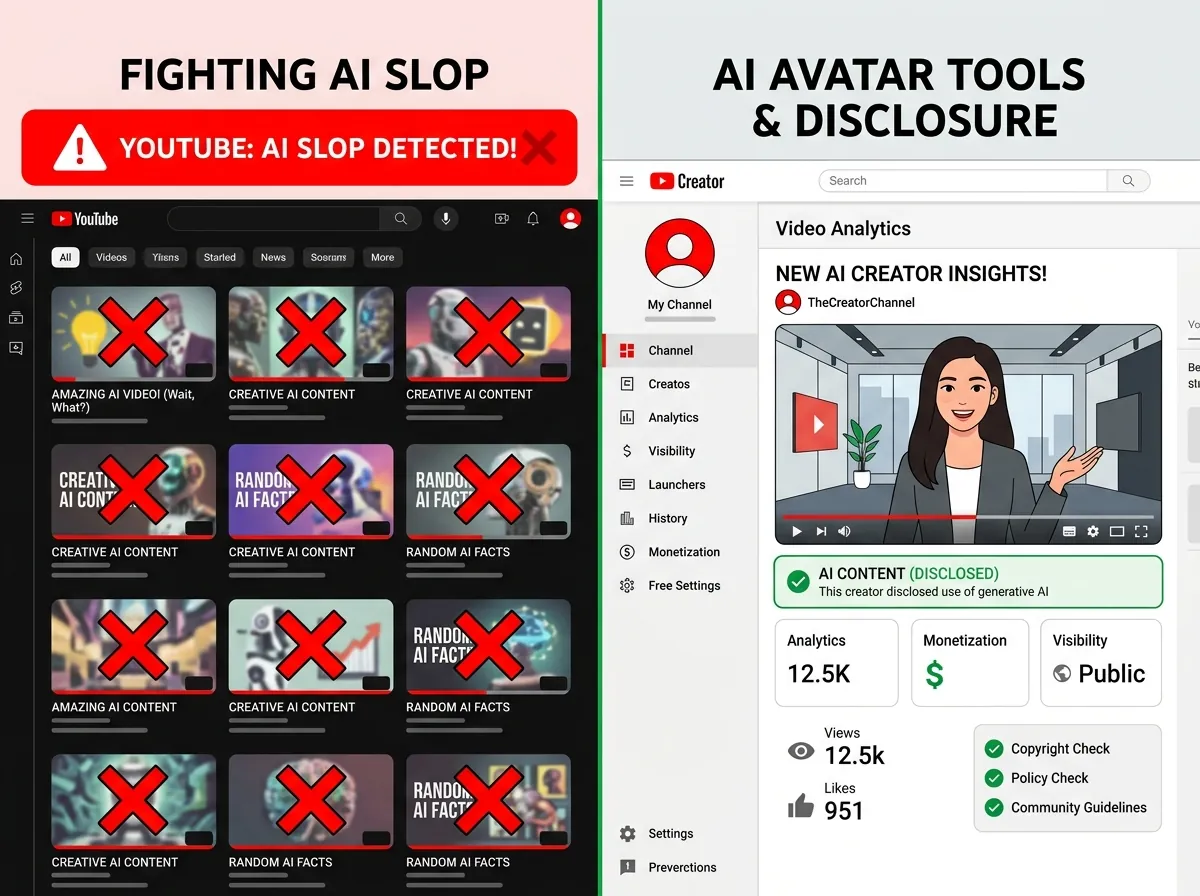

Det er en litt spesiell situasjon YouTube har satt seg i. Plattformen sier de prioriterer kampen mot AI-søppel og deepfake-svindel i 2026. Nesten samtidig lanserer de et verktøy som lar millioner av brukere lage fotorealistiske videoer av seg selv – uten å filme en eneste sekund. Det er ikke nødvendigvis feil – men det er i hvert fall interessant timing.

Her er det som faktisk skjer, og hva det betyr for deg som creator.

Hva er YouTube Shorts AI-avatar?

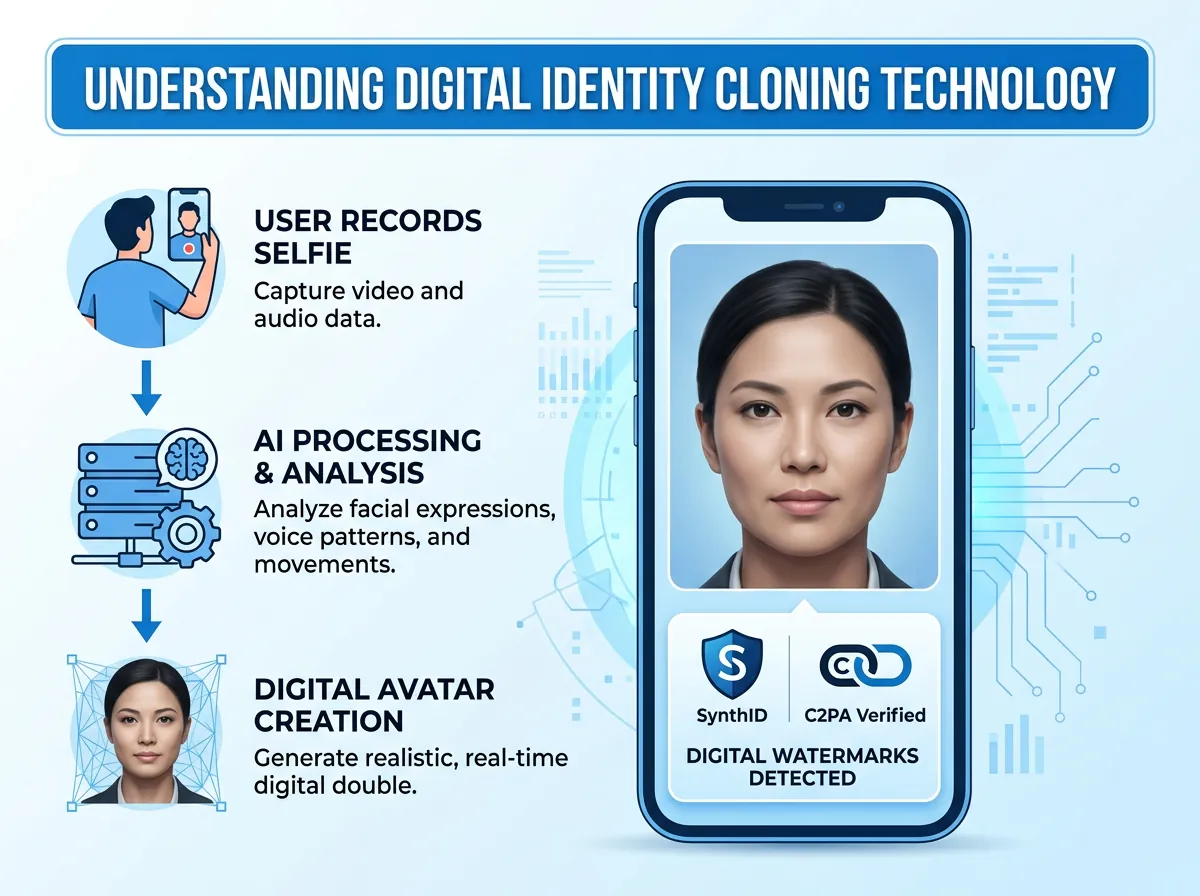

Funksjonen fungerer enkelt: Du åpner YouTube-appen, trykker på Create-knappen og velger «Make a video with my avatar». Første gangen setter du opp avataren ved å filme ansiktet ditt live og lese noen setninger høyt så systemet fanger stemmen din. Det er ett engangsoppsett – etter det kan du generere Shorts av deg selv ved å bare skrive en tekst-prompt.

Hvert AI-generert klipp kan være opptil 8 sekunder. Vil du lage noe lengre, kobler du sammen flere klipp. I teorien kan du lage en hel video av deg selv som forklarer noe, demonstrerer noe, eller snakker direkte til seerne – uten å sette deg foran kamera en eneste gang.

Funksjonen er også tilgjengelig via Remix-menyen under «Reimagine», der du kan legge deg selv inn i andres scener. Selve verktøyet er bygget på Gemini, og tilgangen finner du under Gemini-ikonet i Create-menyen.

Hvilke sikkerhetstiltak har YouTube lagt inn?

YouTube er tydelig på at de har tenkt på misbruk. Selfie-videoen og stemmedataene dine brukes kun til din egen avatar – ingen andre kan bruke ditt utseende til å lage innhold. Alle videoer generert med avataren merkes automatisk med SynthID-vannmerke og C2PA-etiketter, pluss synlig AI-innhold-disclosure i selve videoen.

Du kan slette avataren din når som helst. Gjør du det ikke, sletter YouTube den automatisk etter tre år uten aktivitet. Eksisterende videoer forblir til du sletter dem manuelt.

Det er altså ikke hvem som helst som kan lage en deepfake av deg via YouTube. Bare du kan bruke din egen avatar. YouTube har i tillegg rullet ut et likeness detection-system som varsler deg hvis noen andre lager deepfakes av ansiktet ditt uten tillatelse – en funksjon som nå er tilgjengelig for millioner av kanaler i YouTube Partner Program.

Hvorfor gjør YouTube dette nå?

Det korte svaret er at konkurransen tvinger dem. TikTok har hatt lignende AI-avatar-funksjoner en stund, og plattformene kjemper om de samme creatorene. Muligheten til å lage innhold raskere og billigere er et reelt konkurransefortrinn – og YouTube vet det.

Det lengre svaret er mer komplisert. YouTube CEO Neal Mohan erklærte i januar 2026 at bekjemping av «AI slop» er en prioritet for plattformen i år. En analyse viste at av de første 500 Shorts som vises til en ny konto, var 21% rent AI-søppel og 33% klassifisert som «brainrot». Det er ett av fem videoer som er skrot fra start.

Midt i det lanserer YouTube altså en funksjon som senker terskelen for AI-generert innhold ytterligere. Logikken de presenterer er at sofistikert, autentisk AI-assistert innhold fra ekte skapere vil presse ut det generiske søppelet. Det gjenstår å se om det stemmer.

Er dette noe å være bekymret for?

Det avhenger litt av hva du er bekymret for. For enkeltpersoner og skapere er verktøyet ganske tydelig avgrenset – avataren din er din, den kan ikke brukes av andre, og innholdet er merket. Det er langt mer kontrollert enn mange fryktet da deepfake-teknologien begynte å bli tilgjengelig for vanlige folk.

Det større spørsmålet er hva det betyr for innholdskvalitet og tillit. Når YouTube selv gjør det lett å lage fotorealistiske videoer der du «sier» ting du aldri faktisk sa, hvilken standard setter det? Plattformen har allerede et problem med deepfake-svindel der falske versjoner av kjente skapere promoterer falske investeringer. Merking hjelper, men de fleste seere legger ikke merke til C2PA-etiketter.

YouTube sier at likeness detection-systemet gir skapere verktøy til å finne og fjerne uautoriserte deepfakes. I januar 2026 terminerte de 11 kanaler og fjernet innhold fra seks andre for brudd på disse reglene. Det er et skritt i riktig retning, men deepfake-skapere er ikke akkurat kjent for å la seg stoppe av regler.

Hvem bør prøve dette?

Reell nytte finnes for skapere som vil produsere mer innhold uten å alltid sette seg foran kamera. Educational content, quick updates, eller faste oppsummeringsformater er åpenbare bruksområder. Kan du filme deg selv én gang og så generere varianter av deg som forklarer forskjellige ting, sparer det faktisk tid.

Det som bekymrer meg litt er hvem som ellers vil bruke dette. Funksjonen er begrenset til brukere over 18 utenfor Europa – men «outside Europe» betyr at det meste av verden er med fra dag én. Kravene for å misbruke systemet er lave hvis du er villig til å bryte reglene: sett opp en konto, lag en avatar, publiser innhold.

For deg som creator er det fornuftig å holde et øye med om avataren din dukker opp steder den ikke skal. YouTubes likeness detection-system er der, men det er reaktivt – du oppdager misbruk etter det har skjedd, ikke før. Det er ikke ideelt, men det er omtrent så godt som det blir med teknologi som dette.

Funksjonen er tilgjengelig i YouTube-appen og YouTube Create fra nå av, globalt for brukere over 18 utenfor Europa. Vil du teste, finn Gemini-ikonet i Create-menyen og se hva du synes. Personlig er jeg nysgjerrig på bildekvaliteten og om avatarer faktisk ser troverdige nok ut til å fungere – det er erfaringen, ikke spesifikasjonene, som avgjør den slags.