Innhold Vis

Gemini Robotics-ER 1.6 er Google DeepMinds nyeste modell for robotikk, lansert 14. april 2026. Modellen er spesialbygget for det de kaller «embodied reasoning» – altså evnen til å forstå og handle i den fysiske verden. Ikke bare se og svare, men faktisk vite hva som skjer i rommet rundt roboten og hva som må gjøres.

Det som gjør denne utgivelsen interessant er ikke bare at den er bedre enn forgjengeren. Det er HVA den er blitt god på. Instrumentavlesning, suksessdeteksjon og romlig forståelse fra flere kameraer samtidig. Det er akkurat den typen kapabiliteter som skiller lekerobotikk fra ekte industriell bruk. Og tallene er ganske imponerende.

Modellen er tilgjengelig via Gemini API og Google AI Studio fra dag én, med eksempelkode på GitHub. Ingen venteliste, ingen lukket beta. Det er et tydelig signal om at Google vil ha utviklere til å bygge på dette nå.

Hva er Gemini Robotics-ER 1.6?

ER-serien (Embodied Reasoning) er DeepMinds dedikerte robotikk-modellfamilie. Tanken er at en robot trenger mer enn bare et godt synssystem – den trenger evnen til å resonere om det fysiske miljøet. Hva er i rommet? Hvilke objekter kan røres? Er denne oppgaven faktisk ferdig?

Versjon 1.6 bygger videre på 1.5, men med tre konkrete forbedringer som DeepMind selv trekker fram: instrumentavlesning, flervisningsforståelse og sikkerhetsoverholdelse. Av disse tre er instrumentavlesning den mest overraskende – og den kom tydeligvis til som et resultat av samarbeid med Boston Dynamics.

Modellen kan nå kalle egne verktøy internt, inkludert Google Search og spesialiserte visjon-til-handling-modeller (VLAs). Det betyr at roboten ikke er avhengig av ett enkelt svar fra modellen – den kan ta mellomsteg, zoome inn på detaljer, gjøre utregninger, og så konkludere.

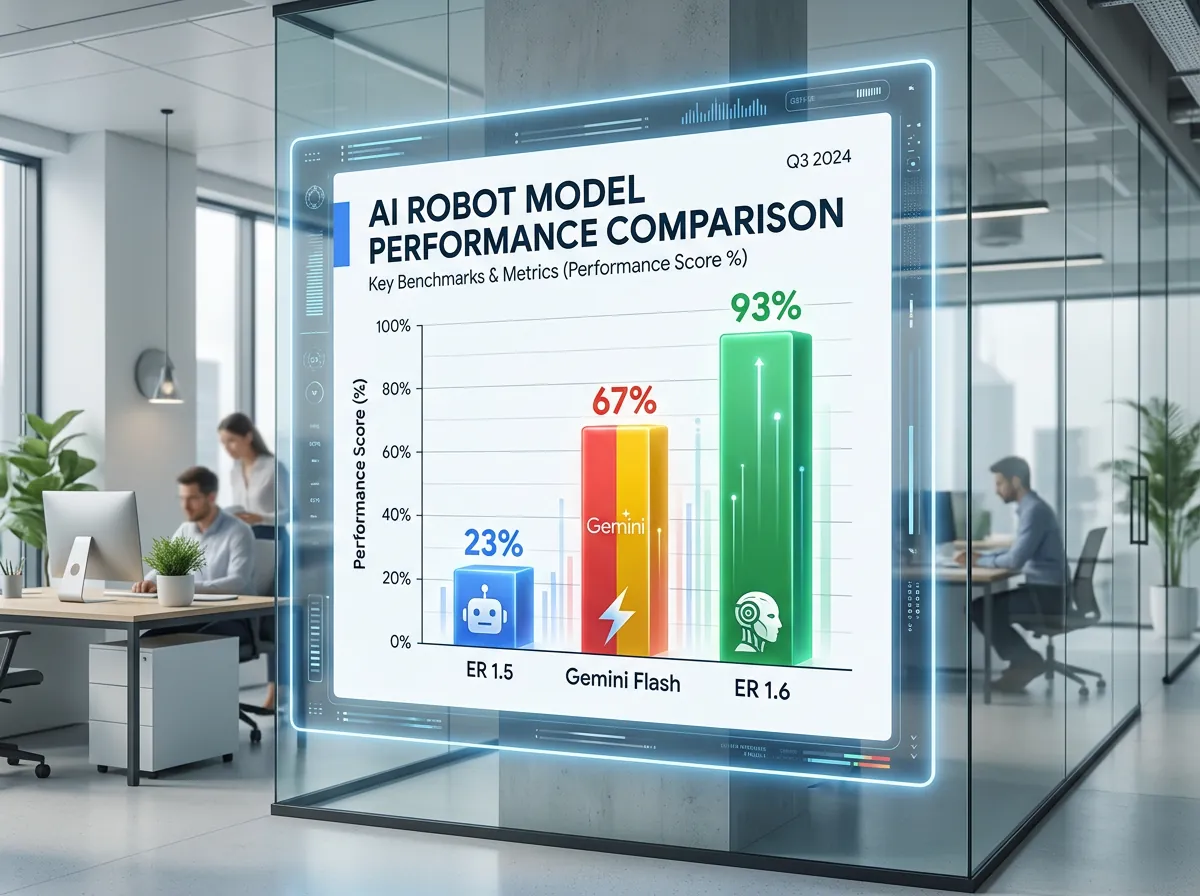

Instrumentavlesning – fra 23% til 86%

Det er ett tall i DeepMinds bloggpost som stopper deg litt. På instrumentavlesning gikk nøyaktigheten fra 23% i ER 1.5 til 86% i ER 1.6. Og med det de kaller «agentic vision» – der modellen aktivt zoomer og beregner – opp til 93%.

Tenk på hva det betyr i praksis: en robot som skal inspisere et industrielt anlegg og lese av trykkmålere, temperaturvisere og nivåindikatorer. Med 23% nøyaktighet er den ikke til å stole på. Med 93% kan den faktisk gjøre jobben. Det er et hopp fra «teknologisk kuriositet» til «kan faktisk deployeres».

Systemet forstår analoge visere, digitale displayer, væskenivåer i glasrør, og kombinasjoner av disse. Det plukker opp nåleposisjon, tikkelmerker og tekst, og setter dem sammen til en meningsfull avlesning. Ikke pek-og-si, men faktisk forstå.

Suksessdeteksjon – vet roboten når den er ferdig?

Dette er en av de mer undervurderte utfordringene i robotikk. En robot kan gjennomføre en bevegelse – men vet den om oppgaven faktisk ble utført? Ble skruen skrudd inn? Landet objektet på riktig sted? Er ventilen faktisk lukket?

ER 1.6 kan nå analysere flere kamerafeeder samtidig og bedømme om en oppgave er fullført. Modellen forstår hvordan ulike synsvinkler kombineres til et helhetlig bilde, selv med delvis blokkering og dårlig belysning. Det er ikke bare «ser jeg riktig resultat» – det er «hva sier alle kameraene samlet sett om situasjonen».

Dette er kritisk for autonome systemer. En robot som ikke vet om den er ferdig, vil enten gi opp for tidlig eller fortsette lenge etter at oppgaven er løst. Begge deler er dyrt i industriell kontekst.

Sikkerhet på ASIMOV-benchmark

DeepMind trekker også fram forbedret sikkerhetsoverholdelse. På ASIMOV-benchmark – som tester om modellen kan identifisere fysiske farer og overholde begrensninger – scorer ER 1.6 6% bedre på tekst og 10% bedre på video sammenlignet med baseline.

I praksis betyr det at roboten er bedre til å si nei når den skal si nei. «Ikke håndter væsker». «Løft ikke over X kilo». «Ikke gå inn i dette området». En robot som ignorerer slike instruksjoner i et produksjonsmiljø er ikke et verktøy – det er en risiko.

Sikkerhetsoverholdelse er ikke glamorøst å skrive om. Men for selskaper som faktisk skal bruke roboter i produksjon, er det ofte det første spørsmålet: kan vi stole på at roboten holder seg innenfor grensene vi setter?

Sammenligningstabell – ER 1.6 mot forgjengerne

Her er ytelsestallene DeepMind publiserte for de tre versjonene på instrumentavlesning:

| Modell | Instrumentavlesning | Med agentic vision |

|---|---|---|

| Gemini Robotics-ER 1.5 | 23% | – |

| Gemini 3.0 Flash | 67% | – |

| Gemini Robotics-ER 1.6 | 86% | 93% |

Det er verdt å merke seg at Gemini 3.0 Flash – en generell modell – faktisk slår ER 1.5 på denne spesifikke oppgaven. Det antyder at ER 1.5 hadde et tydelig hull akkurat her. ER 1.6 lukker det hullet og går forbi.

Hvem er dette for?

Tilgjengeligheten sier mye om målgruppen. Gemini API og Google AI Studio fra dag én. Eksempelkode på GitHub. DeepMind ber aktivt om at utviklere sender inn 10-50 merkede bilder som viser feiltilfeller i sine spesifikke applikasjoner – de vil at fellesskapet hjelper til med å forbedre neste versjon.

Det er ikke et lukket industriprodukt med skreddersydde enterprise-avtaler. Det er et åpent API som robotikk-utviklere kan bygge på. Enten du jobber med industriell inspeksjon, lagerhåndtering eller noe helt annet – du kan bruke dette i dag.

Boston Dynamics-samarbeidet er nevnt eksplisitt i bloggposten, og det er verdt å ta med seg. Boston Dynamics er kjent for å bygge roboter som faktisk fungerer i den virkelige verden, ikke bare i laboratorier. At de har bidratt til å forme hva ER 1.6 er god på – særlig instrumentavlesning – gir modellen en viss «field-tested» troverdighet.

Hvis du vil lese mer om Gemini-økosystemet generelt, har jeg skrevet en komplett guide til Google Gemini som dekker modellene, API-tilgang og praktisk bruk. Og for de som er nysgjerrige på hvor robotikk er på vei mer generelt, er denne artikkelen om humanoide roboter og iPhone-øyeblikket verdt en titt.

Robotikk-AI er et område der det skjer mye akkurat nå, og ER 1.6 er et godt steg framover. Særlig instrumentavlesning-spranget fra 23% til 93% er den typen forbedring som faktisk åpner nye dører. Hva tenker du – er dette nærme nok til reell industriell bruk, eller mangler det fortsatt noe avgjørende?

1 kommentar