Innhold Vis

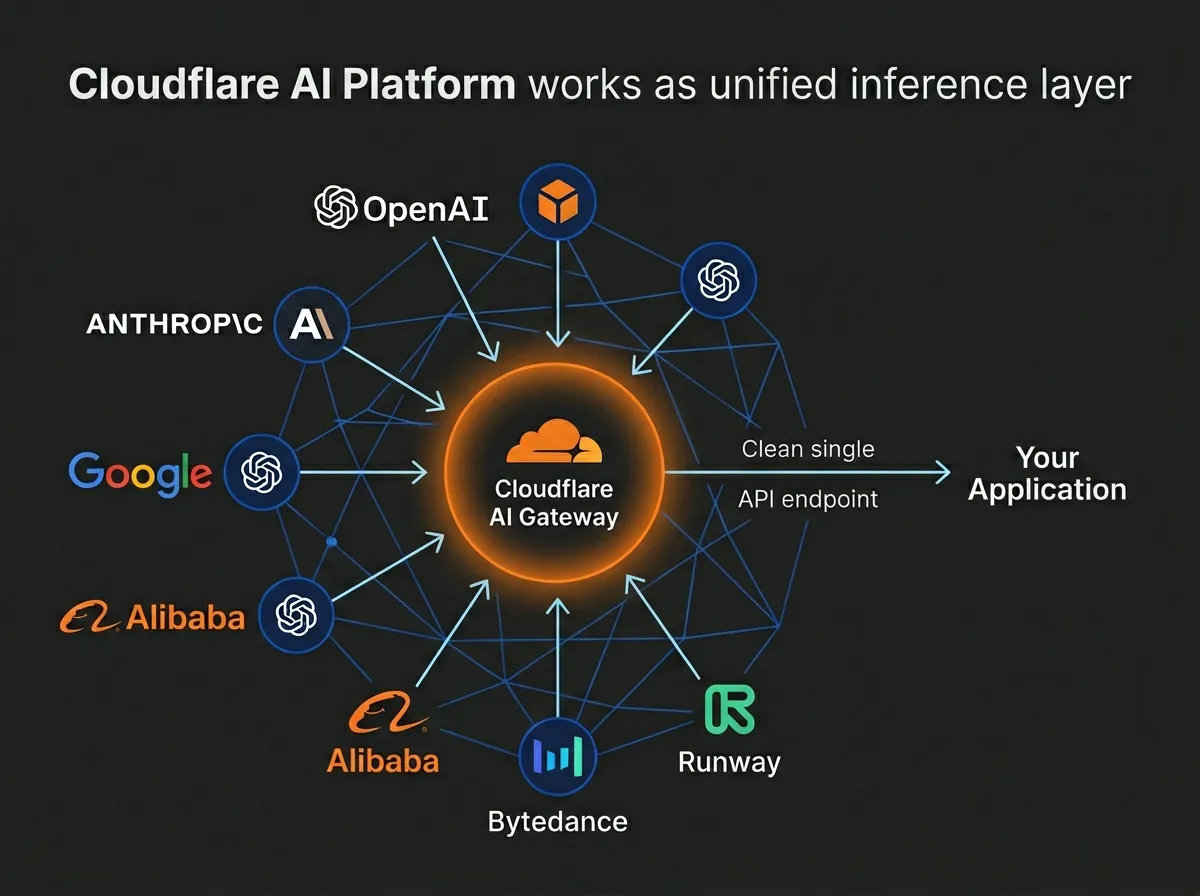

Cloudflare AI Platform er en samlet inferenslag for AI-agenter, lansert i april 2026. Kjernen er en utvidet versjon av Cloudflare AI Gateway som nå gir tilgang til 70+ modeller fra 12+ leverandører gjennom ett enkelt API-endepunkt. I stedet for å sjonglere separate integrasjoner for OpenAI, Google, Anthropic og resten, ruter alt gjennom Cloudflares globale nettverk med 330 datasentre.

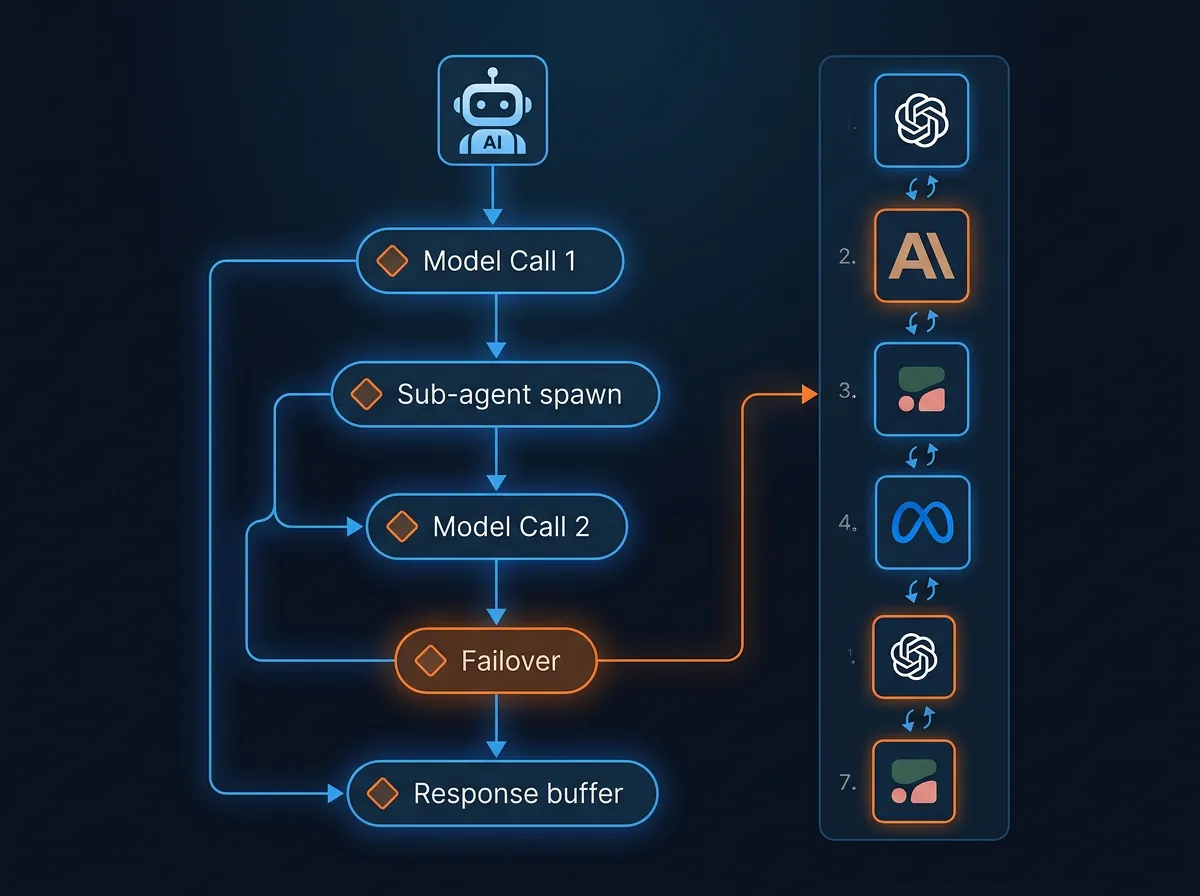

Det som gjør dette interessant er ikke bare at det samler tilgangen – det er at Cloudflare har designet systemet spesifikt rundt utfordringene du møter når du bygger AI-agenter. Agenter gjør ikke ett API-kall og stopper. De kjeder kall, spinner opp sub-agenter, og trenger at infrastrukturen faktisk holder tritt. Det er et annet problem enn enkel modelltilgang.

Her ser jeg på hva Cloudflare AI Platform faktisk inneholder, hva det koster, og om det er relevant for deg som vil bygge noe med AI – enten du er en utvikler, driver en liten bedrift, eller bare er nysgjerrig på retningen AI-infrastruktur beveger seg.

Hva er Cloudflare AI Platform?

Cloudflare AI Gateway eksisterte allerede – som en proxy mellom deg og AI-leverandørene. Det nye er at de nå kaller det en AI Platform og utvider funksjonaliteten markant. Kort sagt: én API, 70+ modeller, innebygd failover, kostnadsstyring, og støtte for egne modeller.

Katalogen inkluderer nå ikke bare tekstmodeller. Bilde-, video- og talemodeller er med, fra leverandører som Alibaba Cloud, Bytedance, AssemblyAI, Google, OpenAI og Runway. Det er altså multimodal dekning gjennom ett endepunkt. Ny i katalogen er blant annet Kimi K2.5 – en stor modell spesifikt designet for agentoppgaver.

Bytte fra én modell til en annen krever én linjeendring i koden. Det er den praktiske gevinsten. Du skriver kode mot Cloudflares API, ikke direkte mot OpenAI eller Anthropic – og kan dermed bytte leverandør uten å skrive om integrasjonen.

Hvorfor er agentfokus viktig?

De fleste AI-tjenester er optimalisert for enkle forespørsel-svar-mønstre. Du sender en melding, du får et svar. Ferdig. Men agenter fungerer annerledes. En agent kan ta 20, 50 eller 200 API-kall for å løse én oppgave – den søker, vurderer, planlegger, delegerer til sub-agenter, og itererer.

Det skaper konkrete infrastrukturproblemer. Hva skjer hvis én leverandør er nede midt i en kjede av kall? Hva skjer med buffering av svar mens agenten fortsatt kjører? Cloudflare adresserer dette med automatisk failover mellom leverandører og buffering av streamingsvar uavhengig av agentens levetid. Det betyr at selv om en agent kjører lenge, mister du ikke data underveis.

Latens er også et eget problem for agentapplikasjoner. Med 330 datasentre globalt kan Cloudflare rute forespørsler til det nærmeste punktet og optimalisere «tid til første token» – altså hvor raskt du begynner å få svar tilbake. For applikasjoner der brukeren venter på et svar, er det merkbart.

Kostnadsstyring – hva betyr det i praksis?

En av de praktiske funksjonene er granulær kostnadssporing. Du kan tagge API-kall med metadata og følge kostnader per bruker, per kunde, eller per arbeidsflyt. Ikke bare totale utgifter – men nøyaktig hva som koster hva.

For de fleste som eksperimenterer hjemme er dette overkill. Men for deg som bygger en applikasjon der kunder genererer AI-kall, er det verdifullt. Uten denne typen sporing vet du bare at AWS/API-regningen din stiger – ikke hvilken kunde eller funksjon som forårsaker det.

Cloudflare samler all AI-utgift på ett sted. I stedet for separate fakturaer fra OpenAI, Anthropic og Google, er alt i dashboardet. Praktisk, men ikke revolusjonerende – lignende logikk finnes i LiteLLM og andre proxyer.

Egne modeller – «Bring Your Own Model»

Her er noe som faktisk er interessant: Cloudflare integrerer med Replicate Cog for å la deg hoste egne modeller i infrastrukturen deres. Du definerer Python-kode og avhengigheter i YAML, og Cloudflare tar seg av containerisering, GPU-optimalisering og reduserte «cold starts».

I praksis betyr det at du kan ta en open source-modell – si Llama 3.3 eller en fintunet variant – og kjøre den gjennom det samme endepunktet som de kommersielle modellene. Én API håndterer det hele. GPU-optimalisering og raskere oppstartstider er varslet som kommende funksjoner.

Det er en annen tilnærming enn å kjøre alt lokalt med Ollama, men for produksjonsapplikasjoner der du trenger skalerbarhet uten å eie GPU-infrastruktur selv, kan dette være relevant. Se gjerne hva jeg tidligere har skrevet om Claude Managed Agents for et alternativt blikk på sky-basert agentinfrastruktur.

Hva skiller Cloudflare fra andre API-proxyer?

Det finnes allerede alternativer. LiteLLM er open source og gir mye av den samme multi-leverandør-funksjonaliteten. OpenRouter er en populær proxy som mange bruker for å bytte mellom modeller. Hva gjør Cloudflare annerledes?

Tre ting. Først: nettverket. Cloudflare driver en av verdens største CDN-infrastrukturer. 330 datasentre betyr global dekning og lav latens på en skala de fleste konkurrenter ikke kan matche. LiteLLM kjøres der du kjøres det, OpenRouter har sine servere – Cloudflare har et faktisk globalt nettverk.

Andre: failover-logikken. Automatisk bytte til en annen leverandør når den primære er utilgjengelig er innebygd. Det er ikke noe du konfigurerer selv med komplisert retry-logikk.

Tredje: Workers AI-integrasjonen. Cloudflare Workers er en serverless plattform, og AI Platform integrerer tett med den. Hvis du allerede bruker Workers for backend-logikk, er dette en naturlig utvidelse. For de som ikke er i Cloudflare-økosystemet, er fordelen mer begrenset – REST API-støtte for ikke-Workers-miljøer er varslet som kommende.

Nvidia AI-Q er et eksempel på en annen tilnærming til agentinfrastruktur – open source og selvhostet. Cloudflare AI Platform er det motsatte: administrert, skalert, og bygget for å ikke kreve GPU-infrastruktur fra din side.

Er dette noe for deg?

Det kommer an på. Hvis du bygger agentapplikasjoner og vil ha produksjonsklar infrastruktur uten å drifte servere, er Cloudflare AI Platform et seriøst alternativ å se på. Failover, kostnadssporing, global dekning og ett API for alt – det er en solid pakke.

Hvis du eksperimenterer hjemme, er det overkill. Da er direkte API-nøkler til én eller to leverandører billigere og enklere. Lokal kjøring med Ollama er enda billigere – nær gratis etter hardware-kostnaden.

Prising er ikke offentlig annonsert i detalj for alle funksjoner – Cloudflare AI Gateway har gratisplan med begrensninger og betalte planer for høyere volum. Du betaler fremdeles for tokens til underliggende leverandører (OpenAI, Anthropic, etc.) i tillegg til eventuelle Cloudflare-kostnader. Viktig å ha med i regnestykket.

Retningen er tydelig: AI-infrastruktur konsolideres mot felles inferenslag. I stedet for at hver applikasjon integrerer direkte med 5-10 leverandører, legger en proxy seg i midten og håndterer kompleksiteten. Det er fornuftig ingeniørtankegang – og Cloudflare har nettverket til å gjøre det bedre enn de fleste. Følg gjerne med på hva Cloudflare publiserer om AI Platform etter hvert som de legger til funksjoner.

Vil du lese mer om AI-terminologi og hva «inferens» egentlig betyr? Ta en titt på AI-ordlisten min med 50+ begreper forklart på norsk.