Innhold Vis

Thinking Machines Lab – selskapet til tidligere OpenAI-teknologisjef Mira Murati – har signert en milliardavtale med Google Cloud. Ifølge TechCrunch er avtalen verdsatt til enkeltsiffer-milliarder dollar og dreier seg om tilgang til AI-infrastruktur drevet av Nvidias nyeste GB300-brikker.

Det er første gang Thinking Machines Lab inngår en skyavtale av denne typen. Selskapet har eksistert i litt over et år, hentet inn 2 milliarder dollar i startfinansiering og er allerede i spill med de virkelig store aktørene i AI-bransjen.

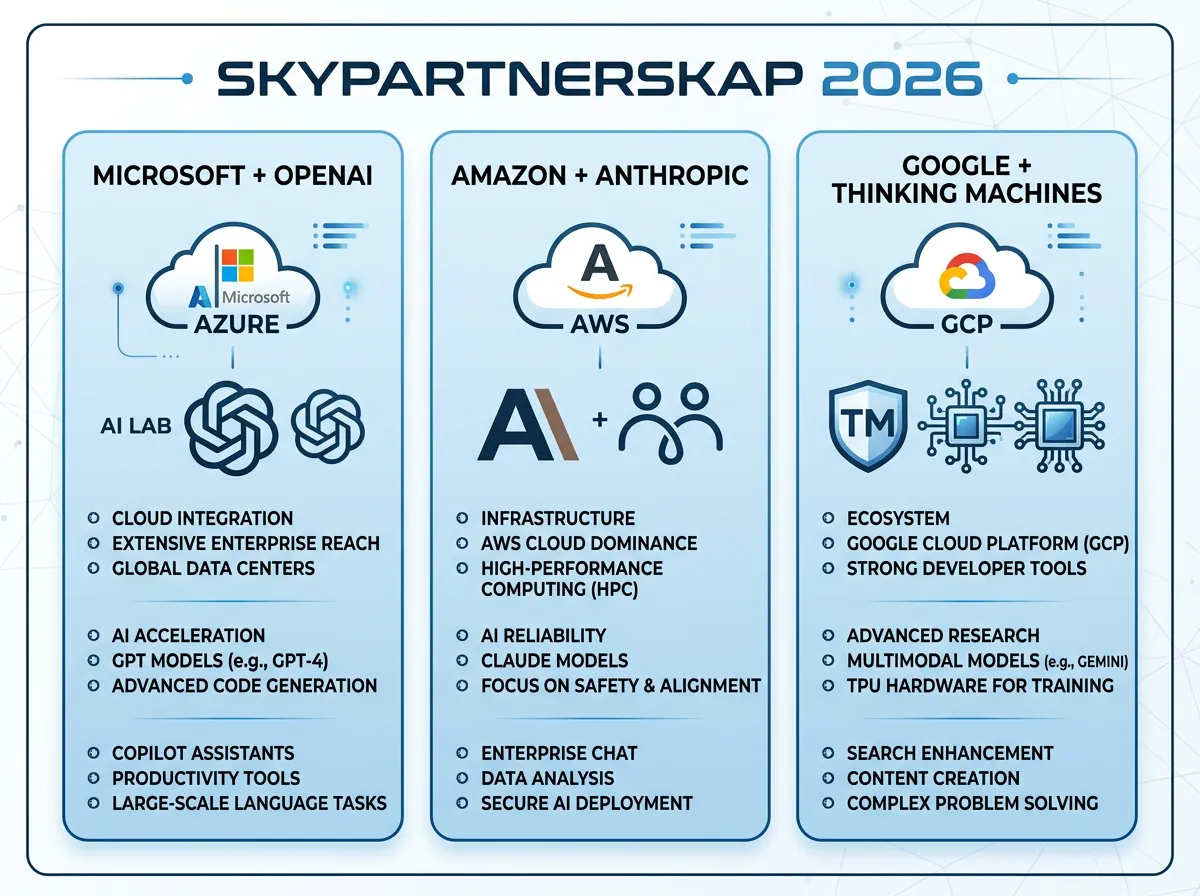

Interessant timing, det her. Vi er midt i et kappløp der alle store AI-labber prøver å sikre seg den beste infrastrukturen – og Google er tydeligvis villig til å betale godt for å knytte de mest lovende selskapene til seg.

Hvem er Thinking Machines Lab?

Mira Murati var teknologisjef i OpenAI i flere år og var en av de sentrale personene bak ChatGPT og GPT-4. I september 2024 forlot hun OpenAI og grunnla Thinking Machines Lab i februar 2025.

Selskapet samlet inn 2 milliarder dollar i en seed-runde – noe som i seg selv er absurde tall – og ble verdsatt til 12 milliarder dollar ved oppstarten. Det sier litt om hvilken tillit Murati har blant investorer etter OpenAI-karrieren.

I oktober 2025 lanserte de sitt første produkt: Tinker. Det er et verktøy som automatiserer opprettelsen av tilpassede AI-modeller, og arkitekturen bygger i stor grad på reinforcement learning. Det er nettopp disse arbeidsbelastningene den nye Google Cloud-avtalen er innrettet mot.

Hva inneholder avtalen?

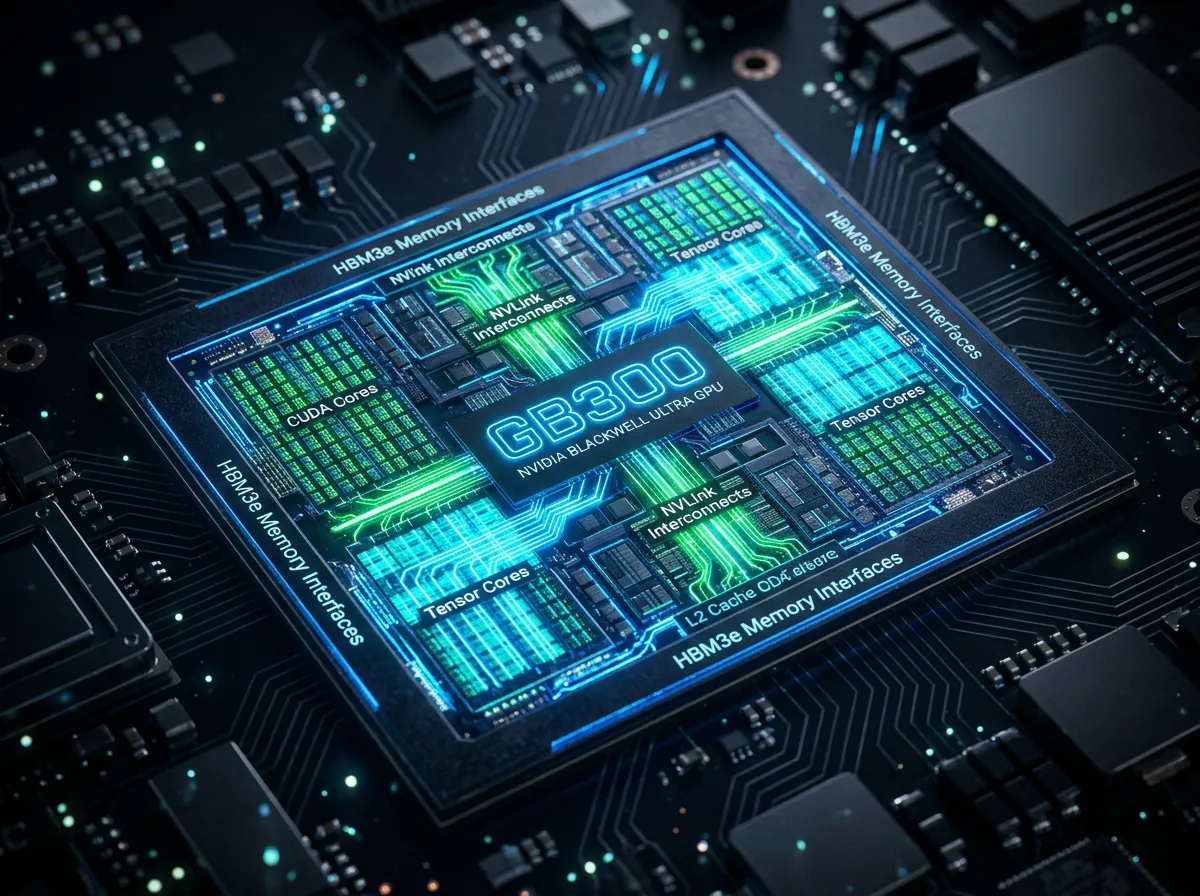

Kjernen i avtalen er tilgang til Nvidias GB300-brikker via Google Cloud. Disse brikkene er den nyeste generasjonen i Blackwell-familien og lover dobbelt så rask trening og inferens sammenlignet med forrige generasjon. For et selskap som Thinking Machines – der ytelse på reinforcement learning er kritisk – betyr det ganske mye i praksis.

I tillegg til GPU-kapasitet dekker avtalen infrastrukturtjenester for modelltrening og distribusjon. Tenk: lagring, nettverk, distribusjonspipelines – alt det praktiske som er nødvendig for å kjøre store AI-modeller i produksjon.

En grunnlegger i selskapet uttalte til TechCrunch: «Google Cloud got us running at record speed with the reliability we demand.» Det høres ut som en fornøyd kunde, men det er jo en naturlig reaksjon etter en milliardavtale.

Ikke eksklusivt – og det er interessant

Et viktig poeng: avtalen er ikke eksklusiv. Thinking Machines kan bruke andre skyleverandører i tillegg til Google Cloud. Det gir dem forhandlingskraft og fleksibilitet – og det er akkurat det kloke selskaper gjør i et marked der AWS, Azure og Google alle sloss om de samme kundene.

Selskapet hadde allerede et partnerskap med Nvidia direkte, men dette er første gang de inngår en formell skyavtale. Retningen er klar: de skal bygge seriøs infrastruktur og trenger stabil, skalerbar tilgang til toppklasse hardware.

Fra Googles side er dette en smart investering. Å knytte til seg et selskap grunnlagt av en av AI-bransjens mest profilerte navn – og et selskap med så mye kapital i ryggen – gir Google Cloud et tydelig signal om at de er et seriøst alternativ til AWS for AI-laboratorier.

Hva betyr dette for Google?

Google har investert tungt i Gemini og sin posisjon i AI-markedet, men konkurransen om skykapasitet er vel så viktig. Microsoft har OpenAI. Amazon har Anthropic. Nå sikrer Google seg Thinking Machines Lab som en sentral partner.

Det handler ikke bare om penger – det handler om å sitte rundt bordet der neste generasjons AI-modeller blir bygd. Hvis Tinker vokser til å bli et viktig verktøy for bedrifter som vil trene sine egne modeller, vil det meste av den treningen skje på Google Cloud-infrastruktur.

Google lanserte nylig en rekke nye AI-verktøy gjennom Google Labs, og denne avtalen passer inn i et større bilde: Google prøver å være tilstede i hele verdikjeden – fra konsumentverktøy til den infrastrukturen seriøse AI-laboratorier er avhengige av.

Nvidias GB300-brikker – hva er de egentlig?

GB300 er den nyeste generasjonen i Nvidias Blackwell Ultra-arkitektur. Nvidia oppgir selv at brikkene leverer dobbelt så høy ytelse for trening og inferens sammenlignet med forrige generasjon (B200). For reinforcement learning-arbeidsbelastninger – som er Tinkers spesialitet – er dette spesielt relevant fordi RL krever enorme mengder parallell beregning.

Google Cloud er en av de første store skyleverandørene som tilbyr GB300 i skala, noe som gir dem en midlertidig fordel i kampen om AI-laboratoriene. Den fordelen forsvinner når AWS og Azure får på plass sin GB300-kapasitet, men det er noen måneder der Google kan hente inn de mest lovende kundene.

Tallene lyver i hvert fall ikke: enkeltsiffer-milliarder dollar for infrastrukturtilgang er mye penger. Det viser hvor seriøst dette kappløpet er.

Hva tenker du? Er dette mer et prestisjeprosjekt for Google enn en ren forretningsavgjørelse? Eller er Thinking Machines Lab en av de virkelig farlige konkurrentene i neste runde av AI-kappløpet?