Innhold Vis

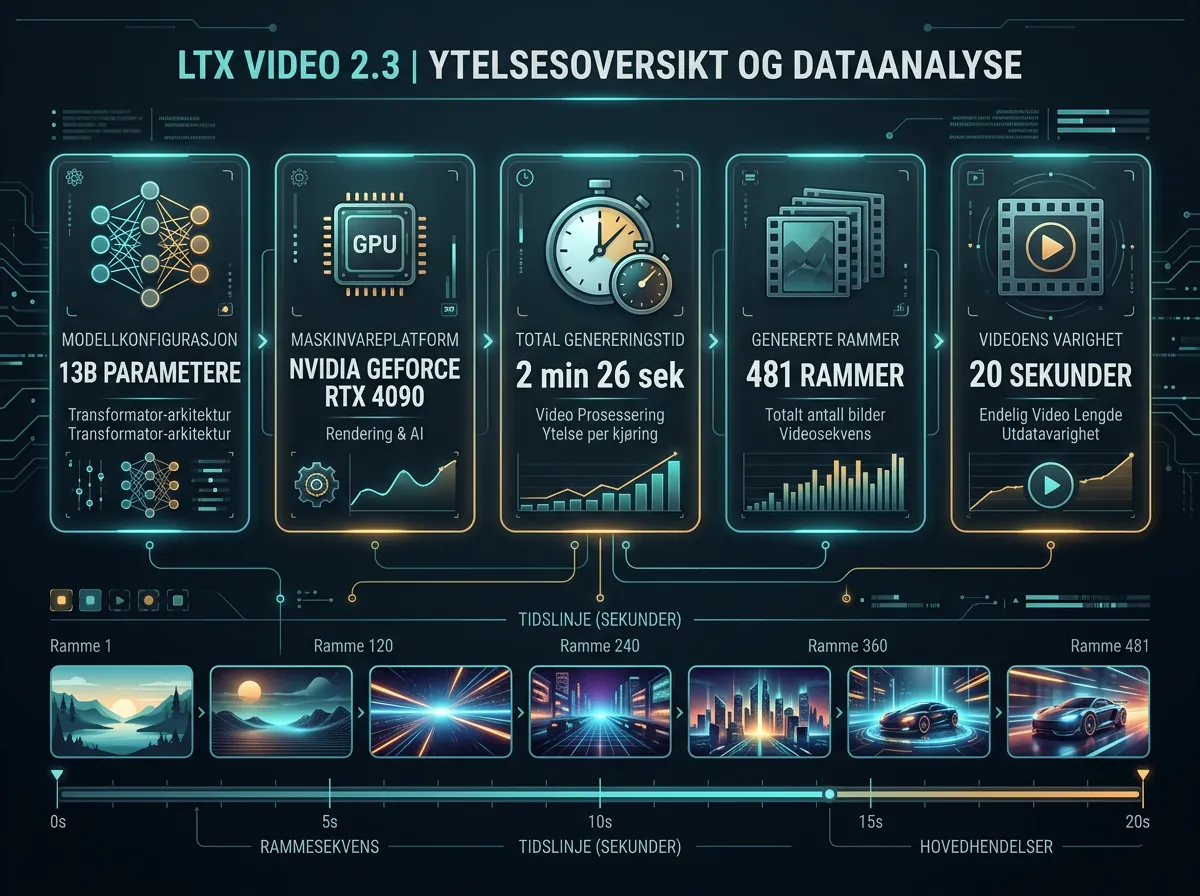

LTX Video 2.3 (versjon 0.9.8) er den nyeste utgaven av Lightricks’ open source videogenereringsmodell – og jeg har brukt den de siste dagene til å lage en hel AI-musikkvideo. 20 sekunder video med 481 frames på under 2,5 minutt på en RTX 4090. 24 fps. Lokal generering, uten skytjenester, uten abonnement.

Jeg har fulgt LTX Video siden starten og skrevet om LTX Video 2 da den kom i januar, og om hvorfor LTX-2 er kongen av open source video-AI. Det som skjer nå er ikke bare en inkrementell oppdatering – jeg bruker den Q8 GGUF-varianten (22B) til å generere klipp til en musikkvideo via ComfyUI, og resultatene er merkbart bedre enn forrige versjon.

Her er hva jeg har lært etter å ha kjørt den gjennom flere titalls klipp på både RTX 4090 og H100.

Hva er LTX Video 2.3 egentlig?

LTX Video 2.3 er ikke et helt nytt produkt – det er Lightricks’ versjon 0.9.8 av modellen, og det er den 13B-parametere-distillerte varianten folk referer til når de sier «2.3». Modellen er åpen kildekode med en lisens som tillater kommersiell bruk, og den kjøres lokalt via ComfyUI.

Den har tre varianter i versjon 0.9.8:

- ltxv-13b-0.9.8-dev – Høyeste kvalitet, krever mest VRAM

- ltxv-13b-0.9.8-distilled – Rask og god kvalitet, balansen de fleste vil velge

- ltxv-2b-0.9.8-distilled – Minste modell, raskest generering

I tillegg finnes Q8 GGUF-varianten (22GB) som jeg har brukt mest – den gir høyere kvalitet enn FP8 men krever deretter mer VRAM. Det er den 13B-distillerte versjonen som leverer 481 frames på 2 minutter og 26 sekunder på en 4090.

Hva jeg faktisk bruker den til

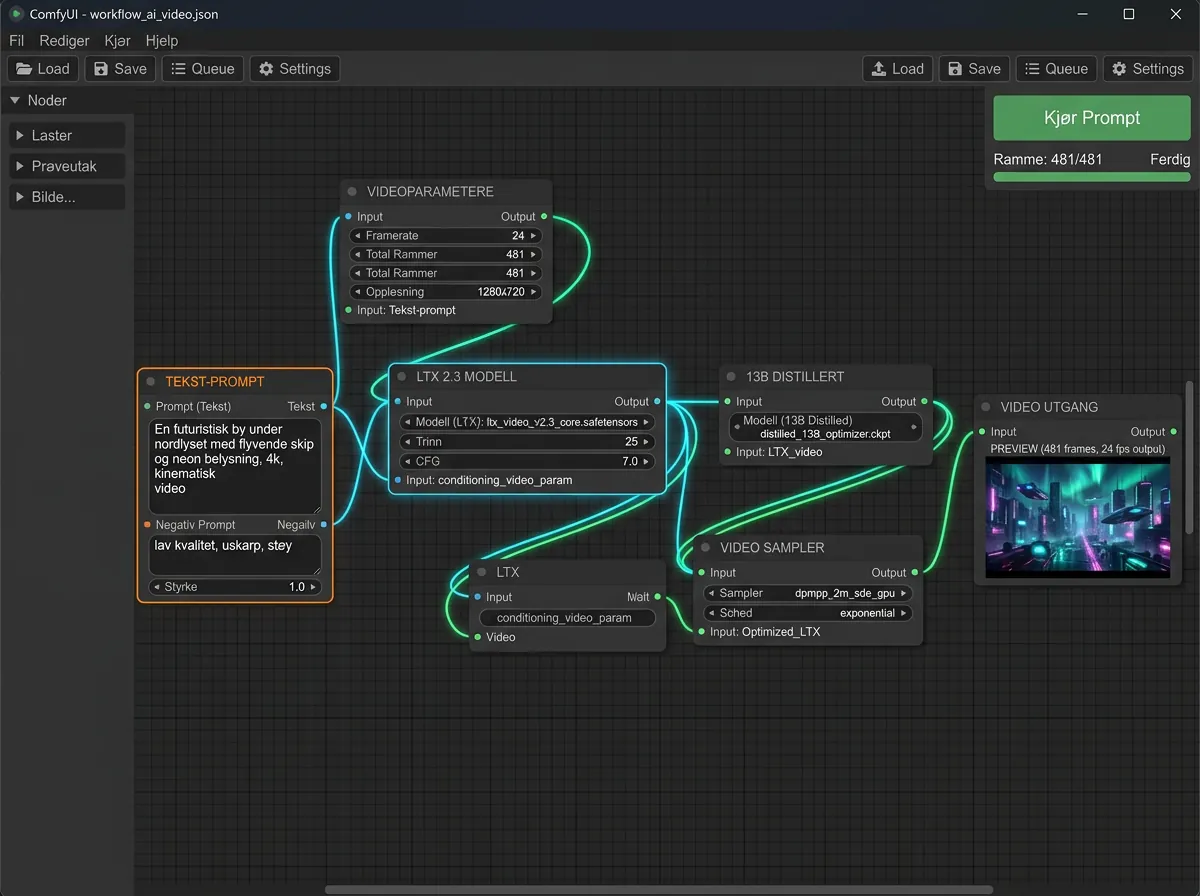

Jeg holder på med en AI-musikkvideo akkurat nå – en symphonic rock/trance-låt på 4 minutter som trengte rundt 20 videoklipp. Hvert klipp er 8-14 sekunder, 1920×1080, 24 fps. Arbeidsflyten er: generere key frames med Nano Banana 2 (bildegenerering), så animere hvert bilde med LTX 2.3 via ComfyUI. Modellen tar inn bildet, en audio-fil for det aktuelle klippet, og en tekstprompt som beskriver hva som skal skje.

ComfyUI håndterer hele arbeidsflyten. Prompting-strukturen følger den offisielle LTX 2.3-guiden: flytende avsnitt i presens, fysiske beskrivelser i stedet for emosjonelle labels, og lyd beskrevet separat. Det som faktisk fungerer er å beskrive scenen som den ER – ikke be om komplekse transisjoner eller flere ting som skal skje samtidig.

Resultatet? Klippene ser genuint bra ut på det de er gode på – enkeltpersoner, atmosfæriske landskapsscener, abstrakte datavisualiseringer. Det som IKKE funker er multi-person-scener og for ambisiøse bevegelser. Ber du LTX om at noen skal sette seg ned, kan du like gjerne få noen som reiser seg opp og går.

Hva er endret fra LTX Video 2?

Fra LTX Video 2 til 2.3 (0.9.8) er det flere forbedringer som merkes i praksis. Opptil 60 sekunders videoinnhold støttes nå – altså seks ganger mer enn de 10 sekundene fra versjon 2. De to nye distillerte modellene (13B og 2B) gir vesentlig raskere generering uten å ofre all kvalitet. Bedre prompt-forståelse er dokumentert, og støtte for IC-LoRA (Image Conditioning LoRA) er lagt til for presis kontroll over referansebilder.

FP8-vekter er inkludert fra starten, og integrering med ComfyUI er tettere enn noensinne – offisielle arbeidsflyter følger med. For de som testet LTX 2 tidlig: dette er en markant forbedring på det som allerede var lovende.

Hvorfor 481 frames på 24 fps?

LTX har tekniske krav til frame count – det må være delbart med 8 pluss 1. Det betyr 481 er et gyldig tall (480 + 1). 24 fps er standard filformat. 20 sekunder ganger 24 fps er 480 frames, men modellen legger til én frame som «ankerframe». Altså: 20 sekunder video = 481 frames ved 24 fps.

Dette er ikke vilkårlige tall – det er rammebetingelsene modellen krever for å generere konsistent videosekvens uten hopp eller glitches. Har du prøvd å kjøre LTX og fått feilmeldinger om feil antall frames, er dette grunnen.

Kravene til hardware – min erfaring

Her blir det ærlig. Jeg har prøvd LTX 2.3 Q8-modellen (22GB) på flere GPU-er, og dette er hva som faktisk skjedde:

RTX 4090 (24GB VRAM): Det funker – men så vidt. Q8-modellen alene er 22GB, og da har du 2GB igjen til LoRA-er, VAE og selve genereringen. Det betyr at deler av modellen lastes over på system-RAM, og da kan ting begynne å gå tregt. Minnebruken klatrer til 100% og maskinen kan henge seg. Mitt tips: sett EXTRA_ARGS til --reserve-vram 10 i ComfyUI-oppsettet, og ikke ha noe annet kjørende som bruker GPU-ressurser. Ingen Chrome-faner med video, ingen andre AI-modeller. 4090 må ha alt for seg selv.

Med FP8-kvantiserte vekter eller den mindre 13B-distillerte modellen er det mer komfortabelt på 4090. Men Q8 gir bedre kvalitet, så det er en avveining.

H100 SXM (80GB VRAM): Her flyr det. Jeg leide en H100 via RunPod og kjørte 23 klipp gjennom køen – hvert klipp tok rundt 10 minutter, og alt bare fungerte uten noen form for minneproblemer. Om du har et prosjekt med mange klipp og ikke vil sitte og babysitte en 4090 som balanserer på kanten, er det verdt å leie en H100 for noen timer. Det kostet meg rundt 30-40 kroner i timen, og jeg fikk unna hele musikkvideoen på en kveld.

Lokal video-AI krever generelt 16GB VRAM som minimum for de fleste modellene som er verdt å bruke. Men for LTX 2.3 Q8 spesifikt? 24GB er minimum, og 80GB er komfortabelt.

Prompting – hva jeg lærte etter 40+ klipp

Jeg har vært gjennom tre runder med denne musikkvideoen, og det tok litt tid å forstå hva LTX 2.3 faktisk vil ha. Den offisielle prompting-guiden er nyttig, men her er hva som faktisk gjør forskjellen:

- Skriv ett flytende avsnitt i presens: Ikke bullet points, ikke stikkord. Beskriv scenen som den er akkurat nå, 4-8 setninger.

- Fysiske cues, ikke abstraksjoner: «munnen beveger seg, øynene ser mot kameraet» fungerer. «Virker glad» fungerer ikke.

- ÉN kamerabevegelse per klipp: «Camera pushes in slowly» er bra. «Camera orbits then zooms then pans» gir kaos.

- Ikke be om komplekse handlinger: Jeg ba om at en karakter skulle sette seg ned – LTX ga meg en som reiste seg opp og gikk. Hold det enkelt.

- Enkelt subjekt: Én person funker. To personer? Da dukker det opp random folk i blå skjorte som ingen ba om.

- Klippene må være lange nok: 4-5 sekunder er for kort – LTX har ikke nok tid til å bygge bevegelse. 8-12 sekunder er sweet spot.

Multi-person-scener er fortsatt utfordrende for LTX – det er der Kling og lignende skytjenester leder. Men for single-character-video, atmosfæriske landskapsscener, abstrakte datavisualiseringer – dette fungerer genuint bra.

Open source vs betalte tjenester i 2026

Sammenlign dette med Veo 3.1 (Google, skytjeneste) eller Kling (kinesisk, kostbart per klipp). LTX 2.3 er gratis å kjøre lokalt. Du trenger GPU med nok VRAM, og du betaler strøm – det er det. Ingen per-video-pris, ingen abonnement, ingen data som går til en skyserver. Alternativt leier du en H100 for noen timer via RunPod og får unna et helt prosjekt for prisen av en pizza.

For norske brukere er det ekstra interessant: full kontroll over innholdet, ingen GDPR-bekymringer knyttet til sky-prosessering, og en modell som er god nok for reell bruk. LTX 2.3 var allerede fremhevet i AI-nyhetene fra mars 2026 – og etter å ha brukt den selv i et ekte prosjekt kan jeg bekrefte at det var berettiget.

Er det perfekt? Nei. Ansikter kan bli dratt ut om klippene er for lange, random folk dukker opp i scener der du ikke ba om dem, og komplekse handlinger blir ofte det motsatte av hva du ba om. Open source video-AI har kommet vanvittig langt – men betalte løsninger som Veo 3.1 og Kling er fortsatt flere hoder foran på kvalitet, konsistens og multi-person-scener. Men for image-to-video med god prompting, atmosfæriske scener og abstrakte visualiseringer – dette er genuint imponerende for en open source-modell du kjører selv. Og gapet krymper for hver oppdatering.

Mitt råd: start med kortere klipp (8-10 sekunder), hold promptene enkle, og vær forberedt på å iterere. LTX 2.3 er ikke et «trykk på knappen og få perfekt video»-verktøy. Det er et verktøy for folk som liker å eksperimentere og finpusse – og for oss er det gull.

3 kommentarer