Innhold Vis

En ny studie fra University of Southern California konkluderer med at store språkmodeller standardiserer menneskelig uttrykk – og subtilt påvirker hvordan vi tenker. Publisert i Trends in Cognitive Sciences i mars 2026, peker forskerteamet ledet av Zhivar Sourati på noe som egentlig er ganske åpenbart – når milliarder av mennesker bruker de samme tre-fire AI-chatbotene til å formulere tanker, skrive e-poster og brainstorme ideer, begynner det å lukte litt… likt.

Jeg har tenkt på dette selv. Når jeg leser AI-generert tekst fra forskjellige folk – på Twitter, i kommentarfelter, i nyhetsbrev – er det noe som gjør dem like. En bestemt rytme. En bestemt måte å strukturere argument på. Nesten en «AI-stemme» som siver inn i tekster som ikke er fullt ut skrevet av AI, men som er redigert, polert eller inspirert av den.

Studien kaller det homogenisering. Og den er mer bekymret for det enn jeg umiddelbart er – men den reiser spørsmål det er verdt å tenke på.

Hva sier forskningen konkret?

Studien – «The homogenizing effect of large language models on human expression and thought» – er et opinion paper, altså en faglig argumentasjon og gjennomgang av eksisterende forskning, ikke en ny eksperimentell studie. Sourati og kollegene hans ved USC har samlet bevis fra en rekke studier for å argumentere for et mønster.

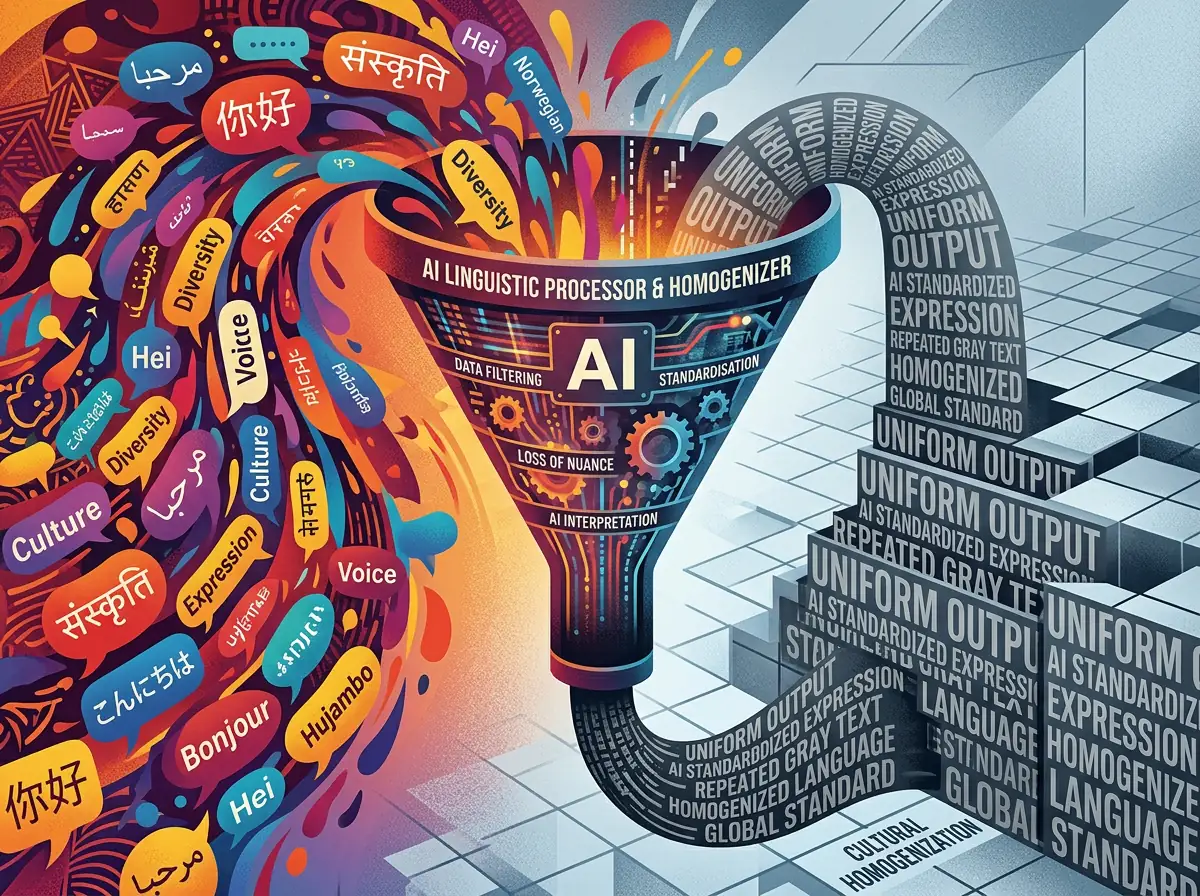

Det viktigste funnet: Når individer formulerer tanker gjennom de samme LLM-ene, mister tekstene sine særtrekk. Lingvistisk stil, perspektiv og resonneringsstrategier flater ut. Det er ikke at folk skriver dårlig – det er at de skriver likt.

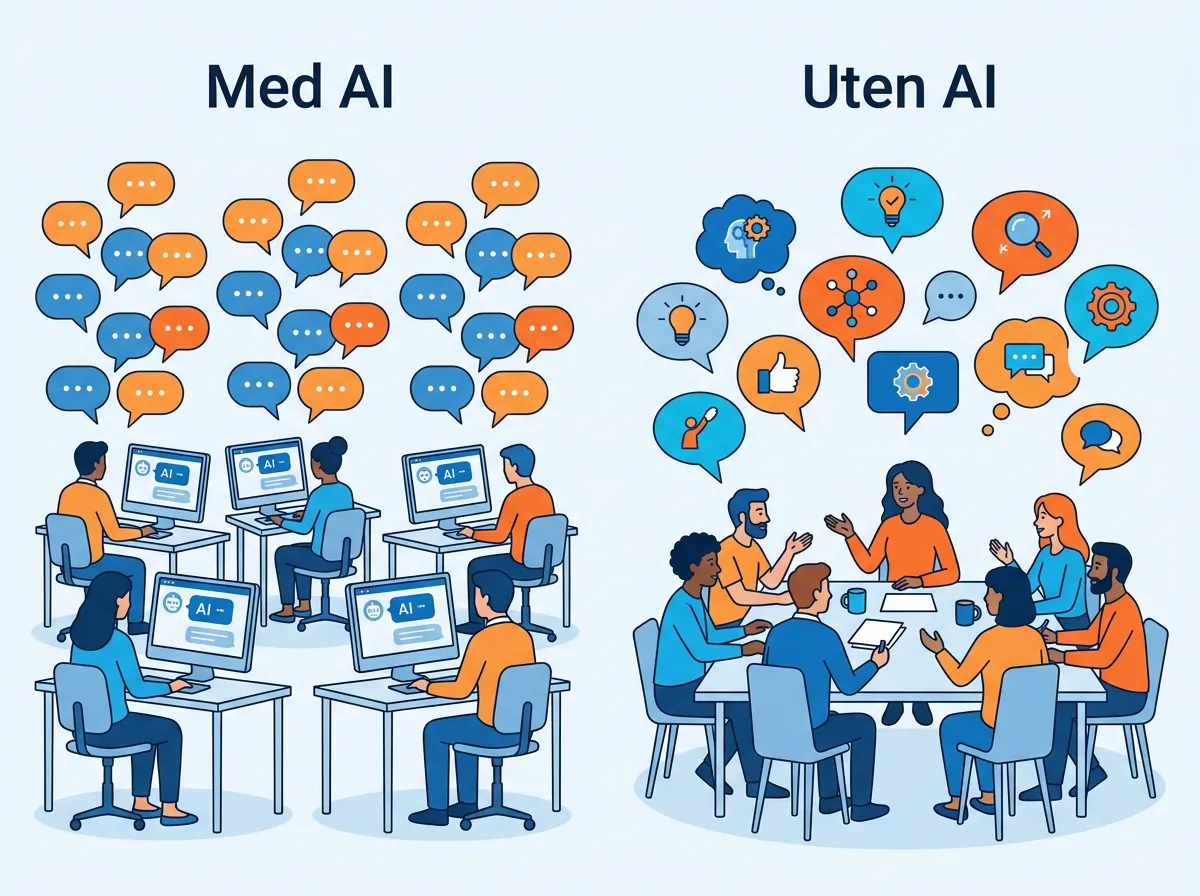

Et konkret eksempel fra forskningen: Grupper som bruker AI til idédugnad genererer færre og mindre kreative ideer enn grupper som jobber uten AI. Individer produserer flere ideer, men idéene ligner mer på hverandre. Paradoksalt nok: AI hjelper individet, men skader gruppen.

Det er en distinksjon som fortjener å stoppe opp ved. Individuell produktivitet opp. Kollektiv kreativitet ned.

Vestlig bias innbakt i modellene

En annen dimensjon i studien handler om kulturell skjevhet. LLM-er trenes på data som i stor grad overrepresenterer vestlige, engelskspråklige, velutdannede perspektiver. Sourati formulerer det slik: LLM-output «speiler en smal og skjev del av menneskelig erfaring.»

Det betyr at når folk verden over bruker ChatGPT, Claude, Gemini og lignende til å finpusse meningene sine og skrive innhold, absorberer de – kanskje uten å vite det – vestlige resonnerings- og uttrykksformer. Lineær argumentasjon. Chain-of-thought logikk. Bestemte måter å strukturere tanker på.

Intuitivt og abstrakt resonnement – som i mange kulturer er like gyldige tenkemåter – presses ut. Det er faktisk fascinerende og litt ukomfortabelt å tenke på.

Hva skjer med meningene dine?

Den mest urovekkende delen av studien er ikke skrivingen – det er meningsdannelsen. Forskning viser at etter interaksjon med LLM-er med innbygde perspektiver, begynner brukernes meninger å konvergere mot modellens perspektiv.

Det er ikke science fiction. Det er en statistisk effekt fra eksperimenter som allerede er gjennomført. Du spør AI-en om noe. AI-en svarer med sitt perspektiv – innbakt i måten den presenterer informasjon, hvilke alternativer den nevner, hvilke den hopper over. Og uten at du merker det, trekkes du litt i den retningen.

For deg som er vant til å tenke kritisk er det kanskje ikke dramatisk. Men for milliarder av brukere som ikke tenker på AI som noe annet enn Google 2.0 – da begynner det å bli interessant på et samfunnsnivå.

Jeg tenker litt på dette i sammenheng med noe jeg har skrevet om tidligere: slik fungerer disse modellene egentlig. De er ikke nøytrale ordbøker. De er statistiske maskiner trent på menneskelig tekst – og de reproduserer mønstre fra den teksten, inkludert fordommer og perspektiver.

Er dette faktisk et problem?

Her er jeg litt mer skeptisk enn forskerne til den apokalyptiske tonen. Menneskelig uttrykk har alltid blitt påvirket av dominerende medier og teknologier. Boka standardiserte skriving. Telegraf standardiserte nyhetsspråk. TV standardiserte uttale og aksent. Internett standardiserte … alt mulig.

Det er ikke slik at menneskelig tanke var et blomstrende mangfold av fullstendig unike ideer før ChatGPT kom. Vi er sosiale dyr som imiterer og absorberer. Alltid har vært.

Men LLM-er er noe nytt i skala og direkte interaktivitet. Boka leste du passivt. AI-en svarer deg. Det er en tokke forskjell. Og hastigheten er en annen. Det tok hundre år for boken å standardisere europeisk skriftspråk. LLM-er har gjort noe lignende på tre år.

Det er den dynamikken jeg synes er verdt å ta på alvor. Ikke hysteri – men bevissthet.

Hva mener forskerne må gjøres?

Sourati og kollegene anbefaler at AI-utviklere bevisst bygger inn lingvistisk, perspektivmessig og kulturelt mangfold i modellene. Tren på flere språk, mer varierte kulturelle kontekster, et bredere spekter av resonneringsformer.

Det høres fornuftig ut som teknisk tilnærming – og det er en markedsbasert løsning snarere enn en reguleringsbasert en. Selskaper som lager bedre, mer mangfoldige modeller bør over tid vinne brukere som setter pris på det. Og konkurranse mellom ulike modeller med ulike treningsdata er i seg selv en buffer mot total homogenisering.

Det er kanskje det mest underliggende poenget: Et marked med mange konkurrerende AI-modeller er et naturlig forsvar mot homogenisering. Monopol på AI er derimot et reelt problem – ikke fordi staten må gripe inn, men fordi brukere bør velge med det i bakhodet.

Hva betyr dette for deg som bruker AI?

Noen praktiske tanker fra meg:

- Bruk AI som verktøy, ikke ghostwriter. Skriv utkastet selv. La AI polere, sjekke fakta, foreslå omformuleringer. Ikke la AI skrive fra blank side. Da beholder du din stemme.

- Bruk flere modeller. Jeg bruker Claude og Grok. Ikke bare ChatGPT. Ulike treningsdata gir ulike perspektiver. Det er en naturlig motgift.

- Vær bevisst på å ha egne meninger. Når du spør AI om noe kontroversielt, legg merke til om du opplever at svaret «passer deg» – eller om du ubevisst adopterer det.

- Skriv noe uten AI. Dagbok. Notater. Noe bare for deg. Hold tanke-muskelen i form.

Studien er fra USC, men problemstillingen treffer bredt. Og den er mer aktuell desto mer vi integrerer AI i skole og arbeidsliv. AI på skolen handler ikke bare om juksing – det handler også om hva slags tenkere vi utvikler.

Jeg er ikke redd for AI. Men jeg synes det er verdt å bruke verktøyene med åpne øyne. Bevissthet er bedre enn forbud – og langt mer effektivt.