Innhold Vis

Microsoft tester nå OpenClaw-lignende AI-agenter for Microsoft 365 Copilot – autonome bots som skal jobbe døgnet rundt på vegne av brukerne, uten å vente på at noen sier «hei, gjør dette.» Omar Shahine, Microsofts corporate vice president, bekreftet til The Information at selskapet aktivt utforsker dette. Copilot for Microsoft 365 hadde 70 millioner betalende brukere i Q1 2026. Det er ganske mye som kan endres.

OpenClaw er et open source-rammeverk for AI-agenter som kjører lokalt på enheten – uten konstant skyavhengighet. Det har fått mye oppmerksomhet blant utviklere som er lei av API-kostnader og ventetid på skytjenester. Nå vil altså Microsoft ta den ideen inn i enterprise-verdenen, og skalere det til potensielt 400 millioner Office 365-brukere globalt.

Her er det interessante spørsmålet: Hva betyr det egentlig at AI-en din jobber «hele tiden» – og hvem bestemmer hva den skal gjøre mens du sover?

Hva er forskjellen fra vanlig Copilot?

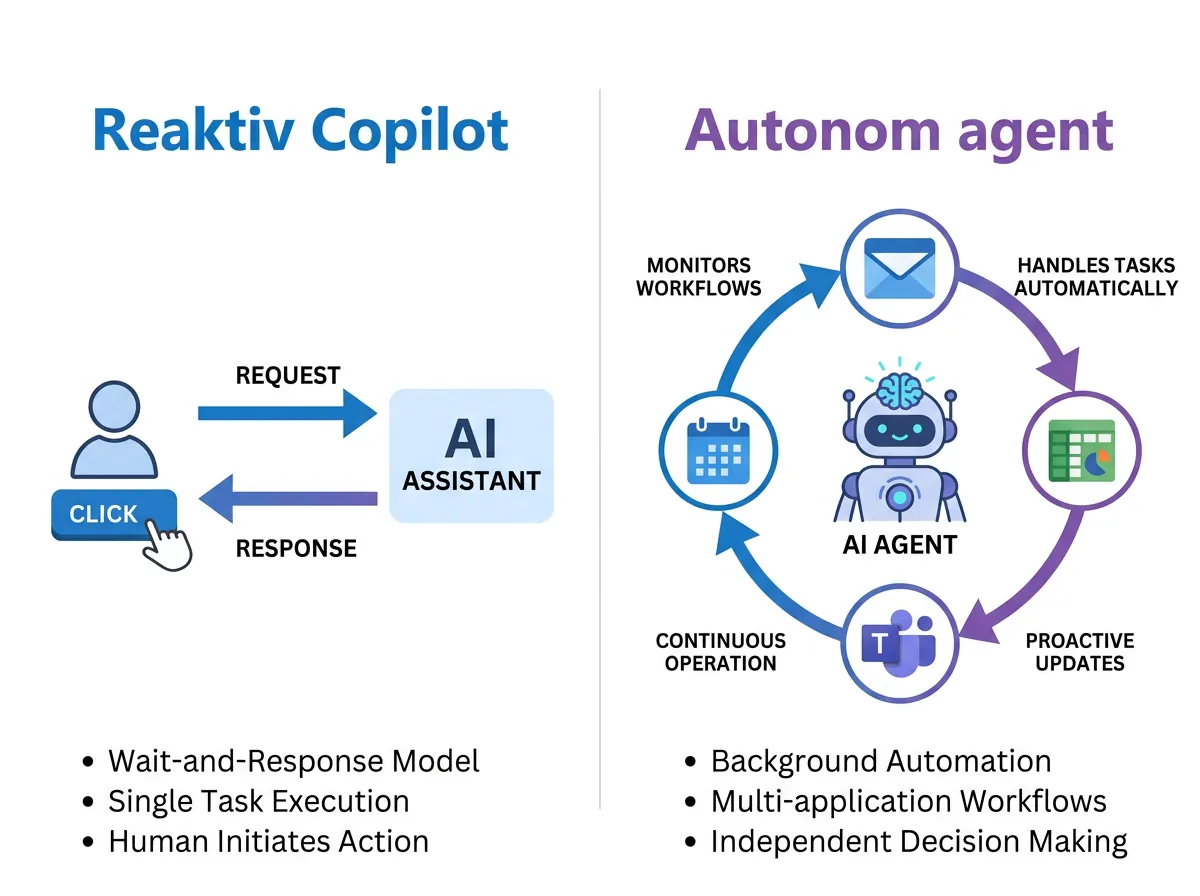

Dagens Microsoft 365 Copilot er i stor grad reaktiv. Du spør, den svarer. Du ber den skrive et utkast, den gjør det. Det er nyttig, men det er ikke autonomt – det er en veldig smart autocomplete.

Det Microsoft nå tester er noe annet. Autonome agenter som overvåker, beslutter og handler kontinuerlig uten at du trykker «send». I praksis kan det bety at Copilot selv svarer på e-poster etter dine preferanser, forbereder møtereferater før møtet er ferdig, oppdaterer regneark basert på data som strømmer inn, og koordinerer på tvers av Teams-kanaler – alt i bakgrunnen.

Det ligner mye på det OpenClaw allerede gjør for utviklere, bare pakket inn i Microsofts enterprise-drakt med de kontrollmekanismene som kreves for store organisasjoner.

Hva er OpenClaw, og hvorfor er det relevant her?

OpenClaw er et open source agent-rammeverk som lar AI-modeller utføre oppgaver lokalt – uten å sende alt til skyen. Det vant popularitet tidlig i 2026 blant utviklere og tech-entusiaster som var frustrerte med API-kostnader og latensproblemer fra skybaserte løsninger.

Det som skiller OpenClaw fra mange andre agent-rammeverk er vekten på lokal kjøring. Agenten lever på maskinen din, har tilgang til filsystemet, og kan ta valg uten å måtte vente på et svar fra en server i Virginia. Det gir lavere forsinkelse, lavere kostnader per handling – og mer kontroll for den teknisk kyndige brukeren.

Jeg har tidligere skrevet om NemoClaw fra Nvidia, som tar en lignende tilnærming men med hardwareoptimalisering i fokus. Microsoft tar nå den samme ideen og prøver å tilpasse den for massemarkedet. Det er et signal om hvilken retning hele bransjen beveger seg.

70 millioner brukere – og potensielt 400 millioner

Tallene er verdt å stoppe opp ved. Microsoft 365 Copilot har 70 millioner betalende brukere per Q1 2026. Det er vekst fra null på to år – en ganske imponerende oppskalering. Men bak det igjen sitter 400 millioner Office 365-brukere som betaler for pakken uten å ha aktivert Copilot ennå.

Hvis Microsoft lykkes med å gjøre Copilot mer autonom og dermed mer synlig nyttig – ikke bare en funksjon du aktivt må oppsøke, men en som faktisk gjør ting mens du er på lunsjpause – er det ikke utenkelig at adopsjonsraten skyter opp. Det er trolig hele poenget med denne testingen.

Microsoft Build i juni skal etter sigende vise frem noe relatert til dette. Akkurat hva er ikke bekreftet, men tidspunktet stemmer godt med at de nå er i testfase.

Hva kan gå galt?

La meg ikke bare juble her, for det er faktisk noen reelle utfordringer. Autonome agenter i enterprise-miljøer reiser et grunnleggende spørsmål om tillit og revisjon. Hvem er ansvarlig når en AI-agent sender feil e-post på vegne av sjefen? Hva skjer når den oppdaterer feil regneark? Eller planlegger et møte i feil tidssone fordi den tolket en kalenderoppføring feil?

Microsoft nevner selv at de jobber med «enterprise-tilpassede sikkerhetskontroller» som skal skille dem fra det mer åpne og risikofylte open source-rammeverket. Men detaljer om hva disse kontrollene faktisk innebærer er foreløpig vage. Audit trails, rollback-mekanismer, og tillatelsesrammer er nevnt som nødvendigheter – men ingen av delene er ferdig definert.

Prissettingen for 24/7 autonom drift er heller ikke avklart. Dagens Copilot-lisensiering er basert på at en bruker aktivt benytter tjenesten. Hvis agenten kjører konstant i bakgrunnen, endres forbruksmønsteret dramatisk. Det vil reflekteres i prisen, og det er ikke gitt at det blir billig.

Hva betyr dette for deg som bruker Microsoft 365?

Foreløpig ingenting. Dette er en test, ikke en lansering. Men det er interessant å følge med på fordi det peker mot noe: AI-assistenter er på vei fra å være verktøy du henter frem, til å bli bakgrunnsprosesser du setter opp én gang og glemmer.

Det er en stor overgang, og den krever at du tenker annerledes om hva du delegerer. Å be Copilot skrive et utkast som du leser over – det er en ting. Å la en agent svare på e-poster mens du ikke ser det – det er noe helt annet. Det krever et nivå av tillit, konfigurasjon og kontroll som de fleste brukere ikke er vant til å tenke på.

Microsoft Build i juni vil trolig gi svar på mange av disse spørsmålene. Til da er dette et tidlig signal om hvilken retning selskapet vil med Copilot – og det er en retning som faktisk er interessant å følge med på.

Hva tenker du? Ville du latt en AI-agent håndtere e-post og møteplanlegging autonomt, eller er det et steg for langt?

3 kommentarer