Innhold Vis

OpenAI oppdaterte Agents SDK 15. april 2026 med to nye hovedelementer: sandkasse-isolering (sandboxing) og et såkalt in-distribution harness. Oppdateringen er rettet mot bedrifter som vil bygge AI-agenter som klarer langvarige, flertrinns oppgaver – uten at agenten kan rote rundt i systemer den ikke har noe i.

Timing er interessant. Agentbasert AI vokser fort, og spørsmålet alle stiller seg er: hvordan holder vi kontroll på agenter som faktisk gjør noe? OpenAI svarer med verktøy, ikke løfter.

Her er hva som faktisk er nytt, og hvorfor det har praktisk betydning.

Hva er sandboxing i Agents SDK?

En AI-agent som kan lese filer, kjøre kode og sende forespørsler er nyttig – men også potensielt kaotisk hvis den ikke er begrenset. Sandboxing er OpenAIs svar på det: agenten får jobbe i et isolert miljø der den bare har tilgang til filer og verktøy som er godkjent for den spesifikke operasjonen.

Tenk på det som å gi en ny ansatt nøkkel til bare det rommet de skal jobbe i – ikke hele bygningen. De kan gjøre jobben sin, men kan ikke gå inn i arkivrommet eller serveren ved siden av.

Ifølge TechCrunch er selve kjernen i lanseringen at SDK-en nå er kompatibel med eksisterende sandbox-leverandører. Bedrifter trenger ikke bygge isolasjonslaget selv.

Hva er harness – og hvorfor skal du bry deg?

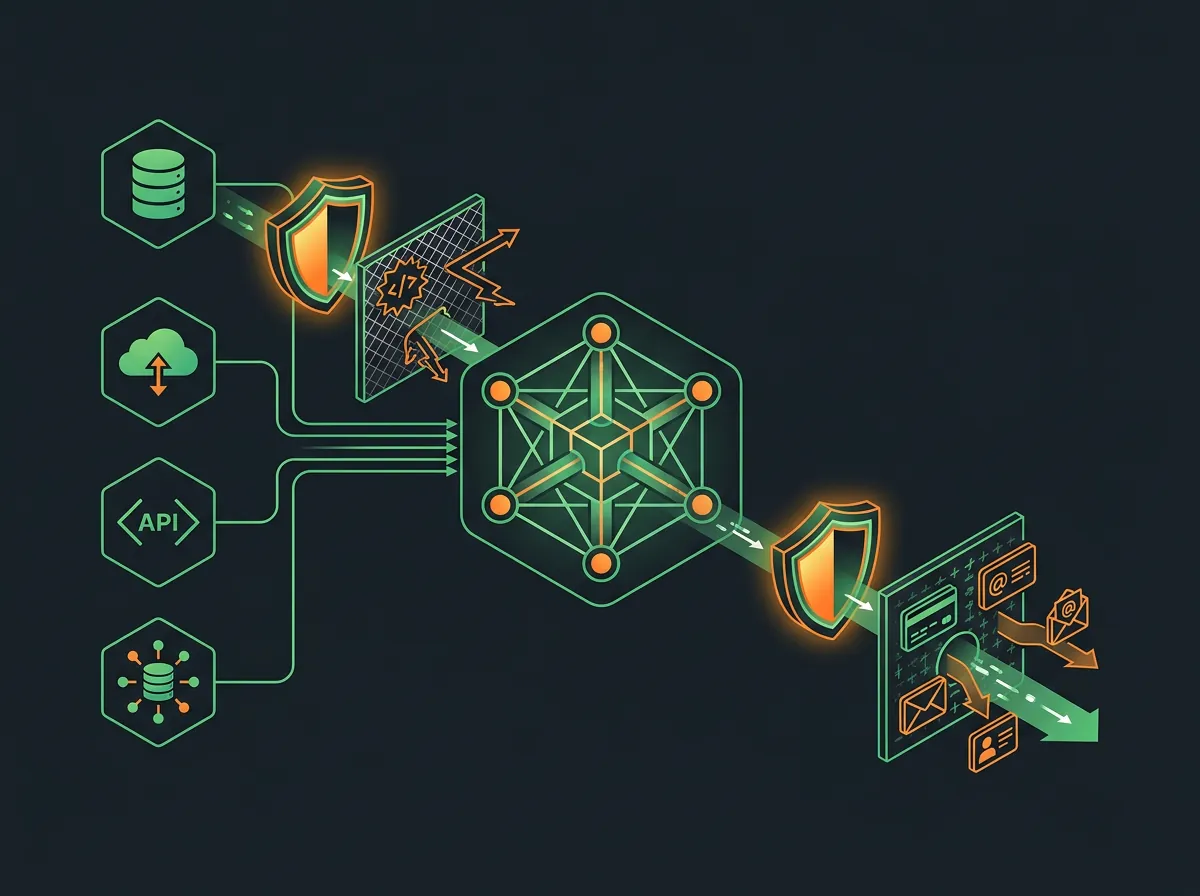

En harness er alt rundt modellen – infrastrukturen som lar agenten gjøre noe utover å generere tekst. Det inkluderer verktøytilgang, godkjente filer, shell-kommandoer og kode-kjøring.

Det OpenAI leverer her er et ferdigbygd harness for sine egne frontier-modeller. Karan Sharma fra OpenAIs produktteam sa det rett ut:

«Dette handler om å ta det eksisterende Agents SDK og gjøre det kompatibelt med alle disse sandbox-leverandørene – slik at folk kan bygge langvarige agenter med vår infrastruktur og sin egen.»

Langvarige agenter betyr agenter som jobber gjennom komplekse, flertrinns oppgaver over tid – ikke bare enkel spørsmål-svar. Det er her enterprise-bruk faktisk begynner å gi mening: automatisering av prosesser som tar timer, ikke sekunder.

Guardrails – sikkerhet kjørt parallelt med agenten

En av de mer praktiske tilleggene er guardrails-systemet. Det lar deg kjøre sikkerhetssjekker parallelt med agenten – ikke etterpå. Systemet kan blant annet maskere eller flagge personopplysninger (PII), oppdage jailbreak-forsøk, og stoppe kjøringen umiddelbart hvis en sjekk feiler.

Det betyr kortere responstid ved problemer. I stedet for at agenten kjører et langt oppdrag og du oppdager problemer til slutt, stopper systemet mens det fortsatt er tid.

Guardrails er dokumentert i OpenAIs offisielle SDK-dokumentasjon og er ikke en ny konsept – men integrasjonen med den nye harness-strukturen gjør den mer praktisk å bruke i produksjon.

MCP og verktøyintegrasjon

Harness-strukturen er bygget for å fungere med eksisterende infrastruktur – inkludert verktøytilgang via MCP (Model Context Protocol). Det vil si at agenter bygget i Agents SDK kan hente data fra eksterne systemer, kjøre verktøy og bruke skills på en strukturert måte.

Dette er relevant fordi det knytter OpenAIs SDK tettere til det bredere agentøkosystemet – ikke bare OpenAIs egne modeller og tjenester. Bedrifter som allerede har MCP-basert infrastruktur kan i teorien koble den inn uten å bygge om.

Jeg har tidligere skrevet om lignende tilnærminger – OpenAIs arbeid med AI-agenter og autonome agenter som jobber i bakgrunnen – og det er tydelig at verktøy-integrasjon er det feltet som beveger seg raskest akkurat nå.

Python først – TypeScript kommer

Sandboxing og harness lanserer først i Python. TypeScript-støtte er planlagt, men ingen dato er oppgitt. Code mode og subagents – der én agent kan spawne og koordinere andre agenter – kommer til begge språk i neste runde.

For de fleste som bygger agenter i dag er Python-first ikke noe problem. Det er der mesteparten av AI-verktøy-utviklingen skjer uansett.

Prisingen er standard API-prising. Ingen ekstra enterprise-tillegg annonsert.

Hva betyr dette i praksis?

OpenAI gir utviklere infrastrukturen de ellers måtte bygge selv. I stedet for å sy sammen sandkasse, verktøy-integrasjon og sikkerhetslag fra scratch, kan et team sette opp en fungerende agent-pipeline med Agents SDK som grunnlag.

Det er ikke revolusjonerende – konkurrenter som Anthropic og Microsoft har lignende tilbud. Men det senker terskelen for bedrifter som allerede er i OpenAIs økosystem. Har du GPT-4o i produksjon fra før og vil eksperimentere med agenter, er dette en kortere vei dit enn å bytte plattform.

Spørsmålet er om enterprise-markedet faktisk vil ta dette i bruk, eller om agentbasert automatisering fortsatt er i «proof of concept»-fasen hos de fleste. Mitt inntrykk er at det er dit vi er på vei – men det tar tid. OpenAIs bredere ambisjon om å samle agenter, koding og browsing i én plattform peker i samme retning.

Hva tenker du – er dette noe du vil teste, eller er agenter fortsatt for umodne for produksjonsbruk?