Innhold Vis

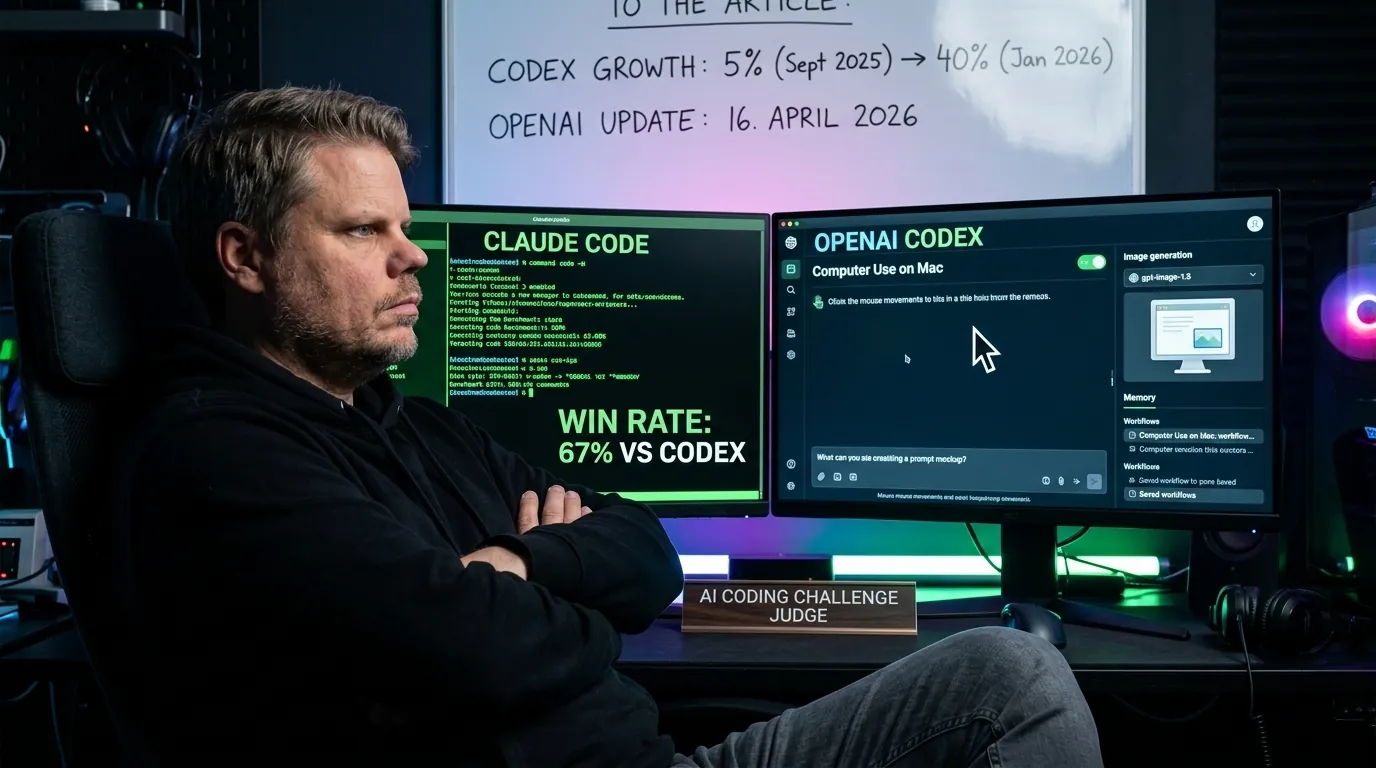

OpenAI Codex fikk 16. april 2026 en av sine største oppdateringer siden lanseringen – og nå snakker vi ikke lenger bare om et kodeverktøy. Codex kan nå ta kontroll over Mac-apper på egen hånd, se skjermen din, klikke og skrive, alt mens du holder på med noe annet.

Oppdateringen kom stille og rolig, men det den representerer er ganske vesentlig. Codex beveger seg bort fra det smale «skriv kode»-sporet og over mot det som minner mer og mer om en autonom digital assistent som faktisk gjør jobben – ikke bare foreslår den.

Her er hva som er nytt, hva du faktisk kan bruke det til, og én ting du bør merke deg hvis du er i Europa.

Hva er OpenAI Codex?

Codex er OpenAIs desktop-app for utviklere og avanserte brukere – et AI-verktøy som opprinnelig ble lansert for macOS 2. februar 2026, og kom til Windows 4. mars samme år. Det ble bygget rundt GPT-5.3 Codex-modellen og posisjonert som et alternativ til Claude Code, som Anthropic har hatt et forsprang med i kodemarkedet.

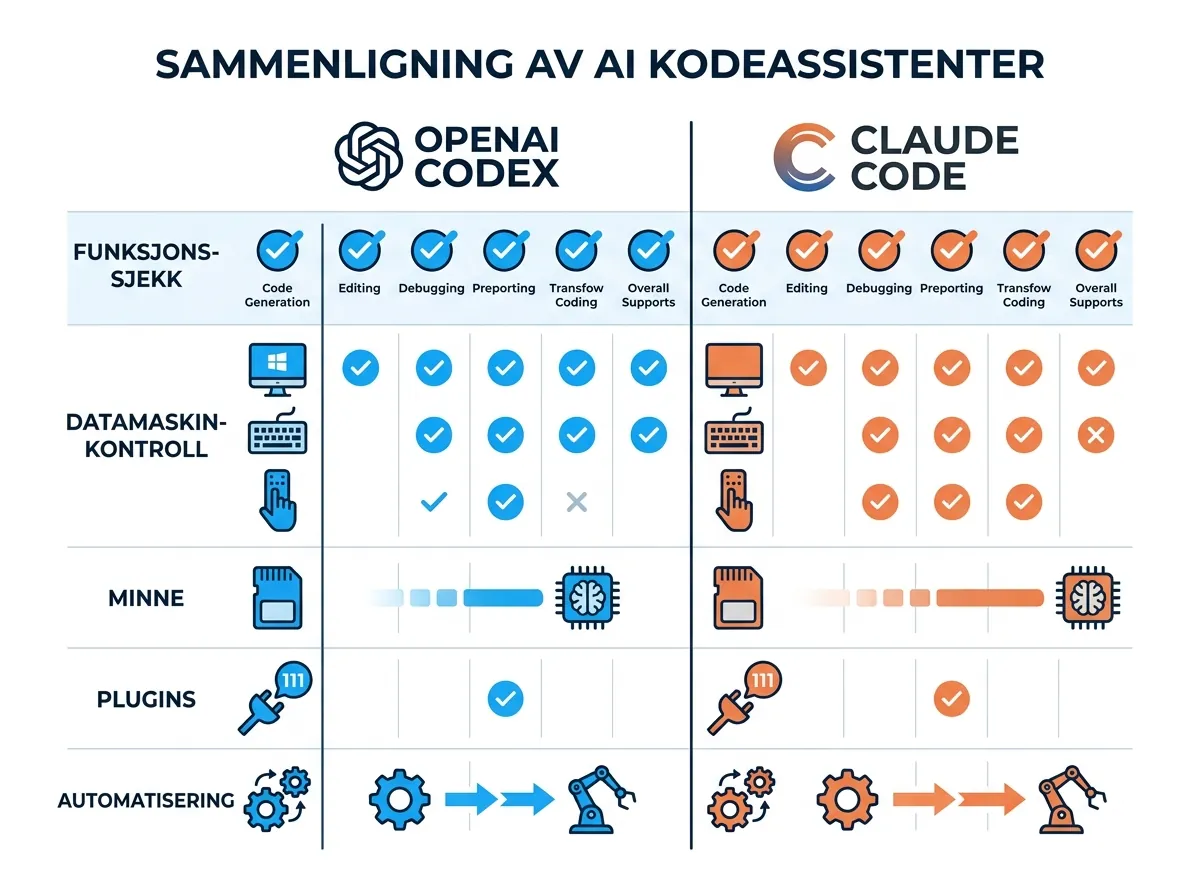

Frem til april-oppdateringen handlet Codex primært om å hjelpe deg å skrive, gjennomgå og forbedre kode. Nå handler det om noe bredere: å ta kontroll over hele arbeidsflaten din.

Computer use – hva vil det si i praksis?

Den mest konkrete nyheten er computer use-funksjonen. Codex kan nå åpne Mac-apper, se hva som vises på skjermen, klikke på knapper og skrive inn tekst – helt autonomt, i bakgrunnen, mens du holder på med din egen jobb.

Tenk deg at du ber Codex om å teste en funksjon i en app, navigere gjennom et GUI-basert grensesnitt, eller reprodusere en bug som bare vises visuelt. Tidligere måtte du gjøre det selv og beskrive hva du så. Nå kan Codex se det direkte og handle ut fra det.

OpenAI beskriver det som særlig nyttig for testing av native Mac-apper, simulatorflyter, og GUI-spesifikke bugs som er vanskelige å dokumentere i tekst. Og siden Codex kjører i bakgrunnen, trenger du ikke sitte og vente – den gjør jobben mens du gjør din.

En liten hake for norske brukere: computer use er ikke tilgjengelig i EU, Storbritannia eller Sveits ved lanseringen. Det er ingen overraskelse – slike kraftige autonome funksjoner møter regulatorisk motstand i Europa før de er ute av startgropen. Men det er altså ikke det norske markedet OpenAI prioriterer her, i hvert fall ikke akkurat nå.

Memory, planlegging og flerdagers arbeidsflyt

Noe av det mest interessante med april-oppdateringen er ikke computer use – det er minnefunksjonen og automatiseringen.

Codex kan nå huske dine preferanser, tech stack, og typiske arbeidsflyter fra gang til gang. Du slipper å forklare kontekst på nytt hver sesjon. I tillegg kan du nå planlegge arbeid på tvers av dager: be Codex om å sjekke CI-feil hver morgen, sortere issues, eller sende deg en daglig oppsummering.

Dette er et konseptuelt skifte. Fra «ett spørsmål om gangen» til «et verktøy som arbeider kontinuerlig på dine vegne». Det er i den retningen alle de store AI-verktøyene beveger seg akkurat nå – Codex er bare én av flere som tar steget.

Innebygd nettleser og bildegenerering

To andre nye funksjoner fortjener å nevnes. Codex har nå en innebygd nettleser der du kan åpne lokale eller offentlige sider, kommentere direkte på rendret innhold, og be Codex adressere tilbakemeldinger på siden – uten å forlate appen.

I tillegg støttes nå bildegenerering via gpt-image-1.5. Det vil si at du kan generere designmockups og visuelle assets direkte i arbeidsflyten, uten å bytte til et eksternt verktøy. Praktisk hvis du jobber med frontend og vil se noe konkret raskt.

111 nye plugins – hva betyr det for deg?

Codex lanserte samtidig 111 nye plugins. Disse kombinerer ferdigheter, app-integrasjoner og MCP-servere for å utvide hva Codex kan gjøre. Blant de navngitte integrasjonene finner du Atlassian Rovo, CircleCI, CodeRabbit, GitLab Issues, Microsoft Suite og Render.

For de som bruker GitHub aktivt er det verdt å merke seg at Codex nå støtter gjennomgang av pull request-kommentarer direkte. Kombinert med SSH-tilgang til fjernservere (riktignok fortsatt i alpha) begynner dette å ligne på et utviklingsmiljø man faktisk kan tenke seg å jobbe i over tid, ikke bare ta et par raske svar fra.

Codex vs. Claude Code – er det tett nå?

Jeg har skrevet om GPT-5.3 Codex tidligere, og det er tydelig at OpenAI presser hardt for å utfordre Anthropics posisjon i kodemarkedet. ChatGPT Pro til 100 dollar ble satt opp nettopp med dette markedet i tankene.

Etter april-oppdateringen er gapet mellom Codex og Claude Code betydelig redusert på papiret. Begge tilbyr nå desktop-kontroll og langsiktige oppgaver. Hvor Codex skiller seg ut er i PR-gjennomgang og frontend-iterasjon innenfor ett arbeidsrom. Claude Code har tradisjonelt vært sterkere på bredere kunnskapsarbeid.

Hvem som er best? Det avhenger helt av hva du bruker det til. Jeg ville testet begge på min egen kodebase før jeg lot prisen alene avgjøre.

Tilgjengelighet og planer

Codex er tilgjengelig som en del av ChatGPT Pro, Team, Enterprise og Education-abonnementene. Computer use rulles ut gradvis for disse planene, og memory-funksjonen kommer gradvis til Enterprise og Education, inkludert EU og Storbritannia, men på et eget tidsskjema.

Intel Mac-støtte kom også med denne oppdateringen – noe som burde glede de som ikke har byttet til Apple Silicon ennå.

Det skjer mye på kort tid i dette markedet. Codex i april 2026 er et fundamentalt annet produkt enn det som ble lansert i februar. Og jeg mistenker at april-oppdateringen bare er begynnelsen.