Innhold Vis

Alice v1 er en 14-milliarder parameter open source videogenereringsmodell fra Mirage, lansert mai 2026 med Apache 2.0-lisens. Modellen bruker en spesiell destillasjonsteknologi kalt rCM (score-regularized consistency distillation) og hevder å produsere videoer av høyere kvalitet enn lukkede modeller som Sora og Veo – på bare 4 inferenstrinn mot de vanlige 50.

Det som gjør Alice interessant er ikke bare tallene, men hva arkitekturen faktisk gjør: den bruker Mixture-of-Experts (MoE) med totalt ~27 milliarder parametere, men aktiverer bare ~14 milliarder per steg. Det gir effektiviteten til en liten modell kombinert med kapasiteten til en stor. Genererer 5-sekunders 720p-video med 24 fps – og er tilgjengelig for alle å laste ned fra HuggingFace.

Open source videogenerering har beveget seg fort. Jeg har tidligere skrevet om LTX-2 som kongen av open source video-AI og Happy Horse fra Alibaba – og nå er Alice nok en modell som utfordrer den lukkede eliten. La meg grave litt i hva som faktisk er nytt her.

Hva er rCM-destillasjon, og hvorfor er det smart?

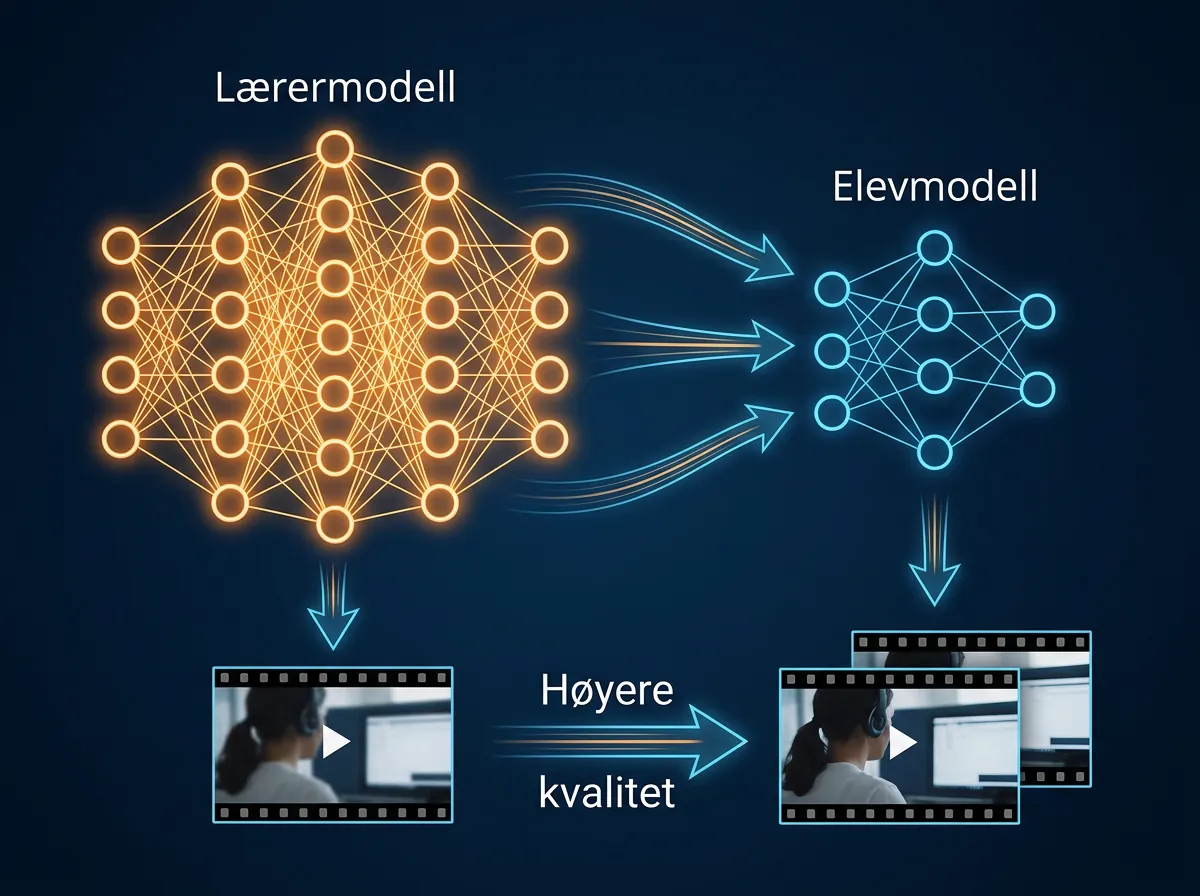

Tradisjonell destillasjon er et kompromiss: du tar en stor, treg lærermodell og trener en raskere elev-modell til å kopiere den. Resultatet er raskere, men som regel litt dårligere. Det er «prisen» du betaler for fart.

Alice gjør dette annerledes. rCM kombinerer to ting: konsistenstvanget (consistency enforcement) som sørger for at denoisingprosessen mapper til samme output uansett startpunkt, og score-regularisering som skyver modellen mot høykvalitets-output i stedet for bare å kopiere læreren. Resultatet, ifølge Mirage, er at eleven faktisk slår læreren på kvalitet.

Intuisjonen er grei: i stedet for å lære å kopiere alle mulige outputs fra læreren (inkludert middelmådige), lærer Alice å sikte mot de beste outputsene. Det er litt som å lære av en mester ved å fokusere på mesterverket, ikke gjennomsnittsproduksjonen.

Om det faktisk holder i praksis er et annet spørsmål – Mirage har ikke publisert kvantitative benchmarks med tallsammenligninger mot Sora eller Veo. Det er verdt å merke seg. «Surpasses closed-source models» er et sterkt utsagn uten konkrete tall å støtte seg på.

Mixture-of-Experts – hva betyr det for video?

MoE-arkitekturen er ikke ny i seg selv – den dukket opp i stor skala med Mixtral og er nå standard i mange store modeller. Men bruken i videogenerering er interessant fordi ulike faser av genereringen krever ulik kompetanse.

Alice bruker to spesialiserte eksperter:

- High-noise expert: Tar seg av de tidlige denoisingtrinnene der modellen bygger grovstrukturen i videoen

- Low-noise expert: Håndterer de siste trinnene der detaljer, tekstur og kantskarphet raffineres

Totalt ~27 milliarder parametere, men bare ~14 milliarder aktive per steg. Det betyr at du i teorien ikke trenger like mye VRAM som en fullstor 27B-modell ville kreve. Anbefalt hardware er en NVIDIA RTX 4090 – ikke noe du har i sekken, men heller ikke en spesialbygd datamaskin til millionkostnader.

Treningsdataen: 1 million prompts og hard example mining

Et interessant aspekt ved Alice er hvordan treningsdataen er satt sammen. Mirage har brukt GPT-4 til å generere én million diverse prompts, og deretter filtrert ut topp 30% av lærermodellens genereringer som treningsdata.

I tillegg bruker de noe de kaller «hard example mining» – en metode for å finne og over-representere vanskelige scener i treningsdataen. Konkret betyr det eksempler med kompleks fysikk, hender (notorisk vanskelig for AI), og ansikter. Forholdet mellom syntetisk og reell data er 70:30.

Den progressive treningsprotokollen er fire steg der modellen gradvis øker oppløsning fra 480p til 720p, med perceptuelle tap og DPO-justering (Direct Preference Optimization) mot slutten. Det er en solid metodikk som speiler mye av det vi ser i de beste bildegenererings-modellene overført til video.

Er Alice verdt å teste?

Det kommer an på hva du har av hardware. En RTX 4090 er minstekravet Mirage selv oppgir – det setter en tydelig grense for hvem som faktisk kan kjøre dette lokalt. De fleste hobbyister har ikke det. Men for deg som har tilgang til skytjenester som RunPod, er det mer overkommelig.

Teknisk sett ser oppsettet greit ut:

- Python 3.10 eller nyere

- CUDA 12.1 eller nyere

- PyTorch 2.4.0 eller nyere

- FP8-kvantisering støttes for å spare VRAM

- LoRA-adaptere for finjustering

- Batch-inferens fra JSON/JSONL/TXT-filer

Apache 2.0-lisensen betyr at du kan bruke dette kommersielt uten restriksjoner – det er alltid bra. Koden ligger på GitHub og modellvektene på HuggingFace.

Sammenlignet med LTX Video 2.3 som kan kjøre lokalt på mer tilgjengelig hardware, er Alice mer krevende. LTX-2 har imponert med 481 frames og 20 sekunder video på 25 minutter – det er en konkret referanse Alice må måle seg mot.

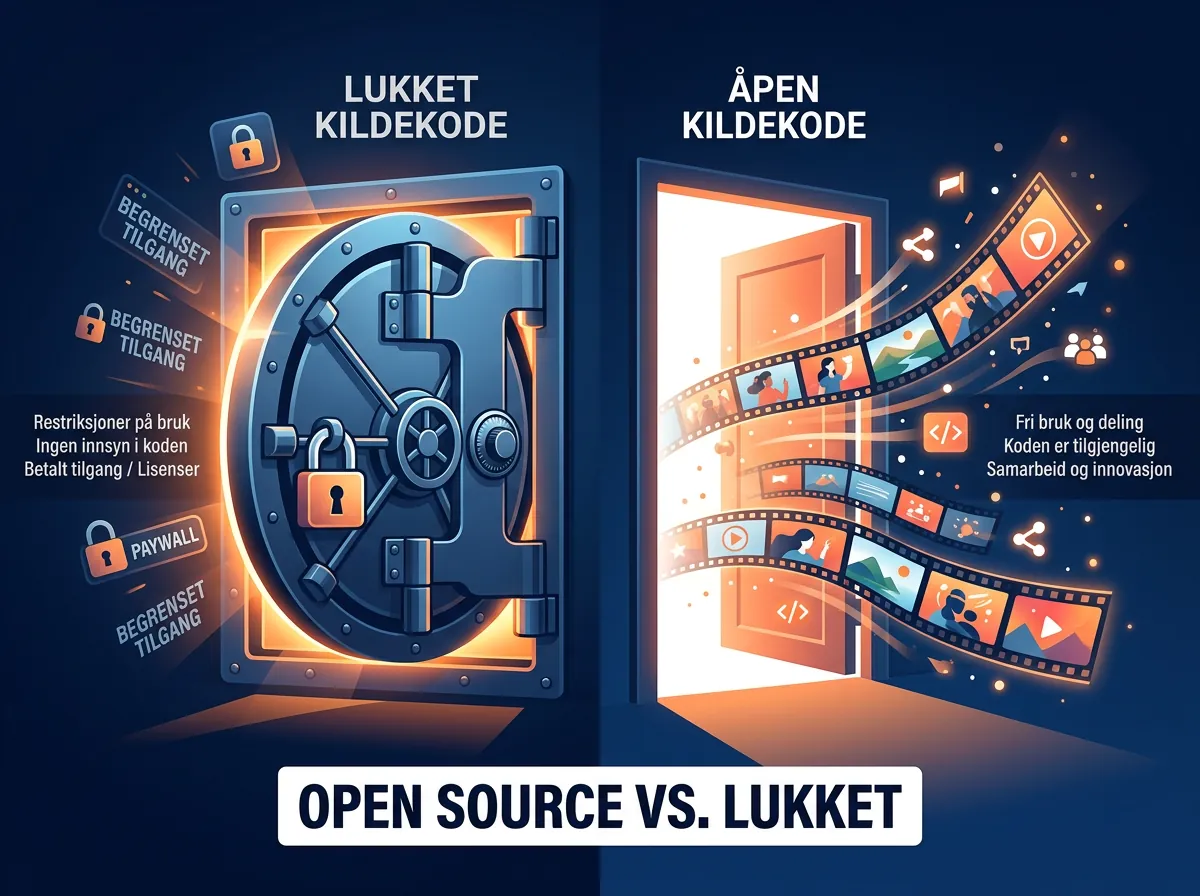

Open source vs. lukket: hva er egentlig forskjellen i 2026?

Det er noe som skjer i videogenereringsfeltet akkurat nå. For ett år siden var Sora fra OpenAI det uoppnåelige gullet – lukket, eksklusivt, dyrt. I dag har vi Alice, Happy Horse fra Alibaba, LTX-2, og flere andre open source alternativer som seriøst utfordrer den posisjonen.

Sier jeg at Alice er bedre enn Sora? Nei – ikke uten konkrete tall. Men det at modeller av denne kaliber nå er tilgjengelige med Apache 2.0, det forteller noe om retningen bransjen beveger seg.

Open source-miljøet rundt videogenerering er genuint spennende akkurat nå. Mirage er ikke noe gigantselskap – dette er forskning og utvikling som skjer i åpne fora, med modeller alle kan bygge videre på. Det er en helt annen dynamikk enn å betale et abonnement og håpe på at leverandøren er tilgjengelig.

Jeg skal holde et øye med Alice fremover. Når community-tester og sammenligninger dukker opp på Reddit og HuggingFace, vil vi få et klarere bilde av om rCM-destillasjonen faktisk leverer på løftet. Foreløpig er det et lovende paper og en tilgjengelig modell – og det er et godt sted å starte.