Innhold Vis

I dag handler ikke konflikten mellom Anthropic og Pentagon bare om én kontrakt. Den handler om geopolitikk: hvordan liberale demokratier skal møte autoritære stater i et AI-kappløp, uten å kopiere deres styringsmodell. Fristen som ble satt av Pentagon er 17:01 ET, og Anthropic har offentlig sagt at de ikke vil gi blankofullmakt til bruk av Claude i alt militæret definerer som «lovlig».

Jeg mener dette er kjernen: I Kina er AI-utvikling tett koblet til statlige prioriteringer, med lavere terskel for statlig styring og bruk enn i åpne samfunn — noe vi blant annet ser i de nasjonale rammene for generativ AI fra kinesiske myndigheter, oppsummert av Library of Congress. Det er ikke en konspirasjonspåstand, men en politisk realitet vi må ta inn over oss når vi diskuterer beredskap. Da holder det ikke å si «mindre stat» i alle setninger; vi må også spørre hvordan et fritt samfunn bygger troverdig avskrekking.

Pentagon-fristen handler om to helt konkrete røde linjer

Det sentrale her er ikke PR, men vilkår. Ifølge dekningen hos CNBC og TechCrunch har Anthropic holdt fast ved to grenser: ingen masseovervåking av amerikanere, og ingen fullt autonome våpensystemer uten mennesker i løkken.

Det er også i tråd med linjen vi allerede har sett i denne føljetongen, blant annet da Anthropic-ledelsen ble kalt inn til Pentagon og da fristen ble satt offentlig. Jeg mener Anthropic har et legitimt poeng her: Hvis du først har sagt at sikkerhet er kjernen i produktet, kan du ikke skru av det når presset blir stort.

Pentagons argument er likevel enkelt å forstå: De vil ikke at en privat leverandør skal detaljstyre operativ bruk av teknologi som de betaler for. Dette er den reelle kollisjonen: produktetisk kontroll hos leverandøren mot statlig kontroll hos kunden.

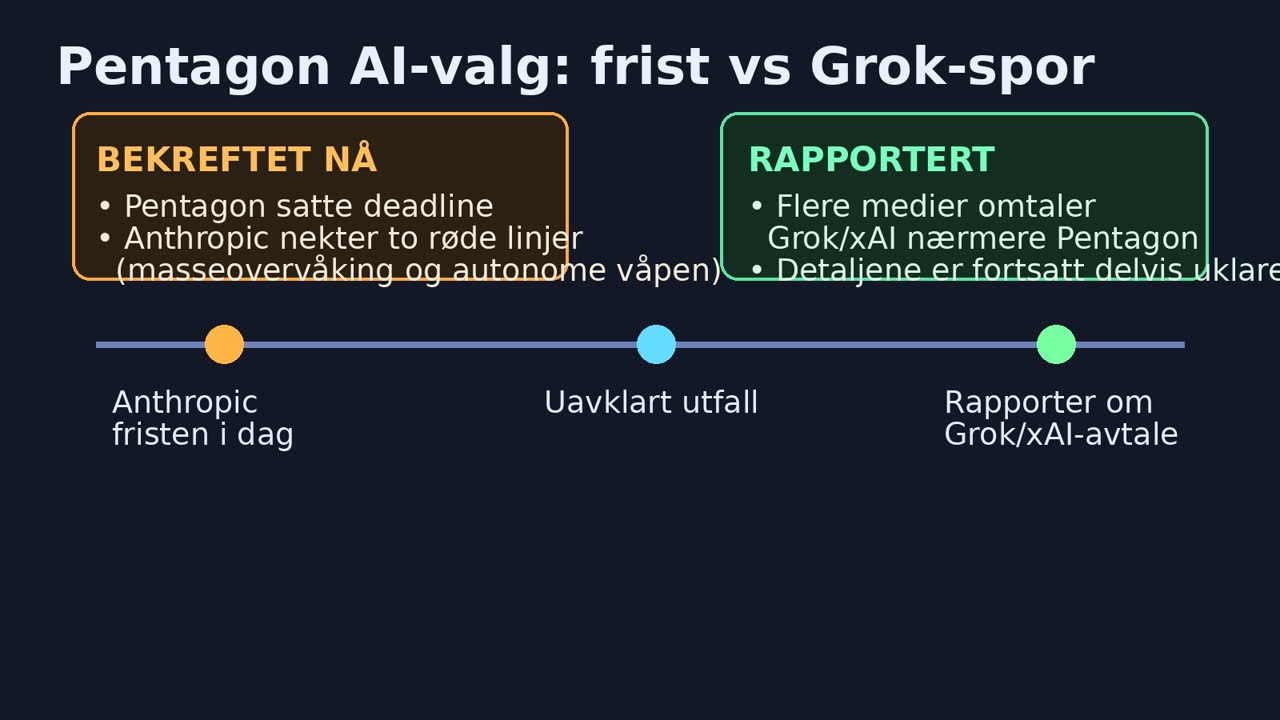

Hva vet vi egentlig om Grok/xAI-avtalen?

Her må vi skille mellom bekreftet og rapportert. At xAI er på vei inn i forsvarsøkosystemet er i seg selv ikke nytt: War Department har allerede annonsert utvidelse av GenAI.mil med Grok-familien.

Det nye nå er rapportene om bredere og mer sensitiv bruk, blant annet omtalt av Axios. Akkurat de detaljene er ikke fullt dokumentert i åpne, offisielle kontraktstekster enda, så her er det viktig å være presis: signalene peker i retning av en styrket rolle for xAI, men omfanget er fortsatt delvis uavklart.

For meg er dette det strategiske poenget: Når én modellleverandør holder hardt på sikkerhetsbegrensninger, får mer fleksible aktører et konkurransefortrinn i forsvarsmarkedet. Vi ser konturene av et nytt markedsskille i AI: «policy-strenge» modeller vs. «operativt fleksible» modeller.

Min vurdering: Dette er en geopolitisk stresstest, ikke bare et policy-drama

Jeg tror ikke dette stopper med Anthropic. Vi kommer til å se samme konflikt hos flere leverandører, i flere land. Og vi har allerede sett hvordan Pentagon-sporet har eskalert raskt, fra trusler om full utfasing til dagens fristdrama.

Poenget mitt er at vi må klare to tanker samtidig: Jeg er kritisk til for stor statsmakt hjemme, men jeg er også kritisk til naivitet om maktpolitikk ute. Når kinesisk AI i større grad er integrert med statlige mål, må vestlige demokratier ha beredskap som faktisk virker — ellers outsourcer vi sikkerheten vår til aktører med helt andre verdier.

Liberalistisk dilemma: mindre stat, sterkere beredskap

For meg betyr klassisk liberalisme ikke «svak stat uansett», men «begrenset stat med tydelig mandat». Staten skal ikke detaljstyre alt i fredstid. Men den skal kunne beskytte borgere, infrastruktur og institusjoner når presset øker. I AI-politikken betyr det smale, kontrollerbare virkemidler: klare anskaffelseskrav, demokratisk kontroll og realistisk avskrekking mot autoritære motstandere.

Derfor er min linje enkel: minst mulig unødvendig statsmakt i hverdagen, men null romantisering av geopolitiske realiteter. Frihet uten sikkerhet er sårbarhet. Sikkerhet uten frihet er noe annet enn det samfunnet jeg ønsker å forsvare.

FAKTABOKS

Bekreftet nå: Pentagon har satt en hard frist i dag for Anthropic. Anthropic har offentlig fastholdt to røde linjer (masseovervåking av amerikanere og fullt autonome våpen uten menneskelig kontroll). War Department har tidligere bekreftet at Grok/xAI skal inn i GenAI.mil-plattformen.

Geopolitisk ramme: I Kina er AI-feltet tett koblet til statlige prioriteringer og reguleringer, noe som i praksis gir lavere terskel for statlig styring og bruk enn i vestlige liberale demokratier. Det skjerper presset på USA og Europa til å velge mellom hastighet, kontroll og prinsipper.

Liberalistisk vurdering: Jeg ønsker mindre statlig detaljstyring i hverdagen, men samtidig sterk nok beredskap til å avskrekke autoritære motstandere. Målet er ikke maksimal stat, men en begrenset stat som fortsatt er kapabel.

Uavklart: Om Anthropic faktisk blir formelt «offboardet» i kveld, og nøyaktig hvor bred/klassifisert Grok-bruken blir utover det som allerede er annonsert offentlig.