Innhold Vis

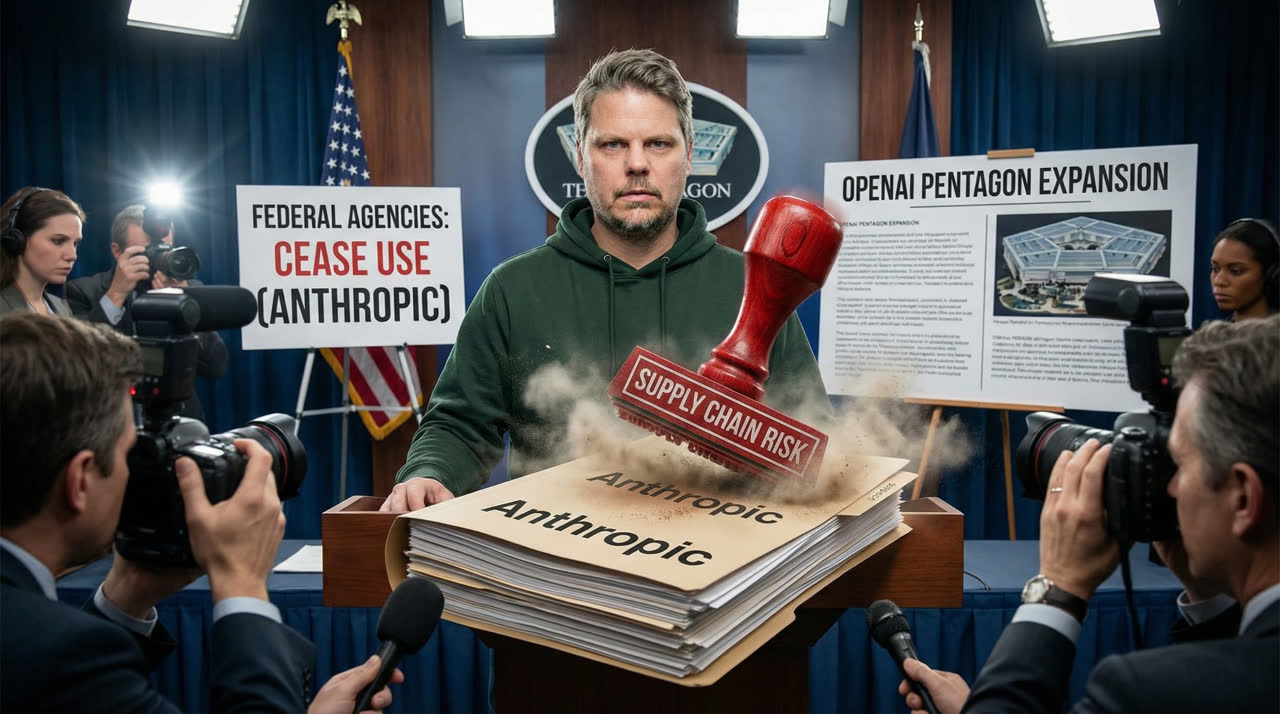

Pentagon/Anthropic-saken har eskalert igjen. Dette startet som en hard politisk dragkamp om vilkår for militær bruk av AI, men har nå gått over i konkrete ordre som påvirker hvilke modeller som faktisk får operere i amerikanske etater. Vi er med andre ord forbi «høyt konfliktnivå» og inne i en fase der makt flyttes i praksis.

Siden sist har konflikten gått fra møter og varsler til tydeligere institusjonelle grep. Jeg har tidligere dekket både møtet mellom Hegseth og Amodei og trusselen om å kutte Anthropic fra forsvarskontrakter. Nå rapporteres det at presset er blitt operativt: etater blir bedt om å stoppe bruken av Anthropics teknologi.

Hvorfor er dette viktig? Fordi denne saken i praksis avgjør hvem som setter standarden for AI i nasjonal sikkerhet de neste årene: ikke bare teknisk, men også juridisk og etisk. Når én leverandør presses ut, åpnes det et rom som andre aktører kan fylle raskt — med langvarige konsekvenser for både markedet og styringsmodellen.

Det er i dette vakuumet OpenAI-signalet kommer. Reuters melder at OpenAI har nådd en avtale om utrulling i klassifisert nettverk. Det er en betydelig utvikling, men vi må fortsatt skille mellom reell styrking og full overtakelse.

Status i Pentagon/Anthropic nå

Det bekreftede nå er at Anthropic er i en direkte konflikt med amerikanske myndigheter om rammer for militær bruk av modellen deres, samtidig som selskapet omtales som risiko i leverandørkjeden. AP rapporterer (via WRAL) at Trump-administrasjonen har beordret etater til å stoppe bruk av Anthropics teknologi: WRAL/AP.

Dette er et markant skifte fra forrige runde, der saken først og fremst ble oppfattet som en offentlig maktkamp. Når etater får operative føringer, er vi ikke lenger i «forhandling via medieutspill». Da påvirkes faktisk innkjøp, utrulling og prioriteringer i systemene.

For markedet betyr det at leverandørbildet kan endre seg fort. For statlige miljøer betyr det at valgene blir mer politiserte. Og for oss som følger AI-feltet, betyr det at vi må lese kontraktssporene like nøye som retorikken.

Hvorfor dette er en eskalering — ikke bare støy

Vi har nå en tydeligere kjede av hendelser: Først en eksisterende konflikt om vilkår, så offentlig press mot Anthropic, og deretter rapporterte styringsgrep i etatene. Dette er ikke enkeltstående nyhetsdrypp; det er en utvikling der terskelen flyttes steg for steg.

Juni 2025: OpenAI får en stor DoD-kontrakt (opp til 200 millioner dollar) for prototyping og AI-bruk i nasjonale sikkerhetsdomener, ifølge CNBCs dekning av DoD-kunngjøringen: CNBC.

Uken før nåværende opptrapping: Konflikten mellom Pentagon og Anthropic eskalerer ytterligere, med tydeligere signaler om at leverandørforhold kan brytes dersom vilkårene ikke aksepteres.

Fredag 28. februar 2026: AP/WRAL melder om stoppordre mot Anthropic, og kort tid etter kommer meldingen om OpenAI i klassifiserte nettverk. Tidsnærheten alene beviser ikke årsak, men den viser at maktbalansen er i bevegelse akkurat nå.

Hva OpenAI-signalene faktisk betyr

Det er fristende å lese dette som at OpenAI «vant alt» over natta. Det er en forenkling. Det bekreftede er at OpenAI både har hatt en stor DoD-kontrakt fra før og nå ser ut til å ha fått en tydeligere posisjon i klassifiserte omgivelser. Men vi har ikke offentlig dokumentasjon på at OpenAI har fått eksklusivitet eller at de har overtatt hele Anthropics tidligere leveranseomfang.

TechCrunchs dekning av konflikten viser også at presset ikke bare handler om én leverandør, men om hvilke rammer som skal gjelde for hele bransjen – spesielt rundt masseovervåking og autonome våpensystemer. I den forstand er dette like mye en styringskamp som en kontraktskamp.

Og her er det viktig å holde hodet kaldt: forhandlinger, politiske utspill og endelige kontraktsvilkår er tre forskjellige ting. Markedet reagerer ofte på overskrifter lenge før de juridiske detaljene er på plass.

Regelverket i bunn: hva DoD faktisk sier om autonomi og ansvar

Det amerikanske forsvarsdepartementet viser selv til at autonome og semi-autonome våpensystemer skal utformes slik at mennesker utøver «appropriate levels of human judgment over the use of force». Dette står i oppdateringen av direktiv 3000.09, publisert av departementet: DoD Release om 3000.09.

Samme release kobler også dette til DoDs Responsible AI-rammeverk. CDAO/ai.mil beskriver RAI som en modell for sikkerhet, ansvarlighet og etisk bruk i hele livsløpet: Responsible AI Strategy and Implementation Pathway.

Poenget: når OpenAI sier at avtalen bygger på forbud mot innenlandsk masseovervåking og menneskelig ansvar ved bruk av makt, finnes det allerede et policy-anker i DoDs egne dokumenter. Men hvordan dette håndheves i praksis, avgjøres i kontrakter, etterlevelse og tilsyn – ikke bare i pressemeldinger.

Status nå: hva vi vet, hva vi tror, hva vi ikke vet

Bekreftet nå

- OpenAI fikk i 2025 en DoD-kontrakt på opptil 200 millioner dollar (rapportert av CNBC med henvisning til DoD-kunngjøring).

- AP og Reuters rapporterer at OpenAI nå har meldt avtale om bruk i klassifiserte forsvarsnettverk.

- DoD-direktiv 3000.09 og RAI-rammeverket legger vekt på menneskelig kontroll og ansvarlighet i bruk av autonome systemer.

Sannsynlig

- OpenAI får en mer sentral operativ rolle på kort sikt når Anthropic fases ut av deler av statlig bruk.

- Pentagon bruker leverandørkonkurransen aktivt for å presse frem bredere tilgang til modeller under «lovlig bruk»-språk.

Ubekreftet

- At OpenAI har fått eksklusiv kontroll over klassifisert AI-bruk i hele forsvarsapparatet.

- At OpenAI-avtalen er identisk med vilkårene Anthropic avviste, punkt for punkt.

- At dette er en permanent maktforskyvning; mye kan fortsatt endres gjennom rettssaker, nye anbud og politiske vedtak.

Min vurdering akkurat nå: dette er en reell maktforskyvning i OpenAIs favør, men narrativet om «endelig avgjort» er for tidlig. Vi ser konturene av en ny forsvarsarkitektur for AI – ikke det ferdige kartet.