Innhold Vis

FastVideo-teamet har klart det mange trodde var år unna: å generere og live-redigere 30 sekunders 1080p-video med bare 4,5 sekunders forsinkelse. Prosjektet heter Dreamverse, og det er bygget på LTX-2 – den open source-videomotoren fra Lightricks.

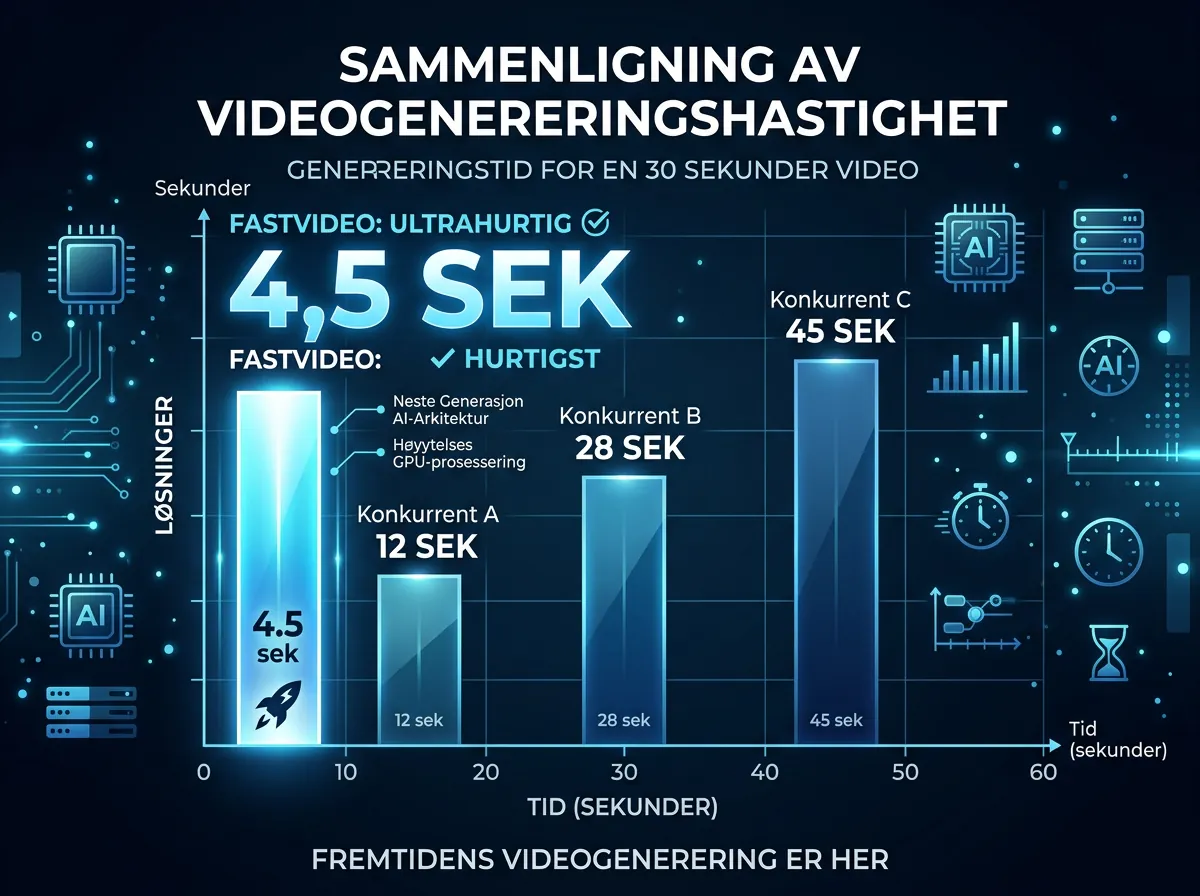

Ideen er enkel å forstå, men sinnssyk å se i praksis: du endrer prompten, og videoen endres i nær sanntid. 4,5 sekunder for å generere 30 sekunder med video. Det vil si at systemet genererer raskere enn du kan se ferdig det det allerede har lagd.

Hao AI Lab ved UC San Diego publiserte nylig resultater som viser en 3,9x forbedring i latensy sammenlignet med nest raskeste alternativ. Og dette er open source – ikke en betalingstjeneste, ikke et lukket API.

Hva er FastVideo og LTX-2?

FastVideo er et åpent rammeverk for akselerert videogenerering, utviklet av Hao AI Lab ved UC San Diego. Apache 2.0-lisens. 55+ bidragsytere. Over 3 200 GitHub-stjerner.

LTX-2 er basismodellen de bygger på – produsert av Lightricks, tilgjengelig på HuggingFace. Den støtter oppløsninger opptil 4K ved 50 bilder per sekund, med synkronisert lyd. For sammenligning: WAN 2.2 14B på H100-servere er omtrent 18 ganger tregere.

Kombinasjonen av disse to – FastVideo-rammeverket på toppen av LTX-2 – er det som gjør live-editing mulig. Jeg har tidligere skrevet om LTX Video 2 som en praktisk modell for lokal videogenerering og hvorfor LTX-2 skiller seg ut blant open source-videomodeller. FastVideo tar det videre.

Hva er 4,5 sekunders latensy egentlig verdt?

La meg si det på en annen måte. Før dette var real-time video-generering et tankeeksperiment. Du genererte et klipp, ventet, justerte prompten, ventet igjen. Arbeidsflyten var sekvensiell. Nå er den interaktiv.

FastVideo oppnår 4,55 sekunder end-to-end for en 5-sekunders 1080p-video. Ifølge Hao AI Lab er dette en 3,9x forbedring over nest raskeste system. De kjeder deretter disse 5-sekunders klippene til en sammenhengende 30-sekunders scene – og gjør det slik at du kan endre hva som skjer ved å justere prompten underveis.

Det er ikke streaming i tradisjonell forstand. Det er noe nærmere sanntids-iterasjon. Du «vibe-director» videoen – endrer stemning, handling eller miljø – og systemet genererer om.

Teknisk er det bygget på tre pillarer:

- Optimaliserte attention-kernels for NVIDIAs SM100/SM103-arkitektur (Blackwell)

- NVFP4-kvantisering – lavere presisjon uten merkbar kvalitetsforringelse

- Kernel fusion – samler prompt-encoding, latent-forberedelse, denoising og dekoding i én strømlinje

Live-demoen kjøres på halvparten av en GB200 NVL72, altså 36 GPU-er med lastbalansering. Ikke noe du setter opp på en RTX 4090 hjemme – ennå. Men koden er åpen, og optimaliseringene er planlagt sammenslått til hovedgrenen.

Kan du prøve det selv?

Dreamverse-demoen på dreamverse.fastvideo.org er offentlig tilgjengelig. Der kan du teste live-editing selv – skriv en prompt, se videoen, endre prompten, se oppdateringen.

For de som vil grave i koden: FastVideo GitHub-repoet inneholder hele rammeverket. Apache 2.0 betyr full kommersiell bruk, ingen begrensninger.

Hva betyr dette for video-AI fremover?

Det interessante er ikke bare hastigheten – det er hva hastigheten muliggjør. Når latensy faller under et visst terskelnivå, endres hele interaksjonsmodellen. Det er den samme dynamikken vi så da LLM-er ble raske nok til å gi streaming token-for-token: plutselig ble samtalen naturlig.

For video betyr det at vi beveger oss fra «generer og vent» til «iterer i sanntid». Det åpner for brukstilfeller som er vanskelige å forestille seg i dag – interaktiv storytelling, live visualisering, videospill-grafikk generert on-the-fly.

LTX-2.3 er notorisk rask allerede. FastVideo tar det et stort steg videre. Og siden alt er åpen kildekode under Apache 2.0-lisens, er det bare et spørsmål om tid før noen kjører dette på forbruker-hardware.

Enn så lenge finnes demoen. Det er nok til å se retningen tydelig.

Les komplett oversikt: Lage video med AI – komplett guide (2026).

1 kommentar