Innhold Vis

Nvidia lanserte AI-Q på GTC 2026 – et open source blueprint for å bygge dype forskningsagenter som topper DeepResearch Bench-rangeringene. Agenten kombinerer frontmodeller for orkestrasjon med den fintunte Nemotron 3 Super (120 milliarder parametere) for research-sub-agenter, og kutter søkekostnadene med over 50 prosent sammenlignet med rene frontier-oppsett.

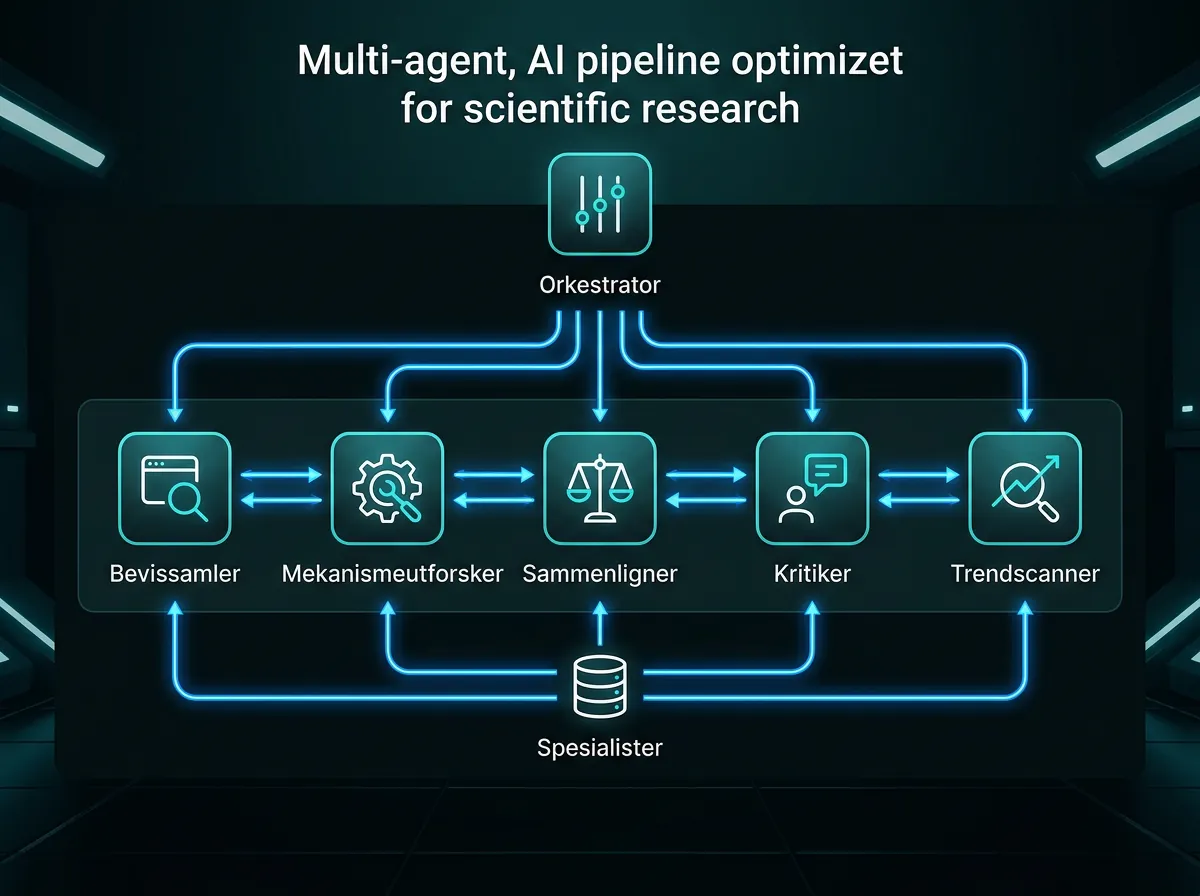

Det er ikke bare enda en chatbot med websøk. AI-Q er en multi-agent pipeline der fem spesialister jobber parallelt – en som samler bevis, en som utforsker mekanismer, en som sammenligner data, en som ser etter motargumenter, og en som scanner nye trender. Resultatet er forskningsrapporter med kildehenvisninger, ikke bare oppsummeringer.

Hva er egentlig nytt her, og hva betyr det for folk som bruker AI til research? La meg gå gjennom det.

Hva er Nvidia AI-Q og hvordan fungerer det?

AI-Q er Nvidias open source blueprint for det de kaller «deep research agents» – agenter som ikke bare søker, men som resonnerer over data, syntetiserer funn og produserer velkildesatte svar. Blueprintet er distribuert via GitHub og LangChain, og bygger på NVIDIA Agent Toolkit-stacken som ble presentert på GTC 2026.

Arkitekturen er delt i tre lag. En orkestrator koordinerer hele flyten. En planner kartlegger informasjonslandskapet og designer research-planen. Så sender en researcher-komponent ut fem parallelle spesialister som jobber uavhengig: Evidence Gatherer, Mechanism Explorer, Comparator, Critic og Horizon Scanner. Hver har sin rolle – ingen er generalister.

Under panseret bruker den Nemotron 3 Super som fintunet sub-agent, med Tavily for websøk og Serper for akademiske papirer. Hele oppsettet er konfigurerbart via YAML – du kan bytte modeller, legge til egne datakilder og justere agent-atferd uten å omskrive kode. Det er distribuert som open source på GitHub.

Topper DeepResearch Bench – hva betyr det?

AI-Q nådde førsteplassen på begge de primære benchmarkene for deep research agents: DeepResearch Bench (55,95) og DeepResearch Bench II (54,50). Ifølge Nvidias tekniske gjennomgang på Hugging Face bruker DeepResearch Bench II over 70 detaljerte binære kriterier per oppgave – den sjekker om agenten henter riktig informasjon, om den syntetiserer til høyere nivå-analyse, og om den presenterer funnene tydelig.

Det er strengere enn de fleste AI-benchmarks. Og AI-Q slo alle andre systemer – inkludert de som bare bruker frontier-modeller fra OpenAI og Anthropic direkte. Det interessante er at den gjør det til halvparten av kostnaden, takket være hybrid-tilnærmingen med fintunet Nemotron 3 Super for sub-agent-oppgavene.

Nemotron 3 Super ble trenet på rundt 80 000 trajektorier hentet fra akademiske datasett (OpenScholar, ResearchQA) med ekte websøkresultater inkludert. Treningen tok 25 timer på 128 NVIDIA H100-er. Det er ikke et lite prosjekt.

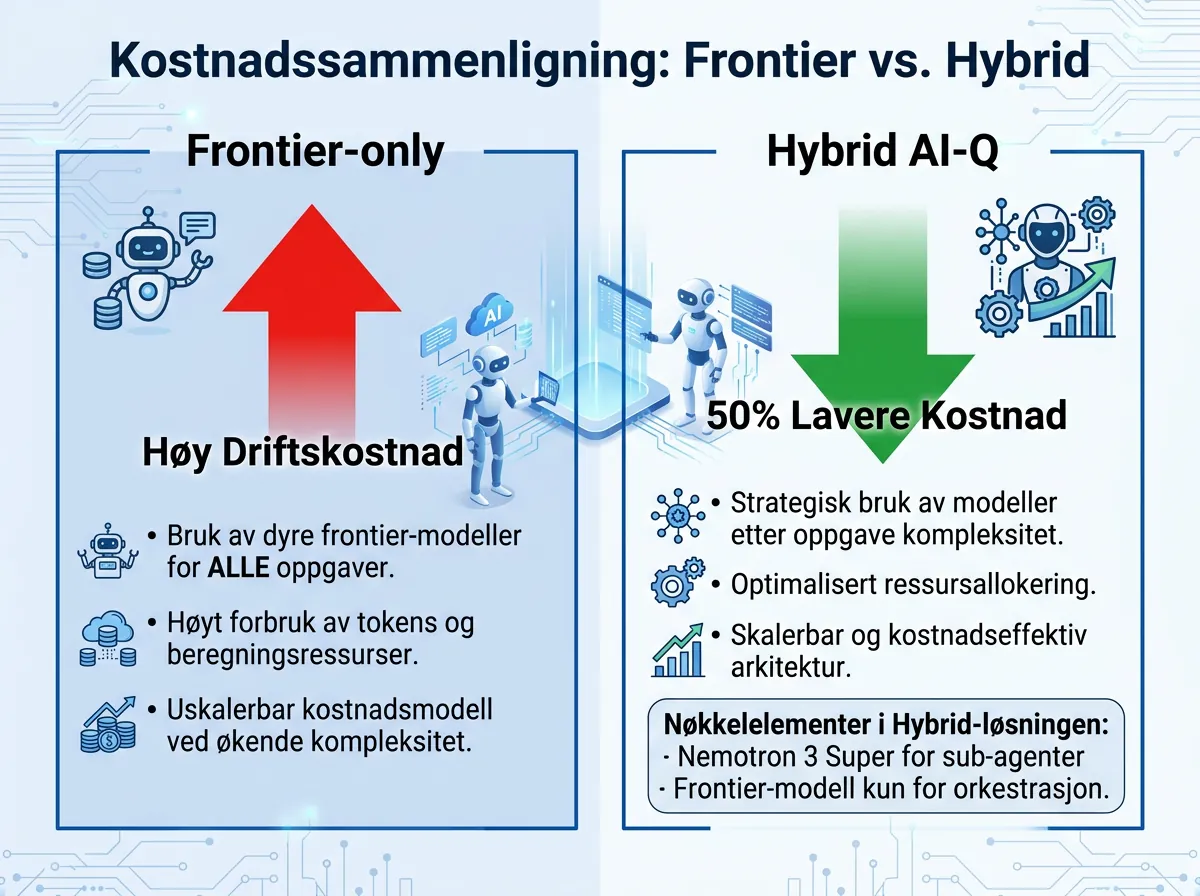

50% billigere enn frontier-only – slik fungerer hybrid-modellen

Hybrid-modellen er her grunnen til at dette er interessant utover bare benchmarktall. I stedet for å sende alle spørsmål til GPT-4o eller Claude Opus, bruker AI-Q frontier-modellen kun for orkestrasjon – den strategiske planleggingen. De faktiske research-sub-agentene kjøres på Nemotron 3 Super, som er en åpen modell du kan hoste selv eller kjøre via CoreWeave, Fireworks og Together AI.

Ifølge Nvidias offisielle pressemelding er resultatet sammenlignbar nøyaktighet med frontier-only, til rundt halvparten av kostnaden. Jeg har skrevet om lignende tilnærminger tidligere – i artikkelen min om å kutte AI-agent-kostnader med 80 prosent er model tiering akkurat dette prinsippet. AI-Q er en konkret implementasjon av det.

Hva med NemoClaw og resten av Agent Toolkit?

AI-Q er ikke et frittstående produkt – det er del av Nvidias bredere Agent Toolkit, som ble annonsert på GTC 2026. Toolkit-en inneholder tre komponenter:

- NemoClaw – sikker agent-runtime med prosess-isolering, least-privilege tilgangskontroll og en privacy router som fjerner persondata fra prompts før de sendes til eksterne API-er

- AI-Q – open research agent blueprint

- Nemotron-modellene – open source LLM-familien som driver sub-agentene

NemoClaw-sikkerhets-laget er verdt å merke seg. Privacy routeren bygger på teknologi fra Gretel, som Nvidia kjøpte opp, og stripper PII fra prompts automatisk. Det er den typen infrastruktur som gjør at større organisasjoner faktisk kan ta i bruk agenter mot interne datasystemer uten å sende sensitiv data til OpenAI.

Edison Scientific og Kosmos – agenter i faktisk bruk

Det mest konkrete eksemplet på AI-Q i praksis er Edison Scientific sitt Kosmos-system. Ifølge Nvidias pressemateriale er Kosmos en autonom AI-forsker som brukes av over 50 000 forskere, og som kjører hundrevis av research-oppgaver parallelt. Systemet komprimerer måneder med forskning til én dag.

Det er store tall og de er vanskelige å verifisere uavhengig. Men konseptet er klart: en agent som ikke hjelper forskere med å søke, men som faktisk utfører research-sykluser autonomt – definerer spørsmål, søker litteratur, syntetiserer funn, identifiserer hull og foreslår neste steg. AI-Q er blueprintet for å bygge akkurat dette.

Praktisk tilgang – hvem kan bruke AI-Q?

Blueprintet er tilgjengelig på GitHub og via build.nvidia.com. Du trenger ikke Nvidia-hardware for å kjøre det – AI-Q er designet for å fungere med ulike inference-leverandører inkludert CoreWeave, Fireworks og Together AI.

Det krever litt teknisk kompetanse å sette opp. YAML-konfigurasjon, LangChain-integrasjon og API-nøkler til søketjenestene (Tavily og Serper) er minimumskravene. Men det er ikke et prosjekt for absolutte nybegynnere – det er et rammeverk for utviklere og organisasjoner som vil bygge egne research-pipelines.

For deg som ikke vil sette opp hele stacken selv, er det verdt å følge med på om noen av de eksisterende AI-verktøyene du allerede bruker integrerer AI-Q. LangChain er allerede en del av distribusjonskanalen, og det betyr at integrasjoner vil komme relativt fort.

Konkurransen innen deep research agents er nå real. Perplexity, OpenAI og Anthropic har alle lignende produkter, men ingen av dem er open source og konfigurerbare på denne måten. Det er Nvidias trumfkort her – ikke bare ytelse, men eierskapet du får over hele pipelinen.

Les komplett oversikt: Nvidia og AI – komplett guide (2026).