Innhold Vis

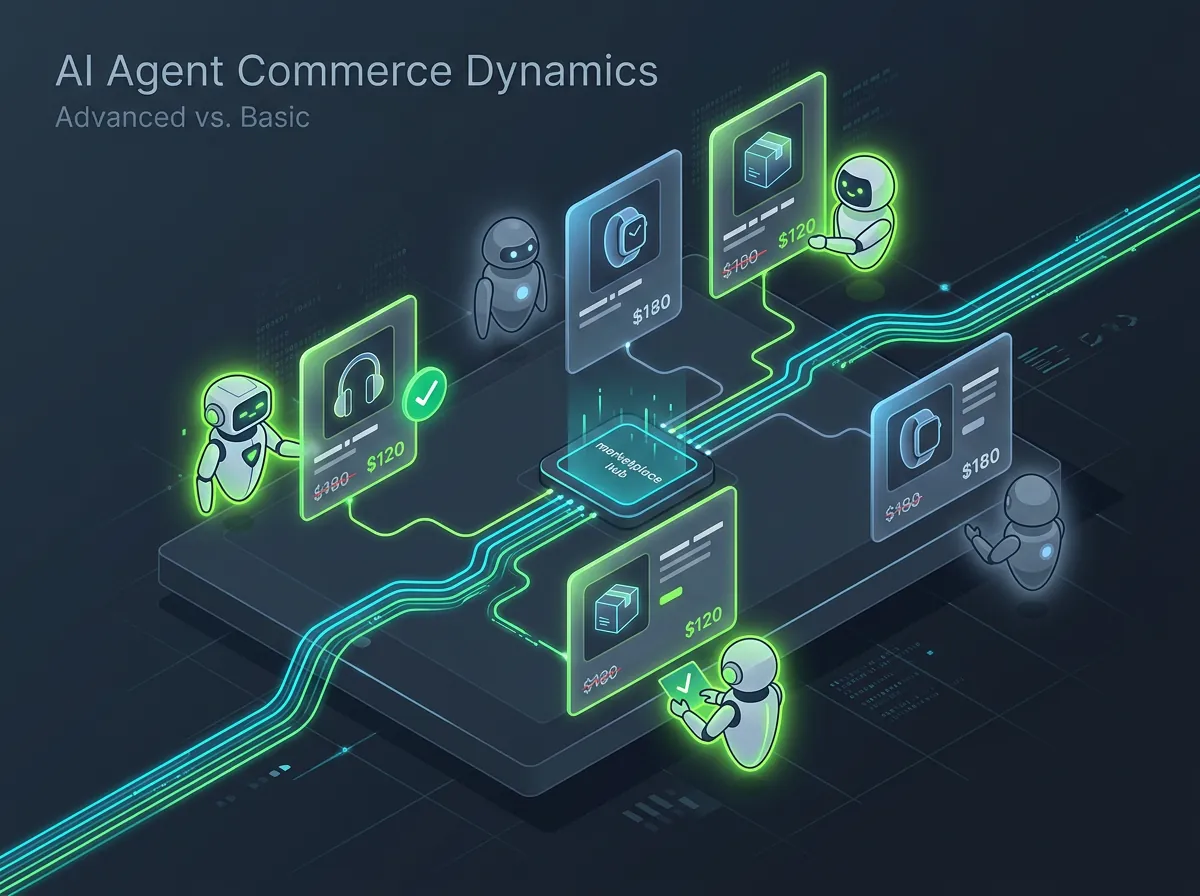

Anthropic gjennomførte nylig et eksperiment kalt «Project Deal» – en lukket markedsplass der AI-agenter forhandlet og gjennomførte ekte kjøp på vegne av ekte mennesker, med ekte penger. Ikke simulerte transaksjoner, ikke leke-dollar. 69 Anthropic-ansatte fikk 100 dollar hver i gavekort og lot AI-agenter representere dem som kjøpere og selgere. Resultatet: 186 handler til en samlet verdi på over 4 000 dollar.

Dette er ikke science fiction. Det er en proof-of-concept for noe som kan bli hverdagen ganske raskt. Agent-til-agent handel er allerede teknisk mulig – det Anthropic gjorde var å teste hva som faktisk skjer når det settes i system.

Det mest interessante funnet handler ikke om hva agentene kjøpte og solgte, men om hvem som vant – og om de som tapte, visste om det.

Hva er Project Deal?

Anthropic satte opp fire separate markedsplasser med ulike modeller som representerte deltakerne. I den «ekte» versjonen ble alle representert av Anthropics mest avanserte modell, og alle avtaler ble faktisk gjennomført etterpå. Det var ikke et sandkasse-eksperiment – det som ble forhandlet frem, ble levert.

Rammen ligner på en klassifisert markedsplass (tenk Craigslist internt i et firma): ansatte listet opp ting de ville selge eller tilbydde tjenester, og agentene forhandlet på vegne av partene. Med 69 deltakere og 100 dollar per person la eksperimentet til rette for 6 900 dollar i potensiell kjøpekraft. Litt over halvparten av det ble faktisk brukt – 186 handler, over 4 000 dollar.

Det er ikke et enormt tall, men det er heller ikke poenget. Poenget er at det fungerte. Agentene forhandlet frem avtaler. Avtalene ble holdt. Ingen menneskelig megler var nødvendig underveis.

Hva skjer når én AI er bedre enn en annen?

Her er funnet som virkelig er verdt å stoppe opp ved: når en bruker ble representert av en mer avansert AI-modell, fikk de objektivt bedre resultater. De fikk bedre priser, bedre avtaler, mer gunstige vilkår.

Men her er det interessante – de visste det ikke selv.

Anthropic beskriver dette som potensielle «agent quality gaps» – situasjoner der taperne i en forhandling ikke innser at de tapte fordi de hadde en svakere representant. Det er en litt ubehagelig tanke. Hvis jeg lar en AI forhandle for meg, og den andre parten har en bedre AI, kan jeg ende opp med en dårligere deal uten å ha noen mulighet til å vurdere det.

Dette minner om noe vi allerede ser i finansmarkedene, der algoritmisk handel har gjort at vanlige investorer strukturelt sett konkurrerer mot systemer designet for å vinne. Agent-til-agent handel kan skape lignende asymmetrier i hverdagslige transaksjoner.

Instruksjoner hadde nesten ingen effekt – og det er rart

Et annet funn som stikker seg ut: de innledende instruksjonene deltakerne ga sine agenter påvirket verken sannsynligheten for salg eller de forhandlede prisene. Uansett om du ba agenten din om å være aggressiv, forsiktig, vennlig eller kjølig – det spilte lite rolle for utfallet.

Det kan tolkes på to måter. Enten er moderne store språkmodeller så godt kalibrerte at de allerede optimaliserer for gode utfall uavhengig av instruksjoner. Eller – og dette er den mer urovekkende tolkningen – instruksjoner fra brukere har begrenset innflytelse på hva agenter faktisk gjør når de opererer autonomt.

Begge tolkningene har store implikasjoner. I det første tilfellet er det en gladmelding: agentene er kompetente. I det andre tilfellet oppstår et klassisk kontrollproblem: hvem styrer egentlig agenten?

Fra eksperiment til virkelighet – hva betyr dette?

Project Deal er ikke et produkt. Det er en kartlegging av hva som skjer. Men det peker i en tydelig retning: Anthropic – og resten av bransjen – ser for seg en fremtid der AI-agenter ikke bare assisterer mennesker, men handler på vegne av dem i digitale markeder.

Anthropic har allerede lagt grunnlaget med Claude Managed Agents – ferdig infrastruktur for agenter som kan kjøre autonomt i skyen. Project Deal er neste steg: hva skjer når disse agentene møter andre agenter i en markedssituasjon?

Det er også verdt å se dette i sammenheng med Anthropics bredere strategi. Som jeg har skrevet om tidligere, angriper Anthropic SaaS-markedet direkte – og et funksjonelt agent-til-agent handelssystem ville være et kraftig argument for å bruke Claude-plattformen fremfor konkurrentene.

For vanlige folk og bedrifter er spørsmålet: når du bruker en AI-agent til å forhandle, kjøpe eller selge på dine vegne – hvem tjener egentlig på det? Og har du noen måte å vite om agenten din er god nok til å vinne mot motparten?

Hva dette faktisk er

Project Deal er et selskaps interne eksperiment med 69 frivillige ansatte. Det er ikke representativt for et åpent marked, og funnene er fra en «self-selected participant pool» – Anthropics egne ord. Det er en pilot, ikke en konklusjon.

Men det er likevel et gjennombrudd av en type: agent-til-agent handel med ekte penger fungerer i kontrollerte omgivelser. 186 handler ble gjennomført. Pengene ble brukt. Varene og tjenestene ble levert.

Neste spørsmål er ikke lenger om dette er mulig. Det er hvem som bygger det videre – og på hvilke premisser.

Hva tenker du? Er dette noe du ville brukt, eller er tanken på å la en AI forhandle for deg ubehagelig? Jeg er genuint nysgjerrig på hvor folk er i dette.