Innhold Vis

GDPR og AI i bedriften er enklere enn du tror. De fleste norske virksomheter bruker allerede AI-verktøy – og mange gjør det uten å tenke to ganger på personvern. Det er ikke nødvendigvis feil. Men det finnes noen helt konkrete ting du bør ha på plass for å sove godt om natten.

Denne guiden er ikke skrevet av en jurist, og det er ikke en liste med skummende advarsler. Det er en praktisk oversikt over hva GDPR faktisk krever av deg når du bruker AI i jobbsammenheng – og hva du rolig kan ignorere. Spoiler: det er mye av det juridiske støyet der ute som gjelder store selskaper og spesielle bransjer, ikke en vanlig norsk SMB som bruker ChatGPT til markedsføringstekster.

Jeg har gått gjennom regelverket, lest Datatilsynets egne veiledninger, og prøvd å destillere det ned til hva som faktisk betyr noe i praksis. La oss ta det systematisk.

Hva sier GDPR egentlig om AI?

GDPR ble vedtatt i 2018 – lenge før ChatGPT eksisterte. Lovteksten nevner ikke AI med ett ord. Det betyr at GDPR regulerer AI indirekte, gjennom prinsippene om behandling av personopplysninger generelt.

Kjernen er dette: Behandler du personopplysninger – navn, e-poster, kundeinformasjon, ansattdata – så gjelder GDPR. Det spiller ingen rolle om det er et Excel-ark eller en AI-modell som behandler dem. Reglene er de samme.

Tre prinsipper er særlig relevante for AI-bruk:

- Formålsbegrensning: Du kan bare bruke personopplysninger til det formålet de ble samlet inn for

- Databehandleravtale: Sender du data til en ekstern tjeneste (som OpenAI eller Anthropic), trenger du en skriftlig avtale

- Behandlingsgrunnlag: Du må ha et lovlig grunnlag for å behandle personopplysninger – samtykke, kontrakt, eller berettiget interesse

Det er egentlig ikke mer komplisert enn det. Mesteparten av det som skrives om GDPR og AI er juridisk støy rettet mot store selskaper som bygger sine egne AI-systemer. For de fleste norske SMB-er handler det om noen enkle vurderinger.

Kan du sende kundedata til ChatGPT?

Det korte svaret: Det kommer an på hvilken plan du bruker, og hva slags data det er.

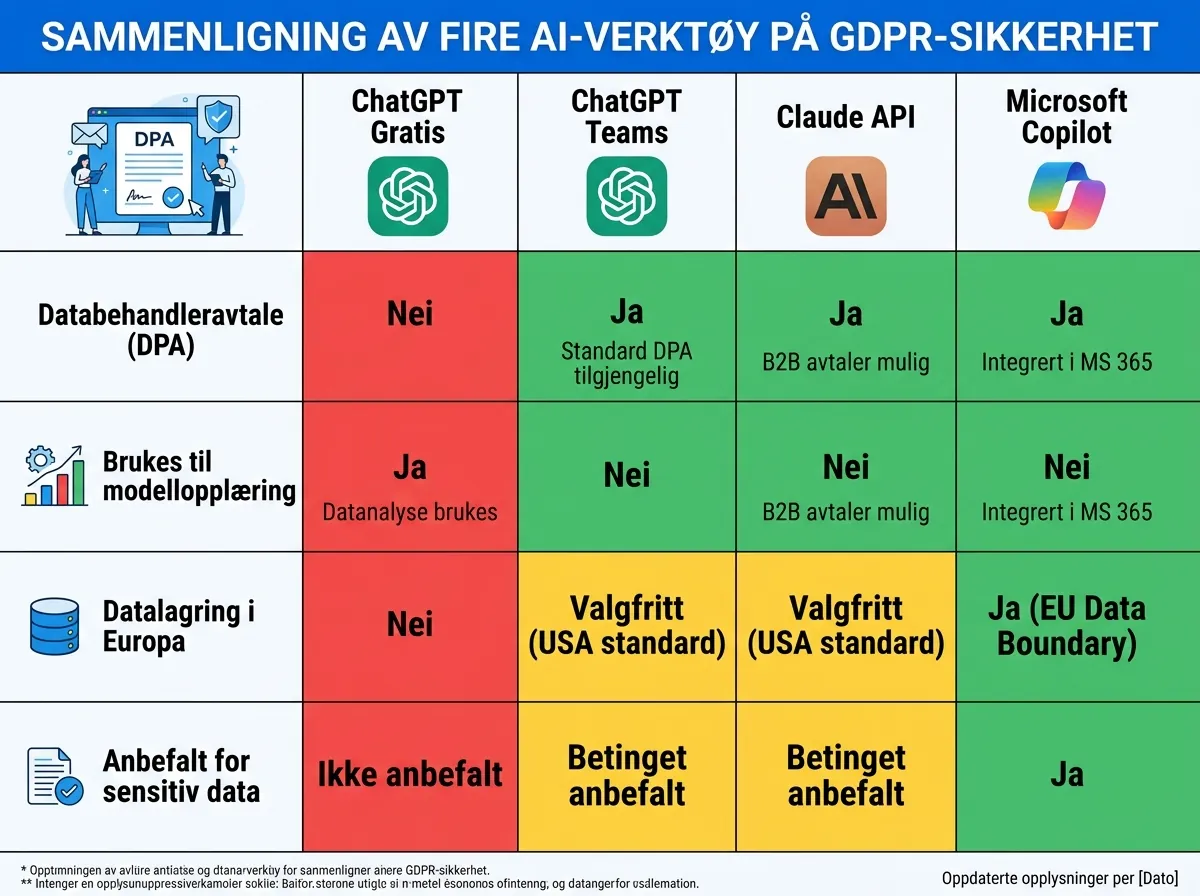

Gratisversjonen av ChatGPT (Free og Plus) bruker som standard innholdet ditt til å trene modellen. Det betyr at du ikke skal sende inn navn, e-poster, kontrakter eller annen sensitiv kundeinformasjon her. Det vil potensielt bryte med GDPR, og du har uansett ingen databehandleravtale.

ChatGPT Teams og Enterprise er en annen sak. OpenAI tilbyr databehandleravtale (DPA) på disse planene, og data brukes ikke til modellopplæring som standard. OpenAI har også introdusert europeisk datalagring, slik at data kan holdes innenfor EU/EØS. Prismessig starter Teams på rundt $30 per bruker per måned – det er akseptabelt for mange bedrifter som bruker verktøyet aktivt.

Mitt råd: Kjøp Teams-planen hvis dere bruker ChatGPT i jobbsammenheng og håndterer kundedata. Det er ikke dyrt, og det løser det meste av GDPR-bekymringene på én gang. Les også innstillingene – du kan slå av datalagring for enkle sessions der du ikke trenger historikk.

Er Claude tryggere enn ChatGPT for bedrifter?

Anthropic har gjort en smart ting: De inkorporerer databehandlertillegget (DPA) automatisk i alle kommersielle vilkår. Aksepterer du Anthropics Commercial Terms of Service, har du allerede signert databehandleravtalen. Det er en langt lavere terskel enn hos mange konkurrenter.

Claude bruker heller ikke inndata fra betalende kunder til å trene modellen. Og Anthropic har signert EU Standard Contractual Clauses (SCC) – det er den juridiske mekanismen som gjør internasjonal dataoverføring lovlig under GDPR, siden Anthropic er et amerikansk selskap.

Fra januar 2026 er Anthropic også tilgjengelig som Microsoft-subprosessor, noe som betyr at bedrifter med eksisterende Microsoft-avtaler kan bruke Claude gjennom Microsofts infrastruktur. Det er positivt for de som allerede er godt forankret i Microsoft-økosystemet.

I praksis: Claude API via Anthropic er et godt valg for bedrifter som behandler sensitive data. Det er ikke null-risiko – ingen skybasert AI er det – men det er et solid valg med god dokumentasjon. Se min komplette Claude-guide for mer om planer og priser.

Microsoft Copilot og enterprise-avtaler – er det tryggere?

Microsoft 365 Copilot er det mest «enterprise-klare» alternativet for mange norske bedrifter – rett og slett fordi de fleste allerede har Microsoft 365. Copilot inngår i de eksisterende databehandleravtalene med Microsoft, og data behandles innenfor EUs datagrense.

Datatilsynet i Norge og NTNU gjennomgikk Microsoft 365 Copilot i 2024-2025, og konklusjonen var at det kan brukes GDPR-lovlig, men at organisasjoner har et ansvar for å konfigurere det riktig og gjennomføre konsekvensutredning (DPIA). Det er ikke en clearance – det er en betinget grønn lys.

Hva betyr det i praksis? Har du allerede Microsoft 365 Business Premium eller Enterprise, og har en etablert databehandleravtale med Microsoft, er Copilot sannsynligvis det tryggeste alternativet å legge til. Du trenger ikke signere noe nytt – det dekkes av eksisterende avtale. Gjør likevel en rask DPIA-vurdering hvis du planlegger å bruke det med sensitiv informasjon.

Lokale AI-modeller – den sjokkerende enkle løsningen

Det er ett alternativ som eliminerer nesten alle GDPR-bekymringer: Kjør AI lokalt.

Ollama lar deg kjøre kraftige språkmodeller direkte på din egen maskin eller server – ingenting forlater bygget ditt. Ingen data sendes til OpenAI, Anthropic eller noen andre. Det er ikke noe å lekke.

Dette er ikke lenger en «hacker-løsning». Ollama nådde 52 millioner månedlige nedlastinger i Q1 2026, og modeller som Llama 3.3, Mistral og Qwen2.5 gir utmerket ytelse for de fleste bedriftsoppgaver. Vil du bruke noe kraftig som rivaliserer ChatGPT 4o? Kjør Meta Llama 3.3 70B på en server med skikkelig GPU. Det er mulig for mange bedrifter i dag.

Ulempen er åpenbar: Det krever litt mer teknisk kompetanse å sette opp, og du får ikke den samme polerte brukeropplevelsen som ChatGPT. Men for mange bruksscenarier – intern dokumentanalyse, automatisering, FAQ-bots – er det helt utmerket. Og som jeg skriver i startguiden min for SMB, er lokale modeller noe flere og flere bedrifter velger akkurat av personvernhensyn.

Anonymisering og pseudonymisering – konkret i praksis

Du trenger ikke alltid velge mellom «skybasert AI» og «ingen AI». En tredje vei er å rense dataene før de sendes til AI-verktøyet.

Anonymisering betyr at du fjerner all informasjon som kan knyttes til en enkeltperson. Anonymiserte data er ikke lenger personopplysninger, og GDPR gjelder ikke. En kontrakt der du har fjernet navn, organisasjonsnummer og kontaktinfo, er anonym nok til å sende til hvilken som helst AI-tjeneste.

Pseudonymisering er litt svakere – du erstatter identifiserende informasjon med en kode (f.eks. «Kunde A» i stedet for «Ola Nordmann»). Dataene er fortsatt personopplysninger under GDPR, men risikoen er vesentlig lavere, og det er lettere å forsvare bruken.

Enkelt eksempel: Du vil bruke ChatGPT til å analysere kundetilbakemeldinger. Finn/erstatt alle navn og e-poster med nøytrale referanser («Kunde 1», «Kunde 2»), send til ChatGPT, og jobb med resultatene. Ferdig. Ingen GDPR-bønnfall nødvendig.

Dette er den mest undervurderte tilnærmingen. For 90% av AI-oppgavene i en vanlig bedrift trenger du egentlig ikke personidentifiserende informasjon i det hele tatt – du trenger innholdet.

Hva du faktisk MÅ ha på plass

La meg være tydelig på hva som faktisk er obligatorisk, slik at du ikke bruker energi på det som ikke er det.

Databehandleravtale (DPA) er obligatorisk når du bruker et eksternt AI-verktøy til å behandle personopplysninger. OpenAI, Anthropic, Google og Microsoft tilbyr alle dette. For gratisversjoner finnes det ikke, og da skal du ikke bruke dem med persondata. For betalte businessversjoner er det som regel tilgjengelig – sjekk nettsiden under «Privacy» eller «Legal».

Behandlingsgrunnlag – du trenger et lovlig grunnlag. For ansatters AI-verktøy er berettiget interesse vanligvis tilstrekkelig. For kundedata er det mer nyansert avhengig av hva du gjør. Dokumenter vurderingen din – det trenger ikke å være lang, men den skal finnes.

Protokoll over behandlingsaktiviteter er obligatorisk for alle med over 250 ansatte, og anbefalt for alle andre. Det er rett og slett en liste over hva slags persondata du behandler og med hvem. Kan gjøres i et enkelt regneark.

Det er i grunnen det. Resten – lange risikovurderinger, konsekvensutredninger, personvernombud – er krav som utløses av spesifikke situasjoner (stor skala, sensitive kategorier, høy risiko). En regnskapsbyrå med 10 ansatte som bruker ChatGPT Teams til å skrive nyhetsbrev, er ikke i den kategorien.

Hva du IKKE trenger å stresse med

Mye av skrekk-journalistikken om GDPR og AI er rettet mot selskaper som bygger AI-systemer, ikke bedrifter som bruker dem. Det er en viktig distinksjon.

Du trenger ikke stresse med:

- Personvernombud – kreves bare ved systematisk, storskala behandling av sensitive kategorier. Ikke for den typiske SMB

- DPIA (konsekvensutredning) – kreves bare ved «høy risiko» for personvern. ChatGPT for markedsføringstekster er ikke høy risiko

- Eksplisitt samtykke for hvert AI-verktøy – du trenger ikke innhente samtykke fra kunder hver gang du bruker et AI-verktøy internt

- Rapportere AI-bruk til Datatilsynet – det er ingen generell meldeplikt for å bruke kommersielle AI-tjenester

Datatilsynet er ikke ute etter å straffe norske SMB-er som bruker AI fornuftig. De er ute etter de som samler inn data i stor skala, behandler sensitive kategorier uten grunnlag, eller gjør noe åpenbart problematisk. Hold deg unna det, og du er i god form.

EU AI Act – hva betyr det for norske bedrifter?

EU AI Act trådte i kraft i august 2024 og rulles ut gradvis. Norge implementerer det gjennom EØS-avtalen, trolig med norsk lov etter sommeren 2026.

For de aller fleste norske bedrifter betyr AI Act lite konkret i dag – og det er fordi de fleste bruker «generell AI» (ChatGPT, Claude, Copilot) til lavrisiko-oppgaver. Skriving, analyse, sammendrag. Det er ikke høyrisiko i AI Act sin forstand.

Høyrisiko-kategoriene under AI Act inkluderer AI brukt i rekruttering, kredittscoring, helsevedtak, og rettssystem. Bruker du AI til å automatisk sortere CV-er og ta ansettelsesvedtak, ja – da utløses det krav om dokumentasjon, testing og transparens. Det er fornuftig.

Mitt råd: Kartlegg hvilke AI-verktøy dere bruker og hva de brukes til. Det tar en halvtime. Faller noe i høyrisiko-kategorien? Ta en grundigere gjennomgang. Faller alt i lavrisiko? Fortsett som normalt og hold øye med utviklingen.

Bransjeeksempler – hva gjelder for deg?

Regnskap og revisjon: Klientdata er sensitiv. Ikke send kundenavn, organisasjonsnummer og transaksjonslister til gratisversjoner av AI. Bruk ChatGPT Teams / Copilot med DPA, eller anonymiser data før bruk. Generell skriving (nyhetsbrev, kommunikasjon, sjekklister) – ingen problemer med vanlige AI-tjenester.

Helsesektoren: Helseopplysninger er en særlig sensitiv kategori under GDPR. Her gjelder strengere krav. Pasientinformasjon skal ikke gå til vanlige skybaserte AI-tjenester uten spesifikk avtale og risikovurdering. Lokale modeller er et reelt alternativ her – og flere norske helseaktører ser på dette.

Juridiske tjenester: Advokatfirmaer har i tillegg taushetsplikten å forholde seg til. Klientkommunikasjon og saksinformasjon skal ikke inn i sky-AI uten klientgodkjenning. Bruk AI til generelle oppgaver – lovresearch, malutvikling, intern dokumentasjon – uten klientspesifikk informasjon.

Markedsføring: Dette er lavrisiko-sonen. Bruke AI til å skrive annonsetekster, generere ideer, analysere markedsdata uten personidentifisering? Det er uproblematisk med vanlige betalte AI-tjenester. Vil du analysere kundedatabaser eller sende personaliserte e-poster via AI? Da trenger du DPA og behandlingsgrunnlag – men det løser seg enkelt med de riktige verktøyene. ChatGPT-guiden min dekker dette i mer detalj.

Praktisk sjekkliste: 10 punkter for trygg AI-bruk

- 1. Kartlegg AI-verktøyene du bruker. Lag en enkel liste over hvilke verktøy, hvem som bruker dem, og hva de brukes til. En halvtime.

- 2. Skil mellom persondata og ikke-persondata. AI til intern dokumentasjon og generell skriving – ingen problem. AI med kundeinformasjon – trenger DPA.

- 3. Bruk betalte businessversjoner for sensitiv data. ChatGPT Teams, Claude Pro/API, Microsoft Copilot – disse inkluderer databehandleravtaler.

- 4. Sjekk og signer DPA med leverandøren. For OpenAI og Google: logg inn på bedriftskontoen og signér DPA under innstillingene. For Anthropic: automatisk inkludert i kommersielle vilkår.

- 5. Anonymiser data der det er mulig. Fjern navn og identifiserende info før du sender til AI. Det er raskt og eliminerer de fleste problemer.

- 6. Dokumenter behandlingsgrunnlaget. Et enkelt notat som forklarer hvorfor og hvordan dere bruker AI med persondata. Trenger ikke være langt.

- 7. Oppdater personvernerklæringen. Om dere bruker AI til å behandle kundedata, bør det nevnes. Krever ikke juridisk bistand – hold det enkelt.

- 8. Lær opp ansatte. De trenger ikke en juskurs. En enkel «dette kan vi sende til AI, dette kan vi ikke»-regel er tilstrekkelig.

- 9. Vurder lokale modeller for sensitive prosesser. Ollama og lignende verktøy eliminerer GDPR-utfordringen for data som ikke skal forlate bygget.

- 10. Hold deg oppdatert – men ikke panikopdatert. AI Act implementeres gradvis. Følg med, kartlegg høyrisikoscenarier, og juster etterhvert. Du trenger ikke et fullt compliance-program i dag.

Det er ikke mer enn dette. GDPR er ikke designet for å hindre norske bedrifter i å bruke nyttige verktøy – det er designet for å sikre at folk har kontroll over sine egne data. De to tingene er fullt forenlige. Med litt sunn fornuft og noen enkle tiltak kan du bruke AI aktivt i bedriften din uten å tape søvn over regelverket.

Har du spørsmål om spesifikke bruksscenarier? Skriv gjerne i kommentarfeltet. Noen situasjoner er mer nyanserte enn andre, og det er alltid bedre å spørre enn å gjette.