Innhold Vis

Gemma Gem er en Chrome-utvidelse som kjører Googles Gemma 4-modell direkte i nettleseren via WebGPU – uten API-nøkler, uten sky, uten at data forlater maskinen din. Prosjektet ble lagt ut på Hacker News og fikk raskt oppmerksomhet: en liten AI-agent som sitter på siden du besøker og faktisk kan gjøre ting.

Ikke bare svare på spørsmål. Lese sideinnhold, ta skjermbilder, klikke på elementer, fylle ut skjemaer og kjøre JavaScript. Alt lokalt, alt i nettleseren, alt gratis.

Dette er det siste eksemplet på en trend jeg synes er genuint interessant: AI som kjøres der du allerede er, i stedet for at du sender data til en server et sted i verden. Gemma 4 viste at Googles åpne modeller er blitt gode nok til at dette faktisk gir mening – og Gemma Gem viser hva som er mulig når noen tar det ett steg videre.

Hva er Gemma Gem og hvordan fungerer det?

Gemma Gem lastes ned som en Chrome-utvidelse. Når du har installert den, vises et lite edelstein-ikon nede til høyre på alle sider du besøker. Klikker du på det, åpnes en chat-overlay der du kan stille spørsmål om siden du er på – eller be agenten gjøre ting for deg.

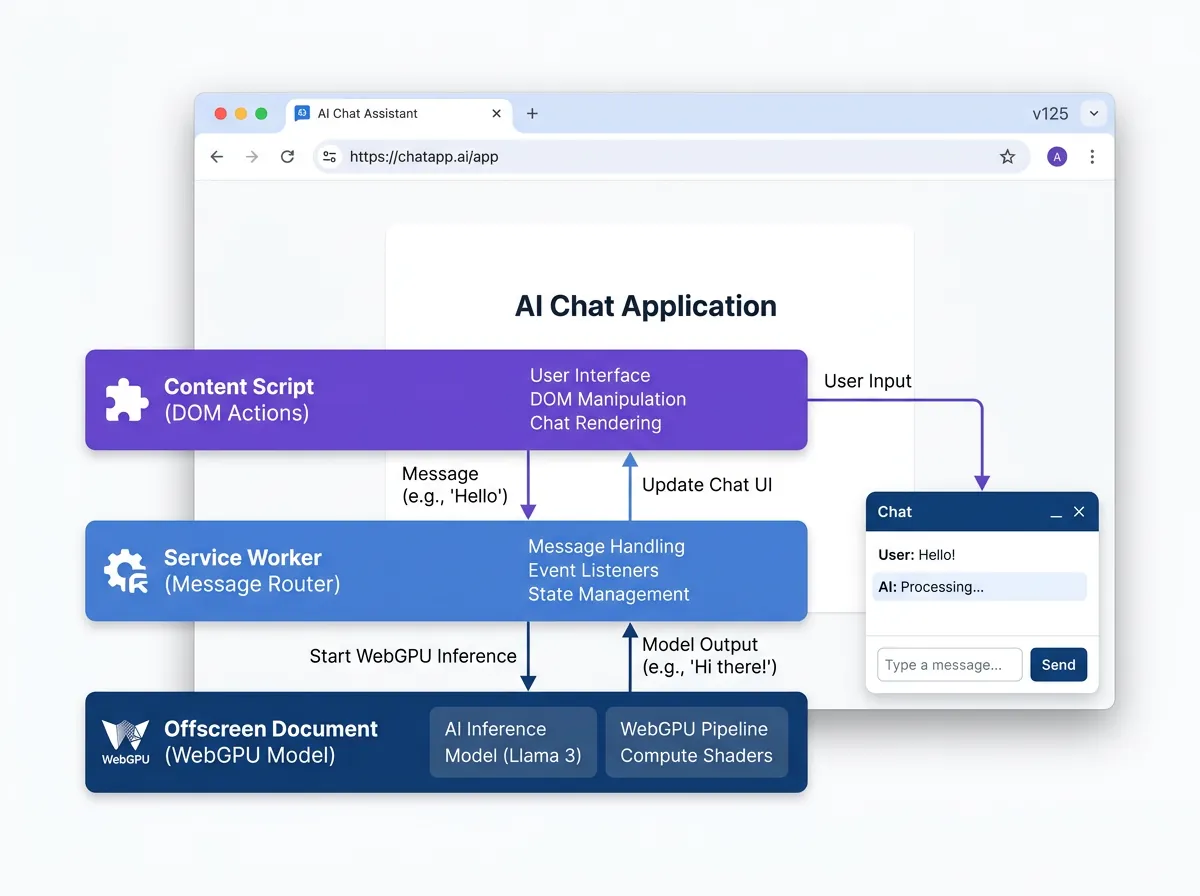

Selve modellen kjøres lokalt via WebGPU, en relativt ny nettleser-API som gir JavaScript tilgang til GPU-akselerasjon uten noen tredjepartsplugin. Det er det samme prinsippet som gjør at moderne nettleserspill kan ha anstendig grafikk – men her brukes det til å kjøre en språkmodell. Teknisk er arkitekturen elegant:

- Offscreen Document – kjører selve modellen via Hugging Face Transformers-biblioteket med WebGPU-akselerasjon

- Service Worker – ruterer meldinger mellom komponentene, håndterer skjermbilder og JavaScript-kjøring

- Content Script – injiserer grensesnittet i siden og utfører DOM-operasjoner

Første gang du åpner utvidelsen lastes modellen ned – enten Gemma 4 E2B (~500MB) eller E4B (~1,5GB). Deretter er den cachet lokalt og klar til bruk uten internettforbindelse. Det er en engangskostnad for nedlasting, men etter det er alt offline.

Hva kan agenten faktisk gjøre?

Gemma Gem har tilgang til seks verktøy som den kan kalle automatisk basert på hva du spør om:

- Les sideinnhold – henter tekst og HTML fra spesifikke elementer

- Ta skjermbilder – av det synlige området

- Klikk på elementer – via CSS-selektorer

- Skriv tekst – i inputfelt og skjemaer

- Scroll – navigerer opp og ned på siden

- Kjør JavaScript – med full DOM-tilgang

Modellen kjører i en agent-loop – den kan utføre sekvenser av handlinger og planlegge fremover. Spør du den om å «finne prisene på alle produktene på denne siden og summer dem», vil den ikke bare lete etter tekst. Den kan scrolle, lese, klikke seg gjennom sider, og rapportere tilbake.

Det finnes også en «thinking mode» som viser chain-of-thought-resonnementet mens agenten jobber. Det er litt som å se noen tenke høyt – nyttig for å forstå hva den planlegger å gjøre, og for å fange opp feil før de skjer.

Er en 2 milliarder parameter-modell god nok?

Her må jeg være ærlig: det er en 2B-modell i en nettleser. Det er ikke GPT-4o. Prosjektsiden selv sier «det fungerer for enkle sidespørsmål» – og det er en viktig nyansering.

Gemma 4 E2B har 128K kontekstvindu og ifølge Googles egne tall kan den prosessere 4000 input-tokens over to distinkte ferdigheter på under tre sekunder på vanlig hardware. Det er imponerende for størrelsen. Men den er ikke bygget for kompleks flertrinns resonnering av den typen vi forbinder med Claude Sonnet eller Gemini Pro.

For enklere oppgaver – «hva handler denne artikkelen om?», «fyll ut dette skjemaet med disse opplysningene», «klikk på Godta-knappen for meg» – er det mer enn godt nok. Prøver du å be den analysere et komplekst juridisk dokument og trekke kontraktsrettslige konklusjoner, vil du bli skuffet.

Og det er greit. Det er ikke poenget. Poenget er at du har en alltid-tilgjengelig assistent i nettleseren som ikke koster noe per forespørsel, ikke sender data noe sted, og faktisk kan hjelpe med hverdagsoppgaver. Det er en rimelig trade-off.

Hvorfor er WebGPU interessant her?

WebGPU er det som gjør dette mulig i det hele tatt. Det er en moderne nettleser-API som gir direkte tilgang til GPU-akselerasjon fra JavaScript – mye mer effektivt enn den eldre WebGL-standarden. Chrome har hatt WebGPU-støtte siden versjon 113 (mai 2023), Firefox og Safari er i ferd med å følge etter.

For AI-modeller er dette en gamechanger. GPU-er er designet for parallell matematikk, som er akkurat det nevrale nettverk trenger for inferens. Uten GPU-akselerasjon ville en 2B-modell i nettleseren vært ubrukelig sakte. Med WebGPU er det fullt akseptabelt.

Hugging Face har allerede en WebGPU-demo for Gemma 4 som viser ytelsen du kan forvente. Gemma Gem bygger på det samme Transformers.js-biblioteket og legger til agent-laget på toppen.

Sammenligning med andre lokale AI-tilnærminger

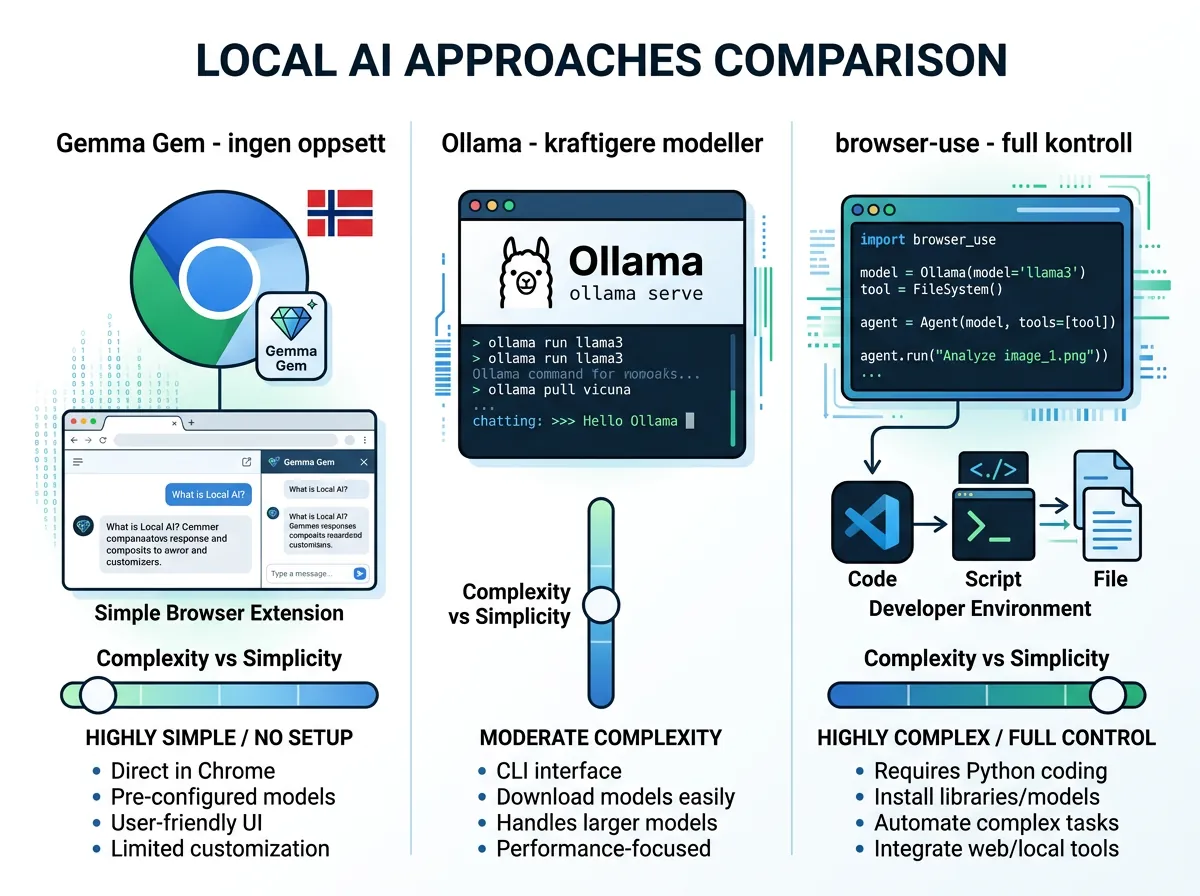

Gemma Gem er ikke det eneste prosjektet som prøver å kjøre AI lokalt i nettleseren eller på enheten – men det er en av de mer elegante løsningene fordi det ikke krever noe ekstra oppsett utenfor Chrome selv.

Alternativer som Ollama gir deg langt kraftigere modeller og mer fleksibilitet, men krever at du installerer noe lokalt, har nok RAM, og forstår litt om hvordan det fungerer. Det er en annen type bruker som setter opp Ollama enn den som installerer en Chrome-utvidelse.

Browser-use-tilnærmingen (lokale modeller som styrer nettleseren via Python) er kraftigere men mer kompleks. Gemma Gem er mye enklere – installer, klikk, still spørsmål. Og for mange oppgaver er det faktisk nok.

Det som gjør Gemma Gem unikt er at hele opplevelsen lever inni nettleseren. Ingen terminal. Ingen konfigurasjonsfiler. Ingen API-nøkler. Det er den laveste mulige inngangsterskelen for lokal AI med agent-kapabiliteter. For folk som er nysgjerrige på hva AI faktisk kan gjøre lokalt uten sky-avhengighet, er dette et godt sted å starte.

Installasjon og kom i gang

Prosjektet er åpen kildekode under Apache 2.0-lisensen og tilgjengelig på GitHub (kessler/gemma-gem). Det er ikke ute i Chrome Web Store ennå, så du må bygge det selv fra kildekode – noe som krever Node.js og et par kommandoer i terminalen.

Teknisk stack er moderne og ryddig: WXT (Vite-basert build-tool for extensions), Hugging Face Transformers.js for modellkjøring, og TypeScript gjennomgående. Det er ikke komplisert kode – det er faktisk ganske lesbart for noen med litt JavaScript-bakgrunn.

Kravene er greie: Chrome med WebGPU-støtte (det har alle moderne Chrome-versjoner), og mellom 500MB og 1,5GB ledig diskplass avhengig av hvilken modellvariant du velger. Velger du E2B er nedlastingen ~500MB og bruker mindre minne. E4B gir bedre resultater men krever mer.

Er du nysgjerrig på lokal AI og vil prøve noe uten å sette opp en hel infrastruktur, er dette et hyggelig lite prosjekt. Det er ikke produksjonsklar programvare ennå – det er et proof-of-concept fra en utvikler som lurte på om det var mulig. Og svaret er: ja, det er mulig, og det er ganske kult.