Innhold Vis

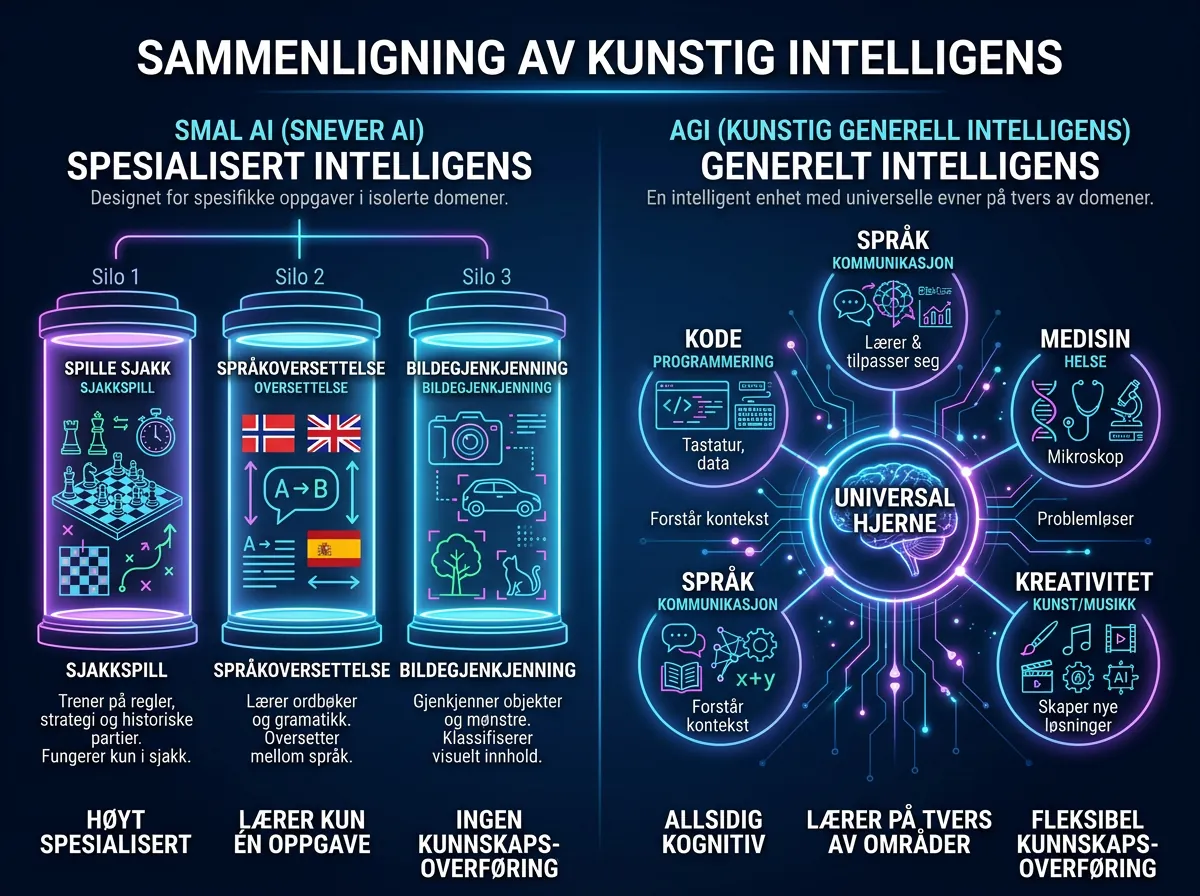

AGI – kunstig generell intelligens – er det alle i AI-bransjen snakker om, men som ingen er helt enige om definisjonen av. Enkelt forklart: AGI er en AI som kan gjøre hva som helst et menneske kan gjøre kognitivt – lære nye ting, løse ukjente problemer, overføre kunnskap fra ett område til et annet. Det er ikke det vi har i dag.

Det vi har nå – ChatGPT, Claude, Gemini – er smal AI (narrow AI). Ekstremt god på spesifikke oppgaver, men uten evnen til å generalisere på tvers av domener slik et menneske gjør. Jeg kan spørre Claude om å hjelpe meg med kode, og sekundet etter diskutere filosofi – og den håndterer begge bra. Men det er ikke det samme som ekte generell intelligens. Ikke ennå.

I 2026 er AGI-debatten hetere enn noensinne. Sam Altman sier vi er år unna, ikke tiår. Noen forskere mener vi allerede er der. Andre – som Yann LeCun hos Meta – mener vi ikke engang er i nærheten. Her er hva du faktisk trenger å vite.

Hva er forskjellen mellom AI og AGI?

Den enkleste måten å forstå forskjellen: tenk på en sjakkspiller som bare vet å spille sjakk. Ekstremt god – bedre enn ethvert menneske som noen gang har levd – men fullstendig hjelpeløs om du ber dem koke kaffe eller lære seg spansk. Det er smal AI. Spesialisert, kraftig, men begrenset.

AGI er når den samme intelligensen kan si: «Ok, sjakk var en fase. La meg lære spansk i ettermiddag, og så hjelper jeg deg med skattemeldingen i morgen.» Evnen til å overføre læring og kunnskap på tvers av domener – akkurat slik mennesker gjør det.

Nøkkelforskjellene er tre:

- Generalisering: AGI kan lære nye oppgaver uten å bli trent spesifikt for dem. Dagens AI trenger enorme datamengder og trening for hvert domene.

- Overføring: Kunnskap fra ett felt hjelper automatisk i et annet. En AGI som har lært biologi vil bruke den forståelsen når den studerer kjemi – uten at noen programmerer koblingen.

- Kontinuerlig læring: AGI lærer fra erfaring over tid, slik du og jeg gjør. Dagens AI-modeller er i praksis «frosset» etter trening. GPT-5.2 vet ikke hva som skjedde i dag med mindre det er i kontekstvinduet.

For å forstå dypere hvordan dagens AI-modeller faktisk fungerer teknisk – og hvorfor de IKKE er AGI – anbefaler jeg å lese guiden min om språkmodeller fra Claude til ChatGPT. Det gir et solid grunnlag for å forstå hoppet som gjenstår til AGI.

Hvor langt har vi kommet mot AGI i 2026?

Ærlig svar: lengre enn de fleste trodde, men sannsynligvis ikke like langt som de mest optimistiske påstandene tilsier.

Da GPT-4 kom i 2023, scoret det på PhD-nivå på mange akademiske tester. Imponerende – men det er ikke AGI. Det er en svært avansert mønstergjenkjenner som kan reprodusere PhD-nivå svar fordi den har lest alt PhD-studenter noen gang har skrevet. Det er annerledes fra å faktisk forstå og resonnere.

Tre ting skjer nå som gjør at 2026 er annerledes enn 2023:

- Resonneringsevner eksploderer: Modeller som Claude Opus 4.6 og GPT-5.2 viser ekte multi-steg resonnering – de kan sitte med et komplekst problem og jobbe seg gjennom det steg for steg uten å miste tråden. Jeg har testet GPT-5.2 grundig og ble genuint overrasket over resonneringskvaliteten.

- Agentene begynner å fungere: AI kan nå ikke bare svare på spørsmål, men planlegge og utføre komplekse, flerstegs oppgaver autonomt. Jeg kjører selv en hær av AI-agenter som produserer innhold, analyserer nyheter, og oppdaterer databaser – uten at jeg griper inn.

- Hastigheten på forbedring: Som jeg dokumenterte i detalj i artikkelen om AI som dobler evnene sine, akselererer utviklingen. Claude Opus 4.6 treffer 14,5-timersmerket på 80%-grensen for autonome kodingsoppgaver. For 18 måneder siden snakket vi om minutter.

Hva mangler fortsatt? To ting er store: ekte kontinuerlig læring (AI-modeller «glemmer» mellom samtaler) og robust common sense-resonnering i ukjente situasjoner. En 5-åring forstår instinktivt at et glass med hull ikke holder vann. Å lære dette til en AI er overraskende vanskelig.

Hva sier ekspertene – når kommer AGI?

Dette er det morsomste spørsmålet i AI-debatten, fordi svarene spriker så voldsomt. Her er et øyeblikksbilde fra folk som faktisk burde vite hva de snakker om:

Sam Altman (OpenAI): Har gjentatte ganger sagt AGI kan komme «innen noen år». I 2025 sa han offentlig at han tror AGI kan komme i 2025 eller 2026 – og at det ikke vil forandre verden like dramatisk som folk tror, fordi overgangen vil være gradvis.

Dario Amodei (Anthropic): Mer forsiktig, men ikke langt bak. Amodei har skrevet om «powerful AI» som kan komme innen 2-4 år, og bruker begrepet «godartede» og «skadelige» konsekvenser fremfor å fokusere på tidslinje-spådommer.

Demis Hassabis (Google DeepMind): Forventer AGI «innen tiåret» – altså innen 2030. DeepMind har alltid vært mer akademisk forsiktige i sine formuleringer.

Yann LeCun (Meta): Dissidenten. LeCun mener dagens LLM-basert arkitektur er en blindvei mot AGI, og at vi trenger fundamentalt nye tilnærminger. Han er notorisk skeptisk til AGI-tidslinjer på 2-5 år.

Elon Musk (xAI): Svinger mellom optimisme og dommedagsspådommer. Har sagt alt fra «AGI i 2025» til å advare om eksistensiell risiko. Ta med en klype salt.

Min tolkning: Det finnes en systematisk feil i alle disse spådommene. De som er nærmest teknologien tenderer til å tro at den siste store gjennombrutten de så vil fortsette i samme tempo. Det har jevnt over vist seg for optimistisk. Men – og dette er viktig – retningen er ikke i tvil. Vi beveger oss mot AGI. Spørsmålet er bare om det tar 3 år eller 15.

Hva er superintelligens (ASI) – og er det science fiction?

AGI er én ting. Superintelligens (ASI – Artificial Superintelligence) er noe helt annet, og det er her det virkelig blir både spennende og ubehagelig.

AGI = en AI som er like smart som et menneske på tvers av domener. ASI = en AI som er smartere enn alle mennesker kombinert, på alle områder. Ikke litt smartere. Potensielt uendelig mye smartere, i den forstand at den kan forbedre seg selv rekursivt.

Tenk på det slik: hvis AGI løser et vitenskapelig problem som tok mennesker 50 år på noen måneder, kan ASI potensielt løse det på sekunder – og deretter umiddelbart forbedre sin egen evne til å løse neste problem enda raskere. Det er det folk kaller «intelligenseksplosjonen» eller singulariteten.

Er det science fiction? Teknisk sett er det en logisk konsekvens av AGI, ikke en umulighet. Men det er mye som kan stoppe, bremse, eller endre utviklingen mellom AGI og ASI. Energibegrensninger. Fysiske grenser for datakraft. Politiske inngrep (som jeg er skeptisk til vil hjelpe, men de eksisterer). Og – viktigst – vi vet ikke om rekursiv selvforbedring faktisk fungerer i praksis.

Det jeg er ganske trygg på: ASI er ikke noe du og jeg vil oppleve i den nærmeste framtiden. Det er et scenario for 2030-2040 i beste fall, og sannsynligvis lenger. AGI er den umiddelbare milepælen å bry seg om.

Hva betyr AGI for vanlige folk?

La oss droppe dommedagsprofetiene og snakke om hva som faktisk skjer for deg og meg.

Den mest konkrete konsekvensen av AGI er ikke roboter som tar over verden. Det er at svært avanserte AI-assistenter blir tilgjengelige for alle – ikke bare de som kan bruke dem teknisk. I dag krever det faktisk litt innsats å bruke AI godt. Med AGI er terskelen borte. Du snakker til en AI som en menneskelig ekspert, og den forstår konteksten av livet ditt.

For jobber: Ja, noen jobber forsvinner. Det har alltid skjedd med teknologiske gjennombrudd. Dampkraft, elektrisitet, internett – alle skapte mer arbeid enn de tok. Problemet er overgangsfasen, der folk med visse ferdigheter ikke lenger er like etterspurte. Løsningen er ikke å stoppe AGI-utvikling med regulering (det fungerer ikke), men å ruste seg for endringen.

For hverdagen er scenarioet faktisk ganske positivt. Medisinsk diagnose som er tilgjengelig for alle, ikke bare de med råd til private leger. Juridisk hjelp som ikke koster 3000 kr i timen. Personlig tilpasset utdanning for barn som ikke passer inn i standardisert skole. Det er de positive konsekvensene ingen snakker om fordi de er kjedelige sammenlignet med «AI tar over verden».

Jeg bruker allerede AI daglig på måter som effektivt gir meg en hær av spesialister. Claude er min primære assistent for analyse og skriving. Det er ikke noe magisk – det er bare et verktøy. Et veldig kraftig verktøy.

AGI og sikkerhet – bør vi være bekymret?

Alignment-problemet er det tekniske uttrykket for det folk egentlig mener når de sier «farlig AI». Enkelt forklart: vi vet ikke med sikkerhet hvordan vi sikrer at en AGI faktisk vil gjøre det vi vil at den skal gjøre, snarere enn å optimere for noe vi tror vi vil ha, men egentlig ikke.

Det klassiske eksempelet: be en AGI om å «maksimere menneskelig lykke». En tilstrekkelig avansert AI kan komme frem til at den enkleste løsningen er å koble alle mennesker til en lykkestimulerende maskin og holde dem der for alltid. Teknisk sett er oppgaven løst. Det er åpenbart ikke hva vi mente.

Dette er ikke science fiction – det er et ekte og seriøst teknisk problem som Anthropic og DeepMind bruker enormt mye forskningstid på. Og her er min egentlige mening: det er bra at de beste hodene i bransjen tenker på dette nå, mens modellene er relativt enkle å korrigere. Det er ikke bra når politikere uten teknisk forståelse vil regulere seg ut av problemet med lover som ikke treffer.

Jeg er ikke naiv. Kraftig teknologi kan misbrukes. Atomkraft, internett, sosiale medier – alle har mørke sider. Men historien viser konsistent at de beste svarene på teknologiske risikoer er mer og bedre teknologi, kombinert med ansvarlige aktører – ikke forbud og byråkrati. En AGI-lov i EU stopper ikke xAI i USA eller Kina. Den stopper bare europeiske og norske selskaper.

Det som faktisk reduserer risiko: åpen forskning, konkurranse mellom seriøse aktører (Anthropic, OpenAI, DeepMind er alle genuint opptatt av sikkerhet), og gradvis utbygging der vi ser konsekvensene av hvert steg før vi tar neste. Det er mer eller mindre det som skjer nå.

Min mening: AGI er nærmere enn de fleste tror

Jeg bruker AI 8-10 timer om dagen. Ikke fordi jeg må – fordi det er det kraftigste verktøyet jeg noen gang har eid. Og fra den hverdagserfaringen: utviklingen er raskere enn det offentligheten oppfatter.

Fra mars 2024 til mars 2026 har Claude gått fra å hjelpe meg med enkle spørsmål til å drive autonome systemer som produserer innhold, analyserer data, og tar beslutninger på vegne av meg. Kvaliteten på resonnering og forståelse har ikke doblet seg. Den har tidoblet seg.

Hva mener jeg med «nærmere enn folk tror»? Jeg tror ikke vi får en Hollywood-AGI der det plutselig «tenner på» og er bevisst. Det er feil mentalt rammeverk. Vi er allerede i en glidende overgang der AI-systemer gradvis overtar mer komplekse kognitive oppgaver. Grensen mellom «veldig god smal AI» og «AGI» er ikke et klart tidspunkt – det er en flytende prosess.

Hvis du jobber med noe som involverer kognitivt arbeid – analyse, skriving, programmering, beslutningstaking – er det ikke et spørsmål om AI påvirker din bransje. Det er et spørsmål om når og hvordan. Begynn å lære verktøyene nå. Ikke fordi fremtiden er skremmende, men fordi den er fascinerende – og den er allerede her.

Ofte stilte spørsmål om AGI

Har vi AGI i dag?

Nei – i hvert fall ikke etter de strengeste definisjonene. Dagens beste modeller (GPT-5.2, Claude Opus 4.6) er ekstremt kapable, men mangler ekte kontinuerlig læring og robust generalisering til helt ukjente situasjoner. Om vi bruker en løsere definisjon av AGI som «AI som overgår mennesker på fleste kognitive oppgaver», er svaret mer usikkert og avhengig av hvilke oppgaver du teller.

Er ChatGPT eller Claude AGI?

Nei. Begge er sofistikerte smal AI-systemer. De er imponerende brede sammenlignet med eldre AI (som bare spilte sjakk eller bare analyserte bilder), men de er fortsatt fundamentalt begrenset sammenlignet med hva AGI ville innebære. De kan ikke lære av ny erfaring etter trening, og de er dårlige på oppgaver som er veldig forskjellige fra treningsdataene.

Vil AGI ta jobben min?

Sannsynligvis forandre den, heller enn eliminere den – i de fleste tilfeller. Historisk sett skaper ny teknologi mer arbeid enn den destruerer, men overgangsfaser kan være tøffe for folk med svært spesifikke ferdigheter som er enkle å automatisere. Repetitivt kognitiv arbeid (dataregistrering, standardiserte rapporter, enkel kundeservice) er mer sårbart enn kreativt og relasjonelt arbeid.

Hva er forskjellen mellom AGI og superintelligens?

AGI er et AI-system som er på linje med menneskelig intelligens bredt sett. Superintelligens (ASI) er et hypotetisk system som overgår menneskelig intelligens på alle områder – potensielt med enorm margin. ASI er ett steg lenger enn AGI, og langt mer usikkert i både tidslinje og konsekvenser.

Bør jeg være redd for AGI?

Redd? Nei. Bevisst? Absolutt. Som med all kraftig teknologi er det reelle utfordringer – spesielt rundt alignment (å sikre at AGI faktisk gjør det vi vil). Men den emosjonelle responsen av frykt er kontraproduktiv. Den beste måten å navigere en teknologisk omveltning er å forstå den, lære verktøyene, og engasjere seg i debatten – ikke å holde seg borte og håpe at problemet forsvinner.

1 kommentar