Innhold Vis

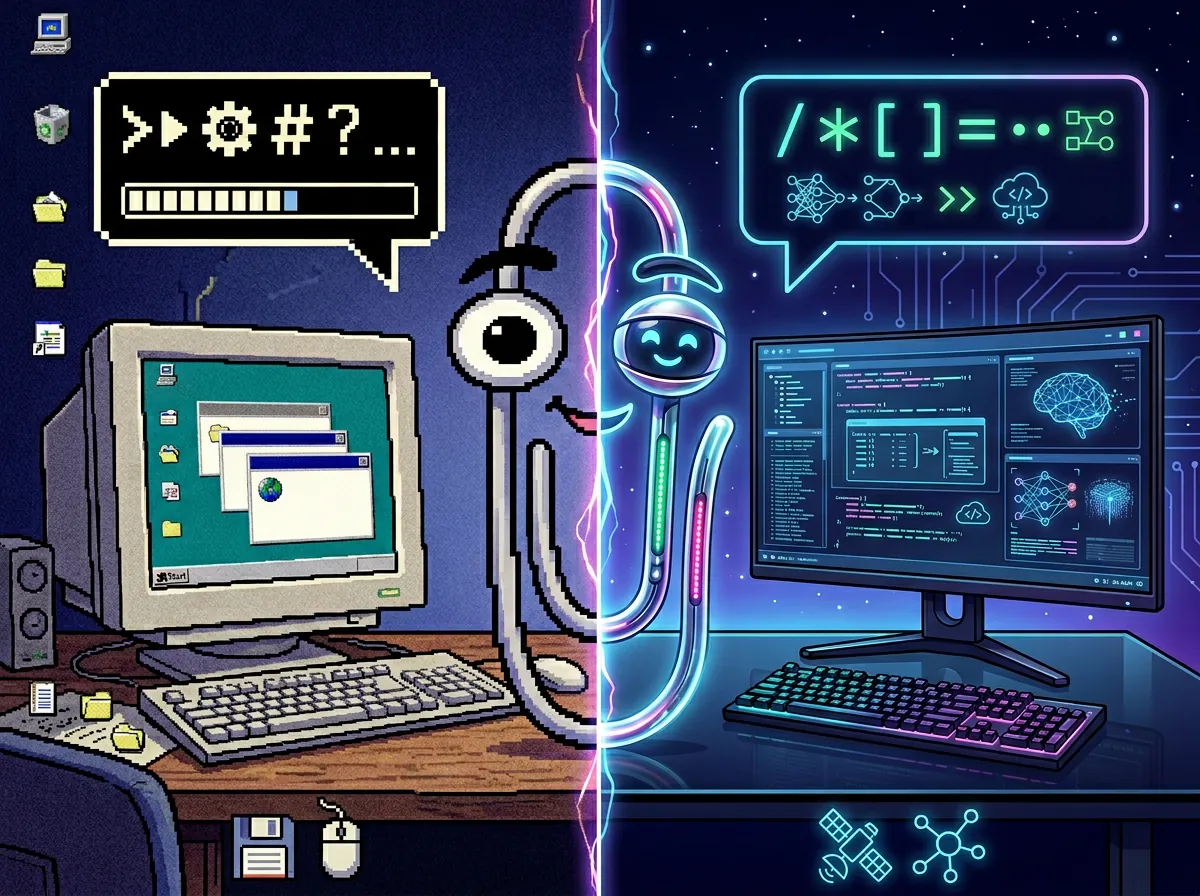

En utvikler på Reddit har bygget en desktop-agent som wrapper rundt Ollama – eller et hvilket som helst OpenAI-kompatibelt endepunkt – og legger til en flytende maskot på skrivebordet som tar imot kommandoer direkte. En av skinene er Clippy. Den berømte bindersfiguren fra Microsoft Office 97. Tilbake. Med AI-krefter. La det synke inn.

Prosjektet dukket opp i r/LocalLLaMA og fikk umiddelbar oppmerksomhet. Ikke bare fordi Clippy-nostalgiosen er reell, men fordi selve konseptet – en flytende, alltid-tilgjengelig skrivebordsagent drevet av din lokale modell – er genuint interessant. Ingen API-nøkler. Ingen sky. Bare Llama 3, Mistral, Qwen, DeepSeek eller hva Ollama enn kjører lokalt hos deg.

Agenten kan utføre filoperasjoner, browse nettet og sende e-post – alt via naturlig språk. Og siden den snakker OpenAI-kompatibelt API, fungerer den med alle modeller Ollama serverer. Det er det smarte med arkitekturen.

Hva er en desktop-agent egentlig?

Konseptet er enkelt: i stedet for å åpne en chat-fane i nettleseren, sitter agenten alltid på skrivebordet ditt – som en liten flytende figur. Du skriver kommandoen, agenten forstår den og utfører den. Ikke bare svarer. Utfører.

Det er forskjellen mellom en chatbot og en agent. En chatbot sier «her er et Python-script for å slette duplikate filer». En agent sletter dem faktisk – om du ber om det.

I dette tilfellet kan agenten:

- Filoperasjoner – lese, skrive, flytte, slette filer

- Nettlesing – søke etter informasjon og hente innhold

- E-post – sende meldinger direkte fra skrivebordet

- Kommandoutførelse – kjøre terminalkommandoer

Alt via den lokale modellen. Alt uten at data forlater maskinen din.

Hvilken Ollama-modell er best for tool calling?

Dette er det viktige spørsmålet – og det som ble diskutert mest i kommentarfeltet. Tool calling krever at modellen forstår funksjonsdefinisjoner og returnerer strukturerte JSON-kall. Ikke alle modeller er like gode på dette.

Ollama støtter tre varianter av tool calling ifølge den offisielle dokumentasjonen: single-shot (ett verktøy om gangen), parallell (flere verktøy samtidig) og en full agent-loop der modellen selv bestemmer når og hvilke verktøy den skal bruke.

For siste kategori – den autonome agent-loopen – trenger du en modell som faktisk er trent for dette. Qwen3-seriens modeller er nevnt som eksempel i Ollama-docs. Llama 3.1 og nyere er solide valg. Mistral Nemo fungerer godt for enklere oppgaver.

Jeg har tidligere skrevet om hvilke lokale modeller som egner seg best for agent-oppgaver med OpenClaw – mye av det gjelder her også. Kortversjonen: bruk en 7B-14B modell med eksplisitt tool-calling støtte. Ikke tving en liten instruksjonsmodell til å gjøre noe den ikke er designet for.

Clippy-faktoren – mer enn en vitsen

Det er lett å avfeie Clippy-skinnet som en meme. Men det er faktisk noe her. Clippy var upopulær fordi den kom med irrelevante forslag du ikke ba om, ikke kunne gjøre noe nyttig, og var umulig å bli kvitt. Alle tre problemene er løst i 2026.

En LLM-drevet skrivebordsassistent ber du om hjelp – den tilbyr den ikke uoppfordret. Den kan faktisk hjelpe, ikke bare foreslå. Og du kontrollerer den helt selv. Det er en litt morsom arc: Microsofts mest hatede UI-element fra 1997 gjenoppstår som legitimt nyttig verktøy 29 år senere, drevet av åpen kildekode og lokal maskinvare.

Lokal AI og personvern – det åpenbare poenget

Greia med lokale agenter som dette er ikke primært ytelse – cloud-modellene er fortsatt kraftigere for de fleste oppgaver. Det er kontroll. Filoperasjoner, e-post og terminalkommandoer er sensitive. Vil du at den handlingen skal gå gjennom OpenAIs servere? De fleste vil ikke.

Ollama løser dette elegant. Du kjører modellen lokalt på din egen hardware, og Ollama eksponerer et REST API på localhost:11434 som er fullt kompatibelt med OpenAI sin SDK. Desktop-agenten trenger ikke å vite om den snakker med GPT-4o eller Llama 3 – den snakker samme protokoll begge veier.

Det betyr at prosjekter som dette er portable. Vil du bytte modell? Endre én linje konfigurasjon. Vil du teste om Mistral gjør det bedre for dine spesifikke oppgaver? To minutter. Ingen ny API-nøkkel, ingen abonnementsendring.

Jeg kjørte Ollama lokalt lenge før det ble populært – her er den opprinnelige RTX 4090-guiden – og dette er akkurat den typen brukstilfelle som gjør lokal AI genuint verdifull fremfor å bare være et tech-hobbyprosjekt.

Kommer dette til å bli noe?

Desktop-agenter har vært «neste store ting» i AI siden minst 2024. De fleste har skuffet fordi de enten krever cloud-tilgang, er for sakte for interaktiv bruk, eller ikke er troverdige nok til å faktisk stole på med filsystemet ditt.

Kombinasjonen av Ollama + moderne tool-calling modeller + en lett desktop-wrapper begynner å løse alle tre. Lokalt betyr ingen latens til sky. Modeller som Qwen3 og Llama 3.1 er faktisk gode nok for strukturerte oppgaver. Og en klar, enkel UI – selv om det er en bindersfigur – senker terskelen for å faktisk bruke det daglig.

Prosjektet er fortsatt tidlig stadium. Men det illustrerer en retning som er mer interessant enn nok en nettleser-chat-app: AI som faktisk lever på skrivebordet ditt, tett integrert med systemet, drevet av modeller du selv kontrollerer. Vi er ikke helt der ennå, men dette er de rette ingrediensene.

Er du interessert i AI-agenter og OpenClaw – sjekk gjerne guiden om å bygge AI-agent-hær med OpenClaw for mer om multi-agent arkitektur.

Les mer om AI-agenter i Hva er AI-agenter? Slik fungerer de i praksis (2026).

3 kommentarer