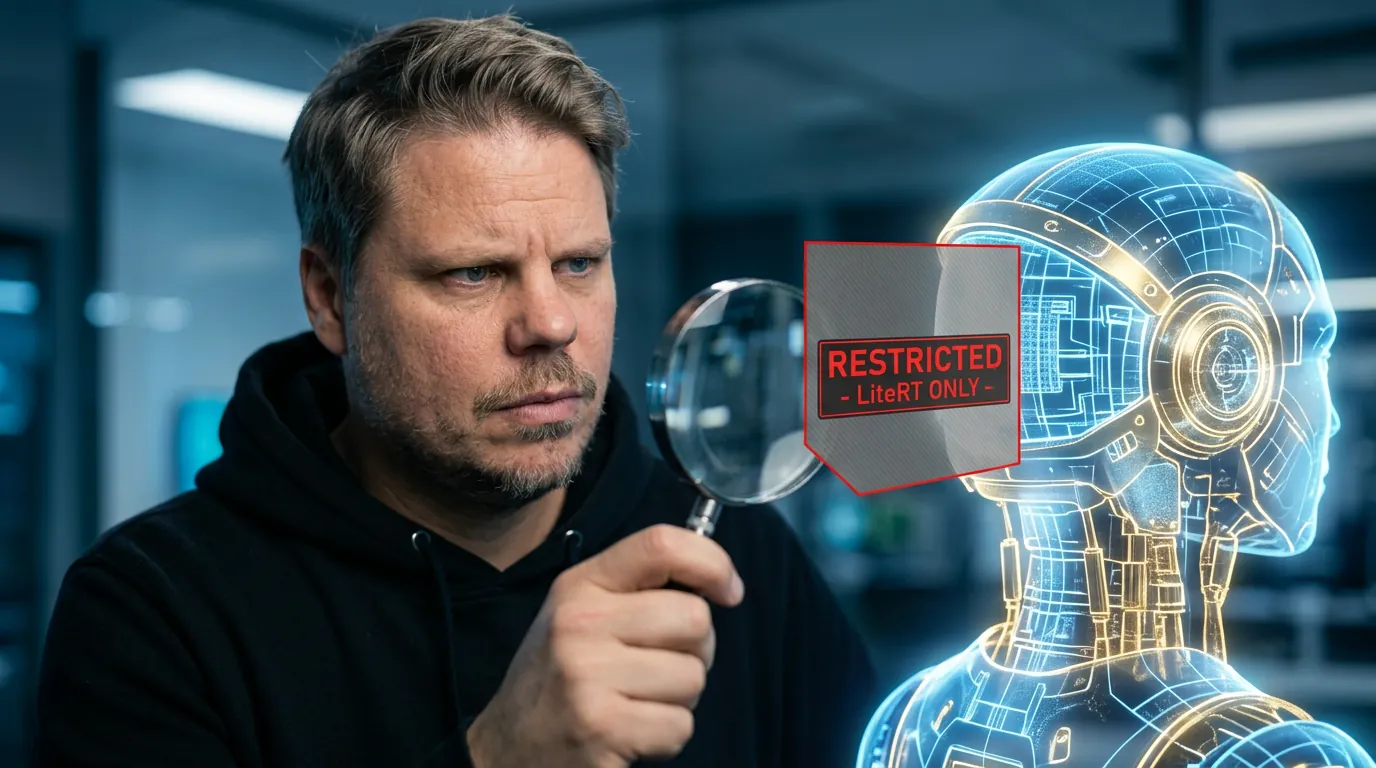

Gemma 4 og MTP – Google fjernet ytelsesboost fra offentlig modell

Google bekreftet via Hugging Face at Multi-Token Prediction er fjernet fra de offentlige Gemma 4-modellene. Den fulle versjonen med MTP finnes bare i LiteRT-formatet – som har 8 000 nedlastninger mot over én million for GGUF og safetensors. DeepSeek og Qwen gjorde det ikke slik.