Innhold Vis

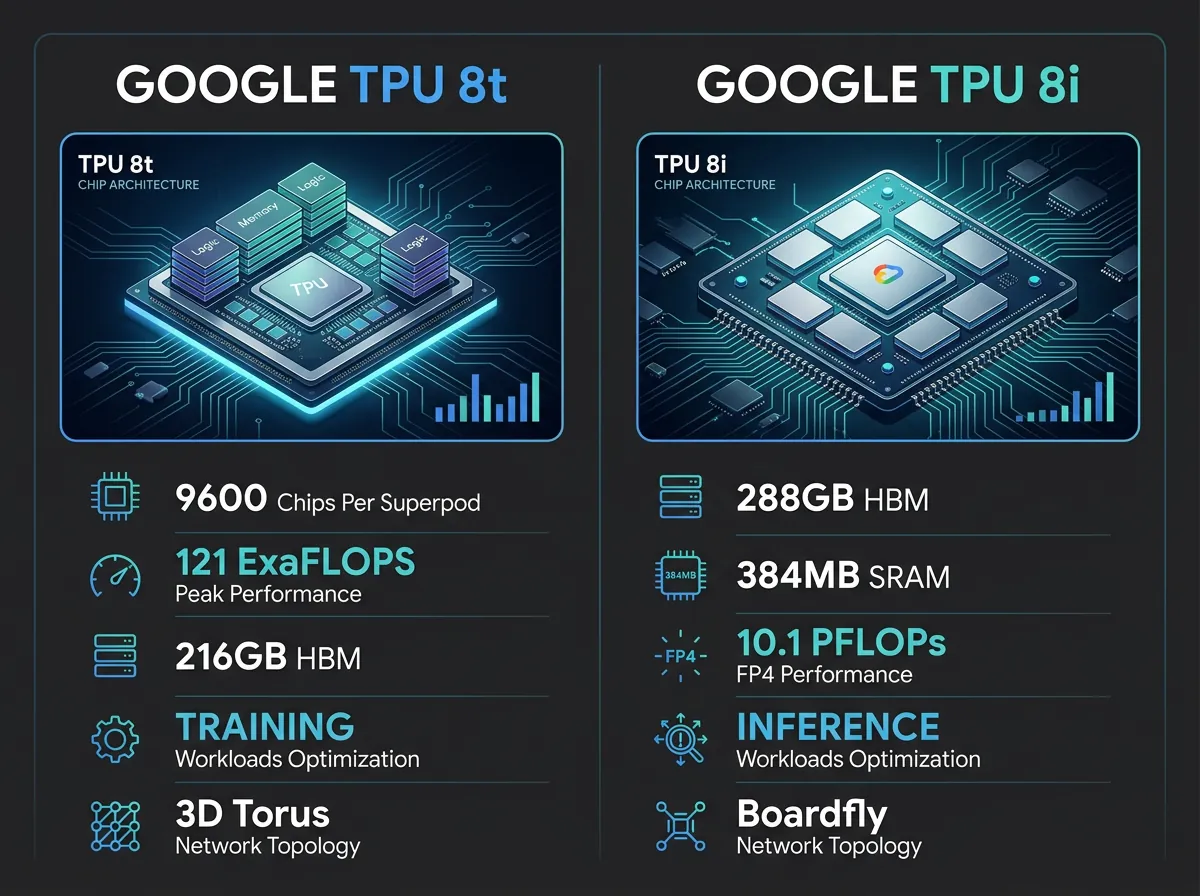

Google lanserte 22. april 2026 to nye åttende generasjons TPU-brikker under Google Cloud Next – TPU 8t for trening og TPU 8i for inferens. Det er første gang Google deler TPU-arkitekturen i to spesialiserte chips i stedet for én generalistbrikke, og begrunnelsen er klar: agentisk AI stiller fundamentalt forskjellige krav til maskinvare enn det som kom før.

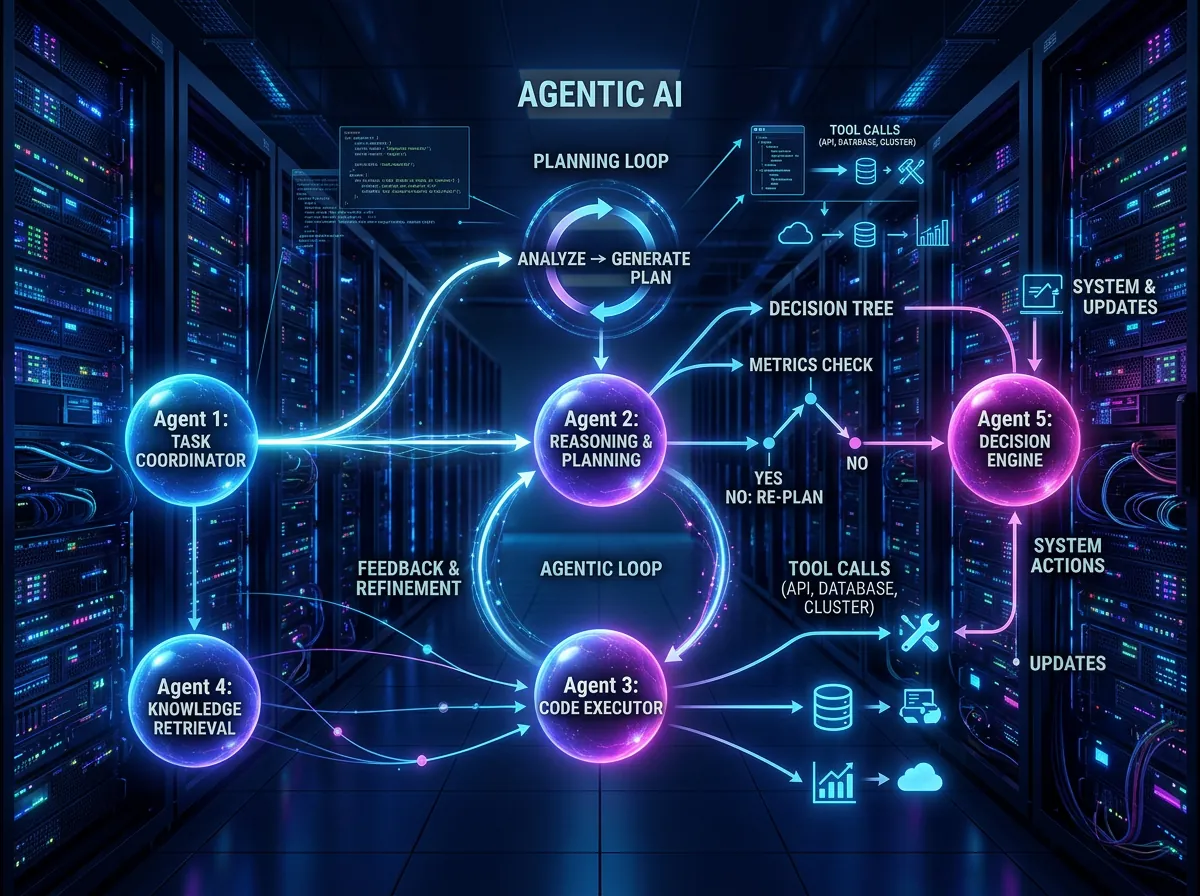

TPU-ene er Googles svar på en utvikling der AI-modeller ikke lenger bare svarer på enkle spørsmål, men planlegger, resonerer og utfører oppgaver i sekvensielle løkker. Slike arbeidsmønstre krever både ekstrem treningskapasitet og svært lav inferenslatens – to krav som er vanskelige å optimalisere for i én og samme brikke.

Tallene Google presenterer er imponerende. Men la meg gå gjennom hva de to brikkene faktisk gjør, og hvorfor oppsplittingen gir mening teknisk sett.

Hva er TPU 8t – Googles treningsbrikke?

TPU 8t er bygget for én ting: å trene gigantiske AI-modeller så raskt og effektivt som mulig. En enkelt superpod med TPU 8t inneholder 9 600 chips og leverer 121 exaFLOPS beregningskraft med 2 petabyte delt høybåndbredde-minne. Til sammenligning leverte Ironwood (sjuende generasjon) 42,5 exaFLOPS for 9 216 chips – TPU 8t er altså nesten tre ganger kraftigere.

Kanskje enda mer interessant er at TPU 8t kan skaleres til over én million chips i én enkelt treningsjobb via JAX og Pathways. Googles eget Virgo-nettverk binder opptil 134 000 TPU 8t-chips med 1,6 millioner exaFLOPS total kapasitet og 47 petabit per sekund bi-seksjonell båndbredde.

Ytelsestallene for priser og ytelse er ifølge Googles offisielle blogg 2,7 ganger bedre price-performance enn Ironwood for treningsoppgaver. Energieffektiviteten er også doblet sammenlignet med forrige generasjon.

Noen tekniske særtrekk ved TPU 8t:

- Native FP4 (4-bits floating point) – dobler gjennomstrømningen i beregningsenhetene

- SparseCore – håndterer embedding lookups og data-avhengige operasjoner effektivt

- TPUDirect RDMA – direktekommunikasjon mellom TPU-minne og nettverkskort

- 10x raskere lagringstilgang enn Ironwood via TPUDirect Storage

- Over 97% «goodput» – produktiv beregningstid uten ventetid

Interconnect-båndbredden er doblet (ICI) og nettverksbåndbredden mot datasenteret er firedoblet (DCN) sammenlignet med forrige generasjon. Poenget er at jo mer data man kan flytte raskt mellom chips, jo mer effektivt kan treningsjobber skalere lineært.

Hva er TPU 8i – inferensbrikken for agenter?

TPU 8i er den mer interessante nyheten, egentlig. Den er designet spesifikt for inferens – det vil si å kjøre ferdige AI-modeller og generere svar. Men ikke bare tradisjonell tekstgenerering: TPU 8i er bygget for det Google kaller «the intricate, collaborative, iterative work of many specialized agents.»

Agentisk AI er fundamentalt annerledes enn å svare på ett spørsmål. En agent resonnerer, planlegger, kaller verktøy, evaluerer resultatene og gjentar prosessen. Det betyr mange korte inferenssteg i rask rekkefølge, med lav toleranse for forsinkelse. Her er TPU 8i skreddersydd.

Spesifikasjoner som skiller TPU 8i fra 8t:

- 288 GB HBM per chip (mot 216 GB for 8t)

- 384 MB on-chip SRAM – tre ganger forrige generasjon

- 8 601 GB/s HBM-båndbredde – ca. 1,3 ganger raskere enn 8t

- Boardfly-nettverkstopologi som reduserer nettverksdiameter fra 16 til 7 hopp (56% lavenslatensforbedring)

- Collectives Acceleration Engine (CAE) – reduserer on-chip latens for kollektive operasjoner med 5x

Den økte SRAM-mengden er viktig. Under inferens med lange kontekstvinduer bygger modellen opp en KV-cache (nøkkel-verdi-cache) som inneholder all kontekst fra samtalen. Jo mer av denne cachen som får plass direkte på brikken i stedet for i HBM, desto raskere kan modellen hente informasjonen. TPU 8i er designet med nettopp dette i tankene.

Boardfly-topologien er en arkitekturinnovasjon som erstatter den tradisjonelle 3D torus-strukturen fra 8t. I stedet for at data må hoppe gjennom mange mellomliggende chips for å nå destinasjonen, bygger Boardfly et flatere nettverk med færre hopp. Det betyr mindre ventetid – noe som er kritisk for MoE-modeller (Mixture of Experts) og reasoning-modeller som Gemini.

Hvorfor dele én brikke i to?

Dette er det interessante spørsmålet. Google har lenge laget generalistbrikker – én TPU-generasjon som håndterte både trening og inferens, om enn med ulik konfigurasjon. Nå bryter de med den tilnærmingen.

Begrunnelsen er fysikkens begrensninger. En brikke optimalisert for trening trenger massiv båndbredde mellom chips og høy gjennomstrømning for store matrisemultiplikasjoner. En brikke optimalisert for inferens trenger rask tilgang til on-chip minne og lav latens i kommunikasjonen. Disse kravene peker i delvis ulike retninger i chip-designet.

Ironwood (sjuende generasjon) var et steg i inferensretningen – Google kalte den «the first Google TPU for the age of inference». TPU 8i går enda lenger, mens 8t optimaliserer treningssiden fullt ut. Det er egentlig et naturlig steg i en periode der både inferens og trening har blitt langt mer krevende og spesialiserte arbeidsbelastninger.

For de som bruker Google Cloud til å kjøre Gemini eller andre store modeller via API, er det TPU 8i som er relevant. For de som trener egne modeller i stor skala, er det TPU 8t. I praksis er dette mest relevant for store bedrifter og forskningsinstitusjoner – ikke for privatpersoner som kjører AI lokalt.

Hva betyr dette for konkurransen med Nvidia?

Google konkurrerer ikke primært med Nvidia i det åpne markedet – TPU-ene er bare tilgjengelige via Google Cloud, ikke som hardware man kan kjøpe og sette i egne servere. Men de konkurrerer om de kundene som vurderer om de skal kjøre AI-arbeidsbelastningene sine på Google Cloud eller bygge Nvidia-basert infrastruktur.

Som jeg har skrevet om i artikkelen om Nvidias posisjon i AI-markedet, kontrollerer Nvidia fortsatt rundt 90% av markedet for AI-treningschips. Googles strategi er ikke å slå Nvidia i det åpne markedet, men å gjøre Google Cloud til den mest effektive plattformen for de som vil trene og kjøre store AI-modeller uten å bygge egen infrastruktur.

Det er verdt å merke seg at Google har trent alle sine Gemini-modeller på egne TPU-er. Hvis TPU 8t leverer 2,7 ganger bedre price-performance enn Ironwood, betyr det at Google kan trene neste generasjons Gemini-modeller vesentlig raskere og billigere enn konkurrentene som kjøper inn Nvidia H100-er eller H200-er. Det er en strukturell fordel som er vanskelig å kopiere.

For mer kontekst om Googles posisjon i AI-stacken fra chips til applikasjoner, se artikkelen om Googles dominans i AI-markedet.

Tilgjengelighet og hva som skjer videre

Begge brikkene er annonsert, men ikke tilgjengelige ennå. Google melder om generell tilgjengelighet «later in 2026» gjennom Google AI Hypercomputer-infrastrukturen. Det er ikke noe uvanlig – chipannonseringer fra Google Cloud Next kommer typisk måneder før de faktisk er tilgjengelige for kunder.

For mer om AI-chiplandskapet mer generelt er det verdt å lese om Nvidia-Groq-avtalen og hva den sier om dynamikken i markedet, samt analysen av TurboQuant og chipacksjenes overreaksjon.

Det som er tydelig er at chipdesign for AI er i rask utvikling. Der det for noen år siden handlet om å lage kraftigere brikker for generelle oppgaver, handler det nå om å spesialisere seg: treningsbrikker som skalerer til en million chips, inferensbrikker som minimerer latens for agentiske løkker. Og med agentisk AI som det neste store steget i bruken av modellene, er TPU 8i-designvalget – mer on-chip minne, lavere nettverkslatens – et godt eksempel på at hardware-design følger bruksmønstre.

Hva tenker du? Er spesialiseringen av chips for trening vs. inferens noe som vil sette seg som standard, eller tror du vi kommer tilbake til generalistbrikker når teknologien modnes? Spennende spørsmål å følge i 2026.