Innhold Vis

DLSS 5 er Nvidias nye «3D-guidet neural rendering»-teknologi som ble kunngjort på GTC 2026 – og den har skapt mer oppstyr enn noe Nvidia har lansert på lenge. I stedet for å bare skalere opp oppløsning (som DLSS 2-4 gjorde), tar DLSS 5 spillets fargebuffer og bevegelsesdata og bruker AI til å tilføre fotorealistisk belysning, hudtoner og materialeffekter i sanntid. Høres imponerende ut, sant?

Problemet er at demoen ikke gikk som planlagt. Nvidia viste frem teknologien med karakterer fra Resident Evil Requiem – og det folk så, ble raskt til memes. Karakterenes ansikter fikk en overdrevent glatt, airbrushet finish som spillerne døpte «yassify-filteret». Leon Kennedy og Grace Ashcroft så plutselig ut som de hadde vært innom en AI-basert plastisk kirurg. Og kommentarfeltene tok fyr.

Nå forsvarer Jensen Huang teknologien med å si at kritikerne er «fullstendig feil». Det er verdt å grave litt i hva som faktisk skjer her – for dette handler om mer enn dårlig belysning på en videospillkarakter.

Hva er DLSS 5 egentlig?

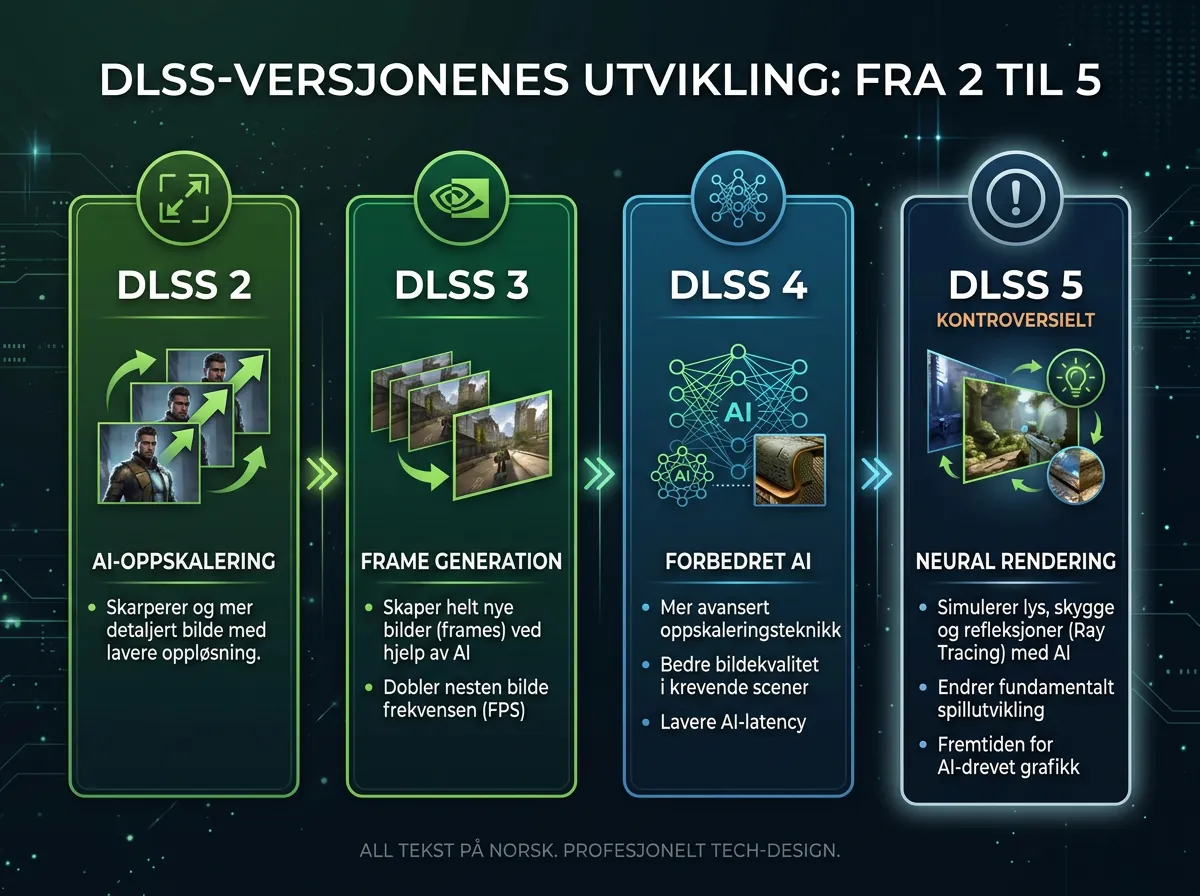

DLSS har gjennom versjonene 2, 3 og 4 handlet om ett kjernemål: få spill til å se bedre ut og kjøre raskere ved hjelp av AI. Version 2 introduserte AI-upscaling (lavere intern oppløsning, AI gjetter resten). Versjon 3 la til frame generation (AI lager mellomliggende frames). Versjon 4 forbedret begge deler.

DLSS 5 er noe fundamentalt annerledes. Nvidia kaller det «3D-guidet neural rendering» – en AI-modell som er trent til å forstå komplekse scenesemantics. Den skjønner hva som er hår, hva som er hud, hva som er stoff, og hvilke lysforhold scenen har. Basert på dette infuserer den fotorealistisk belysning, subsurface scattering på hud, og materialteksturer.

I praksis betyr det at AI-en ikke bare forbedrer det spillet allerede viser deg. Den bestemmer aktivt hvordan belysning og materialer skal se ut – og erstatter spillets egen rendering med sin versjon av virkeligheten.

Teknologien kjører i sanntid ved opptil 4K oppløsning. Nvidia sier at utviklere får detaljerte kontroller for intensitet, fargegradering og masking. Men som vi straks skal se: i demoen ble disse kontrollene tydeligvis ikke brukt.

Hva er «yassify-filteret» – og hvorfor er det et problem?

Begrepet «yassify» kommer fra en internett-trend der man bruker AI-filtre for å gjøre ansikter overdrevent sminket, glatte og glamorøse. Det er et morsomt meme – men ikke noe du vil at din skremmende zombie-overlevelse-karakter skal se ut som.

Det er nøyaktig det som skjedde i Nvidias DLSS 5-demo. Grace Ashcroft fra Resident Evil Requiem fikk fyldigere lepper, mørkere øyne som ble lysere, og det så ut som hun hadde sminke på. Poser og øyenringer forsvant. Leon Kennedy fikk en lignende behandling.

Poenget er ikke at AI-en gjorde jobben sin dårlig. Problemet er at den gjorde jobben sin for godt – bare med feil mål. Capcom har designet disse karakterene nøye. Slagskadene, tretthetssporene og realismen er ikke tilfeldige. De er artistiske valg. DLSS 5 valgte å ignorere dem til fordel for sin egen definisjon av «fotorealistisk».

Det ble enda mer pikant at det etter hvert kom frem at Capcoms egne utviklere ikke var varslet om at spillet deres ble brukt i demoen. De så det, som alle andre, for første gang på GTC-scenen. Det sier litt om tempoet Nvidia holdt her.

Jensen Huang sier spillerne tar feil. Har han et poeng?

Under en pressesamtale på GTC 2026 svarte Jensen Huang på kritikken. Svaret var kontant: «Well, first of all, they’re completely wrong.»

Argumentet hans er at DLSS 5 gir utviklerne full kontroll. De kan stille inn intensitet, velge hvilke deler av scenen som påvirkes, og finjustere AI-en til å matche spillets estetikk. I teorien skal ikke DLSS 5 overkjøre kunstnerisk intensjon – det skal forsterke den.

Og – ærlig talt – han er ikke helt feil. Teknologien i seg selv har disse kontrollene. Problemet er at demoen ikke viste det. Den viste standardinnstillingene på et spill der Capcom ikke engang visste de deltok. Det er et katastrofalt dårlig første inntrykk, uavhengig av om teknologien er god.

Hogwarts Legacy nevnes som et annet eksempel: DLSS 5 gjorde en 15-årig karakter til å se tiår eldre ut. Det er ikke en visuell forbedring – det er en semantisk feil. AI-en forstår ikke kontekst, bare piksler og mønstre.

Er dette «AI slop» i spill?

Det er spørsmålet mange stiller. «AI slop» er begrepet som har festet seg for AI-generert innhold som ser glatt og generisk ut – uten sjel, uten kontekst, uten menneskelig intensjon bak.

DLSS 5-memes sprer seg fordi de traff noe reelt: AI-en erstatter spillutviklerens kunstneriske valg med sin egen smak. Og «AI-smaken» er tydeligvis: glatte ansikter, overdrevet belysning, airbrushet skinn. Det er ikke fotorealisme – det er AI sin forståelse av hva fotorealisme er, basert på treningsdataene.

Her er det verdt å se på parallellen til det jeg har skrevet om GPU-markedet og Nvidias strategi. Nvidia kontrollerer allerede 90% av AI-treningsinfrastrukturen globalt. Med DLSS 5 handler det om å ta kontroll over et nytt lag – selve bildegenereringen i spill. Ikke bare maskinvaren. Ikke bare oppskaleringssteget. Selve det visuelle resultatet.

Det er et bemerkelsesverdig strategisk trekk. Og det forklarer kanskje hvorfor Nvidia haset ut demoen uten å inkludere Capcom i prosessen.

Hva skjer videre med DLSS 5?

Nvidia sier DLSS 5 lanserer høsten 2026. Innen den tid er det mye som kan skje – og bør skje.

For teknologien har faktisk potensial. Digital Foundrys hands-on rapport fra GTC er mer nyansert enn memesene: resultatene kan være imponerende, særlig for belysning i scener uten mennesker. Det er et annet bilde enn «AI ruinerer alt».

Men dette betyr at Nvidia trenger å gjøre to ting riktig frem mot lansering:

- Involvere spillutviklerne tidlig – ikke bruke spill som demo-props uten varsel. Capcom-episoden var unødvendig og uprofesjonell.

- Vise frem kontrollene – ikke bare si at de finnes. Vis et spill der DLSS 5 faktisk respekterer den artistiske intensjonen. Vis at en skummel karakter kan forbli skummel med bedre belysning.

Spillere er ikke dumme. De reagerer på det de ser – og det de så var karakterer som mistet sin identitet til en AI-filter. Jensen Huang kan si de tar feil så mye han vil. Det holder ikke å forklare seg – Nvidia må demonstrere det.

Og der er vi nå: en teknologi med ekte potensial, et katastrofalt dårlig første inntrykk, og et selskap som er mer interessert i å forsvare seg enn å lytte. Høsten 2026 blir interessant.