Innhold Vis

Jeg har en innrømmelse å komme med.

I omtrent tre måneder i fjor brukte jeg AI på en måte som ga meg stort sett middelmådige resultater. Jeg spurte ChatGPT om ting, fikk tilbake svar som var… fine. Generiske. Noen ganger direkte ubrukelige. Og jeg tenkte at kanskje AI bare var overhypet, at det ikke var så revolusjonerende som alle sa, at det kanskje fungerte for andre men ikke for meg.

Du har sikkert vært der selv. Du sitter der og stirrer på skjermen, og ChatGPT har akkurat gitt deg det mest idiotiske svaret du kunne tenke deg. Og så begynner det: «NEI! Det var IKKE det jeg spurte om! Herregud, er du HELT tilbakestående?! HVORFOR forstår du ikke hva jeg mener?!» Du sitter der og kjefter på en datamaskin som om den skulle høre deg, og et eller annet sted innerst inne vet du at dette er absurd, men frustrasjonen er ekte.

Jeg har vært der. Mange ganger.

Det viste seg at problemet ikke var AI. Problemet var hvordan jeg snakket til den.

Denne artikkelen handler om hva jeg lærte da jeg endelig tok meg tid til å forstå hvordan disse språkmodellene faktisk fungerer, og hvordan den forståelsen forandret måten jeg jobber på. Ikke med fancy triks eller kompliserte rammeverk, men med noen grunnleggende prinsipper som gjør forskjellen mellom å få søppel tilbake og å få noe du faktisk kan bruke.

Det fundamentale skiftet i tankesett

Den viktigste innsikten kom da jeg sluttet å tenke på AI som en veldig smart kollega jeg kunne spørre om hva som helst, og begynte å forstå hva en språkmodell faktisk er. En LLM er ikke intelligent på den måten vi vanligvis tenker på intelligens. Den tenker ikke. Den resonnerer ikke. Det den gjør er å predikere hva som sannsynligvis kommer etterpå basert på mønstre den har sett før.

Tenk på det som verdens mest avanserte autofullføring. Når du skriver en melding på telefonen og den foreslår neste ord, er det samme prinsipp – bare skalert opp til et nivå som føles magisk. Men det er fortsatt prediksjon, ikke forståelse.

Hvorfor er dette viktig å forstå? Fordi det endrer hele tilnærmingen din. Når du vet at AI-en prøver å fullføre et mønster du har startet, blir det plutselig åpenbart hvorfor vage spørsmål gir vage svar. Du gir den et utydelig mønster, og den gjetter. Gi den et tydelig mønster, og prediksjonen blir mye mer presis.

Det er ikke et spørsmål du stiller. Det er starten på et mønster du vil at AI-en skal fullføre.

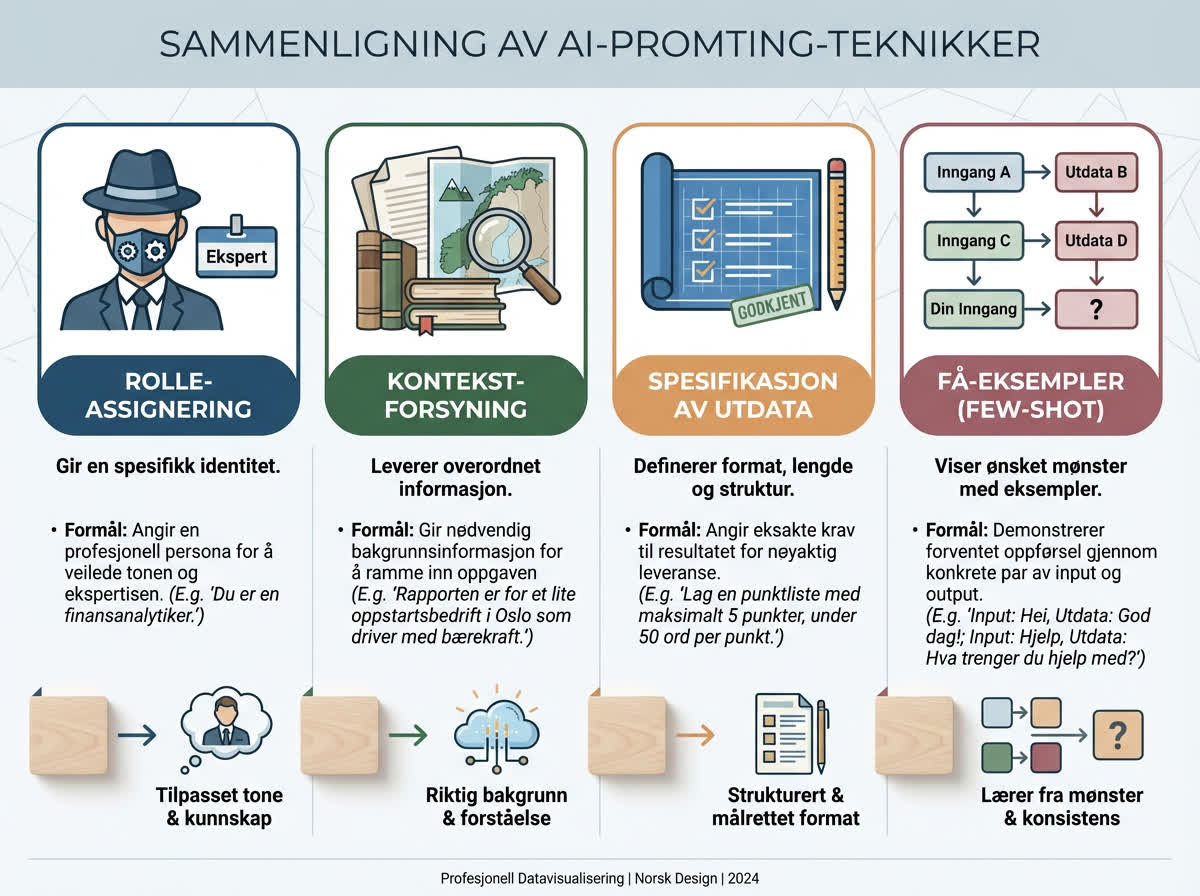

Fortell AI-en hvem den skal være

Her er noe som føles litt rart første gang du gjør det, men som fungerer overraskende bra: Gi AI-en en identitet før du ber den gjøre noe.

Grunnen til at dette fungerer er at språkmodeller har absorbert enorme mengder tekst fra alle mulige kilder – akademiske artikler, kundeservicemanualer, kreative tekster, teknisk dokumentasjon, alt mulig. Når du ikke spesifiserer et perspektiv, prøver den å gi deg et slags gjennomsnitt av alt den vet. Resultatet blir ofte generisk og sjelløst.

Men når du sier «Du er en erfaren kundeservicemedarbeider i et lite norsk firma med 10 års erfaring», så narrower du ned hvilken del av kunnskapen den skal trekke fra. Du setter en kontekst for hele samtalen.

Det praktiske eksempelet ser sånn ut. I stedet for å skrive:

Skriv en e-post til en kunde som klager på forsinket levering.

Prøv dette:

Du er kundeservicemedarbeider i et lite norsk rørleggerfirma. Du er profesjonell men varm, og du bryr deg genuint om kundene. Du unngår corporate-speak og foretrekker å være direkte og ærlig.

Skriv en e-post til en kunde som har ventet tre dager ekstra på at kjøkkenet skulle bli ferdig, på grunn av sykdom hos oss. Vi kan komme i morgen klokken 10. Kunden er frustrert men ikke aggressiv.

Forskjellen i output er dramatisk. Den første gir deg et generisk svar som kunne kommet fra hvem som helst. Den andre gir deg noe som faktisk høres ut som en ekte person som jobber i en liten bedrift.

Det fine er at dette tvinger deg til å tenke gjennom hvem du faktisk ville spurt om dette i virkeligheten. Hvem har den ekspertisen du trenger? Hvilket perspektiv vil gi det beste svaret? Den tankeprosessen alene forbedrer resultatene dine.

Kontekst er alt

Her kommer den teknikken som har gjort størst forskjell for meg, og det er egentlig ganske enkelt når du først forstår det: AI-en vil alltid gi deg et svar. Alltid. Selv når den ikke har nok informasjon til å gi deg et godt svar. Den fyller inn hullene selv, og det er der hallusinasjoner kommer fra.

Hver gang du utelater informasjon som er relevant for oppgaven, tar AI-en en gjetning. Noen ganger gjetter den riktig. Ofte gjetter den feil. Og du sitter igjen og lurer på hvorfor den fant på noe helt sprøtt.

Løsningen er å gi mer kontekst enn du tror du trenger. Ikke vær redd for å skrive lange prompts. Inkluder bakgrunnsinformasjon, målgruppe, hva du skal bruke resultatet til, begrensninger, preferanser – alt som er relevant. AI-en kan filtrere ut det som ikke er viktig, men den kan ikke finne opp informasjon den ikke har fått.

Et annet triks som har hjulpet meg mye er å eksplisitt gi AI-en tillatelse til å si at den ikke vet. Det høres kanskje rart ut, men disse modellene er trent til å være hjelpsomme, noe som betyr at de vil strekke seg langt for å gi deg et svar. Ved å legge til noe sånt som «Hvis du ikke har nok informasjon til å svare presist, si det i stedet for å gjette» reduserer du sjansen for hallusinasjoner dramatisk.

Spesifiser hva du vil ha tilbake

Dette er en feil jeg gjorde konstant i starten: Jeg ba om ting uten å si hvordan jeg ville ha det. Så fikk jeg tilbake noe som var teknisk riktig, men i helt feil format, feil lengde, feil tone.

AI-en kan ikke lese tankene dine. Hvis du vil ha en kort oppsummering på 100 ord, si det. Hvis du vil ha en punktliste, si det. Hvis du vil ha en uformell tone som passer for sosiale medier, si det. Hvis du vil ha noe som passer i en e-post til en kunde, si det.

Her er et eksempel på hvordan dette kan se ut i praksis:

Krav til svaret:

– Maks 200 ord

– Punktliste for hovedargumentene

– Tone: Profesjonell men vennlig, ikke noe corporate-tull

– Inkluder ett konkret eksempel

– Avslutt med en tydelig oppfordring til handling

Det føles kanskje overkill å være så spesifikk, men det sparer deg for runder med «nei, ikke sånn, mer sånn» frem og tilbake. Du får det du vil ha første gang, eller i hvert fall mye nærmere.

Vis, ikke bare fortell

Noen ganger er det vanskelig å beskrive nøyaktig hva slags stil eller format du er ute etter. I de tilfellene er det mye mer effektivt å vise AI-en et eksempel på hva du vil ha.

Dette kalles few-shot prompting, og det er egentlig bare å inkludere ett eller to eksempler i prompten din. AI-en er ekstremt god til å plukke opp mønstre fra eksempler, ofte bedre enn den er til å tolke beskrivelser.

Så i stedet for å skrive «Lag produktbeskrivelser som er catchy og fokuserer på fordeler, med litt humor», kan du skrive:

Skriv produktbeskrivelser i denne stilen:

Eksempel 1:

«Kaffetrakteren som lager barista-kaffe mens du fortsatt har morgenhår. Enkel. Rask. Slutt på dyre kafébesøk.»Eksempel 2:

«Laptop-stativet som redder nakken din. Justerbart. Solid. Noe du lærer å sette pris på etter tre timer på Zoom.»Nå, skriv en produktbeskrivelse for: [ditt produkt]

Du trenger ikke mange eksempler. To eller tre er vanligvis nok for at AI-en skal snappe opp stilen og reprodusere den konsistent.

Når grunnleggende ikke er nok

De fire prinsippene over løser de fleste problemene jeg støter på i hverdagen. Men noen ganger jobber jeg med noe mer komplekst, noe der jeg trenger AI-en til å virkelig tenke seg gjennom problemet. Da bruker jeg et par avanserte teknikker.

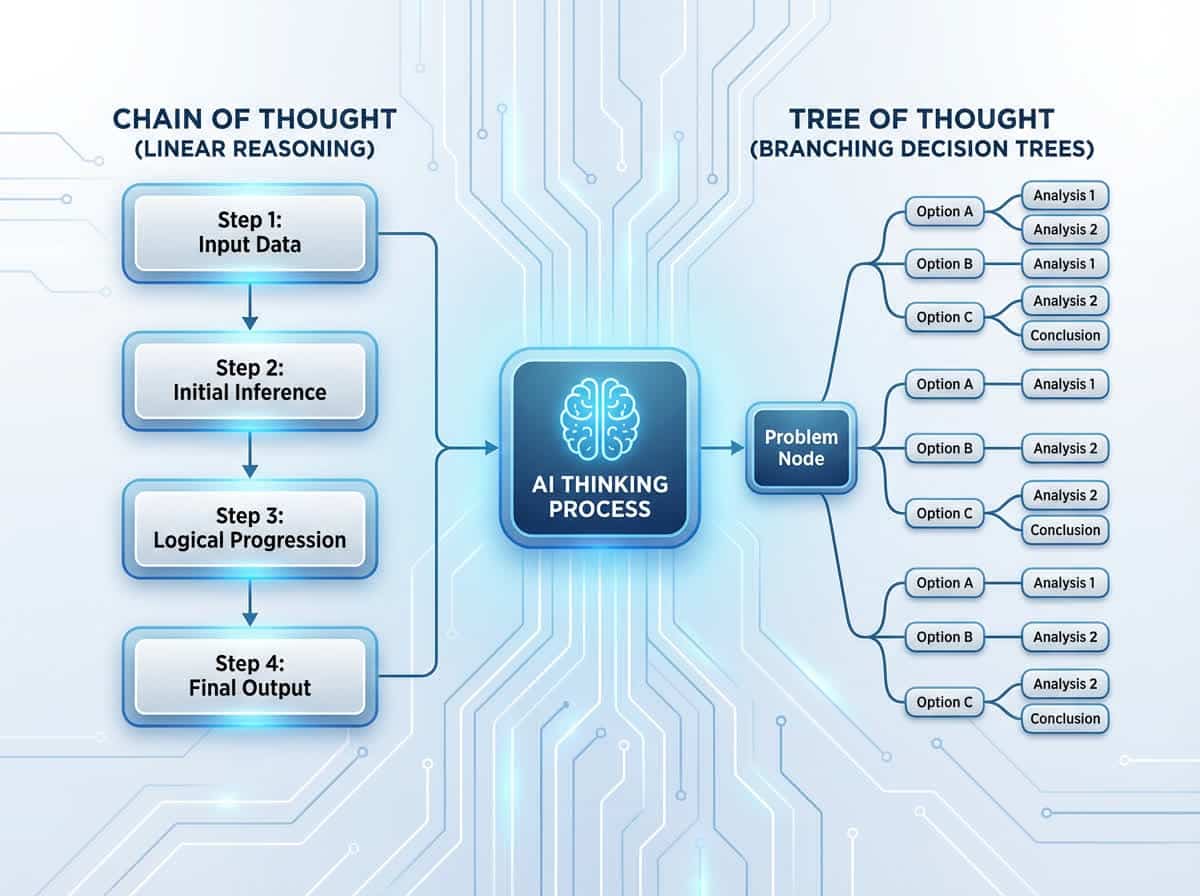

Chain of Thought handler om å be AI-en vise arbeidet sitt. I stedet for å bare be om et svar, ber du den gå gjennom resonneringen steg for steg først. Dette gjør to ting: Det tvinger AI-en til å «tenke» mer grundig før den konkluderer, og det lar deg se hvor i tankeprosessen det eventuelt går galt. Du kan si noe sånt som:

Før du svarer, tenk gjennom dette steg for steg:

1. Hva er kjerneproblemet her?

2. Hva er de viktigste hensynene?

3. Hva er mulige tilnærminger?

4. Hva er fordelene og ulempene med hver?Gi meg så din anbefaling.

De fleste moderne AI-modeller har nå innebygd «extended thinking» eller «reasoning mode» som gjør dette automatisk, men det kan fortsatt hjelpe å spesifisere stegene du vil at den skal ta.

Tree of Thought er en variant der du ber AI-en utforske flere mulige løsninger før den velger én. Dette er nyttig når du ikke er sikker på hva som er beste tilnærming, eller når du vil vurdere alternativer. Du kan strukturere det sånn:

Jeg trenger en markedsføringsstrategi for å lansere en ny tjeneste.

Utforsk tre forskjellige tilnærminger:

1. Aggressiv prising – være billigst på markedet

2. Premium-posisjonering – eksklusivt og high-end

3. Community-bygging – fokus på lojalitet og word-of-mouthFor hver tilnærming, beskriv fordeler, ulempler, og hva det krever.

Anbefal så hvilken tilnærming som passer best for et lite norsk B2B-firma med begrenset markedsføringsbudsjett.

Den tredje teknikken jeg bruker for viktige ting er det noen kaller adversarial validation. Det høres fancy ut, men konseptet er enkelt: Du ber AI-en ta på seg flere roller som argumenterer mot hverandre. Kanskje en som skriver et forslag, en som kritiserer det som en skeptisk kunde, og så en revisjon basert på kritikken. AI er ofte bedre til å kritisere og forbedre enn til å lage noe perfekt fra scratch, så dette utnytter den styrken.

Den egentlige hemmeligheten

Etter å ha brukt disse teknikkene en stund, innså jeg noe som kanskje burde vært åpenbart fra starten: Alle disse teknikkene handler egentlig om det samme. De tvinger meg til å tenke klarere.

Når jeg må definere hvem AI-en skal være, må jeg tenke på hvem som ville gitt det beste svaret. Når jeg må gi kontekst, må jeg tenke gjennom hva som faktisk er relevant. Når jeg må spesifisere output, må jeg vite hva jeg egentlig vil ha. Når jeg må gi eksempler, må jeg vite hva «bra» ser ut som.

Problemet var aldri at AI-en var dum. Problemet var at jeg ikke hadde tenkt klart nok gjennom hva jeg ville ha.

Det er en litt ydmykende erkjennelse, men også en befriende en. Det betyr at når jeg får dårlige resultater fra AI, er løsningen ikke å finne en bedre AI eller et smartere triks. Løsningen er å stoppe opp og tenke: Hva er det egentlig jeg prøver å oppnå her? Har jeg forklart det tydelig nok? Ville et menneske forstått hva jeg vil basert på det jeg skrev?

Hvis svaret er nei, er det der problemet ligger. Ikke i AI-en.

En enkel prosess

Basert på alt dette har jeg landet på en enkel prosess jeg følger før jeg skriver noe til AI:

Først stopper jeg opp og tenker gjennom hva jeg faktisk vil oppnå. Ikke bare «få en tekst skrevet», men hva teksten skal brukes til, hvem som skal lese den, hva den skal oppnå.

Så skriver jeg ned det jeg vet. All relevant kontekst, bakgrunn, begrensninger. Jeg later som om jeg forklarer oppgaven til en ny kollega som ikke vet noe om prosjektet.

Deretter spesifiserer jeg hva jeg vil ha tilbake. Format, lengde, tone, struktur – alt som er relevant for outputen.

Til slutt, hvis det er noe komplekst, legger jeg til eksempler eller ber om steg-for-steg tenkning.

Det tar kanskje to minutter ekstra å gjøre dette. Men det sparer meg for ti minutter med iterering frem og tilbake, og jeg ender opp med et mye bedre resultat.

Sjekkliste

De fleste oppgaver:

- Har jeg gitt AI-en en relevant rolle eller perspektiv?

- Har jeg inkludert all kontekst den trenger?

- Har jeg spesifisert hvordan jeg vil ha resultatet?

- Hvis stilen er viktig, har jeg gitt eksempler?

Komplekse oppgaver:

- Trenger jeg at AI-en tenker seg gjennom dette steg for steg?

- Bør jeg be om flere alternativer før den velger?

- Ville det hjulpet med en kritisk gjennomgang?

Før jeg sender:

- Ville et menneske forstått hva jeg vil basert på dette?

- Har jeg egentlig tenkt gjennom hva jeg vil ha?

Avsluttende tanker

Det er lett å bli frustrert på AI når den ikke gir deg det du vil. Jeg har vært der mange ganger. Men nesten hver gang jeg har sporet tilbake og analysert hva som gikk galt, har svaret vært at jeg ikke var tydelig nok i utgangspunktet.

Det fine med dette er at det er noe du kan bli bedre på. Prompting er en ferdighet, og som alle ferdigheter utvikler den seg med øvelse. Jo mer du jobber med å artikulere tankene dine tydelig – ikke bare til AI, men generelt – jo bedre resultater får du.

Og kanskje det er den egentlige gevinsten her. Ikke bare at du får bedre svar fra ChatGPT, men at prosessen med å formulere gode prompts gjør deg bedre til å tenke og kommunisere generelt.

Så neste gang du sitter der og roper «ER DU HELT IDIOT ELLER?!» til skjermen – ta et skritt tilbake. Pust. Og spør deg selv: Forklarte jeg egentlig hva jeg ville, eller antok jeg at AI-en bare skulle skjønne det?

Svaret ligger som regel der.

Har du spørsmål om prompting eller AI generelt? Send meg gjerne en melding på LinkedIn, eller sjekk ut podcasten min «Jan Sverre prater om AI» for mer praktisk AI-innhold.

1 kommentar