Innhold Vis

Sam Altman er problemet. Ikke teknologien. Ikke OpenAI som selskap. Ikke konkurransen fra Anthropic eller Google. Det skriver Dario Amodei – tidligere nestsjef i OpenAI, nå sjef for Anthropic – i sine private notater. Og 6. april 2026 bekreftet The New Yorker det med en 100+ kilders undersøkelse som vil bli stående som et av de viktigste tech-reportasjene dette tiåret.

Altman er fortsatt sjef. Han satt ut styret som prøvde å sparke ham i november 2023. Han sitter nå på toppen av et selskap verdsatt til 850 milliarder dollar, med direkte linje til Det hvite hus, og planer som bør få alarmklokkene til å ringe hos alle som bryr seg om hvem som faktisk kontrollerer fremtidens AI-verktøy.

Samme dag som New Yorker-artikkelen ble publisert, slapp OpenAI et 13-siders policy-dokument der Altman ber staten om robotskatt, et nasjonalt Public Wealth Fund og kortere arbeidsuke. Altså: mannen som ifølge 100+ kilder lyver konsekvent og ikke kan stoles på, vil nå gi staten mer makt over verktøyene vi alle bruker. Det er ikke et uhell. Det er en plan.

Hva sier New Yorker-undersøkelsen?

Journalistene Ronan Farrow og Andrew Marantz brukte måneder på å snakke med over 100 kilder og gå gjennom mer enn 200 sider interne dokumenter. Konklusjonen er knusende: Altman er ifølge kildene beskrevet som en «relentless liar» som manipulerer folk for å få det han vil.

Ilya Sutskever – OpenAIs tidligere toppforsker og en av mennene som prøvde å sparke Altman i 2023 – kompilerte et notat der første punkt er ett ord: «Lying». Dario Amodei, som ledet sikkerhetsarbeidet, kom frem til samme konklusjon i sine private notater. Han skrev det rett ut: «The problem with OpenAI is Sam himself.»

Styret som stemte for å sparke Altman i november 2023 hadde ikke bare en magefølelse. De hadde et ~70 siders dokument som dokumenterte et «consistent pattern» av løgner, inkludert om selskapets egne sikkerhetsprotokoller. Et konkret eksempel: Altman forsikret styret om at GPT-4 hadde gjennomgått og fått godkjenning fra et sikkerhetspanel. Da et styremedlem ba om dokumentasjon, viste det seg å være en misrepresentasjon.

En anonym Microsoft-direktør sier det slik til The New Yorker: «I think there’s a small but real chance he’s eventually remembered as a Bernie Madoff- or Sam Bankman-Fried-level scammer.» Det er ikke en marginal mening. Det er hva folk som jobber tett med ham tenker – men sier anonymt fordi de er redde for konsekvensene.

Hvem har sluttet – og hvorfor?

Etter det mislykkede kuppet i 2023 forsvant en rekke nøkkelpersoner. Ilya Sutskever gikk. Dario Amodei og store deler av sikkerhetsteamet hans hadde allerede forlatt skuta og grunnlagt Anthropic. Jan Leike, som ledet alignment-forskning, sluttet i 2024 med et brev som var alt annet enn diplomatisk – han beskrev en kultur der sikkerhet konsekvent tapte for produktlansering.

OpenAI har siden lagt ned de fleste av sine sikkerhetsrelaterte teams. Styremedlemmene som stemte for å sparke Altman er borte. Igjen sitter han med et styre han selv i stor grad har satt sammen – folk som er lojale mot ham personlig, ikke mot det originale oppdraget til en non-profit stiftelse bygget for å trygge menneskeheten.

Aaron Swartz – mannen som grunnla Y Combinator sammen med ham – er blant dem som har kalt Altman en «sociopath». Dette er ikke bitter eks-ansatte. Dette er folk som kjente ham fra starten, som bygde ting med ham, og som konkluderer med det samme.

Robotskatt, statsfond og New Deal – hva vil Altman egentlig?

Her er det som virkelig bør bekymre deg. Samme dag New Yorker-artikkelen ble publisert – 6. april 2026 – slapp OpenAI dokumentet «Industrial Policy for the Intelligence Age». Det er 13 sider med politiske forslag som leser seg som sosialdemokratiets drømmepolitikk for AI-alderen.

Altman vil ha robotskatt. Han vil ha et nasjonalt Public Wealth Fund seeded av AI-selskaper – inkludert OpenAI – som skal gi «alle amerikanere en andel i AI-drevet vekst». Han vil ha statlig utløste sikkerhetsnett som automatisk slår inn når AI-relaterte arbeidsledighetstall treffer forhåndsdefinerte grenser. Han sammenligner prosjektet sitt med Progressive Era og New Deal.

La oss kalle dette det det er: Sam Altman vil at staten skal administrere gevinstene fra den teknologien han kontrollerer. Han sitter på toppen av et selskap verdsatt til 850 milliarder dollar. Investeringene strømmer inn fra Saudi-Arabia, Japan og resten av verden. Og nå vil han at en del av disse pengene skal gå gjennom et statlig fond – der politikere og byråkrater bestemmer fordelingen.

Robotskatten er ikke filantropi. Det er et monopolverktøy. Når du skattlegger automatisert arbeid, straffes alle som prøver å konkurrere med OpenAI. De store selskapene med masse kapital – som OpenAI – absorberer skatten. De små konkurrentene, open source-prosjektene og hobbyistene? De kveles sakte.

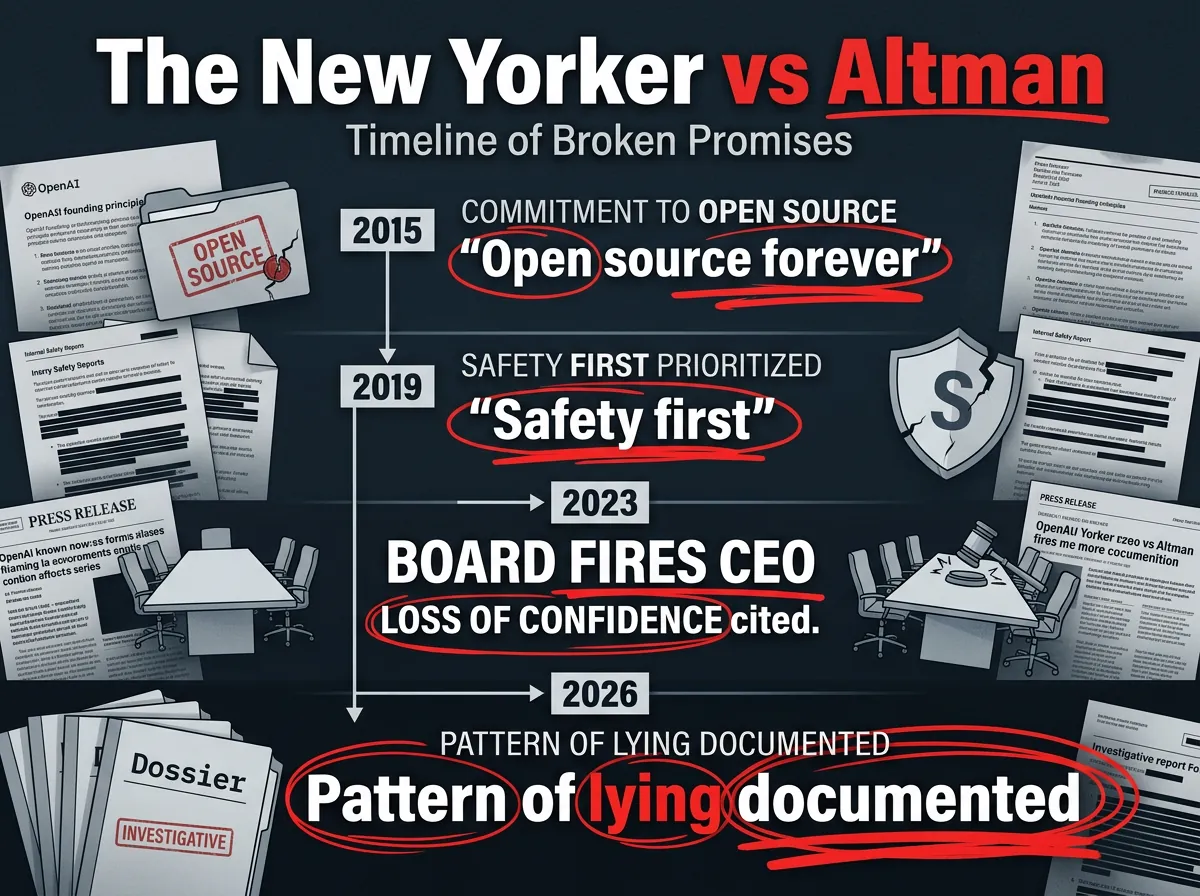

Fra «Open» til lukket – løftebruddene som definerer OpenAI

OpenAI ble grunnlagt som en non-profit stiftelse. Open source, åpen forskning, for menneskeheten. Det stod i vedtektene. Det var salgspitchen til tidlige donorer og samarbeidspartnere – inkludert Elon Musk, som betalte inn 44 millioner dollar fordi han trodde på prosjektet.

I dag er OpenAI et for-profit selskap. Modellene er lukkede. Forskningen er proprietær. Microsoft eier store deler. GPT-4 og GPT-5 er svarte bokser – du kan ikke inspisere dem, du kan ikke modifisere dem, du kan ikke kjøre dem lokalt. Du er avhengig av at Altman holder serverene oppe og prisene nede.

Musk saksøkte selskapet for det han kaller en «fraudulent enterprise» – en bait-and-switch fra ideell til profittmaskin. Rettsdokumentene er nå «unsealed». De viser interne e-poster der grunnleggerne diskuterer overgangen på en måte som er vanskelig å forsvare offentlig. Jeg har tidligere gått gjennom disse dokumentene – det er en ubehagelig lesning.

Altman tok et selskap som lovet åpenhet og gjorte det til et av de mest lukkede i bransjen. Han tok et selskap som lovet å jobbe for menneskeheten og gjorte det til et investeringsobjekt for saudiarabisk kapital. Og nå sier han at løsningen er mer statlig kontroll. Logikken gir mening – hvis du forstår at målet aldri var åpenhet.

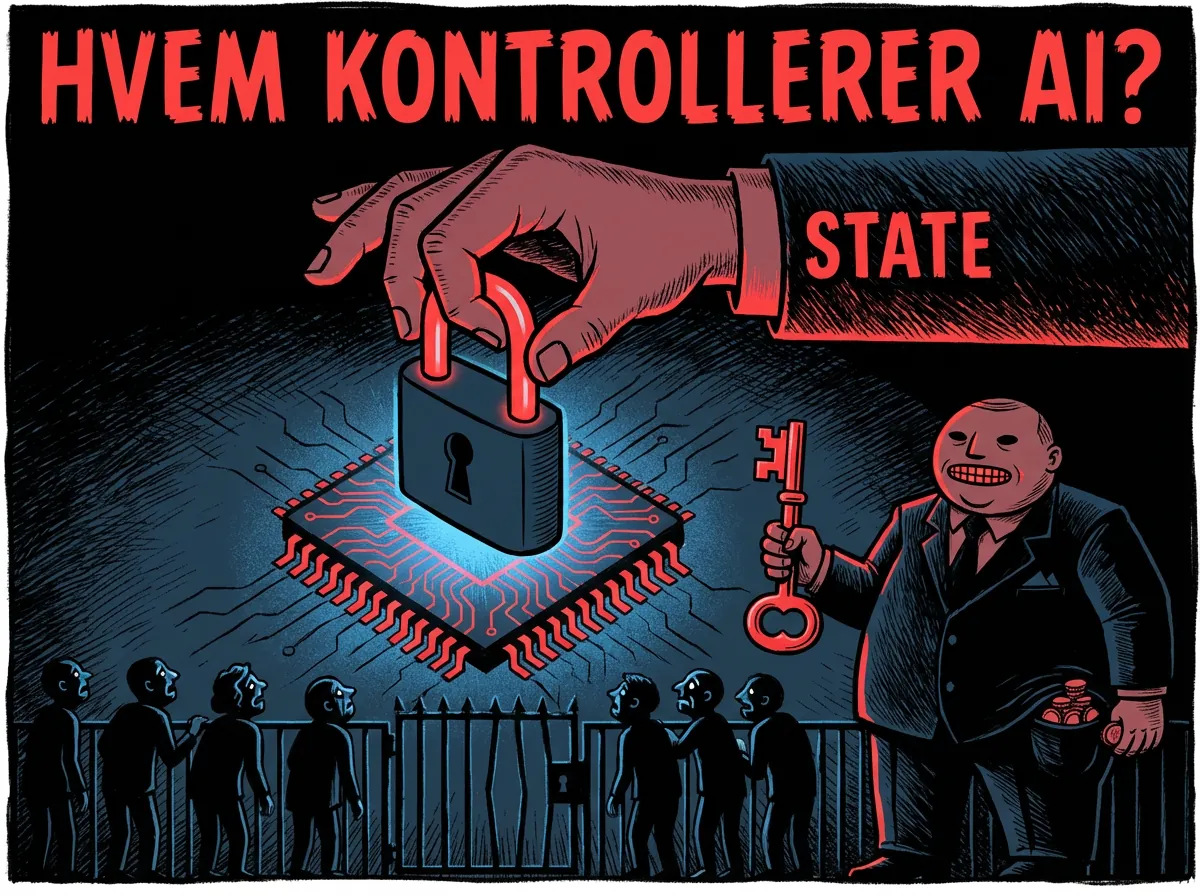

Statens monopol på AI – det skremmende scenariet

Jeg er ikke bekymret for AI i seg selv. AI er et verktøy – og et fantastisk ett. Det jeg er bekymret for er hvem som kontrollerer det.

Altmans prosjekt peker i en retning: AI skal bli regulert av stater, finansiert av skattebetalere gjennom fond, og kontrollert av en liten gruppe selskaper som er store nok til å navigere det regulatoriske landskapet. Vanlige folk – du og jeg – ender opp som konsumenter av det staten og Altmans venner godkjenner.

Tenk på hva som skjedde med atomkraft. Teknologien eksisterer. Den er kraftig. Men den er effektivt monopolisert av stater og store aktører. Du kan ikke bygge en reaktor i garasjen. Du kan ikke starte et atomkraftverk som konkurrerer med statens løsning. Regulering sørget for at det er umulig.

Det er det Altman vil gjøre med AI. «Snille onkel stat» får reguleringsmakt, skattemakt og fondsmakt. I praksis betyr det at AI-verktøyene som ikke passer inn i det politisk godkjente rammeverket, forsvinner. Open source-modeller som er «for kraftige» blir forbudt. Bildegenereringsverktøy som myndighetene ikke liker, stenges ned. Det er allerede i gang – og det er ikke tilfeldig at Altman lobbyerer for nettopp denne typen regulering.

Han fyller ikke statskassen av snillhet. Han bygger en vold rundt sitt eget marked.

Insiderne hadde rett – selvfølgelig stoler de ikke på ham

Tilbake til utgangspunktet: Insiderne som ikke stoler på Sam Altman har rett. Det er ikke mystisk. Det er ikke sjalusi eller intern politikk. Det er en konsekvent observasjon fra folk som har jobbet nær ham over tid – fra Loopt til Y Combinator til OpenAI.

Mønsteret er det samme overalt: Altman sier det folk vil høre, bygger tillit, og handler deretter etter egne interesser. Han fortalte investorer at OpenAI var non-profit og for menneskeheten. Han fortalte sikkerhetsteamet at sikkerhet var prioritet. Han fortalte offentligheten at AI burde være «open». Ingen av disse løftene holdt.

Jeg har skrevet om OpenAI mange ganger. Om funding-galskapen på 850 milliarder. Om reklame i ChatGPT som Altman alltid sa han hatet. Om hans utfall mot Anthropic for å være «uærlige» – dette mannen som ifølge 100 kilder lyver konsekvent.

Det er et mønster her. Og det mønsteret sier at mannen som vil gi staten kontroll over AI, er den siste personen som burde ha den kontrollen selv.

Teknologien er god. AI er et av de kraftigste verktøyene menneskeheten noen gang har laget. Men makten over den teknologien bør ikke ligge hos en mann som ifølge de som kjenner ham best ikke kan stoles på – og absolutt ikke hos statene han vil gi den til. Åpne modeller, konkurranse og desentralisering er svaret. Altmans New Deal er problemet.