Innhold Vis

Stash er et åpen kildekode-minnelag for AI-agenter, lansert av utvikleren alash3al med Apache 2.0-lisens. Ideen er enkel: AI-agenter som Claude og ChatGPT kan huske ting mellom sesjoner på sine egne plattformer – men hva med agentene du bygger selv? Stash er ment å gi akkurat den samme funksjonaliteten til alle.

Prosjektet dukket opp på Hacker News med 182 poeng og skapte en god diskusjon. Konseptet treffer noe mange som bygger AI-agenter kjenner på: agenten starter blankt hver gang, husker ingenting, og du sitter der og limer inn kontekst manuelt gang etter gang.

Her er hva Stash faktisk er, hva det gjør bra – og hva fellesskapet mener det ikke gjør.

Hva er Stash?

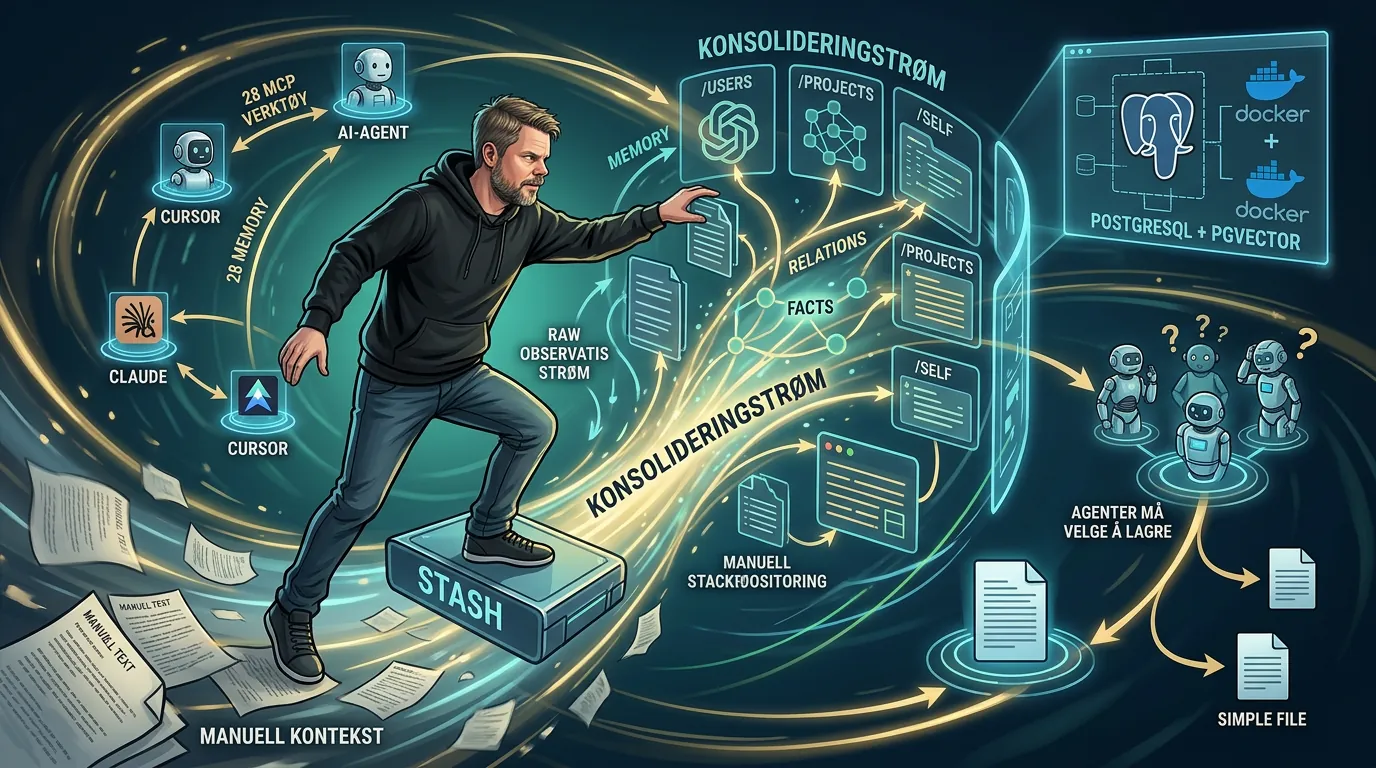

Stash beskriver seg selv som «a persistent cognitive layer that sits between your AI agent and the world.» I praksis betyr det en database som husker ting agenten din har lært, mellom sesjoner. Ikke bare enkle tekstnotater – systemet er designet for å organisere informasjon i et hierarki med navnerom som /users, /projects og /self.

Det som skiller Stash fra en vanlig notatbok er en «konsolideringspipeline» som forsøker å gjøre råobservasjoner om til strukturert kunnskap: fakta, relasjoner, kausale lenker, mønstre – og oppdager selvmotsigelser. Tanken er at agenten ikke bare lagrer tekst, men faktisk lærer over tid.

Teknisk sett er det bygget på PostgreSQL med pgvector for vektorsøk, og kommer med 28 MCP-verktøy som kobler seg til Claude Desktop, Cursor og andre MCP-kompatible klienter. Installasjon er tre Docker Compose-kommandoer. Støtter OpenAI-kompatible APIer, Ollama, OpenRouter, Groq, vLLM, LM Studio og Together AI.

Hva kan Stash gjøre for AI-agenter?

Dokumentasjonen lister opp noen konkrete funksjoner som er verdt å kjenne til:

- Målsporing – agenten husker brukerens intensjoner på tvers av uker, ikke bare i én samtale

- Selvmodell – agenten kan bygge opp forståelse av egne evner, begrensninger og preferanser over tid

- Feilmønsterdeteksjon – systemet stopper agenten fra å gjenta de samme feilene

- Konsolidering – råobservasjoner komprimeres til strukturert kunnskap

Det er ambisiøse mål. Og det er akkurat her ting blir interessant, fordi Hacker News-fellesskapet hadde mye å si om avstanden mellom ambisjon og virkelighet.

Hva sier utviklerne som har testet det?

Den viktigste innvendingen som dukket opp i kommentarfeltet var enkel og direkte: Stash gjør ikke det tittelen lover. En kommentator påpekte at Claude.ai sitt minnesystem bruker bakgrunnsagenter som automatisk oppsummerer chathistorikk – uten at brukeren eller agenten trenger å gjøre noe. Stash krever at agenten selv bestemmer seg for å lagre minner. Det er en vesentlig forskjell.

«It’s not Claude.ai’s memory system…it’s just a store/remember system» – og det er egentlig ganske presist.

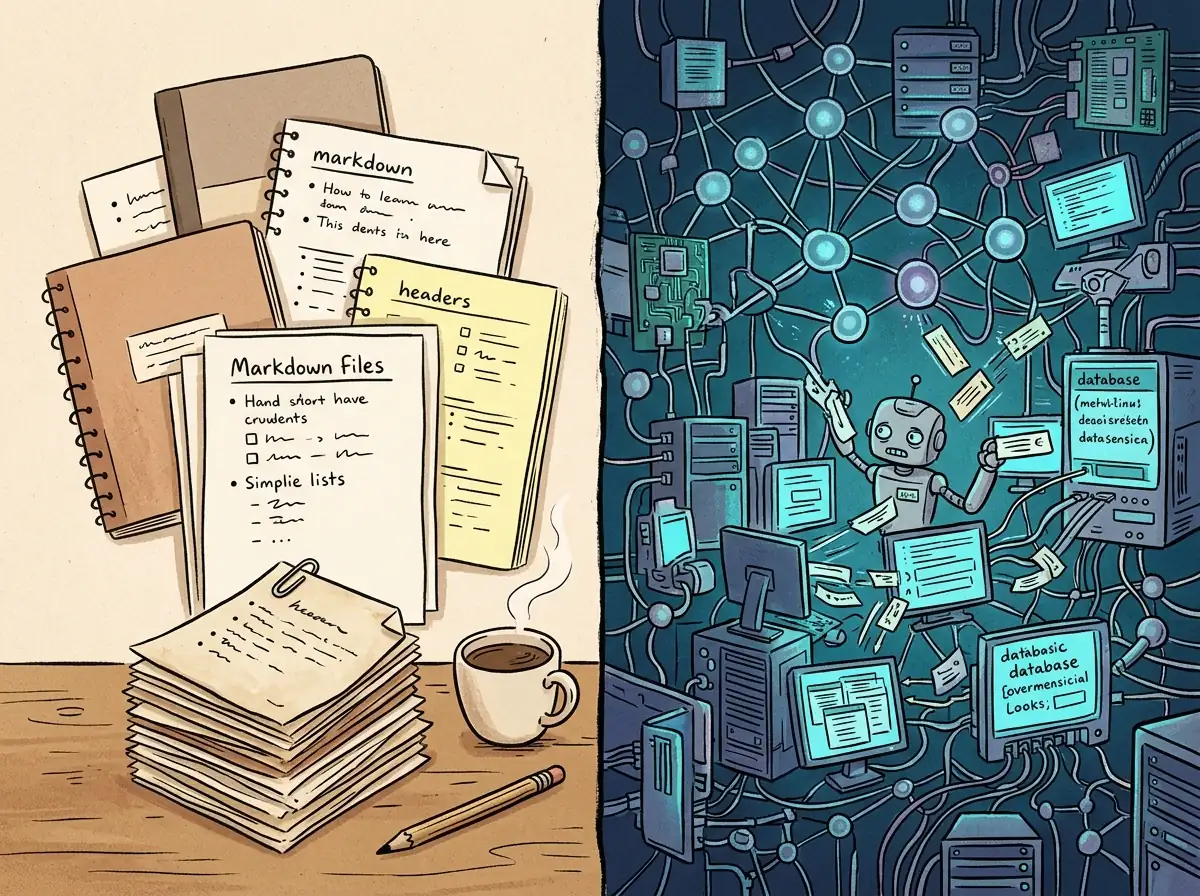

Denne typen minnelagring er ikke ny. Det finnes hundrevis av konkurrerende løsninger for AI-agentminne, fra enkle markdown-filer til fullblods vektordatabaser. Og her er et poeng som går igjen i diskusjonene: mange utviklere rapporterer at manuelt kuraterte minner – altså enkle tekstfiler du selv skriver – faktisk fungerer bedre enn automatiserte systemer. Fordi du vet hva som er viktig. Agenten gjetter.

Det er heller ingen benchmarks eller dokumentasjon som viser at Stash presterer bedre enn alternativene. For et system som lover å revolusjonere agentminne, er det en svakhet.

Fungerer MCP-integrasjonen?

28 MCP-verktøy er et imponerende tall. Siden jeg allerede er kjent med Claude Managed Agents og MCP-arkitekturen, er dette den delen av Stash jeg synes er mest interessant. MCP er blitt standarden for verktøyintegrasjon – og et system som eksponerer minneoperasjoner som MCP-verktøy kan i prinsippet kobles til nesten alt.

Men PostgreSQL-avhengigheten bekymrer litt. For et prosjekt som skal senke terskelen for å gi agenter minne, er en Postgres-instans med pgvector ikke akkurat «bare installer og kjør». Docker Compose hjelper, men det er fortsatt overhead for folk som vil ha noe enkelt.

Alternativt finnes det enklere løsninger. Octopoda er et eksempel på en lokal minneløsning som ikke krever sky eller kompleks oppsett. For lokale agenter kan det være et bedre utgangspunkt enn Stash.

Er persistente agentminner et uløst problem?

Det korte svaret er ja. Persistente agentminner er fortsatt et uløst problem, og det er nettopp derfor vi ser hundrevis av prosjekter som forsøker å løse det på ulikt vis. Claude.ai og ChatGPT har kommet langt med automatisk konteksthåndtering – men det er proprietære løsninger du ikke kontrollerer selv.

Det åpne spørsmålet er om det skal løses i ett generelt system, eller om det alltid vil være oppgave-spesifikt. En agent som hjelper deg med koding har helt andre minnebehov enn en agent som koordinerer arbeidsflyten din. En universell minnedatabase høres elegant ut – men i praksis risikerer den å bli en bøtte med halvstrukturert rot.

En kommentator i HN-tråden oppsummerte det presist: å fortelle AI-en din å selv vurdere hva som er verdt å huske, og når det skal lagres, har fungert overraskende godt i praksis. Det er ikke rakettforskning. Noen ganger er det beste systemet det enkleste.

Stash er et seriøst forsøk på et reelt problem. Apache 2.0-lisens, åpen kode, aktiv utvikling – det er de rette ingrediensene. Om det faktisk holder det det lover, og om det skiller seg ut i et overfylt marked, vil komme frem av erfaringer fra folk som kjører det i produksjon over tid. Prosjektet er verdt å følge med på – men ikke kast ut de markdown-filene ennå. Se også oversikten over open source AI-verktøy for mer kontekst rundt dette landskapet, og Open Swarm for et annet perspektiv på agentarkitektur.