Innhold Vis

Octopoda er et åpen kildekode-minnelag for lokale AI-agenter. Ingen sky. Ingen API-nøkler. Ingen data som forlater maskinen din. Det løser et problem alle som har bygget agenter kjenner: agenten husker ingenting mellom sesjonene – du starter på nytt hver gang du starter programmet på nytt.

Prosjektet dukket opp på r/LocalLLaMA og har truffet en nerve. Det er ikke vanskelig å forstå hvorfor. Persistent minne er kanskje det enkeltproblemet som skiller en faktisk nyttig AI-agent fra en som bare er en glorifisert chatbot.

Installasjonen er ett steg: pip3 install octopoda-memory. Versjonen som ligger ute er 2.0.1 og kom i mars 2026. Under panseret bruker den FastAPI, uvicorn og pydantic – vanlig moderne Python-infrastruktur.

Hva er egentlig problemet med AI-agentminne?

Når du kjører en lokal AI-agent – enten det er en Ollama-instans, en Clippy-wrapper, eller noe du har bygget med LangChain – så finnes konteksten kun mens prosessen lever. Avslutt terminalen, og alt er borte.

Det finnes selvfølgelig mange «løsninger» på dette. De fleste er varianter av det samme: en JSON-fil, en SQLite-database, eller bare et system der du manuelt laster inn kontekst fra forrige sesjon. Det fungerer. Det er bare.. litt håndlaget. Og krasjsikkert er det definitivt ikke.

Octopoda er forsøket på å bygge dette ordentlig. Ifølge skaperen selv: «I kept building hacky workarounds for this so eventually I just built a proper solution.»

Hva gjør Octopoda annerledes?

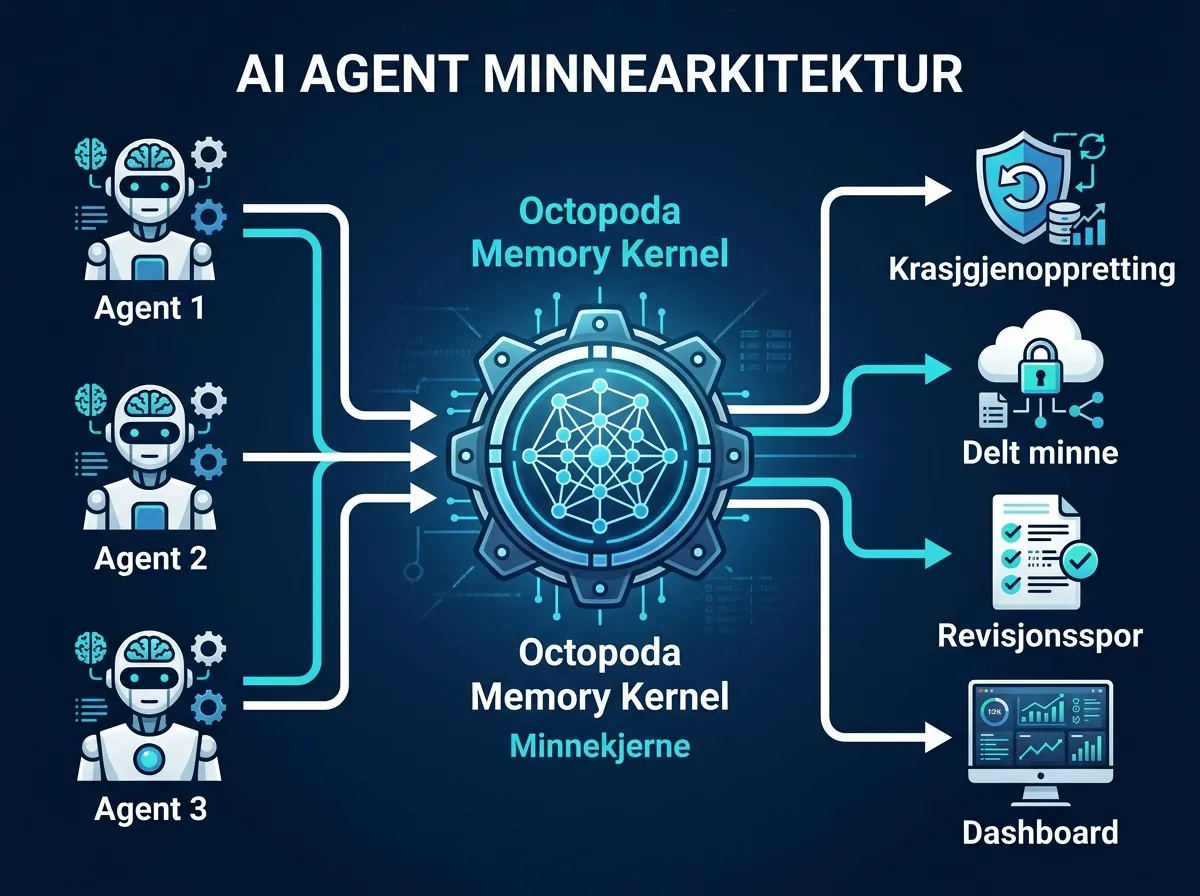

Det som skiller Octopoda fra andre minneløsninger er kombinasjonen av fire ting:

- Krasjgjenoppretting – minnet overlever ikke bare omstarter, det overlever krasj. Agenten kan gjenoppta der den slapp selv etter en uventet avslutning.

- Delt minne – flere agenter kan dele samme minnelager. Én agent skriver, en annen leser. Det åpner for agentkoordinering uten å sende alt gjennom et sentralt API.

- Revisjonsspor – du kan se hva som ble lagret, når, og av hvem. Det er praktisk når ting oppfører seg rart og du vil forstå hva agenten har «lært» seg.

- Sanntidsdashboard – et grensesnitt der du kan inspisere minnelageret mens agentene kjører. Ikke bare loggfiler du graver gjennom etterpå.

Arkitekturen er HTTP-basert via FastAPI – det betyr at hvilken som helst agent som kan gjøre HTTP-kall kan bruke minnelaget, uansett hvilket rammeverk du bruker.

Sammenligning: Octopoda vs de andre minneverktøyene

Det er ikke mangel på løsninger i dette rommet. Mem0 er det mest kjente alternativet – det bruker et LLM til å ekstrahere diskrete fakta fra samtaler og lagrer dem som embeddings. Det er en elegant tilnærming, men det krever et LLM for selve minneoperasjonene, noe som kan bli dyrt og tregt.

CtxVault er et annet solid alternativ som bruker ChromaDB og sentence-transformers lokalt. Styrken er «vault»-konseptet der du kan isolere minne per agent eller per prosjekt. Svakheten er at det ikke har krasjgjenoppretting eller revisjonsspor.

Octopoda posisjonerer seg som en mer robust infrastrukturkomponent – nærmere en «minnekjerne» enn et søkeverktøy. Tanken er at det skal kjøre som en bakgrunnstjeneste, på linje med en database, og at agentene dine kobler seg til det via HTTP.

Er dette faktisk nyttig for deg?

Spørs hva du driver med. Hvis agenten din er en enkel chatbot som hjelper deg med å skrive e-poster, er persistent minne overkill. Du trenger ikke krasjgjenoppretting for noe du bruker i fem minutter.

Men hvis du bygger noe mer ambisiøst – en agent som henter informasjon over tid, koordinerer med andre agenter, eller utfører oppgaver som tar timer – da begynner persistent minne å bli fundamentalt. Ikke en nice-to-have, men en forutsetning.

Det er her dette prosjektet er interessant. Det retter seg mot det neste steget i lokal AI-utvikling: agenter som faktisk lever over tid, ikke bare i én terminal-sesjon.

Kom i gang på fem minutter

Octopoda krever Python 3.9 eller nyere. Installasjon:

pip3 install octopoda-memory

Det trekker inn uvicorn, FastAPI, flask og pydantic. Ingen CUDA-krav, ingen GPU, ingen tunge modeller. Det er ren infrastruktur – minnelageret selv trenger ikke et LLM for å fungere.

Du starter minneserveren, og agentene dine kommuniserer med den via HTTP. Revisjonssporet og dashboardet er tilgjengelig umiddelbart. Delt minne fungerer bare ved at to agenter peker mot samme server-instans.

Kildekoden ligger tilgjengelig og prosjektet er aktivt vedlikeholdt. For de som vil grave: PyPI-pakken octopoda-memory er startpunktet.

Det er litt tidlig i utviklingen, så forvent noen ragged edges. Men selve ideen er riktig. Lokale AI-agenter fortjener ordentlig minneinfrastruktur – ikke JSON-filer du husker å laste inn manuelt. Octopoda er et steg i den retningen.

1 kommentar