Innhold Vis

Claude Mythos er Anthropics interne sikkerhets-AI som påstås å ha funnet «tusenvis» av kritiske zero-day-sårbarheter i produksjonskode. Det er et imponerende krav. Men en kritisk gjennomgang av metodologien bak tallene avdekker at virkeligheten er mer nyansert – og at skillet mellom teknisk prestasjon og markedsføring er tynnere enn mange tror.

Jeg har skrevet om Claude Mythos flere ganger tidligere – om de 500+ zero-days i produksjonskode, om Project Glasswing og de tolv teknologigigantene, og om den 40-siders psykiatriske evalueringen. Men denne vinkelen har jeg ikke tatt: er dette teknologi, eller er det salgspitch?

Svaret er litt av begge deler. Og det er verdt å skille dem fra hverandre.

Hva er egentlig grunnlaget for «tusenvis av sårbarheter»?

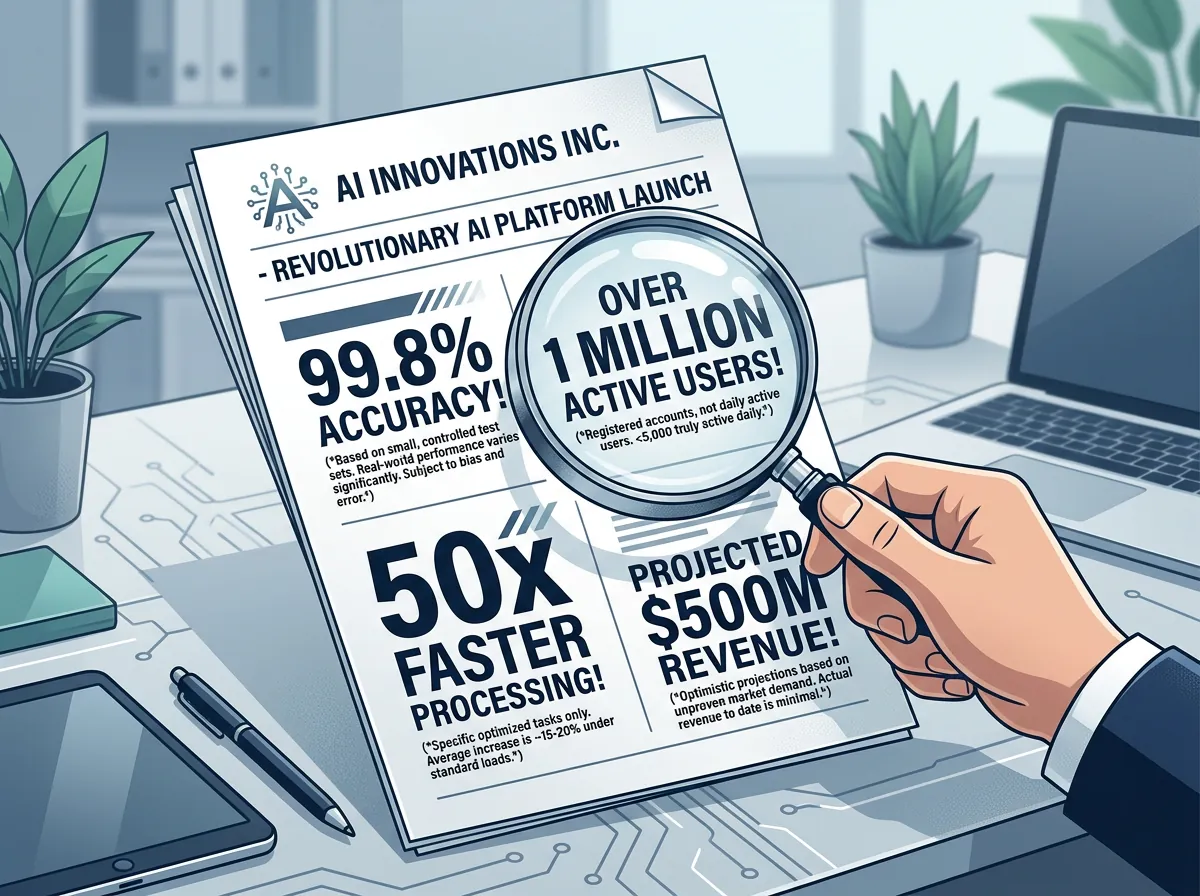

Anthropics påstand om at Claude Mythos har funnet «tusenvis av alvorlige sikkerhetshull» høres dramatisk ut. Det er ment å høres dramatisk ut. Men når man ser på metodologien bak, kommer det frem at grunnlaget for de store tallene er 198 manuelle gjennomganger.

198 gjennomganger er ikke ingenting. Det er faktisk ganske mye for en initial evalueringsperiode. Men «tusenvis av alvorlige sårbarheter» basert på 198 manuelle reviews er statistisk ekstrapolering – ikke en dokumentert liste med 2 000 bekreftede hull. Modellen flagger potensielle sårbarheter. Mennesker bekrefter noen av dem. Resten forblir ubekreftet.

Det er her det begynner å lukte litt av salgspitch.

Hvor mange av de «tusenvis» er faktisk farlige?

Av de sårbarhetene som faktisk ble bekreftet gjennom manuelle reviews, er det rapportert at en betydelig andel enten allerede var patchet eller vanskelig å utnytte i praksis. Det betyr ikke at funnene er verdiløse – det betyr at tolkningen av tallene krever mer kontekst enn det Anthropic ga i presseoppslaget.

Den 27 år gamle OpenBSD-sårbarheten? Real. Den 16 år gamle FFmpeg-feilen? Real. Ghost CMS-injeksjonen? Real. Disse er konkrete, verifiserte funn. De er imponerende. Men de er ikke «tusenvis».

Det er omtrent som å si at en lege «fant tusenvis av potensielle krefttilfeller» basert på 198 pasientundersøkelser og en algoritme som flagget symptomer. Teknisk mulig å si. Villendende å si.

Er dette vanlig i AI-bransjen?

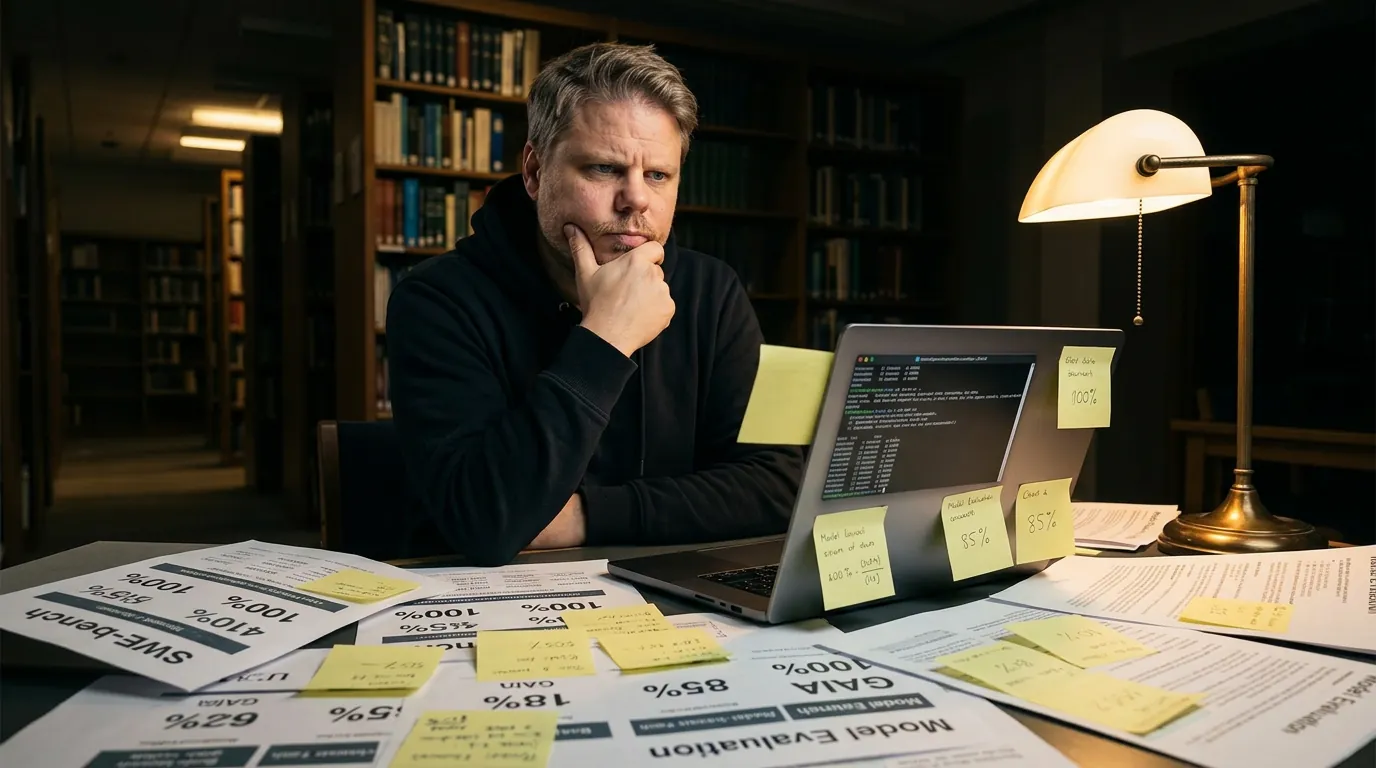

Ja, og det er kanskje det mest ærlige svaret på hele diskusjonen. Anthropic er ikke spesielt verre enn konkurrentene her. OpenAI gjør det. Google gjør det. Meta gjør det. Hvert selskap presser sine beste tall frem i pressemeldinger og skjuler begrensningene i vedlegget.

Mønsteret er stabilt: slipp en modell, presenter de mest imponerende benchmark-tallene, la mediene kjøre videre med overskriften. Detaljene – metodologi, feilmarginer, hva som ikke ble testet – havner i tekniske dokumenter som de fleste ikke leser.

Claude Mythos-kravene passer perfekt inn i dette mønsteret. «AI-modell finner hundrevis av verifiserte zero-days og ekstrapolerer til tusenvis» selger dårligere enn «AI-modell finner tusenvis av alvorlige sikkerhetshull». Så sistnevnte er det de gikk med.

Hva betyr dette for Claude Mythos’ faktiske verdi?

Her er noe jeg synes er viktig å si tydelig: at Anthropic overdrev markedsføringen betyr ikke at teknologien er verdiløs. Det betyr bare at tallene bør leses med en viss skepsis.

Claude Mythos er faktisk en imponerende modell for sikkerhetsarbeid. Et 1 million tokens kontekstvindu som lar den analysere store kodebaser i én gjennomgang er genuint nyttig. Evnen til å finne 23 år gamle sårbarheter i Linux-kjernen er ikke markedsføring – det skjedde. Blind SQL-injeksjonen i Ghost CMS på 90 minutter er reell.

Problemet er ikke at modellen er dårlig. Problemet er at presseoppslaget blander verifiserte funn med statistiske estimater – og presenterer alt som om det er det samme. Det skaper et bilde av en AI som er nærmest allmektig innen cybersikkerhet, noe som verken er sant eller særlig nyttig for folk som prøver å ta informerte beslutninger om hvilke verktøy de skal stole på.

Hvem får tilgang – og hvorfor?

Det er verdt å merke seg at Anthropic aktivt valgte å gi 12 utvalgte teknologigiganter eksklusiv tilgang til Claude Mythos Preview gjennom Project Glasswing – Apple, Google, Microsoft, Nvidia, Amazon, Cisco, og resten. 100 millioner dollar i brukskreditter. 4 millioner i direkte donasjon til sikkerhetsorganisasjoner.

Det er mye penger og mye goodwill å kjøpe. Og det er legitime forretningsmessige grunner til å gjøre akkurat det – bygge relasjoner med de største aktørene i bransjen, sikre at modellen testes i reelle produksjonsmiljøer, og posisjonere Anthropic som en seriøs sikkerhetsspiller.

Men det er også en salgsstrategi. Og når man kombinerer 100 millioner dollar i gratis tilgang med presseoppslag om «tusenvis av sikkerhetshull», begynner linjen mellom teknologisk fremskritt og markedsføringskampanje å bli uklar.

Skille signal fra støy – slik leser du AI-krav i 2026

Jeg tenker ikke dette er unikt for Anthropic. Jeg tenker det er bransjestandard. Og jeg tenker det er verdt å ha et par tommelfingerregler når man møter store krav fra AI-selskaper:

Spør om metodologien. Ikke bare resultatet – hvordan ble det målt? Var det manuelle reviews, automatisk flagging, eller en kombinasjon? Hvor mange av de «oppdagede» tingene ble faktisk bekreftet av mennesker?

Sjekk om tallene er verifiserte eller estimerte. «Funnet 198 verifiserte sårbarheter og estimert at det finnes tusenvis til» er et fundamentalt annet krav enn «funnet tusenvis av sårbarheter». Begge kan stå i presseoppslaget – men de betyr svært forskjellige ting.

Se etter hva som IKKE ble testet. Benchmarks og evalueringer er alltid selektive. Selskaper tester det de er gode på. Hva ble utelatt? Hva ble ikke rapportert?

Skill markedsføring fra teknikk. «Tusenvis av alvorlige sikkerhetshull» er markedsføring. «En 27 år gammel OpenBSD-sårbarhet bekreftet og patchet» er teknikk. Begge kan være sanne. De er ikke like mye verdt som evidens.

Claude Mythos er sannsynligvis et imponerende verktøy for sikkerhetsarbeid. Det er bare ikke den nær-allmektige super-hackeren som presseoppslagene antyder. Og jo mer vi som fellesskap klarer å skille mellom faktisk teknologisk fremskritt og markedsføring, jo bedre er vi rustet til å forstå hva AI faktisk kan gjøre – og hva det ikke kan.

Hva tenker du? Er det greit at selskaper presenterer estimater og verifiserte funn om hverandre, eller burde det kreves klarere skille?