Innhold Vis

En utvikler har fått en ekte transformer-basert språkmodell til å kjøre på en umodifisert Game Boy Color – uten PC, telefon, Wi-Fi eller skyinfrastruktur. Modellen som kjører er Andrej Karpathys TinyStories-260K, en Llama 2-basert minimodell med 260 000 parametere trent på enkle barnestoriehistorier. Cartridgen booter en ROM, og Game Boy-en kjører selve inferensen.

Dette er ikke et triks, ikke en emulator på en telefon skjult bak et Game Boy-skall. Det er faktisk en 8-bit Z80-kompatibel prosessor som gjør transformer-matematikk i 2026. Jeg synes dette er sinnssykt fascinerende – og litt absurd på den beste måten.

Prosjektet dukket opp på LocalLLaMA-subredditen og skapte umiddelbar oppmerksomhet. Og med god grunn: det er en av de mest kreative edge AI-demonstrasjonene jeg har sett på lenge.

Hva er TinyStories-260K og hvorfor er det akkurat den som fungerer?

Karpathy lanserte TinyStories-serien som del av llama2.c-prosjektet – en minimalistisk C-implementasjon av Llama 2 ment for å forstå språkmodeller fra bunnen av. Den minste varianten, 260K-modellen, er en Llama 2-arkitektur presset til det absolutt minste som fortsatt produserer meningsfull tekst.

260 000 parametere. Til sammenligning har selv de minste moderne modellene du kan laste ned via Ollama typisk 350 millioner eller mer. TinyStories-260K er ikke ment for ChatGPT-konkurranse – den er ment for å demonstrere at transformerarkitekturen faktisk fungerer i ekstrem miniaturform.

Teksten den genererer handler om enkle historier. Setningsstruktur og grammatikk er overraskende stabil for noe så lite. Den er ikke smart – men den er en ekte transformer, og det er poenget.

Hvordan er det teknisk mulig på en Game Boy Color?

Game Boy Color har en Sharp LR35902-prosessor som kjører på 8 MHz, 32 KB intern RAM, og er designet for å kjøre Pokémon Crystal og Zelda: Oracle of Ages – ikke matrisemultiplikasjon i float32.

Her er det smarte grepet: vektene er konvertert til INT8 med fixed-point matematikk. Ingen floating point. Det betyr at all matematikken kan gjøres med heltallsoperasjoner, noe en Z80-kompatibel 8-bit prosessor faktisk kan håndtere – bare sakte.

Selve implementasjonen er bygget med GBDK-2020 som et MBC5 Game Boy ROM. MBC5 er en Memory Bank Controller – en chip i cartridgen som lar Game Boy-en veksle mellom ulike minnebanker. Det er slik man historisk fikk Pokémon-spill til å passe på en liten cartridge. Her brukes det til å lagre modellvektene fordelt over mange minnebanker i cartridge-ROM-en.

Selve flyten er elegant:

- Cartridgen booter ROM-en

- Brukeren skriver inn en prompt via et på-skjerm tastatur styrt med D-pad og knapper

- Game Boy-en tokeniserer prompten lokalt

- Inferens kjøres på enheten – ingen ekstern hjelp

- Tekst genereres tegn for tegn på den lille pikselskjermen

Det finnes ingen trådløs forbindelse, ingen USB-tilkobling, ingen skjult Raspberry Pi. Alt skjer i den lille plastikkboksen fra 1998.

Er ytelsen brukbar?

Nei. Ikke om du er vant til moderne modeller. Men det er heller ikke poenget.

Game Boy Color-en er ikke rask. Den genererer trolig noen få tokens i sekundet – kanskje ett token hvert par sekunder. For en 8-bit prosessor som gjør transformer-inferens i 1999-era hardware er dette ikke en svakhet, det er et teknisk mirakel.

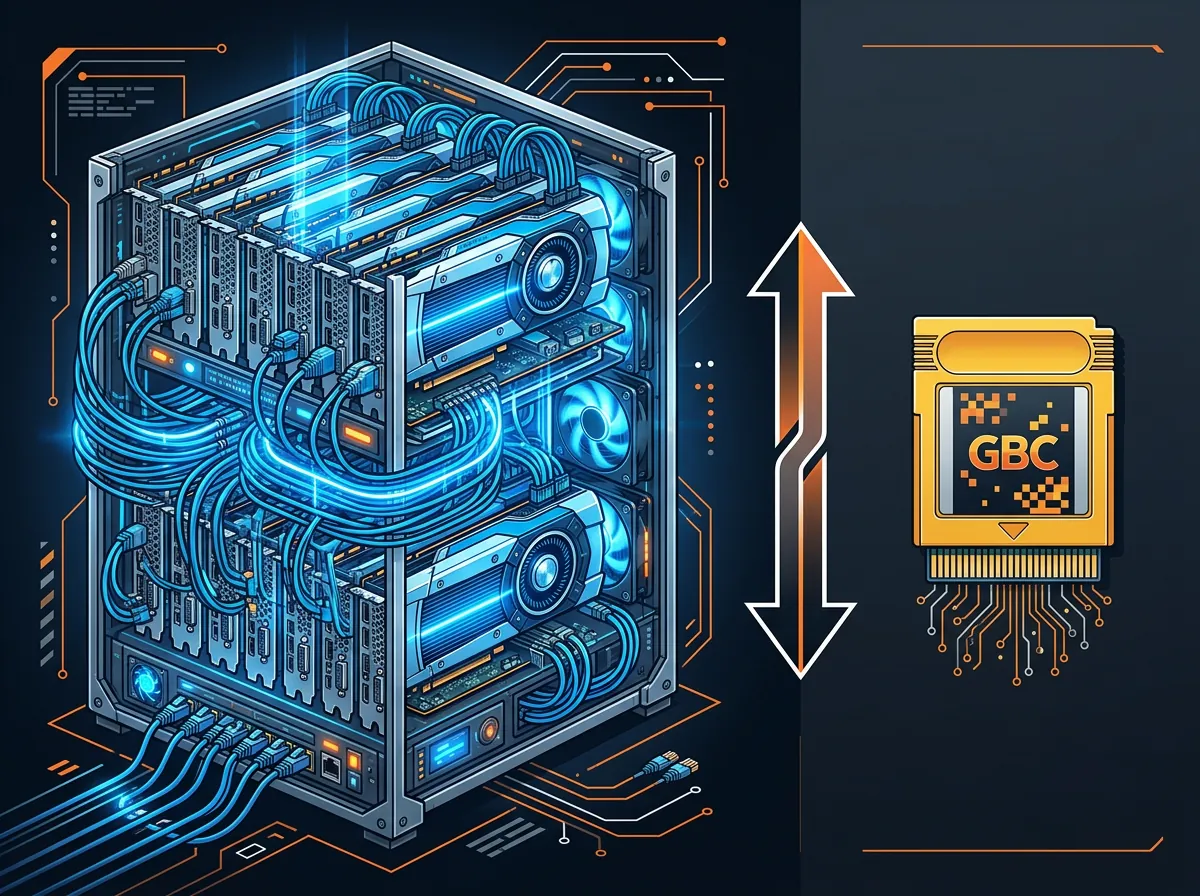

Til sammenligning: en RTX 4090 kan generere hundrevis av tokens per sekund med en 7 milliarder parametersmodell. Game Boy Color har 32 KB RAM og 8 MHz prosessorkraft. Poenget er ikke hastighet – poenget er at arkitekturen faktisk kan kjøre på nær hvilken som helst prosessor, så lenge du er villig til å vente.

Det minner litt om den lille AI-revolusjonen vi snakker om med edge-modeller – bare tatt til sin logiske (og absurde) ytterkant.

Hva sier dette om transformer-arkitekturens eleganse?

Dette er egentlig det mest interessante spørsmålet. Transformer-arkitekturen ble designet for kraftige GPU-er med terabytes av minne og milliarder av parametere. Allikevel er den matematiske kjernen – matrisemultiplikasjon, softmax, oppmerksomhetsmekanismer – generisk nok til å implementeres på en 8-bit prosessor fra slutten av 90-tallet.

Det er ikke ulikt at man tok turbo-motorer fra Formel 1 og installerte dem i en gammel Volkswagen Beetle. Motoren kjører. Akkurat. Sakte. Men den kjører.

Lokal AI-inferens på din egen maskin har blitt stadig mer tilgjengelig de siste to årene – Ollama, llama.cpp, og lignende prosjekter har gjort det mulig å kjøre imponerende modeller på vanlig forbruker-hardware. Game Boy Color-prosjektet er det filosofiske ytterpunktet av den samme ideen: hva er egentlig minimumsbehovet for å kjøre en transformer?

Svaret viser seg å være: ikke særlig mye.

Hva betyr dette for AI på edge-enheter?

Praktisk sett: ingenting direkte. Ingen er i ferd med å sette Game Boy Color-er i produksjon som AI-akseleratorer.

Men prosjektet illustrerer noe viktig. Trenden mot mindre, effektive AI-modeller er reell og akselererer. Modeller som llama2.c og TinyStories viser at Karpathy lenge har utforsket dette rommet – forståelse av AI fra første prinsipper, uten å være avhengig av massive GPU-klynger.

Vi ser det i produkter som kjører AI-modeller på telefoner, smarte briller, hørselsvern og industrielle sensorer. Trenden er klar: AI beveger seg fra skyservere mot kantenheter. Game Boy Color-prosjektet er bare det mest ekstreme eksempelet på at dette faktisk er mulig.

Dessuten: det er godt håndverk. Å kombinere kunnskap om Game Boy-arkitektur, ROM-banking, INT8-kvantisering og transformer-implementasjon til én cartridge er ikke trivielt. Det krever dyp forståelse av begge verdener – den gamle hardware-verdenen og den nye AI-verdenen. Jeg respekterer den typen tverrfaglig nysgjerrighet.

Karpathy og llama2.c – bakgrunnen du bør kjenne

Andrej Karpathy er tidligere AI-direktør hos Tesla og OpenAI-forsker, og er kjent for å lage pedagogiske AI-prosjekter som hjelper folk forstå hvordan teknologien faktisk fungerer. Hans llama2.c er en minimalistisk C-implementasjon av en Llama 2-modell – noen hundre linjer kode som implementerer en hel transformer fra bunnen av.

TinyStories-modellene ble laget spesifikt for dette prosjektet: demonstrere at du ikke trenger milliard-parameter-monstre for å se transformerarkitekturen i aksjon. 260K parametere er nok til å generere grammatisk korrekte setninger om enkle emner. Og tydeligvis nok til å kjøre på en Game Boy Color.

Akkurat den koblingen – llama2.c sin minimalistiske tilnærming møter Game Boy-cartridge-hacking – er det som gjør dette prosjektet mulig. Kode designet for å forstå, ikke for å prestere, viser seg å være bærbar nok for en 26 år gammel spillkonsoll.

Hva tenker du? Er dette den mest unødvendig imponerende AI-demonstrasjonen du har sett, eller er det noe her som faktisk peker mot noe? Send meg gjerne en kommentar. Jeg er nysgjerrig.