Innhold Vis

Et blogginnlegg fra utvikleren Nicky Reinert gikk viralt på Hacker News denne uken – 963 stemmer og 578 kommentarer på én dag. Tittelen sier det meste: han kansellerte Claude-abonnementet sitt etter token-problemer, synkende kodekvalitet og support som ikke fungerte. Innlegget traff en nerve. Kommentarfeltet fylltes opp av utviklere som gjenkjente problemet.

Claude er fortsatt én av de beste AI-modellene på markedet for kodehjelp. Det vet jeg av egne erfaringer. Men noe har endret seg de siste månedene – og Reinerts kritikk peker på konkrete problemer det er verdt å ta på alvor.

Her er hva som skjedde, og hva det faktisk betyr for deg som bruker Claude til koding.

Hva skjedde egentlig med Reinert og Claude?

Reinert er ikke en tilfeldig bruker som ikke skjønner seg på AI. Han har bygget egne verktøy rundt Claude. Han er – eller var – fan av produktet. Likevel kansellerte han.

Problemene hans var tre: Token-grenser som oppfører seg uforutsigbart, synkende kvalitet på svarene, og en kundesupport som ikke virket.

Når det gjelder token-grenser: Reinert beskriver at cachede samtaler forsvant etter pauser, og at han måtte laste inn hele kodebasen på nytt. Han fikk mystiske advarsler om «monthly usage limit» uten noen forklaring i dokumentasjonen. Og den ukentlige kvoten byttet tilbakestillingspunkt – fra dagens dato til mandag – uten at Anthropic informerte om det.

Det er den slags ting som driver en profesjonell bruker til raseri. Ikke fordi én ting er katastrofal, men fordi summen av det er at du ikke kan stole på at verktøyet oppfører seg forutsigbart.

Hva er egentlig problemet med Claude Opus og token-grenser?

Token-grenser er ikke et nytt problem i AI-verdenen. Men det Reinert beskriver er spesifikt: Claude Opus brukte 50% av dagskvoten på ett prosjekt i løpet av to timer. Tidligere klarte han å håndtere tre prosjekter på samme kvote.

Det er ikke nødvendigvis at grensene er lavere – det kan også være at modellen bruker langt flere tokens per svar enn den gjorde. Og her henger token-grenser og kvalitetsfall sammen.

Reinert ga et konkret eksempel: Claude Opus foreslo å injisere verdidisplayer automatisk i HTML i stedet for å endre JSX-koden eksplisitt. Det er akkurat den typen «quick fix» en junior-utvikler ville gjort for å unngå å forstå problemet. En senior-utvikler – eller en god AI-modell – ville gått til roten.

Problemet med slike svar er dobbelt: Du får dårligere kode, og du bruker like mange tokens på det. Det er det verste av to verdener.

Er dette et kjent problem blant Claude-brukere?

Basert på Hacker News-diskusjonen: ja. Reinerts innlegg fikk 963 upvotes og 578 kommentarer på én dag. Det er ikke et tall du oppnår med et randomproblem ingen kjenner seg igjen i.

Kommentarfeltet var delt. Noen kjente seg igjen i problemene. Andre mente at Claude fortsatt er det beste alternativet på markedet og at problemene var isolerte. Noen nevnte at de hadde byttet til GPT-4o eller Gemini av lignende grunner – og kom tilbake til Claude fordi alternativene ikke var bedre.

Det interessante er at diskusjonen ikke handler om at Claude er dårlig i absolutt forstand. Den handler om at Anthropic vokser raskt og muligens ikke klarer å opprettholde kvalitet og support i takt med veksten. Jeg har skrevet om Claude AI priser og abonnementsmodeller tidligere – og prisene er ikke akkurat lave når du betaler for Pro eller Max uten å få forutsigbar kapasitet tilbake.

Hva med kundesupport fra Anthropic?

Her er det vanskelig å forsvare Anthropic. Reinert kontaktet support etter et konkret token-problem. Han fikk et automatisert svar som ikke adresserte spørsmålet hans. Deretter ble saken stengt.

Han testet noe morsomt: Han spurte Claude selv om supportsvaret faktisk hadde besvart kundespørsmålet. Svaret var nei.

Det er litt ironisk – et selskap som bygger verdens beste AI-assistenter bruker en dårlig AI-bot til kundesupport som ikke engang Claude selv godkjenner. Det forteller noe om prioriteringene.

Dårlig support er ikke spesielt for Anthropic – de fleste store tech-selskaper er notorisk dårlige på dette. Men når du betaler for et Pro-abonnement og møter en vegg av automasjon, er det forståelig at du kansellerer.

Hvilke alternativer finnes hvis du er misfornøyd med Claude?

Det korte svaret er: ingen er perfekte, og alternativene har sine egne problemer.

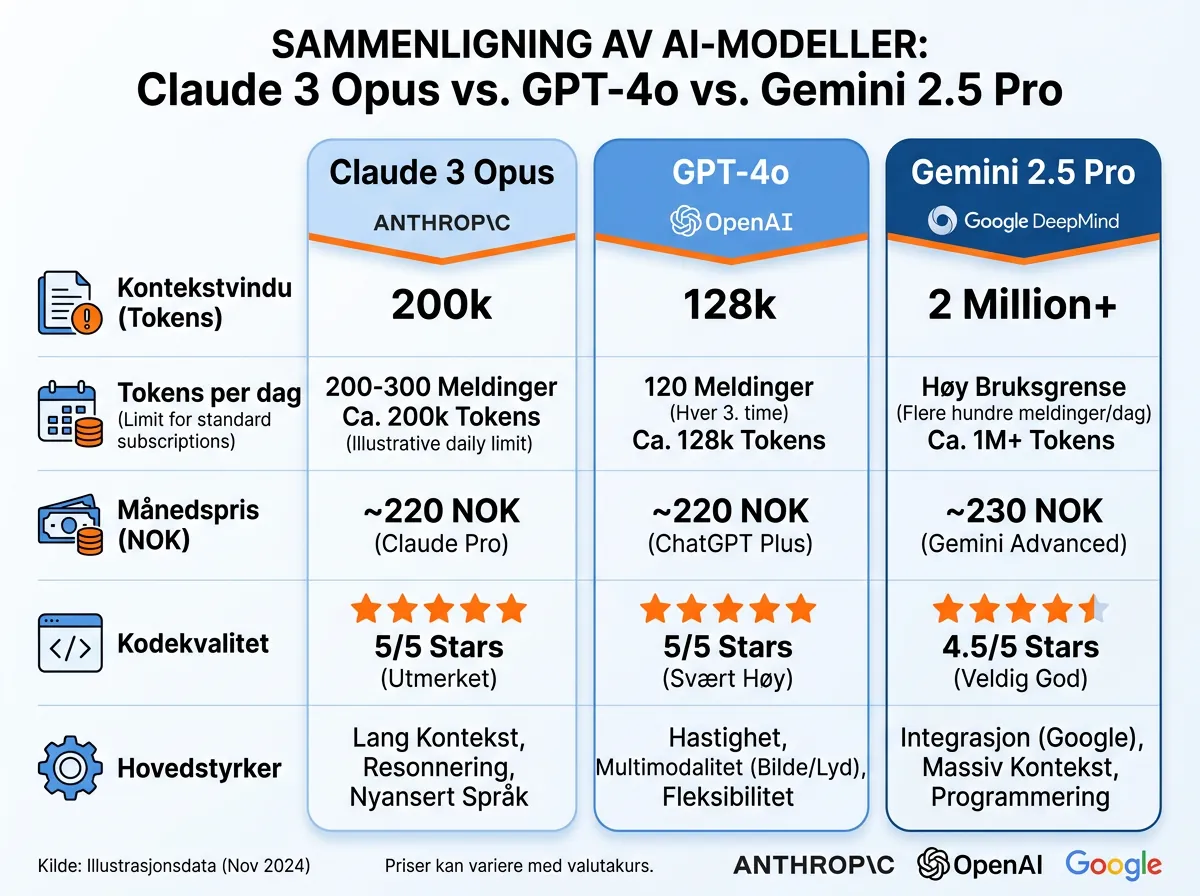

GPT-4o er et åpenbart valg. Den er god på koding, har et stabilt API og OpenAI er mer erfarne med å håndtere stor brukerbase. Men den er ikke alltid bedre enn Claude Opus på komplekse programmeringsoppgaver – den er annerledes.

Gemini 2.5 Pro fra Google er faktisk et undervurdert alternativ akkurat nå. Google har investert tungt i kodekvalitet, og Gemini CLI kan brukes som et gratis alternativ til Claude Code.

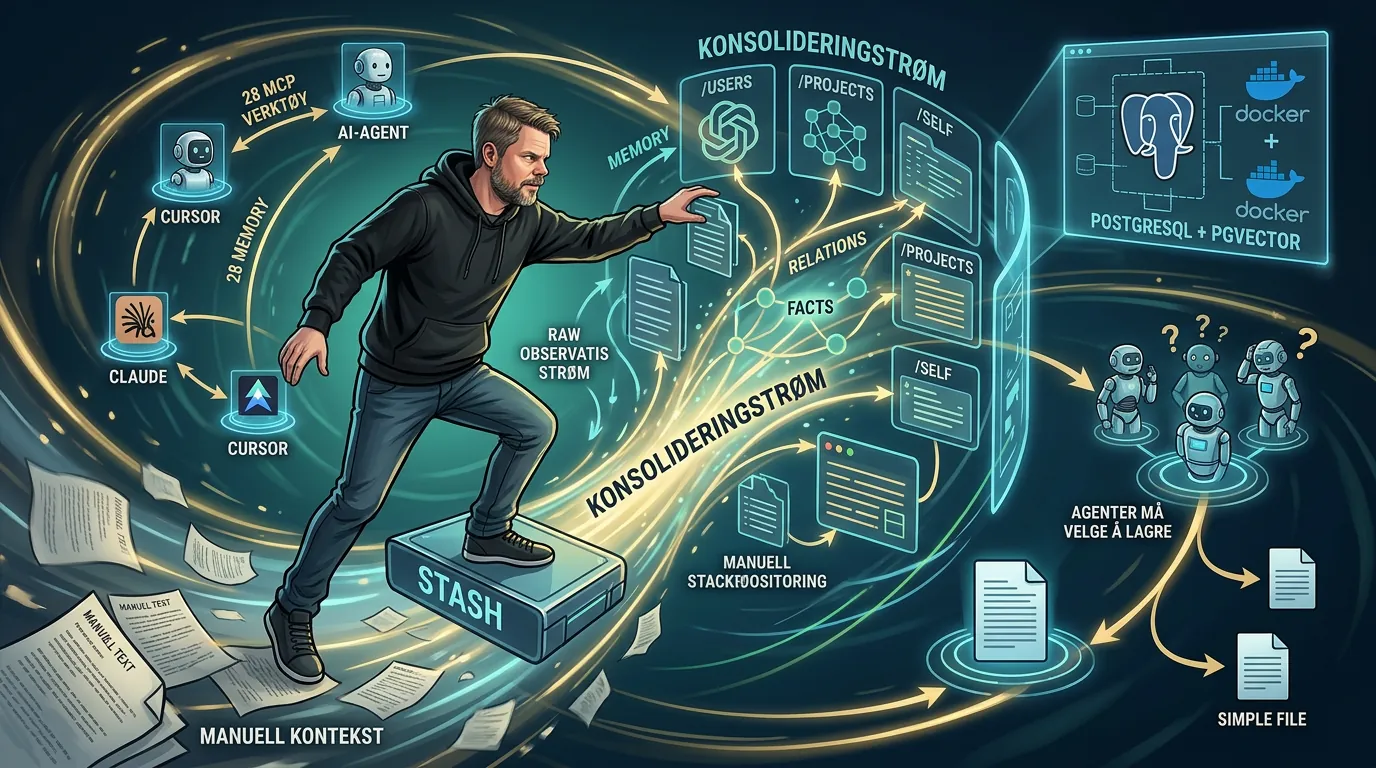

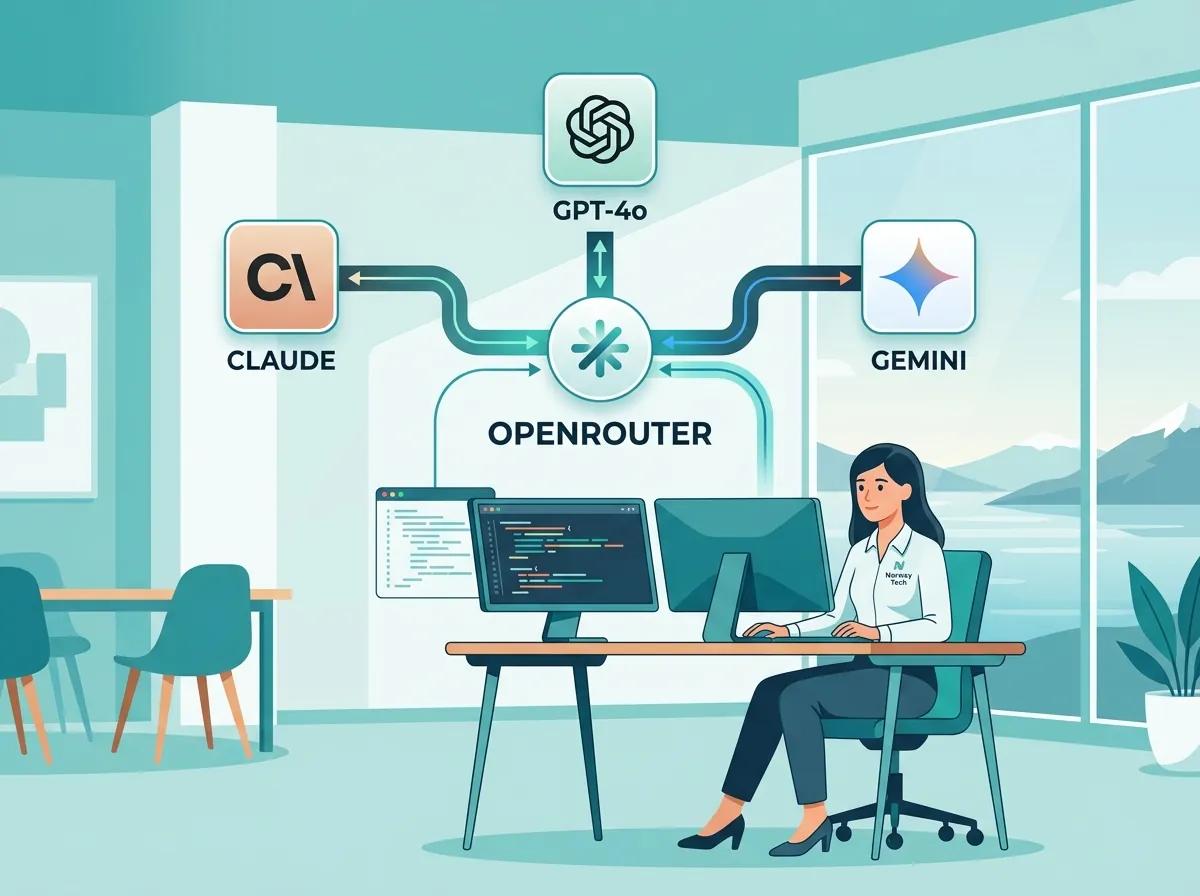

En annen løsning er å ikke låse seg til én leverandør. OpenRouter gir tilgang til hundrevis av modeller via ett API. Når én modell skuffer, bytter du. Det er slik markedet bør fungere.

Jeg har tidligere skrevet en grundig sammenligning av OpenClaw vs Claude Code og Zed og OpenRouter som alternativ til Claude Code Max – begge gir et mer nyansert bilde av kostnadene ved å bruke Claude intensivt.

Hva sier dette om Anthropics situasjon?

Reinert konkluderer med at Anthropic «cannot handle too many new customers at once.» Det er en rimelig hypotese. Anthropic vokser raskt, og Claude Code er blitt et populært verktøy blant utviklere. Rask vekst og konsekvent kvalitet er vanskelig å kombinere.

Men det er også mulig at forventningene har økt. Claude var så imponerende da det ble lansert at standarden er høy. Når modellen gjør noe en junior-utvikler ville gjort, føles det som et tilbakesteg – selv om den fortsatt er bedre enn de fleste alternativer på absolutt basis.

Problemet med token-grenser og uforutsigbar oppførsel er mer bekymringsfullt. Det er ikke et kvalitetsspørsmål – det er et tillitsspørsmål. Du kan jobbe med en modell som noen ganger gir middels svar. Det er mye vanskeligere å jobbe med en modell du ikke vet om er tilgjengelig i morgen med samme kapasitet.

Bør du kansellere Claude-abonnementet?

Det er ditt valg å gjøre. Men her er hva jeg tenker:

Reinerts problemer er reelle. Token-grenser som endrer seg uten varsel, support som ikke fungerer, og svar som er dårligere enn de burde være – det er legitime klager. Og Hacker News-diskusjonen tyder på at han ikke er alene.

Samtidig er Claude fortsatt blant de beste modellene for kompleks koding og resonnering. Spesielt om du bruker det gjennom API direkte og styrer konteksten selv, unngår du mange av begrensningene i standardabonnementet. Og forsto du hvordan språkmodeller faktisk fungerer, er det lettere å jobbe smart med token-begrensningene.

Det smarteste er kanskje ikke å velge mellom Claude og alternativene – men å slutte å bruke bare én. AI-markedet er fullt av gode modeller akkurat nå. Diversifiser. Bruk Claude til det den er god på. Bruk GPT-4o til det den er god på.

Og hvis Anthropic fortsetter å levere dårlig support og uforutsigbare grenser, vil markedet straffe dem. Slik bør det fungere.

Hva er din erfaring med Claude den siste tiden? Kjenner du deg igjen i problemene Reinert beskriver?