Innhold Vis

DeepSeek V4 ble lansert 24. april 2026 – nøyaktig ett år etter at kinesiske DeepSeek rystet AI-bransjen med V3. Det kinesiske selskapet slapp to nye modeller: V4-Pro og V4-Flash. Begge er open source under MIT-lisens, begge støtter 1 million tokens kontekst som standard, og prisnivået er – igjen – lavere enn det som tilbys fra OpenAI, Google og Anthropic.

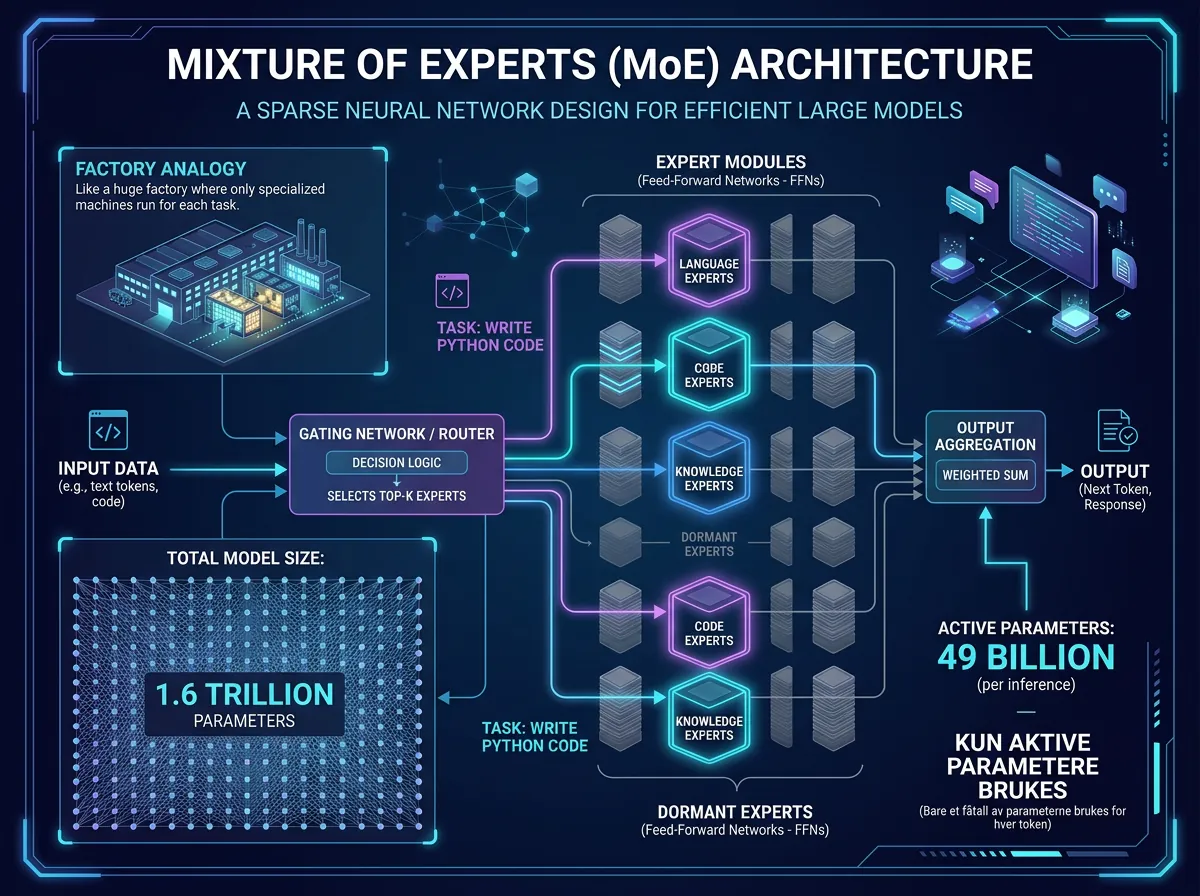

V4-Pro har 1,6 billioner totale parametere (49 milliarder aktive) og benytter Mixture of Experts-arkitektur. V4-Flash er trimmet ned til 284 milliarder totale parametere (13 milliarder aktive) for raskere og billigere kjøring. Begge modellene ligger allerede ute på Hugging Face og kan lastes ned og kjøres lokalt.

API-tilgang er aktiv fra dag én. Er dette en ny «DeepSeek-moment» som sender teknologiaksjene nedover? Antagelig ikke – men det er uansett verdt å se nærmere på hva DeepSeek faktisk har bygget denne gangen.

Hva er nytt i DeepSeek V4?

Det mest oppsiktsvekkende med V4 er at 1 million tokens kontekst nå er standarden, ikke et tillegg boltet på etterpå. DeepSeek kaller det et designvalg de tok fra første linje kode – og det er en ganske stor uttalelse sammenlignet med hvordan de fleste andre modeller er bygget.

Arkitektonisk bruker V4 noe DeepSeek kaller Hybrid Attention Architecture kombinert med Token-wise compression og DSA (DeepSeek Sparse Attention). Resultatet er betydelig lavere beregningskostnad ved lange kontekster. V4-Pro bruker bare 27% av enkelt-token FLOPs sammenlignet med V3.2 ved 1 million tokens – V4-Flash enda mindre, bare 10%. Det er en massiv effektivitetsgevinst.

DeepSeek hevder i sin offisielle dokumentasjon at V4-Pro leverer topp ytelse på kodingsbenchmarks, og at resonneringsevnene er forbedret på tvers av matematikk, STEM og agentic oppgaver. Ytelsen beskrives som marginalt under GPT-5.4 og Gemini 3.1 Pro – men altså ikke langt unna, og til en brøkdel av prisen.

Hva koster DeepSeek V4?

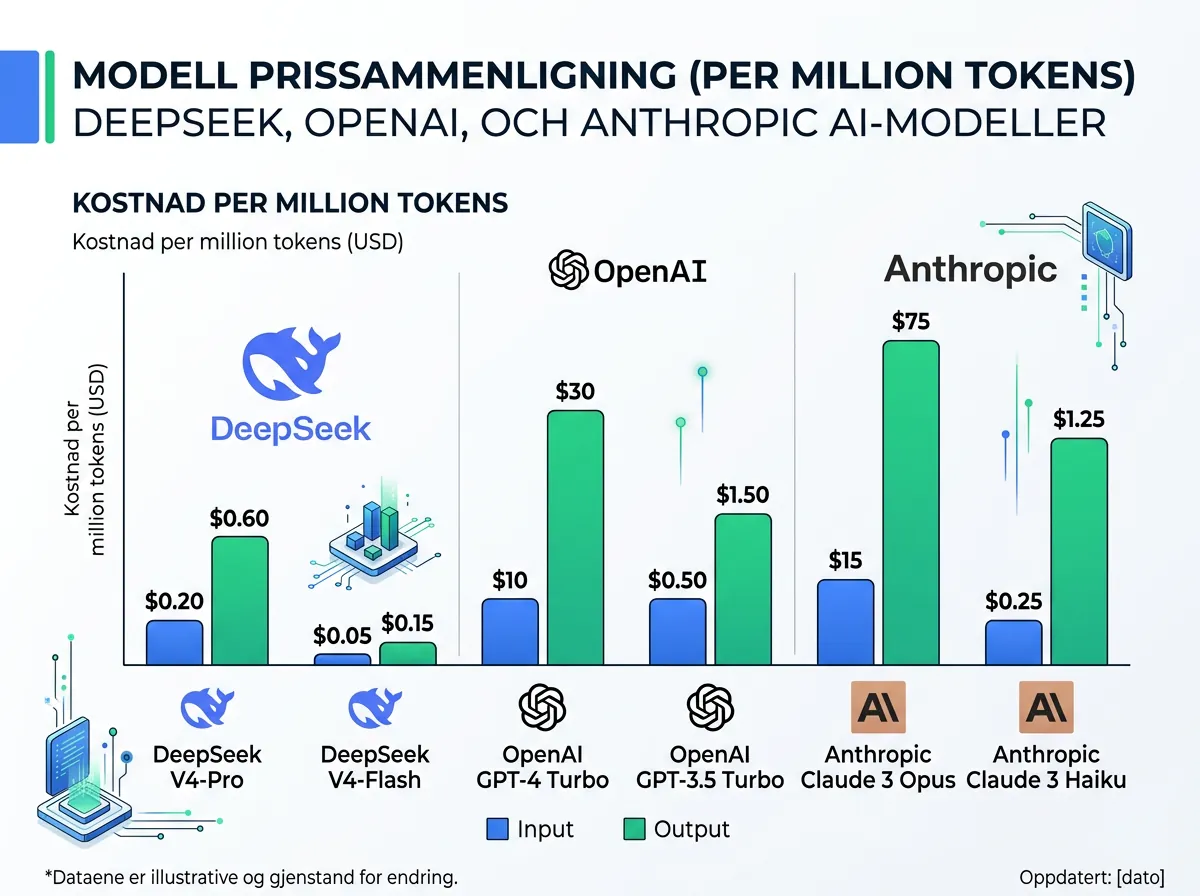

Her er det DeepSeek igjen gjør vondt for konkurrentene:

- V4-Flash: $0,14 per million input-tokens / $0,28 per million output-tokens

- V4-Pro: $1,74 per million input-tokens / $3,48 per million output-tokens

V4-Flash er dermed en av de billigste alternativene i sin klasse – og V4-Pro er billigere enn sammenlignbare frontier-modeller fra OpenAI og Anthropic. For referanse: GPT-5.4 koster vesentlig mer per million tokens, og Claude Sonnet ligger i samme prisklasse som V4-Pro eller høyere.

For den som kjører API-kall i produksjon, er dette tall som merkes raskt. En stor kodebase-analyse med 1 million tokens kontekst koster under 2 dollar med V4-Pro. Det er lavt.

Er DeepSeek V4 egentlig open source?

Ja – og dette er viktig. V4 bruker MIT-lisens, som betyr full kommersiell bruk uten restriksjoner. Du kan laste ned vektene, finjustere modellen og bygge produkter på toppen. Det er ikke «open weights med restriksjoner» slik noen andre aktører praktiserer.

Sammenlign det med min guide til open source AI der jeg går gjennom de viktigste modellene og lisensene – DeepSeek har konsekvent valgt åpne lisenser, noe som skiller dem fra konkurrenter som Meta (som har egne bruksbegrensninger i Llama-lisensen).

MIT-lisens betyr i praksis at du kan gjøre hva du vil med modellen. Det er gode nyheter for de som vil kjøre modellen lokalt eller bygge egne applikasjoner uten å bli låst til en skyleverandør.

Hva gjør DeepSeek V4 best?

Ifølge benchmarks DeepSeek selv presenterer, er V4 spesielt sterk på:

- Koding: Topp ytelse blant open source-modeller på agentic kodingsbenchmarks

- Matematikk og STEM: Slår alle nåværende open source-modeller

- Lange dokumenter: 1 million tokens gjør den naturlig egnet for kodebaseanalyse, juridiske dokumenter, store rapporter

- Agentic oppgaver: Forbedret evne til å planlegge og utføre flertrinns oppgaver

Benchmarks fra DeepSeek selv bør selvfølgelig tolkes med forsiktighet – selskaper presenterer naturlig sine egne tall i best mulig lys. Men ytelsen bekreftes av uavhengige tester publisert på Simon Willisons blogg, som er en av de mest pålitelige kildene for uavhengig LLM-testing.

Hva betyr dette for AI-løpet?

DeepSeek leverer V4 nøyaktig ett år etter at V3 snudde opp ned på forventningene til hva kinesiske AI-selskaper kunne prestere. Den gang sank teknologiaksjene og hele bransjen måtte revurdere sine kostnadsantagelser. V4 gjentar den formelen: høy ytelse, åpen kildekode, aggressiv prising.

Det er ikke nødvendigvis et nytt «sjokk» – markedet er bedre forberedt nå. Men det er en klar påminnelse om at kinesiske selskaper konkurrerer seriøst og leverer modeller som faktisk brukes. DeepSeek er ikke lenger en kuriositet – det er en etablert aktør i det globale AI-løpet.

For deg som bruker AI-verktøy i praksis: det viktigste er at du nå har tilgang til en kraftig open source-modell med 1 million tokens kontekst til svært lav pris. Enten du kjører via API eller laster ned vektene selv, er V4 et reelt alternativ til de store proprietære modellene.

Jeg har tidligere skrevet en full gjennomgang av DeepSeek som selskap og modellserie – og da R1-modellen kom ble det skrevet om med en gang. V4 følger i samme spor, og det er en rimelig grunn til å holde øye med hva DeepSeek gjør videre.

DeepSeek V4 er tilgjengelig nå via DeepSeek API og for nedlasting på Hugging Face. Prøv det gjerne – særlig V4-Flash hvis du vil ha et raskt og billig alternativ til daglig bruk.