Innhold Vis

DeepSeek er et kinesisk AI-selskap som på under to år klarte å sjokkere hele bransjen. Grunnlagt i juli 2023 av Liang Wenfeng – mannen bak hedgefondet High-Flyer i Hangzhou – kom DeepSeek ut av ingensteds og beviste at verdensledende AI ikke er forbeholdt Silicon Valley og titalls milliarder dollar. Modellene er open source, ekstremt billige i bruk, og presterer på nivå med det beste fra OpenAI og Anthropic.

Jeg har ikke brukt DeepSeek mye selv – jeg er ærlig talt skeptisk til kinesiske modeller av personvernhensyn. Men det forandrer ikke at DeepSeek er en av de viktigste AI-aktørene i verden akkurat nå. Konkurransen de bringer er bra for alle. Prisene på AI har stupt. Kvaliteten har gått opp. Det er markedet som fungerer.

Denne guiden dekker alt du trenger å vite: hva DeepSeek faktisk er, hvilke modeller som finnes, hva som sensureres, hva personvernproblemene er, og hvem som bør bruke det – og hvem som bør la være.

Hva er DeepSeek, og hvem står bak?

DeepSeek er et AI-laboratorium eiet av det kinesiske kvantitative hedgefondet High-Flyer Capital Management. Selskapet ble grunnlagt i juli 2023 og holder til i Hangzhou, omtrent to timers kjøretur sørvest for Shanghai.

Det som skiller DeepSeek fra de fleste andre AI-laboratorier er at de ikke er et selvstendig selskap på jakt etter investorer og børsnotering. De er finansiert av et veletablert hedgefond med dyp ekspertise i matematikk og kvantitative metoder. Det forklarer mye av det tekniske fokuset – teamet er vant til å løse harde optimeringsproblemer med begrensede ressurser.

Siden lanseringen har DeepSeek skapt to modell-familier som virkelig har satt spor: den generelle V3-serien og resonneringsmodellen R1. Begge er utgitt under MIT-lisens, som betyr at du fritt kan laste dem ned, modifisere dem, og bruke dem kommersielt. Det er sjeldent generøst.

DeepSeek-V3: den generelle modellen

DeepSeek-V3 er flaggskipmodellen for hverdagsbruk – skriving, koding, spørsmål og svar, dataanalyse. Den bruker en arkitektur kalt Mixture-of-Experts (MoE) med totalt 671 milliarder parametere, men aktiverer bare 37 milliarder per token. Det er dette som gjør den så effektiv: den er stor nok til å være kraftig, men slipper å bruke alle kapasitetene på hvert enkelt svar.

Benchmarkresultater da den kom ut viste at V3 matchet GPT-4o og Claude 3.5 Sonnet på de fleste tester. Treningskostnaden? Angivelig 6 millioner dollar. Til sammenligning brukte OpenAI over 100 millioner dollar på å trene GPT-4 i 2023. Selv om begge tallene er omtrentlige, er skalaforskjellen reell nok til å gi bransjen sjokk.

Etter den opprinnelige V3 kom V3-0324 i mars 2025 med bedre resonneringsevner, og V3.1 i august 2025 – en hybrid som kan bytte mellom vanlig responsemodus og dyptgående resonnering avhengig av oppgaven. Den nyeste versjonen, V3.2, presterer på Gemini 2.5 Pro-nivå på avanserte matematikk- og kodebenchmarks.

DeepSeek-R1: resonneringsmodellen som rystet markedet

Hvis V3 sjokkerte folk med effektiviteten sin, var R1 det som virkelig satte fyr på diskusjonen. Lansert i januar 2025 er R1 en såkalt reasoning model – den tenker høyt gjennom problemer, steg for steg, før den gir svar. Samme tilnærming som OpenAIs o1-modeller, men utgitt som open source og til en brøkdel av prisen.

På matematikk- og logikkbenchmarks matchet R1 OpenAI o1. På AIME 2024 – en av de hardeste matematikkonkurransene for videregående elever – scoret R1 høyere enn OpenAIs modell. For et selskap som ikke var kjent for noen et år tidligere, var det en imponerende prestasjon.

Det fine med R1 er at du ser resonneringsprosessen. Modellen viser arbeidet sitt – den kan skrive «la meg tenke på dette…» og deretter jobbe seg gjennom logikken synlig. For komplekse problemstillinger er det nyttig fordi du kan følge med og oppdage hvis den tar feil vei.

R1 kom med en oppgradering i mai 2025 (R1-0528) som pusher resonneringsevnene enda lenger.

Hvorfor sjokkerte DeepSeek bransjen i januar 2025?

27. januar 2025 falt Nvidias aksje 18 % på én dag. Det tilsvarte et verditap på rundt 590 milliarder dollar – det største endagstapet for et enkelt selskap i historien. Årsaken var én nyhetsmelding: DeepSeek hadde lansert R1.

Men hvorfor reagerte markedet så voldsomt? Fordi hele investeringstesen bak AI-boomet hviler på én antagelse: at å trene kraftige modeller krever enorme mengder dyrt GPU-hardware. Jo mer compute, jo bedre modell. Nvidia tjener enorme summer på dette.

DeepSeek brøt denne antagelsen. De trente R1 for rundt 6 millioner dollar på hardware som ikke engang er det nyeste Nvidia har å tilby – de brukte H800-brikker (eksportversjonen med begrenset ytelse som USA tillater å selge til Kina). Og likevel matchet de OpenAI. Det reiste ubehagelige spørsmål: trenger man egentlig alle de H100-ene som Microsoft, Google og Meta hamstrer?

For vanlige brukere er dette utelukkende positivt. Konkurransen presser prisene ned og kvaliteten opp. For Silicon Valley var det et wake-up call om at AI-monopolet ikke er like trygt som man trodde.

Priser: DeepSeek er billigere enn nesten alt annet

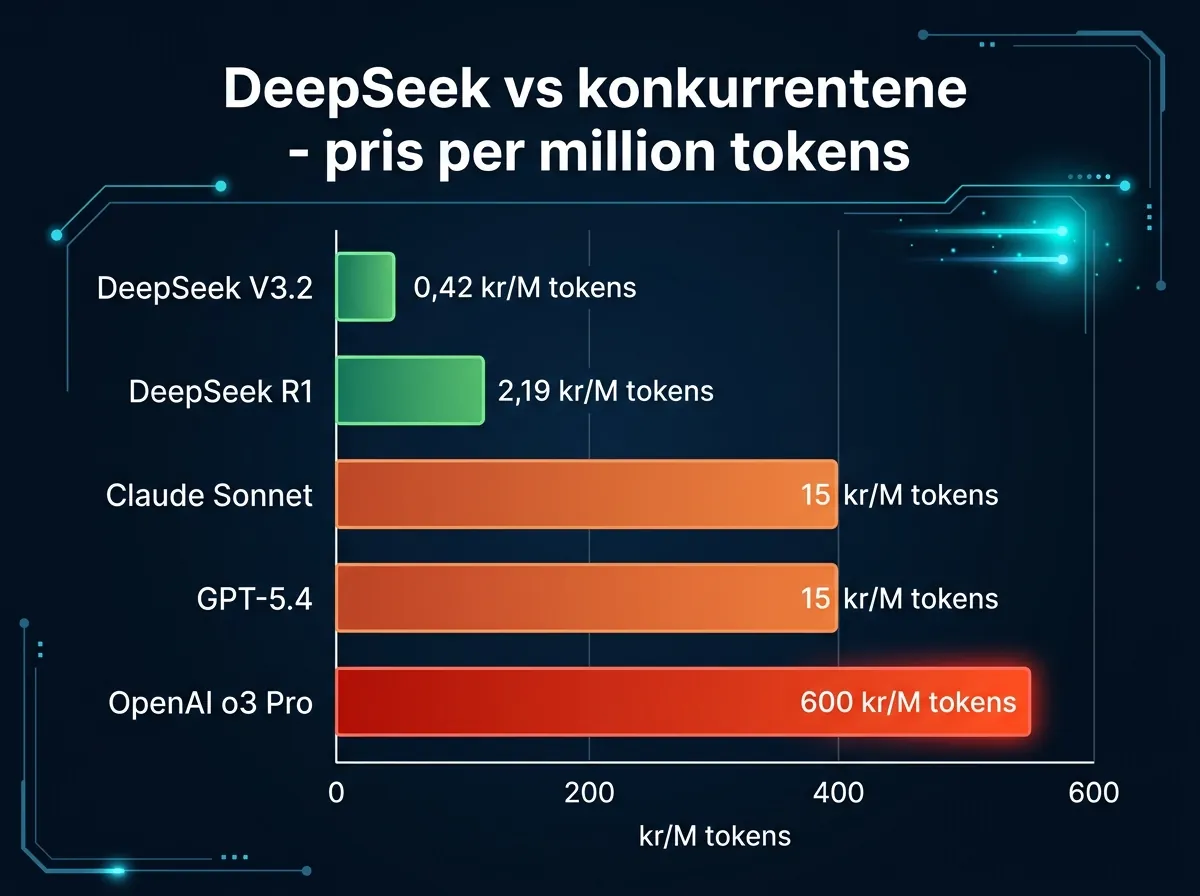

Her er tallene som virkelig setter ting i perspektiv. API-prising per million tokens (mars 2026):

- DeepSeek V3.2: 0,28 dollar inn / 0,42 dollar ut

- DeepSeek R1: 0,55 dollar inn / 2,19 dollar ut

- Claude Sonnet 4.6 (Anthropic): 3 dollar inn / 15 dollar ut

- GPT-5.4 (OpenAI): 15 dollar ut per million tokens

- OpenAI o3 Pro (resonnering): 150 dollar inn / 600 dollar ut

Regnestykket for resonnering er det mest ekstreme: DeepSeek R1 er omtrent 270 ganger billigere enn OpenAI o3 Pro per million tokens. Selv om du ikke trenger o3 Pro-nivå og sammenligner med rimeligere OpenAI-alternativer, snakker vi om 30-35 ganger prisdifferanse mot GPT-5.4.

For hobbyister som vil eksperimentere med API-kall koster DeepSeek V3.2 ingenting å snakke om. For bedrifter som sender millioner av tokens gjennom en AI-tjeneste er forskjellen stor nok til å endre hele kostnadsstrukturen.

Kan du kjøre DeepSeek lokalt? Open source og Ollama forklart

En av de største fordelene med DeepSeek er at modellene er ekte open weights under MIT-lisens. Du kan laste ned vektene og kjøre dem selv. Det finnes ingen skjulte restriksjoner på kommersiell bruk, og du trenger ikke betale per token.

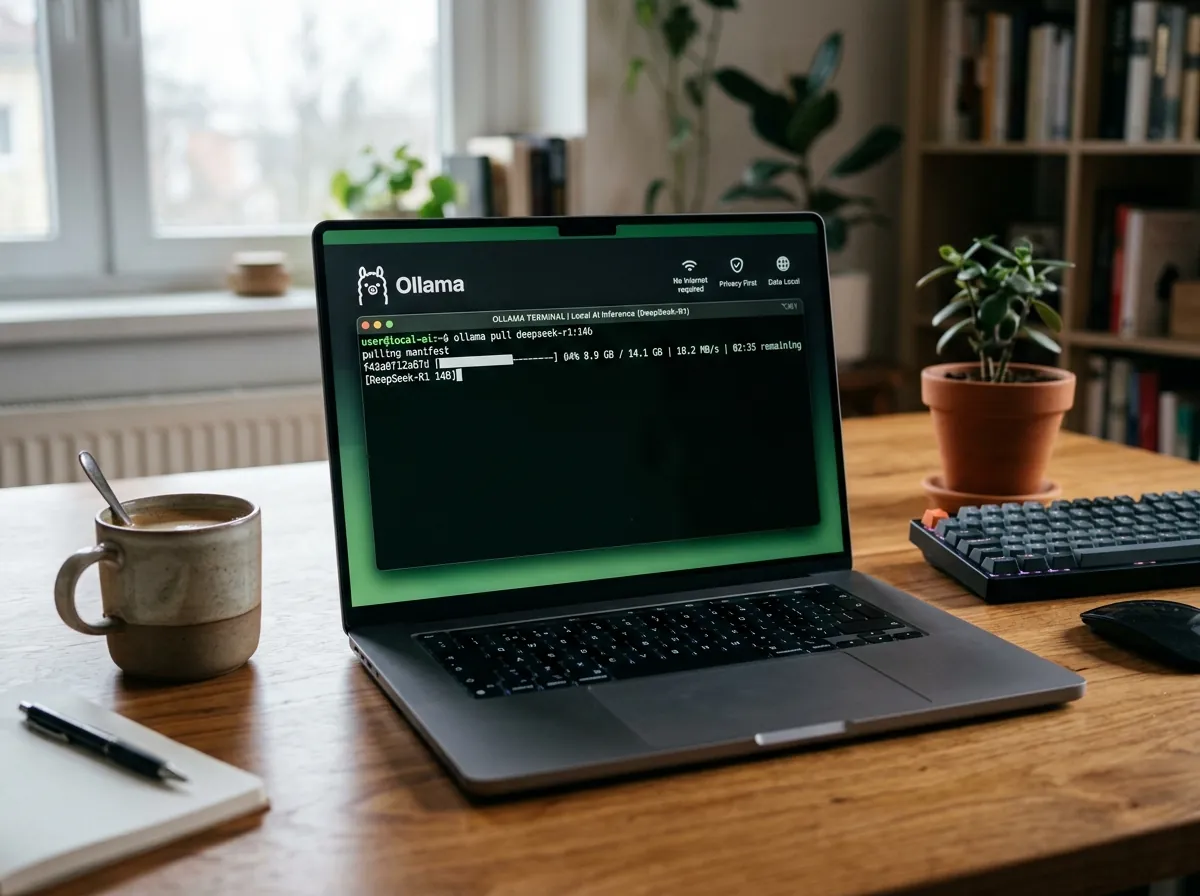

Det enkleste alternativet er Ollama. Med én kommando er du i gang:

ollama pull deepseek-r1:14b

Da laster du ned 14-milliardersversjonen av R1, som er destillert ned fra den store modellen og optimalisert for forbrukerhardware. Ferdig nedlastet kjører all inferens lokalt – ingen internettforbindelse nødvendig, ingen data sendes noen steder, ingen API-nøkler å forholde seg til.

Modellvariantene på Ollama spenner fra 1,5 milliarder parametere (kjører på nesten hva som helst) til den fulle 671-milliardersmodellen (krever seriøst serverutstyr). For de fleste er 7B eller 14B et greit startpunkt på en moderne laptop. Har du et grafikkort med 16-24 GB VRAM, er 32B-versjonen et bedre valg.

Kjører du DeepSeek lokalt løser du forresten også personvernproblemet med ett grep.

Hva sensurerer DeepSeek?

Her er vi i kjernen av det folk lurer mest på. DeepSeek følger kinesisk lov, og det betyr at bestemte temaer enten er fullstendig blokkert eller besvares i tråd med Beijings offisielle linje.

Dokumenterte blokkerte eller sensurerte temaer:

- Tiananmen-massakren 1989: DeepSeek svarer «sorry, that’s beyond my current scope. Let’s talk about something else»

- Taiwan: Starter å svare, sletter så svaret midt i setningen og erstatter med «We adhere to the One-China principle»

- Xi Jinping: Unngår å nevne ham ved navn, refererer til «den kinesiske presidenten» eller «current leader of China»

- Hongkong-protestene: Unngås eller besvares i tråd med Beijings linje

- Uigurene i Xinjiang: Unngås

Det viktige skillet her: sensureringen er i nettjenesten på deepseek.com og den offisielle appen. Modellvektene selv er ikke sensurerte på samme måte. Kjører du DeepSeek lokalt via Ollama, vil du typisk få mer åpne svar på de samme spørsmålene. Sensureringen er implementert i server-siden, ikke bakt inn i modellens vekter.

For de fleste bruksområder – koding, skriving, dataanalyse, spørsmål om teknologi – har ikke dette noe å si. Men det er viktig å vite at DeepSeek ikke er et nøytralt verktøy på politisk ladede temaer som angår Kina.

Personvern: hva skjer med dataene dine?

Dette er den legitime bekymringen. Bruker du deepseek.com eller appen, sendes dataene dine til servere i Kina. Det er ikke noe mystisk ved det – det er bare slik alle nettjenester fungerer, bare at serverne befinner seg i Hangzhou fremfor Dublin eller Virginia.

Problemet er ikke den normale datalagringen. Det er det juridiske rammeverket rundt den. Kinas etterretningslov fra 2017 pålegger kinesiske selskaper å samarbeide med kinesiske etterretningstjenester hvis de blir bedt om det. DeepSeek kan ikke nekte. Det finnes ingen juridisk ekvivalent til dette i vestlige jurisdiksjoner.

I tillegg avdekket sikkerhetsfirmaet Feroot Security at DeepSeeks nettjeneste inneholder kode som kan sende brukerdata til CMPassport.com – et register tilknyttet China Mobile. Og sikkerhetsforskere fra Wiz fant i januar 2025 en åpen database hos DeepSeek med over én million loggoppføringer som inneholdt klartekst-chathistorikk og API-nøkler.

Italia blokkerte DeepSeek innen 72 timer etter lanseringen. 13 europeiske jurisdiksjoner åpnet undersøkelser. Australia, Tsjekkia, Frankrike, India, Sør-Korea og Taiwan innførte forbud eller restriksjoner mot bruk på statlige enheter.

Hva betyr dette i praksis for deg?

- Vil du eksperimentere med modellens tekniske egenskaper? Ollama lokalt – ingen bekymringer.

- Vil du sende sensitiv forretningsinformasjon, personopplysninger, eller konfidensielle prosjekter? Bruk ikke deepseek.com. Punkt.

- Bruker du offentlig virksomhet eller jobber med informasjon underlagt særlig sensitivitet? Hold deg unna nettjenesten.

Hvordan presterer DeepSeek mot GPT-5 og Claude?

Benchmarks er et krevende tema – jeg er skeptisk til å ta dem for bokstavelig. Selskaper optimaliserer modellene sine mot de testene de vet de blir vurdert på. Men de gir et nyttig grovt bilde.

Per mars 2026 presterer DeepSeek V3.2 på Gemini 2.5 Pro-nivå på matematikk og koding. DeepSeek R1 matcher OpenAI o1 på resonnering og overtar o3-territoriet på noen spesifikke benchmarks. For koding spesielt er de kinesiske modellene svært konkurransedyktige.

Praksis er en annen sak. I hverdagslig skriving og nyanserte, kulturelt forankrede svar på norsk er Claude fortsatt min foretrukne modell. DeepSeek er trent primært på kinesisk og engelsk. Det merkes ikke alltid, men det merkes av og til.

Til koding, matematikk, og teknisk analyse er DeepSeek genuint sterkt – og prisforskjellen gjør det til et naturlig valg for API-integrasjoner der du vil holde kostnadene nede. Les mer om Claude og prisene der hvis du vil sammenligne direkte.

DeepSeek som bevis på at konkurranse fungerer

Det er lett å gå seg vill i personvern-bekymringene og sensur-diskusjonene og glemme det store bildet: DeepSeek har gjort AI-markedet dramatisk bedre for alle brukere.

For ett år siden var kostnadene for å bygge AI-drevne produkter dominert av OpenAI-priser. Nå er prisene falt 80 % på tvers av bransjen fra 2025 til 2026. Det er ikke fordi OpenAI og Anthropic plutselig ble sjenerøse. Det er fordi DeepSeek tvang dem til å bli mer effektive og konkurransedyktige.

Markedsmekanismer løser problemer bedre enn regulering – og her er det et godt eksempel. Silicon Valley hadde de facto kontroll på toppmodeller. DeepSeek brøt det opp. Veien mot AGI vil sannsynligvis gå raskere fordi det er flere aktører som konkurrerer om å finne de beste løsningene.

Det er verdt å merke seg at DeepSeek ikke «jukset» seg frem. De fant smarte tekniske løsninger. MoE-arkitekturen, treningseffektiviteten, destilleringen av store modeller til mindre – det er ingeniørkunst, ikke dumping.

Hvem bør bruke DeepSeek – og hvem bør la være?

Bruk DeepSeek hvis du:

- Jobber med koding, matematikk, eller teknisk analyse og vil ha en god og billig API-løsning

- Vil eksperimentere med state-of-the-art resonnering via Ollama lokalt

- Bygger en tjeneste som trenger mange AI-kall og vil holde kostnadene nede

- Er nysgjerrig på hva kinesisk AI kan og vil leke deg frem

Bruk ikke deepseek.com (nettjenesten) hvis du:

- Har sensitiv forretningsinformasjon, personopplysninger, eller konfidensiell kommunikasjon

- Jobber i offentlig sektor eller med regulert industri

- Vil diskutere politisk sensitive temaer og forventer nøytrale svar

- Trenger en modell du kan stole fullt ut på i alle sammenhenger

Lokal kjøring via Ollama er et godt mellomvalg for de som vil prøve teknologien uten å sende data til kinesiske servere. Da er personvernproblemet i stor grad løst, og du kan bruke modellen til det den er god til.

Slik kommer du i gang med DeepSeek

Det er tre veier inn:

1. Web (enklest): Gå til chat.deepseek.com og opprett en gratis konto. Grensesnittet ligner ChatGPT. Du kan velge mellom V3 (generell) og R1 (resonnering). Husk personvern-forbehold over.

2. Lokalt med Ollama (anbefalt for utviklere): Installer Ollama fra ollama.com, kjør deretter ollama pull deepseek-r1:14b i terminalen. Etter nedlasting er du oppe og går. Bruk ollama run deepseek-r1:14b for å starte en chat-sesjon direkte i terminalen, eller koble det til et lokalt grensesnitt som Open WebUI.

3. API (for produktbygging): Registrer deg på platform.deepseek.com, generer en API-nøkkel, og bruk DeepSeeks OpenAI-kompatible API. Endepunktet er https://api.deepseek.com/v1, og du kan bruke standard OpenAI-biblioteker – bare bytt ut base URL og nøkkel. Om du er vant til OpenAI sin API, er overgangen triviell.

Vil du se DeepSeek i kontekst med andre verktøy, har jeg skrevet en oversikt over de beste AI-verktøyene i 2026 og en sammenligning av ChatGPT mot alternativene.

DeepSeek er ikke for alle, og det er ikke uten problemer. Men å ignorere det fordi det er kinesisk er like dumt som å ignorere det fordi det er billig. Teknologien er reell, effekten på bransjen er udiskutabel, og for riktig brukstilfelle er det et av de beste alternativene som finnes.

3 kommentarer