Innhold Vis

GLM-5.1 fra kinesiske Z.ai toppet SWE-Bench Pro-listen 7. april 2026 med 58,4 poeng – og slo både GPT-5.4 (57,7) og Claude Opus 4.6 (57,3). Modellen er trent utelukkende på Huawei-maskinvare, uten en eneste Nvidia-brikke. Den er åpen kildekode med MIT-lisens. Og den koster $1,00 per million tokens inn og $3,20 ut – sammenlignet med Claude Opus 4.6 på $15/$75.

Det er noe som har nagged i bakhodet mitt de siste månedene. Ikke panikk, ikke hype – bare en rolig, litt ubehagelig observasjon: Kina shipper. Raskt. Billig. Og uten Nvidia.

Jeg har skrevet om GLM 4.7 tidligere og pekt på at kinesiske modeller er merkbart billigere enn vestlige alternativer. Men GLM-5.1 er ikke bare billig. Den er faktisk god. Det er en annen diskusjon.

Hva er GLM-5.1 – og hvorfor er det interessant?

Z.ai (tidligere Zhipu AI) lanserte GLM-5.1 den 27. mars 2026. Modellen er en 744-milliarder-parameter Mixture-of-Experts-arkitektur – men med bare ~40 milliarder aktive parametere per inferens. Det betyr lav kostnad per token, selv på maskinvare som ikke er i Nvidias toppsjikt.

Tekniske spesifikasjoner som faktisk betyr noe:

- 200 000 token kontekstvindu – samme som GLM 4.7, fortsatt svært sjenerøst

- 128 000 token output-mulighet – nyttig for lange kodegenererings-oppgaver

- Agentmodus i 8 timer – modellen kan kjøre autonomt med planlegging, utføring og testing i kontinuerlig løkke

- MIT-lisens – selvhosting er lovlig, til og med kommersielt

I en demonstrasjon bygde GLM-5.1 et komplett Linux-system fra bunnen av på åtte timer, med 655 iterasjoner. Det er ikke en statistikk du ser fra vestlige closed-source-modeller – der får du gjerne en PR-melding om at modellen «klarer komplekse flerstegsoppgaver».

Hva koster GLM-5.1 sammenlignet med Claude og GPT?

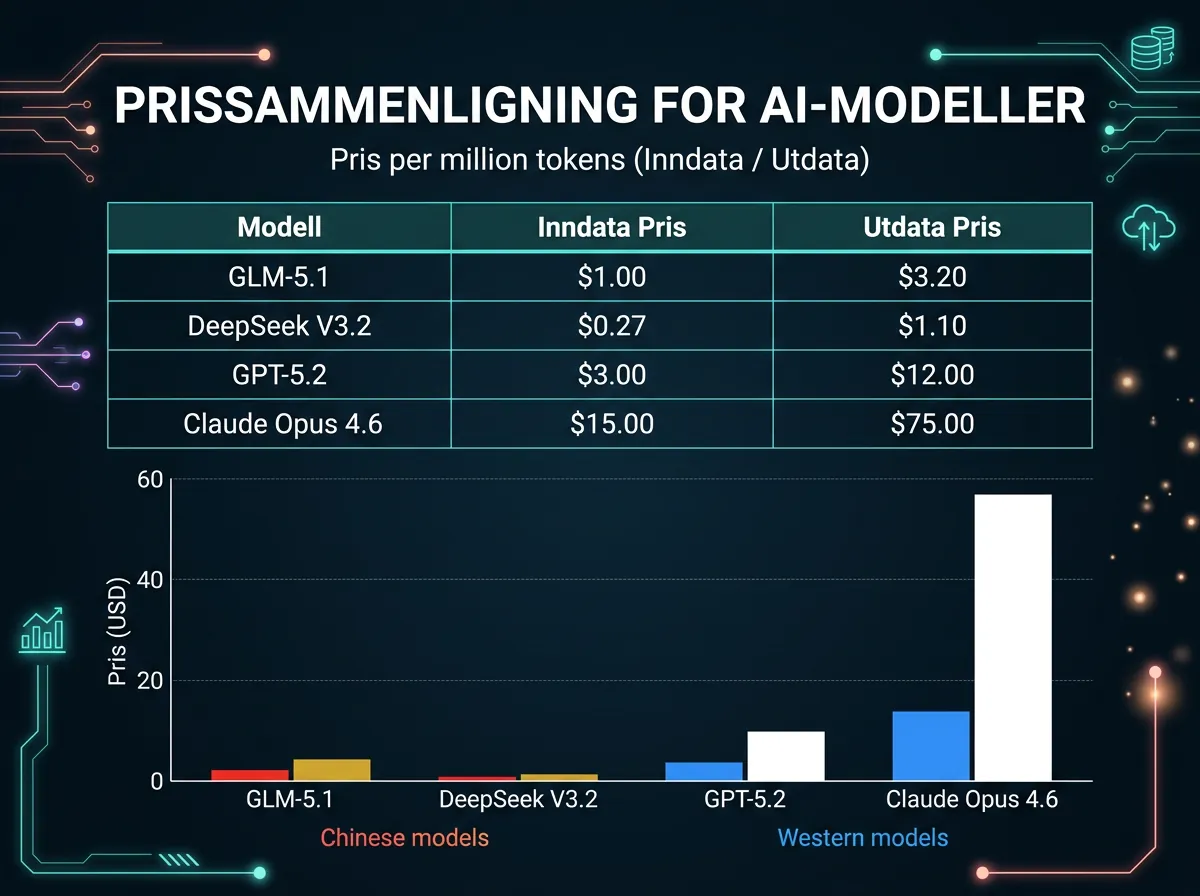

Her er tallene, og de er ganske brutale for vestlig prising:

- GLM-5.1: $1,00 inn / $3,20 ut per million tokens

- DeepSeek V3.2: $0,27 / $1,10 (billigst på markedet)

- GPT-5.2: $3,00 / $12,00

- Claude Opus 4.6: $15,00 / $75,00

For de fleste kodingsoppgaver er GPT til GPT og Claude til Claude for kodingsprestasjon – men GLM-5.1 leverer 94,6% av Claude Opus 4.6s kodingsscore til omtrent en femtedel av prisen. 77,8% på SWE-bench Verified, mot Claude Opus 4.6 sin 80,8%.

Tre poeng under på benchmark. Over 1400% dyrere for Claude. Regnestykket henger ikke helt på greip, med andre ord.

Det er verdt å merke seg at GLM-5.1 er tekstmodell – ingen multimodal støtte for bilder, lyd eller video. For de oppgavene er Claude, GPT og Gemini fortsatt bedre alternativer. Men for ren tekstbehandling og koding er gapet ganske lite.

Trent uten Nvidia – hva betyr det egentlig?

Dette er punktet som burde vekke oppmerksomhet.

USA la Zhipu AI på Entity List i januar 2025 – det vil si at de ble kuttet av fra Nvidia H100 og A100. Tanken var åpenbart å bremse kinesisk AI-utvikling ved å stenge ute tilgangen til verdens beste treningshardware.

GLM-5 og 5.1 ble trent på et klynge med 100 000 Huawei Ascend 910B-prosessorer. Disse ble designet av Huaweis HiSilicon-divisjon og produsert av SMIC (Kinas eget halvlederfirma) på 7nm-prosess. Ascend 910B leverer rundt 320 TFLOPS FP16 – mellom Nvidias A100 (312 TFLOPS) og H100 (989 TFLOPS). Det er ikke i nærheten av H100 på råytelse, men Z.ai utviklet tilpassede distribuert treningsoptimaliseringer som kompenserte.

Resultatet: Et frontier-klassemodell bygd på 100% kinesisk teknologi. Export controls slo ikke. Det er ikke en politisk kommentar – det er bare et faktum som er nyttig å ha med seg når man planlegger hva man skal bruke de neste par årene.

DeepSeek, Qwen, GLM – er dette et mønster?

Det er ikke tilfeldig at GLM-5.1 imponerer. Det er del av et bredere mønster som har vart siden tidlig 2025.

Fra DeepSeek, som sjokkerte bransjen med kostnadseffektiv trening, til Alibabas Qwen-familie med milliontoken-kontekstvinduer til en brøkdel av prisen – kinesiske laboratorier shipper modeller med to til seks ukers mellomrom. Ikke proof-of-concept-modeller. Produksjonsklare modeller.

Fra 2025 til 2026 har følgende kinesiske laboratorier alle levert frontier-nivå releaser:

- ByteDance – Doubao 2.0 og Seed-serie

- Alibaba – Qwen 3.5 og Qwen 3-Max

- Z.ai (Zhipu) – GLM-5, GLM-5.1

- Moonshot AI – Kimi K2.5

- MiniMax – M2.5 (frontier-koding til 5-20% av Claudes pris)

- Xiaomi – MiMo-V2-Pro, fra et telefonselskap

Det er ikke én heldig modell. Det er en industriell produksjonskapasitet.

Bør du bruke GLM-5.1?

Her er min ærlige vurdering, som noen som er skeptisk til kinesiske modeller men ikke dogmatisk:

Jeg bruker ikke kinesiske modeller for egne prosjekter. Det handler ikke om at modellene er dårlige – de er åpenbart ikke dårlige. Det handler om at data sendes til servere i Kina (eller «Singapore/potensielt Kina» som jeg beskrev i GLM 4.7-artikkelen), og at det er vanskelig å verifisere hva som skjer med den dataen.

For ren testing og eksperimentering er det en annen sak. MIT-lisens betyr at du kan kjøre GLM-5.1 lokalt hvis du har maskinvaren. 744 milliarder parametere med 40 milliarder aktive – det krever en del RAM, men det er i prinsippet gjennomførbart på et skikkelig serveroppsett.

For norske bedrifter med GDPR-krav er bildet mer komplisert. Zhipu AI er fortsatt på den amerikanske Entity List – det er ikke et direkte juridisk problem for norske selskaper, men det er et signal om hvilke risikovurderinger amerikanske myndigheter har gjort.

Vestens svar – finnes det ett?

Jeg vet ærlig talt ikke hva det gode svaret er. Det som faktisk bekymrer meg er hastighetsgapet. Ikke at kinesiske modeller er bedre – de er ikke det, ikke ennå, ikke på alle dimensjoner. Men de er gode nok, mye billigere, og released mye raskere. Det er en kombinasjon som kan endre markedsandeler over tid, uavhengig av hvem som «vinner» på benchmarks.

OpenAI, Anthropic og Google leverer fortsatt de beste modellene på de fleste oppgaver. Men det tar lengre tid mellom store releaser, prisene er langt høyere, og open-source-tilbudet er svakere. Det er et strategisk problem som ikke har en åpenbar løsning.

Hva tenker du? Er du bekymret for gapet, eller synes du vestlige modellers kvalitet fortsatt rettferdiggjør prisen?