Innhold Vis

OpenAI lanserte 17. mars 2026 to nye lettmodeller – GPT-5.4 Mini og GPT-5.4 Nano. Begge er bygget på GPT-5.4-arkitekturen, men optimalisert for lavere kostnad, høyere hastighet og bruk i store volumer. OpenAI kaller dem sine mest kapable små modeller hittil.

Mini er den store nyheten for de fleste brukere – den er allerede rullet ut i ChatGPT og erstatter GPT-5 Mini som standard «Thinking»-modell for gratis og Go-abonnenter. Nano er foreløpig kun tilgjengelig via API, og er designet for en ganske spesifikk nisje: oppgaver der hastighet og pris teller mer enn maksimal presisjon.

Det er verdt å merke seg konteksten: GPT-5.4 er den modellen OpenAI lanserte tidligere i mars med innebygd PC-kontroll. Mini og Nano er altså destillerte varianter – de bringer mye av det som er bra med flaggskipet ned i en mye rimeligere pakke.

Hva koster GPT-5.4 Mini og Nano?

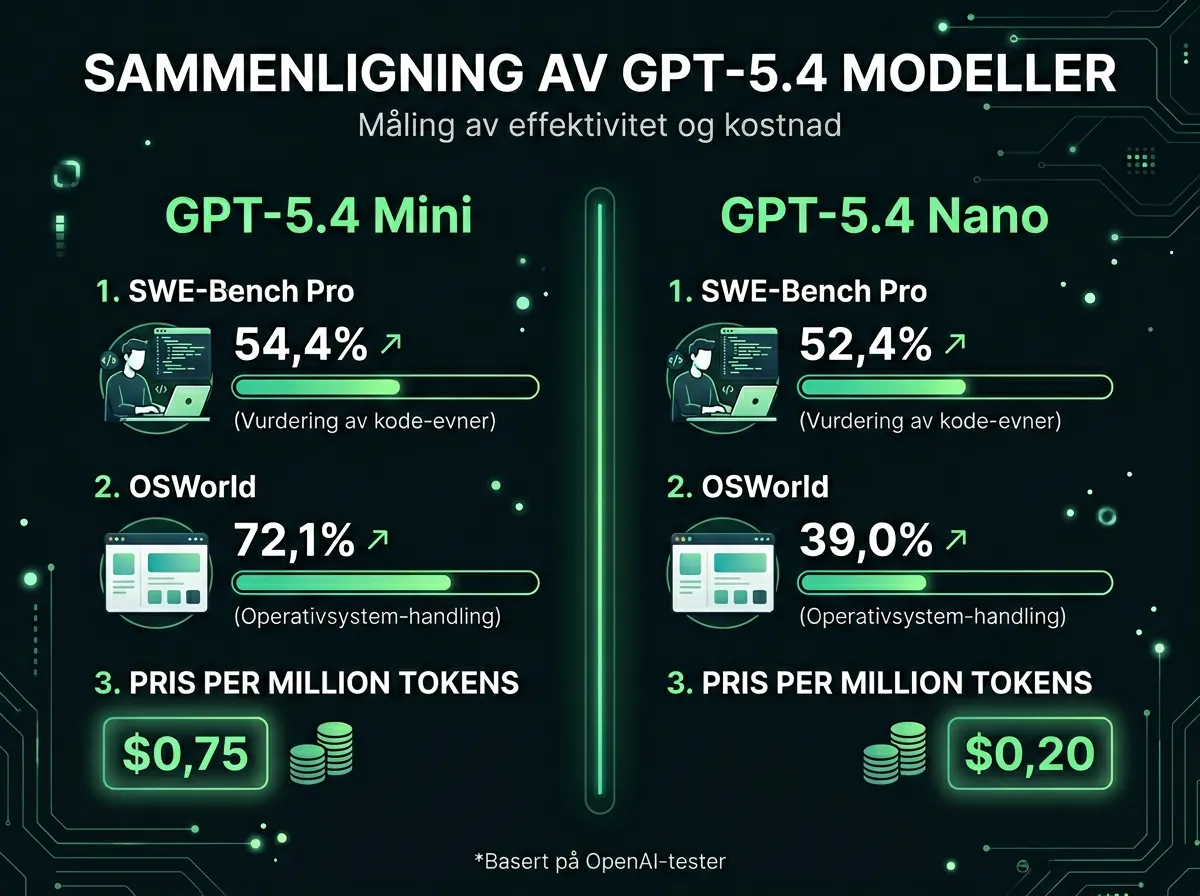

Her er tallene som faktisk betyr noe for deg som bruker API:

- GPT-5.4 Nano: $0,20 per million input-tokens, $1,25 per million output-tokens

- GPT-5.4 Mini: $0,75 per million input-tokens, $4,50 per million output-tokens

Nano er omtrent fire ganger billigere enn Mini på input. Og for å gi det litt perspektiv: Simon Willison regnet ut at Nano kan beskrive alle de 76 000 bildene i fotosamlingen hans for rundt 52 dollar. Det er drøyt 580 kroner for en massiv bildekatalogiseringsjobb. Med caching-rabatt faller Nano-prisen på input til $0,02 – altså to cent per million tokens.

Til sammenligning koster Googles Gemini 3.1 Flash-Lite $0,25 per million input-tokens. Nano underbyr det med god margin.

Ytelse – hvor gode er de egentlig?

La oss ta Mini først, siden det er den som treffer flest brukere.

På SWE-Bench Pro – en benchmark som tester evnen til å løse ekte kodingsproblemer – scorer Mini 54,4%. GPT-5 Mini (forgjengeren) lå på 45,7%. Det er en solid forbedring. Flaggskipet GPT-5.4 scorer 57,7%, så Mini er altså bare 3,3 prosentpoeng bak det store broren på koding.

På OSWorld-Verified, som tester hvordan en modell klarer å operere en desktop ved å lese skjermbilder, treffer Mini 72,1%. Flaggskipet: 75,0%. Marginen er liten.

Mini er dessuten mer enn to ganger raskere enn GPT-5 Mini. Kombinasjonen av høyere ytelse og lavere latens gjør den genuint interessant for alle som bygger applikasjoner der responstid teller.

Nano henger naturlig nok litt lenger bak: 52,4% på SWE-Bench Pro og 39,0% på OSWorld. Men husk – dette er en modell som koster 20 cent per million tokens. Den er ikke ment for de vanskelige resonnerings-oppgavene. Den er ment for det enkle arbeidet du trenger å gjøre i massevis.

Hva er Mini og Nano egentlig bygget for?

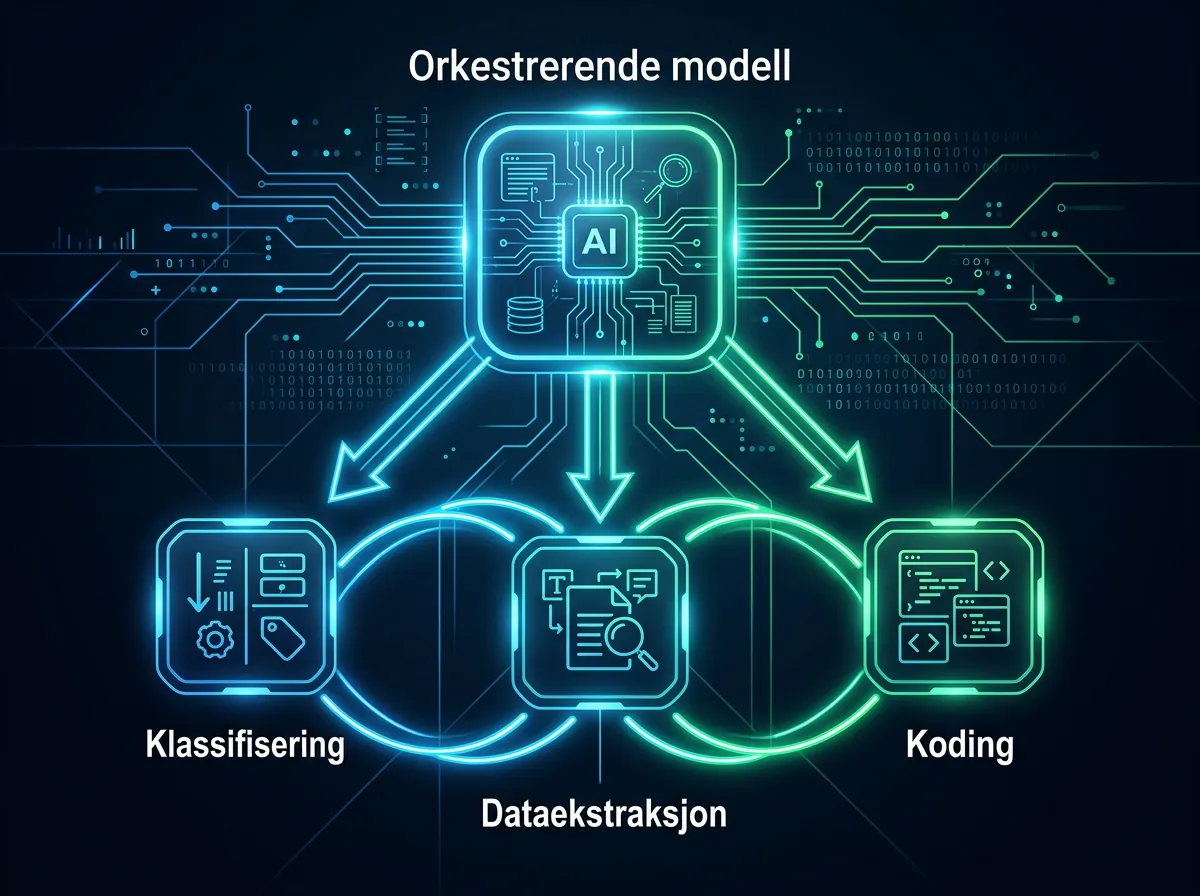

OpenAI har vært tydelige på dette: Mini og Nano er bygget for det de kaller «subagent-æraen». Tanken er at store AI-systemer ikke lenger trenger å kjøre alt gjennom ett tungt og dyrt flaggskip. I stedet kan du ha en orkestrerende stormodell som delegerer enkle deloppgaver til billige, raske minimodeller.

Konkret anbefaler OpenAI Nano for klassifisering, dataekstraksjon, rangering og enklere kodingshjelp. Mini passer for alt det Nano ikke strekker til – mer kompleks koding, multimodal analyse, og oppgaver der du vil ha nær-flaggskip-ytelse uten flaggskip-prislapp.

Dette er egentlig ganske interessant sett fra et arkitekturperspektiv. Hvis du for eksempel bygger en n8n-workflow som prosesserer hundrevis av dokumenter daglig, kan du spare mye ved å sende enkle klassifiseringsjobber til Nano via API, og bare eskalere til Mini (eller flaggskipet) når oppgaven faktisk krever det.

Tilgjengelighet – hvem får hva?

GPT-5.4 Mini er allerede ute i ChatGPT. Gratis og Go-abonnenter kan velge den via «Thinking»-alternativet. Den er også tilgjengelig i Codex og via OpenAI API.

GPT-5.4 Nano er foreløpig kun API-tilgjengelig. Ingen ChatGPT-tilgang ennå – dette er altså en modell rettet mot utviklere og bedrifter som integrerer direkte mot API.

Begge er klare i Azure AI Foundry ifølge Microsoft, som vektlegger lav latens som nøkkelverdi for bedriftskunder.

Hva betyr dette i praksis?

For de fleste som bruker ChatGPT daglig: Mini erstatter rett og slett den gamle mini-modellen. Raskere, bedre på koding og verktøybruk – og gratis-brukere får tilgang til det via Thinking. Det er en grei oppgradering uten at du trenger å tenke noe særlig over det.

For deg som bygger med API er det mer interessant. Nano til $0,20 per million input-tokens er billig nok til at du kan kjøre klassifisering og enkel databehandling i et omfang som ville kostet skjorta med eldre modeller. Se det som et verktøy for alle de kjedelige, repetitive oppgavene du hittil har enten betalt for mye for – eller unngått.

OpenAI pensjonerte GPT-4o og GPT-5.1 nylig, og Mini/Nano-lanseringen bekrefter retningen: de rydder opp i produktporteføljen og samler alt under GPT-5.4-paraplyen. Logisk nok – og Mini er allerede et overbevisende argument for å bytte.

1 kommentar