Innhold Vis

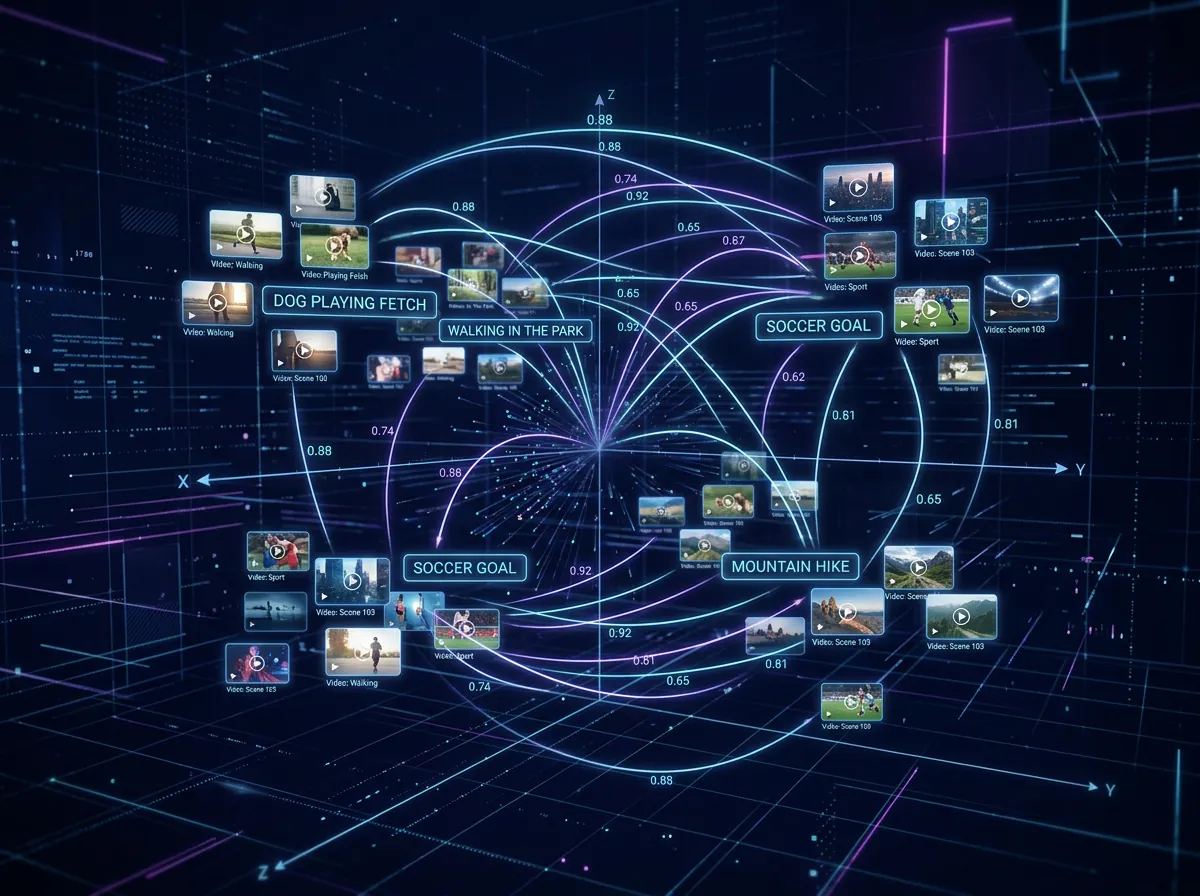

SentrySearch er et open source CLI-verktøy som lar deg søke gjennom timevis av videoopptak med vanlig tekst – uten transkripsjon, uten bildeteksting, uten mellomsteg. Det ble publisert på Hacker News nylig og demonstrerer noe teknisk ganske fascinerende: Gemini Embedding 2 kan nå projisere rå videopikler direkte inn i det samme vektorrommet som tekst.

Det vil si at en spørring som «grønn bil som kjørte på rødt» kan sammenlignes direkte med et 30-sekunders videoklipp – på vektornivå. Ingen AI som ser på bildene og skriver en beskrivelse. Ingen transkripsjon av lyd. Bare matematikk mellom vektorer.

Jeg har skrevet om Gemini Embedding 2 og multimodal embedding tidligere – men det var mer om hva modellen KAN. SentrySearch er et konkret eksempel på hva du faktisk bygger med det. Og det er ganske elegant.

Hva er SentrySearch?

SentrySearch startet som et verktøy for Tesla Sentry Mode-opptak – den dash-cam-liknende funksjonen som lagrer footage automatisk ved hendelser. Men det fungerer med alle MP4-filer. CLI-et gjør tre ting:

- Indekserer videoer i en lokal ChromaDB-database

- Søker med naturlig språk

- Klipper ut og returnerer det matchende klippet automatisk

Brukergrensesnittet er brutalt enkelt. Du kjører sentrysearch init, peker den mot en mappe med videoer, og så skriver du hva du leter etter. Resultatet ser omtrent slik ut: #1 [0.87] dashcam_2026-03-15.mp4 @ 02:15-02:45. Similarity score, filnavn, og eksakt tidskode. Klippet er allerede trimmet og klar til bruk.

Hvordan fungerer video-embeddingen?

Her er den teknisk interessante biten. Gemini Embedding 2 støtter nå video som direkte input – ikke via et bildesyn-steg først, men rå video til vektorer. Modellen sampler 1 frame per sekund (uavhengig av kildefilens frame rate), og korte videoer under 32 sekunder samples ved 1 fps, mens lengre klipp samples uniformt til 32 frames. Maks lengde er 120 sekunder per klipp, og formater som støttes er MP4, MOV med H264, H265, AV1 eller VP9-kodek.

Dimensjoner? Fleksibelt mellom 128 og 3072. SentrySearch bruker standard 768-dimensjoner, som gir et godt kompromiss mellom søkekvalitet og lagringsplass. Jeg har skrevet om Matryoshka Representation Learning-teknikken som gjør denne fleksibiliteten mulig – 1536 dimensjoner gir 99,9% av ytelsen til halvparten av lagringsplassen.

Det som gjør dette annerledes enn tidligere tilnærminger er at tekst og video lever i samme vektorrom. Det betyr at «grønn bil som kjørte ut i veien» og et 30-sekunders videoklipp der det skjer noe slikt, faktisk er direkte sammenlignbare størrelser i 768-dimensjonal matematikk. Ikke via en mellommann som oversetter video til tekst og deretter søker i tekst.

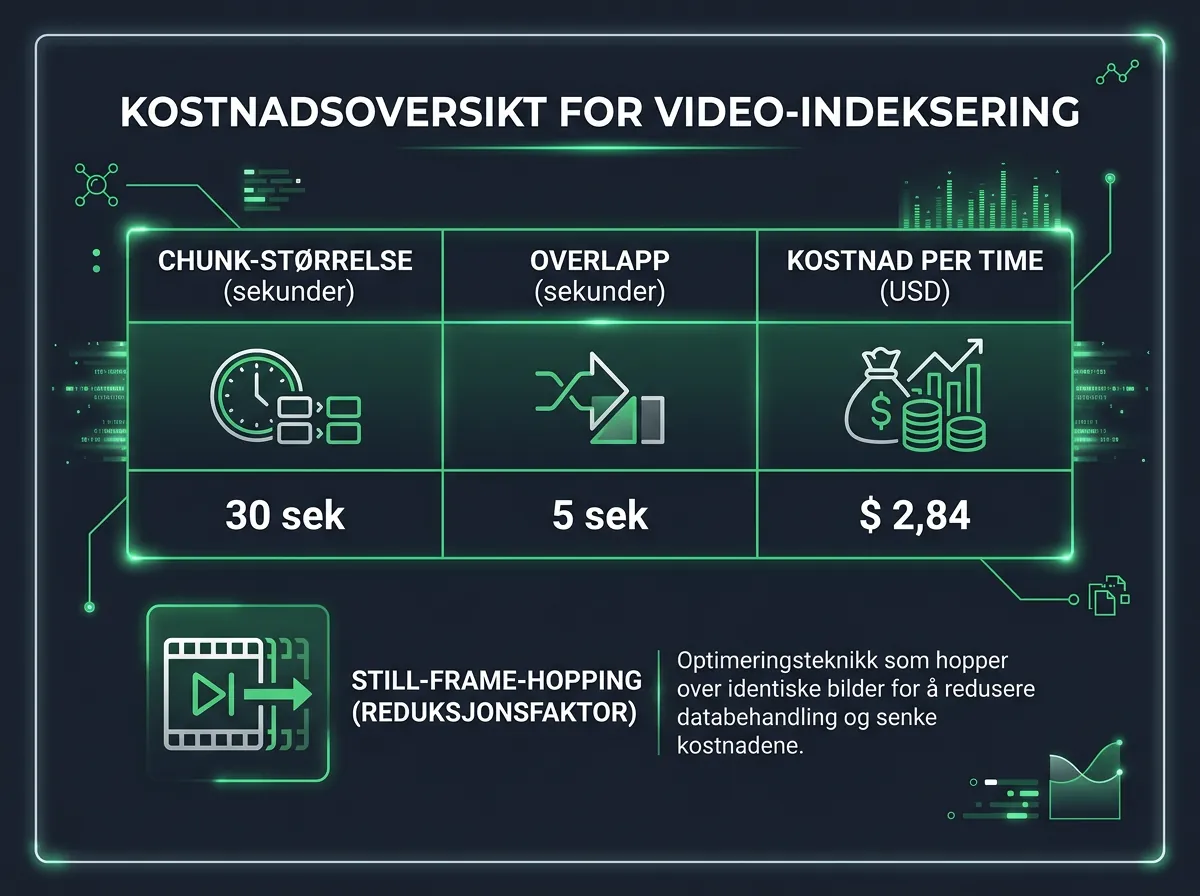

Hva koster det å indeksere en time med video?

Rundt 2,84 dollar ved standardinnstillinger (30 sekunders chunks med 5 sekunders overlapp). Det er ikke gratis, men det er heller ikke galt for hva du får. Still-frame-deteksjon er aktivert som standard og hopper over statiske scener – parkerte biler i 20 minutter, tomt parkeringshus, ingenting som skjer. Det kutter kostnadene merkbart.

For de som vil redusere kostnadene ytterligere: du kan preprocesse video ned til 480p og 5 fps. API-et fakturerer per frame (1 fps), så oppskalering hjelper ikke – men nedskalering av oppløsning reduserer opplastningsstørrelsen og dermed API-kallet.

Hvem kan bruke dette?

Mer enn du kanskje tror. Åpenbare brukstilfeller:

- Trafikkulykker og forsikringssaker – søk direkte i dashcam-footage uten å spole gjennom timer

- Overvåkningskamera-footage – «hvit varebil etter klokken 22» er et gyldig søk

- Drone-videoer – finn spesifikke scener i lange opptak fra inspeksjoner

- Videoproduksjon – søk gjennom råmateriale for å finne spesifikke klipp

- Idrettsanalyse – «keeperen sender langt ball» i timers treningsopptak

Krever Python 3.10+, FFmpeg og en gratis Gemini API-nøkkel fra Google AI Studio. Installasjonen er standard pip. For de som har fulgt med på Gemini CLI-verktøy – dette er en naturlig forlengelse av det jeg dekket i artikkelen om Gemini CLI Extensions.

Er video-embedding klar for produksjon?

SentrySearch er åpen om begrensningene. Gemini video-embedding API er fortsatt i preview-status. Still-frame-deteksjonen er heuristisk (JPEG-sammenligning) og ikke garantert presis. Klipp som strekker seg over chunk-grenser kan gi dårligere treff.

Men det er preview-logikk – altså at funksjonaliteten eksisterer og fungerer, men at priser og API-grenser kan endre seg. For et prosjekt som dette, der du indekserer lokalt med ChromaDB og betaler per API-kall, er det uproblematisk. Du reindekserer når prisen stabiliserer seg.

Kode og demo ligger på GitHub. Demo-video er i README. For de som vil grave dypere i Gemini Embedding 2 og multimodal RAG generelt – den opprinnelige artikkelen min gir teknisk bakgrunn for hele embedding-arkitekturen.