Innhold Vis

Black Forest Labs lanserte FLUX.2-small-decoder denne uken – en destillert VAE-dekoder som fungerer som en direkte utskifting av den vanlige FLUX.2-dekoderen. Resultatet er ~1,4x raskere dekoding og tilsvarende redusert VRAM-bruk, med minimalt kvalitetstap. Og ja – den er Apache 2.0, altså helt fri å bruke kommersielt.

Hvis du kjører FLUX.2 lokalt og har slitt med at dekodingssteget tar tid eller spiser VRAM du trenger til selve genereringen – dette er svaret. Small decoder bytter du bare inn i eksisterende oppsett uten å endre noe annet.

Jeg har fulgt FLUX.2-familien siden lanseringen, og dette er akkurat typen oppdatering jeg liker: ingen ny modell å laste ned, ingen endring i workflow – bare en del som er blitt raskere og slankere. Min erfaring med FLUX.2 har vært god fra starten, men VRAM er alltid en flaskehals lokalt.

Hva er egentlig en VAE-dekoder?

Litt bakgrunn for de som ikke jobber med diffusjonsmodeller daglig: bildegenerering med FLUX.2 skjer i to steg. Først genererer modellen et bilde i et komprimert latent rom – tenk på det som et kodet bilde som ikke er menneskelig lesbart. Deretter dekoder en VAE (Variational Autoencoder) dette til faktiske RGB-piksler som du kan se og lagre.

VAE-dekoderen er ikke den tyngste delen av genereringen, men den koster likevel VRAM og tid. Og siden den kjøres på slutten av hver generering – uansett antall steps og modellvalg – hoper det seg opp hvis du genererer mange bilder.

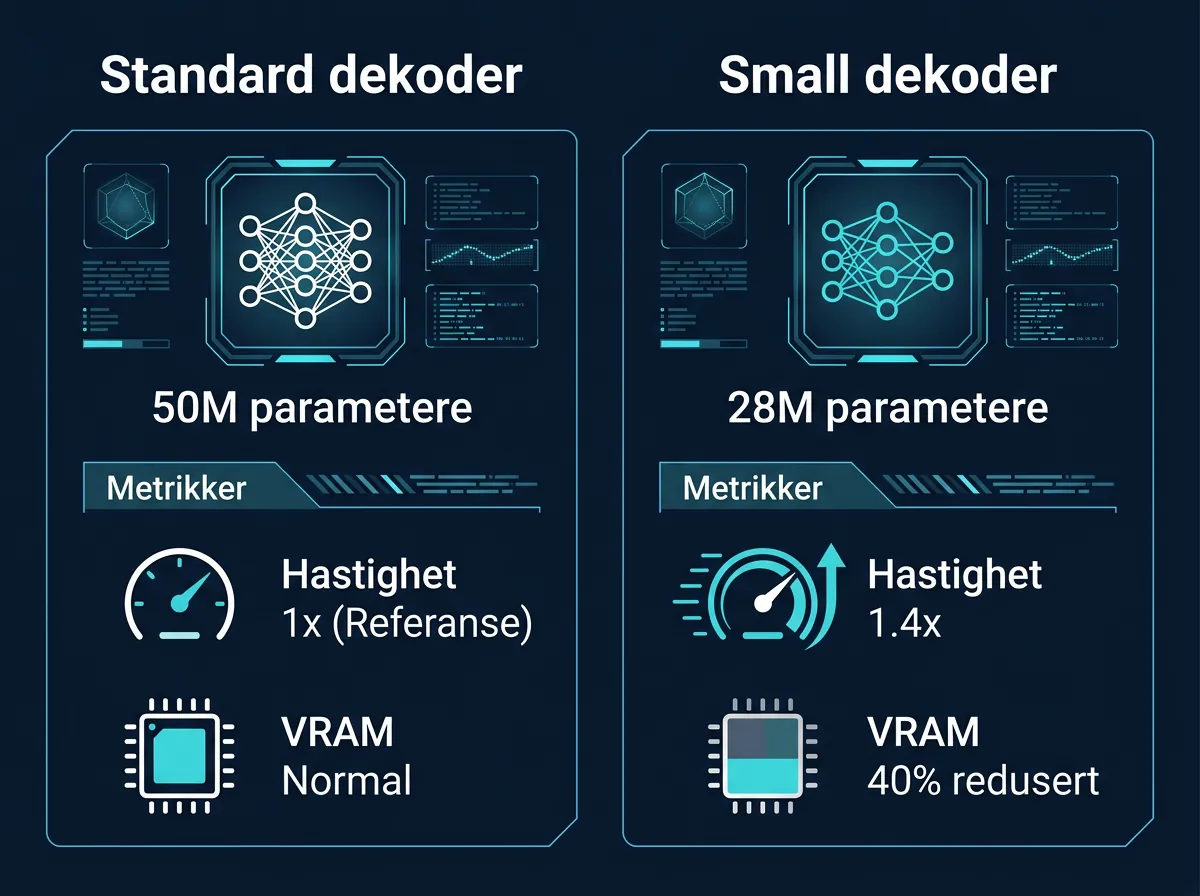

Small decoder er en destillert variant: samme jobb, men modellen er trimmet fra ~50 millioner parametere til ~28 millioner. Kanalbredden er redusert fra [128, 256, 512, 512] til [96, 192, 384, 384]. Det er den tekniske forklaringen på at den bruker mindre minneplass og er raskere å kjøre.

Hvor mye raskere, og hva taper du?

Black Forest Labs oppgir ~1,4x raskere dekoding og ~1,4x lavere VRAM-forbruk under dekodingssteget ifølge den offisielle Hugging Face-siden. Det er ikke dramatisk, men det er heller ikke ubetydelig – særlig for deg som kjører på grensen av hva GPUen tåler.

Kvalitetstapet er beskrevet som minimalt. I praksis betyr det at bildene ser tilnærmet identiske ut. Destillasjonen er trent til å etterligne full dekoder-output, ikke til å ta snarveier som synes i sluttresultatet.

Hvilke FLUX.2-modeller fungerer den med?

Small decoder er kompatibel med alle åpne FLUX.2-modeller:

- FLUX.2-klein-4B – den letteste varianten, klarer seg med 13 GB VRAM

- FLUX.2-klein-9B – mellomvariant med litt mer kapasitet

- FLUX.2-klein-9b-kv – KV-cache-optimalisert variant

- FLUX.2-dev – 32 milliarder parametere, den store modellen

Det er verdt å merke seg at dette ikke er en ny genereringsmodell – det er kun dekodersteget som byttes ut. Selve modellen du bruker for bildesyntesen forblir uendret. Kompatibiliteten er derfor bred: du bytter én komponent og resten av pipelinen fungerer som normalt.

Slik bytter du inn small decoder

Installasjonen er grei. Du trenger diffusers fra GitHub (foreløpig ikke i stabil release), og deretter laster du bare inn small decoder som VAE-parameter:

pip install git+https://github.com/huggingface/diffusers.git

import torch

from diffusers import Flux2KleinPipeline, AutoencoderKLFlux2

vae = AutoencoderKLFlux2.from_pretrained(

"black-forest-labs/FLUX.2-small-decoder",

torch_dtype=torch.bfloat16

)

pipe = Flux2KleinPipeline.from_pretrained(

"black-forest-labs/FLUX.2-klein-4B",

vae=vae,

torch_dtype=torch.bfloat16

)Bytt ut FLUX.2-klein-4B med den modellen du bruker. Samme mønster gjelder for dev og de andre variantene. Resten av koden din – prompts, steps, guidance scale – trenger ingen endringer.

Hvorfor dette er et smart trekk fra Black Forest Labs

Det er noe jeg respekterer med Black Forest Labs: de fokuserer på å gjøre modellene sine bedre å bruke, ikke bare å lansere nye. Small decoder er ikke en ny flagship-modell – det er en vedlikeholdsoppdatering som gjør eksisterende modeller mer tilgjengelige for folk med vanlig hardware.

Tenk på det fra perspektivet til noen med en RTX 4070 eller 4070 Ti. Disse kortene har 12-16 GB VRAM. FLUX.2-dev med 32 milliarder parametere er allerede krevende – enhver reduksjon i overhead er verdifull. 1,4x bedre dekodingshastighet er ikke revolusjonerende, men det er én ting mindre å bekymre seg for.

Og Apache 2.0 på en forbedret komponent? Det er nettopp slik open source bør fungere. Black Forest Labs holder kjerne-modellene proprietære (FLUX.2-dev er ikke helt fri), men infrastrukturen – som VAE – slipper de under åpen lisens. Det er en fornuftig linje.

Har du satt opp FLUX.2 lokalt allerede? Small decoder er verdt å teste neste gang du oppdaterer oppsettet. Ta en titt på Hugging Face-siden for den komplette modellkortsbeskrivelsen og kodeeksempler.

1 kommentar