Innhold Vis

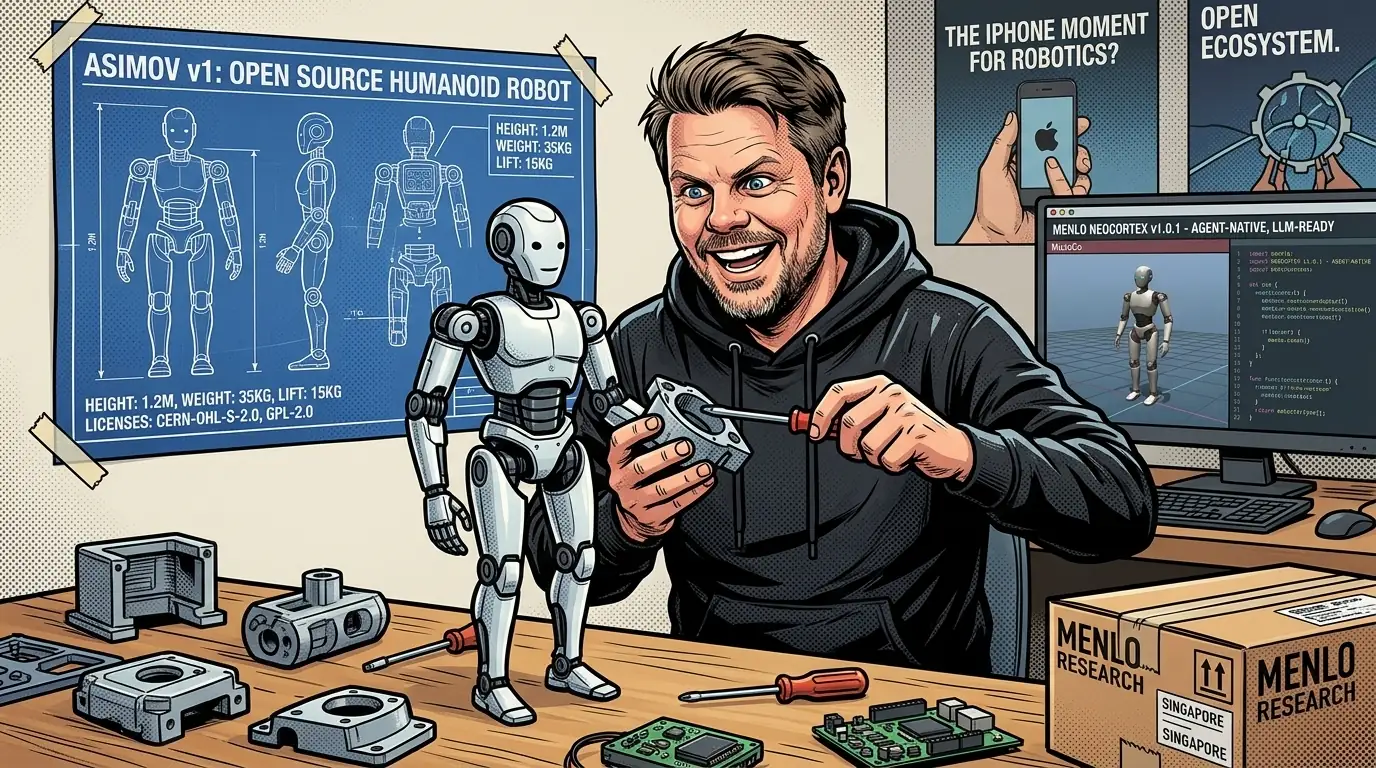

Asimov v1 er en humanoid robot på 1,2 meter og 35 kg som Menlo Research open-sourcer under CERN-OHL-S-2.0 og GPL-2.0-lisenser. Selskapet slapp alle CAD-filer, mekanisk dokumentasjon og en MuJoCo-simuleringsmodell til GitHub 31. mars 2026 – og robotteknologi for under 150 000 kroner er plutselig ikke science fiction lenger.

Det er lenge siden jeg har sett et robotprosjekt som faktisk imponerer meg. De fleste «open source robot»-prosjekter er enten leketøy eller akademiske kuriositeter med 200 000-prislapper. Asimov treffer et interessant punkt: avansert nok til å være nyttig, billig nok til at det faktisk kan skje noe i et bredere økosystem.

Her er det som gjør dette interessant – og noen spørsmål jeg sitter igjen med etter å ha gravd litt i spesifikasjonene.

Hva er Asimov v1?

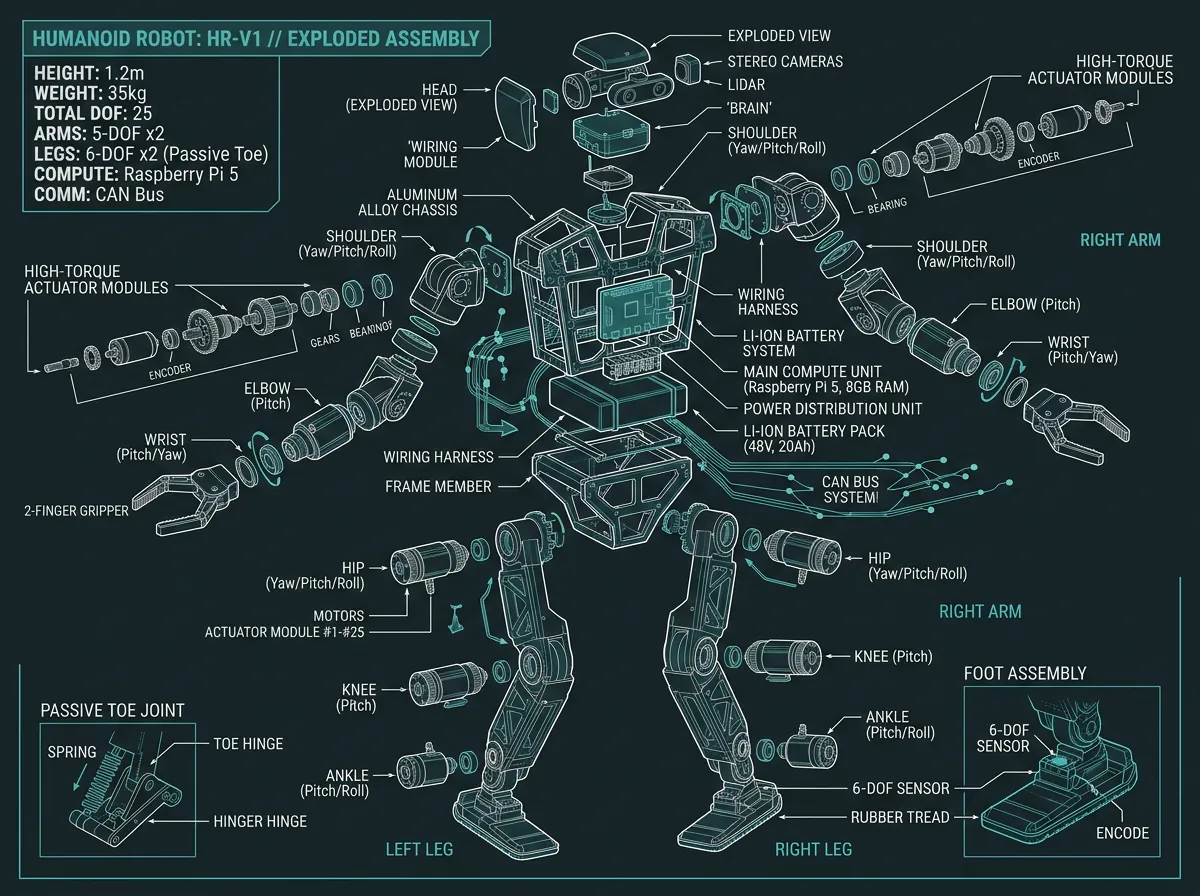

Asimov v1 er en tobeint humanoid robot laget av Singapore-baserte Menlo Research gjennom selskapet Asimov Inc. Roboten er 1,2 meter høy, veier rundt 35 kg, og har 25 til 27 aktuerte frihetsgrader avhengig av konfigurasjon.

Beina har seks frihetsgrader hver med passive tåledd som hjelper med gangsyklus – en detalj som viser at de har tenkt seriøst på bevegelse, ikke bare statikk. Armene er doble fem-frihetsgrads konstruksjoner, pluss ett-frihetsgrads midje og to-frihetsgrads nakke med integrert kamera og mikrofonarray.

Onboard compute er ikke fancy: Raspberry Pi 5 håndterer media og nettverk, Radxa CM5 tar seg av bevegelseskontroll. Kommunikasjon skjer via dual CAN-buss på 1 Mbps og 500 kbps. Det høres primitivt ut sammenlignet med Nvidia Jetson-baserte alternativer, men det holder kostnadene nede og gjør systemet forutsigbart å jobbe med.

Hva koster Asimov v1?

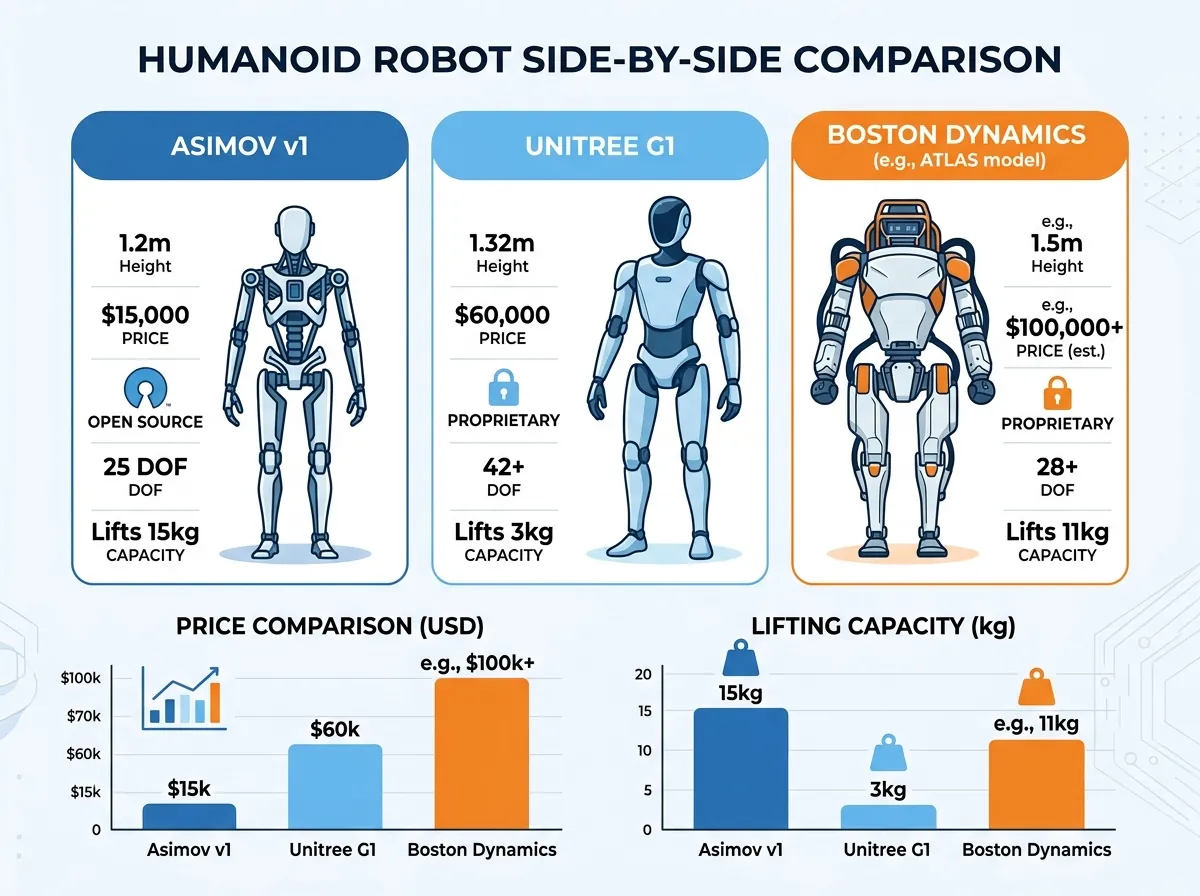

Målpris for DIY-kittet er 15 000 dollar – rundt 165 000 kroner med dagens kurs. Forhåndsbestilling krever 499 dollar i depositum, og levering er planlagt til sommeren 2026 ifølge Asimov Inc sin produktside.

Til sammenligning: Unitree G1 starter på rundt 60 000 dollar. Boston Dynamics Spot er enda dyrere. Det er faktisk et prishopp som betyr noe.

Menlo Research forklarer at 30 000 dollar er det absolutte kostnadsmålet som styrer alle hardware- og designvalg. Universelle motorfester lar deg bytte ut bein, armer og torso uavhengig av hverandre. De fleste strukturelle deler er designet for Multi Jet Fusion (MJF) 3D-printing, som gir høy styrke uten dyre CNC-bearbeidingskostnader.

Hva er egentlig åpent i open source-versjonen?

Per nå inneholder GitHub-repositoriet mekaniske CAD-design i STEP-format, elektrisk dokumentasjon, og en MuJoCo-simuleringsmodell. Det er et godt startpunkt.

Veikart for kommende utgivelser inkluderer komplette elektriske skjemaer, API-lag, gangpolicyer (locomotion policies) og en mobilapp. Disse er ikke ute ennå – noe som betyr at du ikke kan bygge en fullt fungerende gangrobot fra GitHub i dag, men fundamentet er der.

Lisensen er dual: CERN-OHL-S-2.0 for hardware (en sterk copyleft-lisens som krever at avledede hardware-design deles tilbake) og GPL-2.0 for programvare. Dette er ikke Apache 2.0 eller MIT. Bygger du noe på toppen, må du dele det tilbake. Det er en bevisst valgt strategi for å bygge et fellesskap, ikke en kommersiell plattform.

Neocortex – ikke standard ROS

Et interessant designvalg er at Menlo Research har laget sitt eget proprietære robotoperativsystem kalt Neocortex, i stedet for å bygge på ROS2 (Robot Operating System 2) som er industristandardben.

Begrunnelsen er at ROS2 er designet for industrielle roboter, ikke AI-agentdrevne humanoide. Neocortex er ifølge Menlo agent-nativt og bygget for tett integrasjon med LLM-baserte kontrollsystemer. Om dette er genuint innovativt eller et klassisk «vi lager vår egen stack»-feilgrep fra et startup gjenstår å se. Historien er full av begge utfall.

Robotikk-fellesskapet er ekstremt ROS2-sentrisk. En proprietær OS-lag kan bli en barriere for de tusenvis av utviklere som allerede kan ROS2. Jeg hadde foretrukket å se en ROS2-kompatibel abstraksjonslag her.

Hvordan sammenligner Asimov v1 seg med Unitree G1?

Teamet bak Asimov nevner Unitree G1 direkte som motivasjon: G1 klarte ikke å holde tritt med utviklingstempoet, spesielt fordi reservedeler tok to måneder å få tak i. Det er et reelt problem som alle som har jobbet med proprietær hardware kjenner.

Asimov v1 er kortere enn G1 (1,2 m vs 1,32 m) og veier omtrent like mye. Styrken er imponerende på papiret: rundt 15 kg per arm for bicep-curl og 18 kg for lateral raises. For sammenligning kan G1 løfte rundt 3 kg per arm i standard konfigurasjon. Det er en massiv forskjell – om tallene holder i praksis.

Jeg har sett nok robotikk-demonstrasjoner til å vite at «på papiret»-tall og faktisk ytelse i fri bevegelse er to veldig forskjellige ting. Men spesifikasjonene er lovende, og åpen kildekode betyr at fellesskapet kan verifisere og forbedre det.

Som jeg har skrevet om tidligere har vi nærmet oss et iPhone-øyeblikk for humanoide roboter – og prosjekter som Asimov er nettopp de katalysatorene som kan utløse det.

Hva er Menlo Research og hvem er bak dette?

Menlo Research er et Singapore-basert selskap. Asimov Inc er i praksis Menlos robotikk-produktlinje. Utover det er informasjonen om teamet begrenset per nå – noe som er litt merkelig for et prosjekt som ber folk om 499 dollar i depositum.

GitHub-kontoen asimovinc viser at de har jobbet med roboten over tid – det finnes også et asimov-v0-repository som dokumenterer tidlig utvikling. Dette er ikke et over-natt-prosjekt.

Sammenlignet med Hugging Face sin Reachy Mini (299 dollar desktop-robot) sikter Asimov mot et fundamentalt annet marked – ikke hobbyentusiaster, men folk som faktisk vil drive robotforskning eller bygge på toppen av plattformen.

Er dette verdt å følge med på?

Robotikk-feltet har sett nok vapourware til at skepsis er velberettiget. Men noen ting skiller Asimov fra typisk hype: faktiske CAD-filer er ute, simuleringsmodellen er tilgjengelig, og prisnivået er realistisk nok til å tro på det.

Det jeg savner er mer åpenhet om teamet og et klarere bilde av hva Neocortex faktisk kan gjøre i dag kontra på veikart. «Agent-nativt OS» er en vakker setning, men jeg vil se kode og benchmarks.

Gemini Robotics-ER 1.6 viste nylig at AI-drevne roboter begynner å løse virkelige problemer. Asimov v1 handler om noe litt annet – de bygger plattformen som gjør det mulig for mange å eksperimentere med slike AI-lag. Det er en god innsats å gjøre åpen.

Er du interessert i å følge utviklingen? GitHub-repositoriet er det beste stedet å starte – og open source betyr at du faktisk kan bidra til å forme hva dette blir.

Hva er neste steg for Asimov-prosjektet?

Ifølge veikart på GitHub er disse delene på vei: komplette elektriske skjemaer, et åpent API-lag, ferdige gangpolicyer basert på RL-trening i MuJoCo-simulering, og en mobilapp for enklere kontroll.

Summer 2026-leveringen for DIY-kittet er ambisiøs. Leveringsplan fra et robotikk-startup bør alltid tas med en klype salt – men 499 dollar er lite nok å satse på å se hva som skjer.

For de som ønsker å grave dypere er min guide til open source AI i 2026 et godt startpunkt for å forstå hvorfor åpen kildekode i AI og hardware kan bli viktigere enn de proprietære alternativene på sikt.

Asimov v1 er ikke ferdig. Det er ikke en plug-and-play-løsning. Men det er et seriøst forsøk på å bygge fundamentet for et åpent robotikk-økosystem – og etter Honor Lightnings halvmaraton-rekord og Geminis robotikk-fremskritt begynner open source å bli et genuint alternativ til proprietære plattformer fra Boston Dynamics og Unitree.

Det er i hvert fall verdt å holde et øye med hvordan den humanoide robot-utviklingen fortsetter å akselerere.