Innhold Vis

GAIA er et open-source rammeverk fra AMD for å bygge AI-agenter som kjører helt lokalt – ingen sky, ingen abonnement, ingen data som forlater maskinen din. Lisensiert under MIT og tilgjengelig på amd-gaia.ai, støtter det både Python og C++17. AMD startet utviklingen i 2024 og vedlikeholder prosjektet aktivt gjennom 2026.

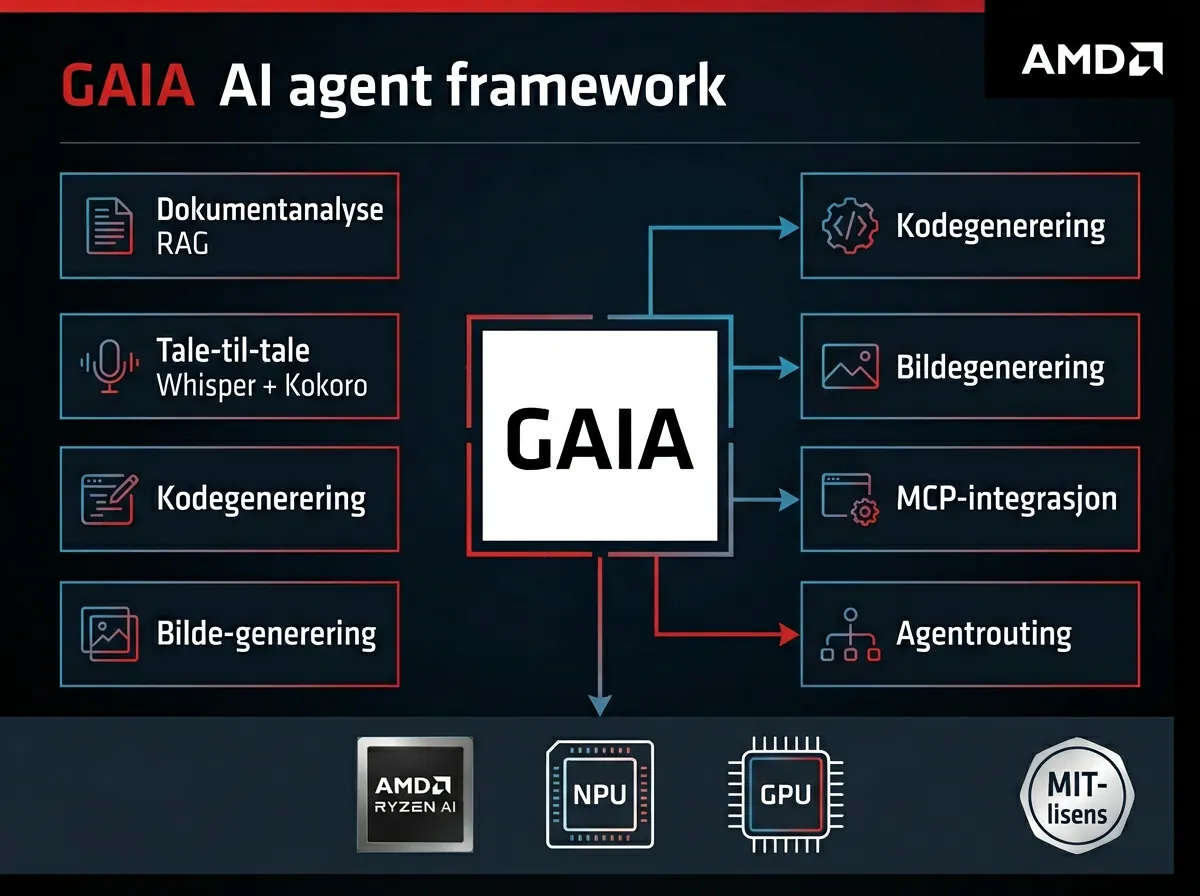

Det som skiller GAIA fra mange andre lokale AI-løsninger er bredden. Det er ikke bare en modell-runner. Rammeverket dekker hele stabelen – dokumentanalyse (RAG), tale-til-tale, kodegenerering, bildegenerering og integrasjon med eksterne verktøy via Model Context Protocol (MCP). Alt lokalt. Alt på din maskinvare.

Hacker News tok godt imot lanseringen med over 100 poeng, men kommentarfeltet avslørte noe viktig: det er et gap mellom hva AMD lover og hva AMD-brukere faktisk opplever. Det er verdt å se nærmere på begge deler.

Hva kan GAIA faktisk gjøre?

Funksjonslisten er imponerende. GAIA lar deg bygge agenter som kan resonere, kalle verktøy, søke i dokumenter og ta handlinger – alt uten internettforbindelse. Her er de viktigste kapabilitetene:

- Dokumentanalyse med RAG: Indekser PDF-er og tekstfiler lokalt, still spørsmål mot dem. Ingen data til OpenAI, ingen API-kostnader.

- Tale-til-tale: Bruker Whisper for talegjenkjenning (ASR) og Kokoro for talesyntese (TTS). Du kan bokstavelig talt snakke med agenten din.

- Kodegenerering: Multi-fil kodeproduksjon med validering innebygd.

- Bildegenerering: Multimodal bildeproduksjon med LLM-forbedring av prompts.

- MCP-integrasjon: Koble til eksterne verktøy og tjenester via Model Context Protocol – samme protokoll som Claude Code bruker.

- Agentrouting: Intelligente forespørsler dirigeres automatisk til de riktige spesialiserte agentene.

Tre inngangspunkter støttes: Agent UI via npm (for de som vil ha et grafisk grensesnitt), Python SDK og native C++-binærer. For folk som allerede bruker Python til AI-prosjekter, er SDK-innfallet åpenbart. C++-varianten er for de som trenger maksimal ytelse og minimal overhead.

Optimalisert for AMD – men hva betyr det i praksis?

GAIA er spesifikt optimalisert for AMD Ryzen AI-prosessorer med NPU- og GPU-akselerasjon. NPU (Neural Processing Unit) er den dedikerte AI-brikken i nyere Ryzen-prosessorer – den er designet for å kjøre inferens effektivt uten å belaste CPU eller GPU unødvendig.

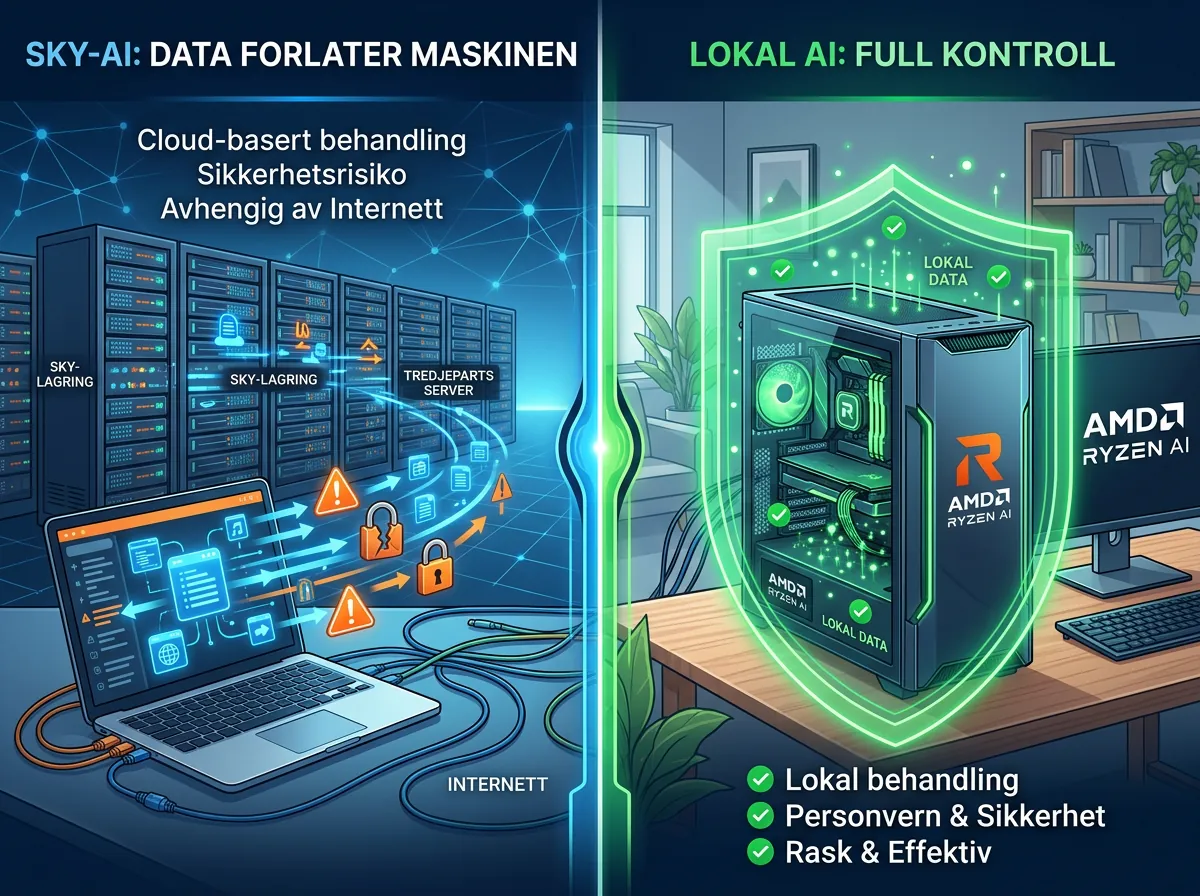

I teorien betyr dette at du kan kjøre GAIA-agenter på en bærbar PC med Ryzen AI uten at viften spinner opp og batteriet tømmes på en halvtime. Det er et genuint interessant brukstilfelle – lokal AI-agent på en arbeidslaptop, uten skyavhengighet.

I praksis er det litt mer nyansert. Hacker News-kommentarene var opplysende. Brukere med RDNA4-kort rapporterte månederlange venter på korrekte Tensile-kjerner for gfx1201-arkitekturen. En kommentator oppsummerte det treffende: «Hvis du faktisk kjører lokal inferens på AMD, bruker du mest tid på CUDA-kompatibilitetslag, ikke på AI-delen.»

AMD prioriterer åpenbart CDNA (serverchips) over RDNA (forbrukerkort). Det er en forretningsmessig logikk bak det, men det frustrerer folk som vil bruke Radeon-kortene sine til lokal AI. NVIDIA bygde CUDA-støtte bredt tidlig – det er et signal om langsiktig engasjement som AMD ennå ikke har sendt på samme måte.

Positive erfaringer finnes. Ollama fungerer stabilt på AMD med Linux, spesielt med kvantiserte modeller. Men det er unntaket, ikke regelen – og GAIA bygger videre på det samme ROCm-grunnlaget som fortsatt er under utvikling.

Hvem bør se nærmere på GAIA?

For deg som allerede har AMD-maskinvare og vil eksperimentere med lokale AI-agenter, er GAIA definitivt verdt en titt. MIT-lisensen betyr full frihet – bruk det til alt, modifiser det, bygg videre på det.

Python SDK-en er porten inn. Installer den, se hva du kan bygge, og vurder deretter om AMD-ytelsen holder mål for ditt brukstilfelle. Det er en rimelig rekkefølge i stedet for å investere i AMD-hardware spesifikt for GAIA.

For de som allerede har investert i NVIDIA-hardware, er det neppe grunn til å bytte. Sammenlign gjerne med hva Nvidia AI-Q gjør på NVIDIA-siden – et tilsvarende open-source agentinitiativ, men med et mer modent GPU-økoystem i ryggen.

Er lokal AI-agentbygging klar for mainstream?

GAIA er et symptom på en større trend: store teknologiselskaper tar lokal AI på alvor. AMD, NVIDIA, Microsoft – alle bygger rammeverk for å la folk kjøre AI-agenter uten sky.

Det er bra. Mer konkurranse her betyr bedre verktøy for alle. Og prinsippet bak GAIA – agenter som resonnerer og handler lokalt, uten at dataene dine forlater maskinen – er genuint verdifullt. For dokumentanalyse med sensitive filer. For kodeassistanse uten at koden sendes til et eksternt API. For automatisering du faktisk kontrollerer.

Selve rammeverket er solid. MCP-integrasjonen er smart – det betyr at GAIA-agenter kan snakke med de samme verktøyene som Claude og andre moderne AI-systemer bruker. Det gir interoperabilitet i stedet for nok et lukket økoystem.

Om du er nysgjerrig på open source AI generelt, gir min komplette guide til open source AI i 2026 god kontekst for hvor GAIA passer inn i det større bildet. Og AMD-posisjonering i AI-kappeløpet er noe jeg har sett nærmere på i forbindelse med Metas massive AMD-kjøp – det er tydelig at AMD har ambisjoner her, selv om execution fortsatt henger etter.

GAIA er verdt å følge med på. Ikke nødvendigvis å sette i produksjon nå, men å ha på radaren. Når ROCm-støtten modnes og AMD begynner å levere mer konsistent på RDNA-siden, kan dette bli et seriøst alternativ for de som vil ha full kontroll over sine AI-agenter uten å sende alt til skyen.