Alt jeg har skrevet om

AI-Nyheter

251 innlegg

AI-verdenen beveger seg fort, og jeg prøver å holde deg oppdatert på det som faktisk betyr noe. Ikke alt som skjer er viktig – men når noe stort lander, enten det er en ny modell, et oppkjøp eller en teknologisk milepæl, får du min take på det her. Over 100 artikler og det stopper ikke.

SenseNova-U1 – nativ multimodal AI uten VAE og diffusion

SenseNova-U1 er en ny åpen kildekode-modell fra SenseTime som genererer bilder uten VAE, visuell encoder eller diffusion-prosess. NEO-Unify-arkitekturen behandler tekst og piksler nativt i én modell – og åpner for tekstrendering og infografikk der diffusion-modeller tradisjonelt mislykkes.

Mistral Medium 3.5 128B lansert – open weights, 256k kontekst og sterk kodeytelse

Mistral AI lanserte Medium 3.5 29. april 2026 – en 128 milliarder parameter tett modell med 256k kontekstvindu, open weights under modifisert MIT-lisens og sterk ytelse på koding og agentic oppgaver. API-pris $1,50/$7,50 per million tokens.

General Motors ruller Gemini ut til 4 millioner biler

General Motors ruller Google Gemini ut til rundt 4 millioner biler via over-the-air oppdatering. Årsmodell 2022 og nyere Cadillac, Chevrolet, Buick og GMC med Google Built-in er kvalifisert. Gemini erstatter Google Assistant og gir samtalebasert AI med tilgang til kjøretøydata, navigasjon og klimakontroll.

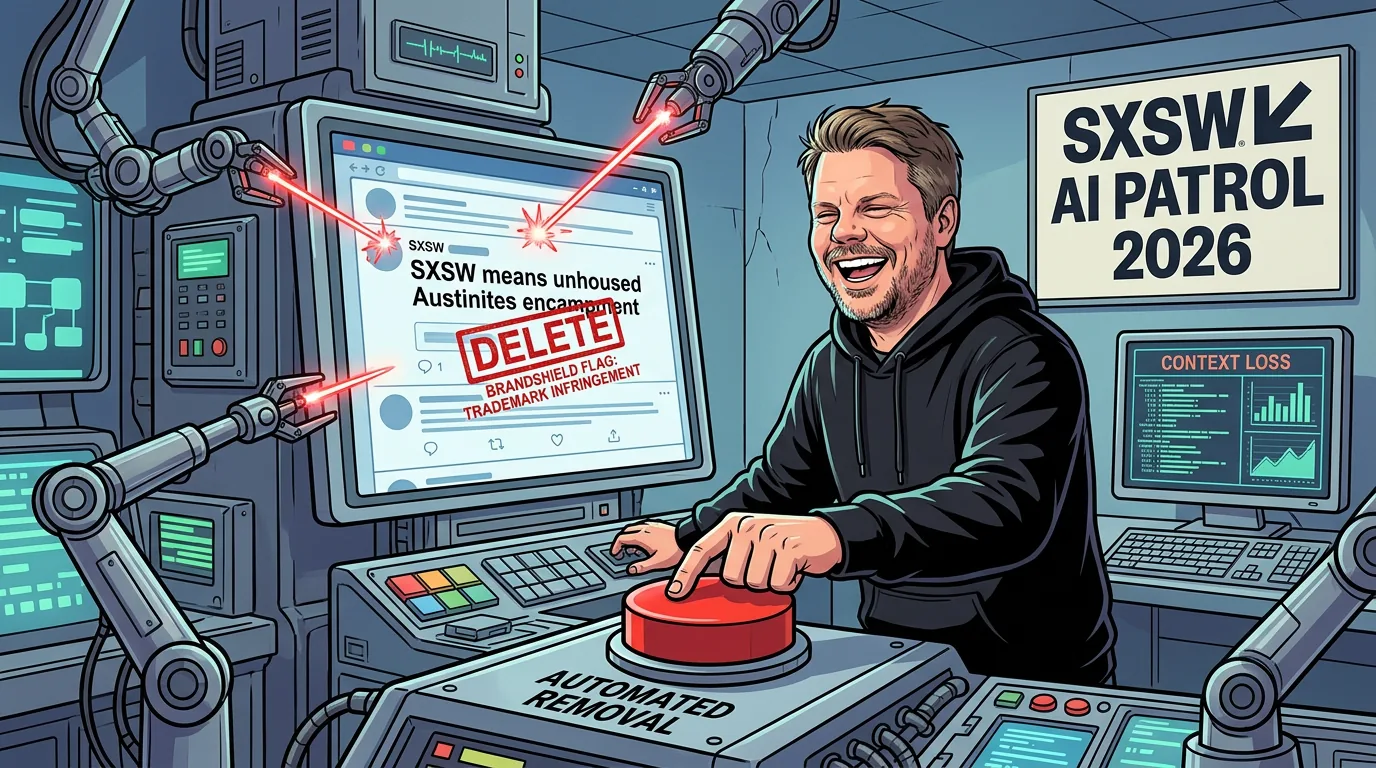

SXSW brukte AI-verktøy til å fjerne kritiske Instagram-innlegg

SXSW brukte AI-verktøyet BrandShield til automatisk å fjerne Instagram-innlegg som kritiserte festivalen. Lovlig politisk ytring ble sensurert fordi algoritmen ikke skiller mellom varemerkebrudd og kritikk. EFF kaller det «pretty clearly over-enforcement.»

Poolside AI lanserer Laguna XS.2 og M.1 – spesialiserte agentic coding-modeller

Poolside AI lanserte 28. april 2026 sine to første offentlige modeller: Laguna M.1 (225B/23B aktive parametere) og Laguna XS.2 (33B/3B aktive, Apache 2.0). Begge er bygget for agentic coding og lange autonome kodingssessjoner – og begge er gratis via API og OpenRouter nå.

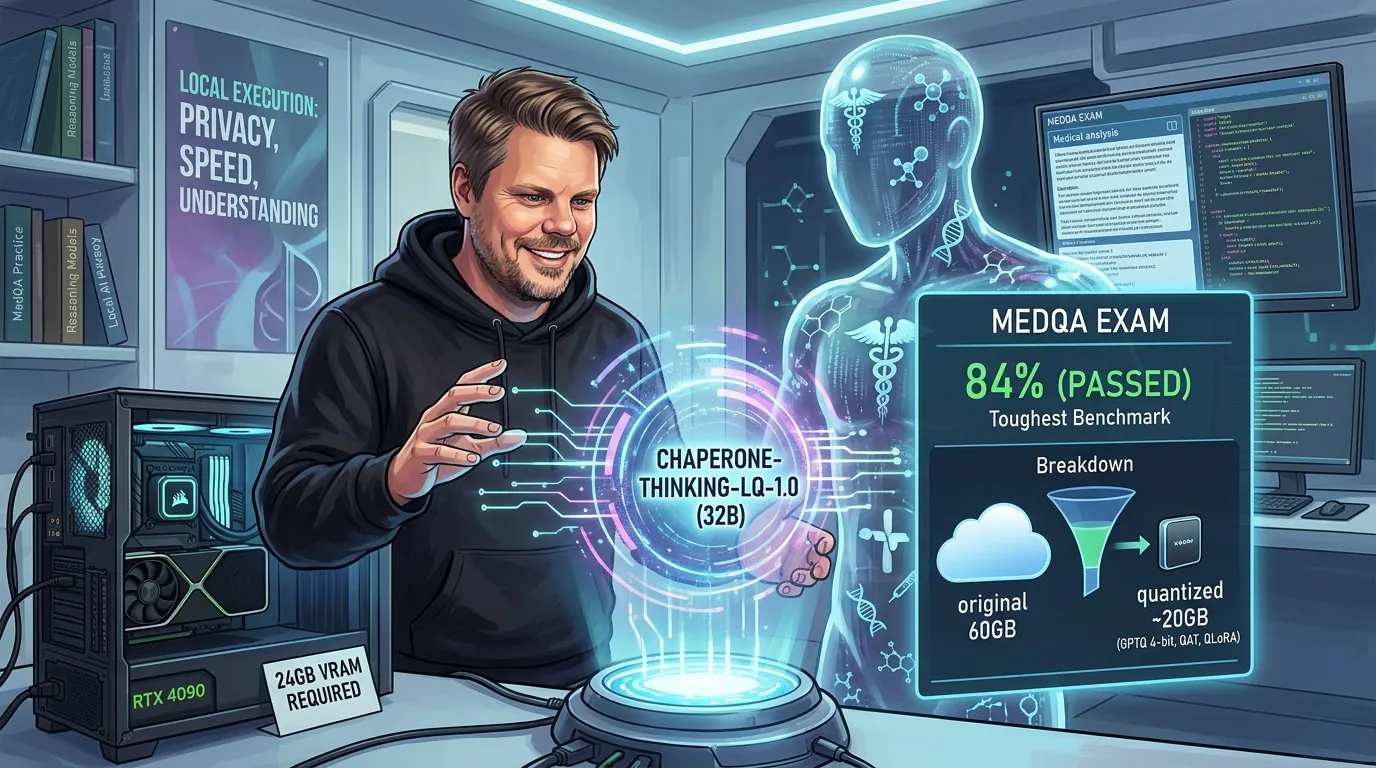

Chaperone-Thinking-LQ-1.0 – medisinsk AI som scorer 84% på legeeksamen og kjører på 20GB

Chaperone-Thinking-LQ-1.0 er en open source medisinsk AI-modell basert på DeepSeek-R1-Distill-Qwen-32B, kvantisert til ~20GB via GPTQ og finjustert med QLoRA på medisinske korpus. Modellen scorer 84% på MedQA-benchmarket og kan kjøres lokalt på en RTX 3090 eller 4090.